重新整理了PCA相关的原理和推导

从最小二乘出发, 其原理可以描述为: 在数据空间 χ \chi χ中寻找一个超平面, 让数据样本到该超平面的距离平方之和最小.

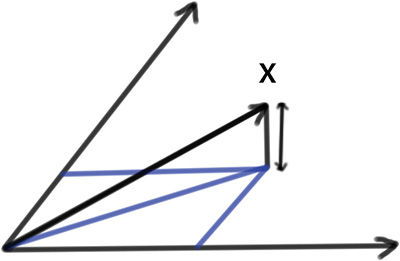

数据点到超平面距离的计算试为该点向量减该点在超平面上的投影所得向量的长度, 即

d i s t ( x i , p l a n e ) = ∣ ∣ x i − x ^ i ∣ ∣ 2 dist(x_i,plane)=||\textbf{x}_i-\hat{\textbf{x}}_i||_2 dist(xi,plane)=∣∣xi−x^i∣∣2

下标2表示L2范数, 几何解释如图

假设该超平面由 d ′ d' d′个标准正交向量张成, 即

p l a n e = s p a n { w 1 , w 2 , w 3 , . . . , w d ′ } , s . t . w i ⋅ w j = δ i j plane = span\{\textbf{w}_1,\textbf{w}_2,\textbf{w}_3,...,\textbf{w}_{d'}\},\\ s.t.\ \ \textbf{w}_i\cdot \textbf{w}_j=\delta_{ij} plane=span{

w1,w2,w3,...,wd′},s.t. wi⋅wj=δij

令 W = [ w 1 , w 2 , w 3 , . . . , w d ′ ] W=[\textbf{w}_1,\textbf{w}_2,\textbf{w}_3,...,\textbf{w}_{d'}] W=[w1,w2,w3,...,wd′],则 PCA的优化目标可表示为

a r g min W ∑ i ∣ ∣ x i − x ^ i ∣ ∣ 2 2 s . t . W T W = I (1) arg\min_{W}{\sum_i{||\textbf{x}_i-\hat{\textbf{x}}_i||^2_2}}\\ s.t.\ \ W^TW=I\tag{1} argWmini∑∣∣xi−x^i∣∣22s.t. WTW=I(1)

由线性代数知识可知, 数据点 x i x_i xi在超平面上的投影可表示为

x ^ i = ∑ j = 1 d ′ ( w j T x i ) w j \hat{\textbf{x}}_i = \sum_{j=1}^{d'}{(\textbf{w}_j^T\textbf{x}_i) \textbf{w}_j} x^i=j=1∑d′(wjTxi)wj

于是优化目标可写为

a r g min W ∑ i ∣ ∣ ∑ j = 1 d ′ ( w j T x i ) w j − x i ∣ ∣ 2 2 s . t . W T W = I (2) arg\min_{W}{\sum_i{||\sum_{j=1}^{d'}{(\textbf{w}_j^T\textbf{x}_i) \textbf{w}_j}-\textbf{x}_i||^2_2}}\\ s.t.\ \ W^TW=I\tag{2} argWmini∑∣∣j=1∑d′(wjTxi)wj

本文深入探讨主成分分析(PCA),从最小二乘法出发,逐步推导PCA的优化目标,揭示PCA实际上寻找的是数据协方差矩阵的最大特征值对应的特征向量。通过特征值分解,PCA实现数据的降维,从而降低复杂性和提高效率。

本文深入探讨主成分分析(PCA),从最小二乘法出发,逐步推导PCA的优化目标,揭示PCA实际上寻找的是数据协方差矩阵的最大特征值对应的特征向量。通过特征值分解,PCA实现数据的降维,从而降低复杂性和提高效率。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

348

348

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?