02 依恋与目标

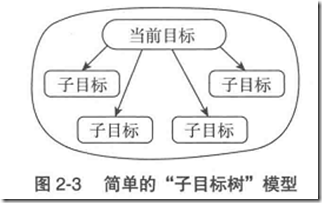

人类的一些目标是天生的本能,是由我们的基因决定的;另一些目标则是通过“尝试和错误”学习,来实现已有目标的次级目标;而高层次目标则是由一种特殊的机器体系形成的。这种特殊的机器体系是指我吗对身为依恋对象的父母,朋友或亲人的价值观的继承,这些价值观积极地响应了我们的需要,在我们体内产生了“自我意识”情感。

沙子游戏:从叉子到勺子

学习知识重要,而学习的目的和原因更重要。--很有哲理的话,适用于我们每个人。

从卡罗尔玩沙子的游戏带给我们的思考:比较流行的观点认为,有助成功的“积极”感觉会帮助我们学习新的表现方法,而造成失败的“消极”感觉则会抑制我们的表现。然而,虽然“正强化学习”方式适合一些动物,却不能充分解释人类如何学习这一个问题。这是因为在很多情况下,尤其是当我们想要获得更深层次的思想时,失败要比成功更具有意义。

依恋与目标

大部分哺乳动物在出生后不久就跟随母亲四处行走,但人类除外。为什么婴儿的发展步伐如此缓慢呢?原因之一,人类大脑的发展和成熟需要更长时间。 孩子们不再有足够的时间从个体经历中学习,而是通过“被告知”(being told)的方式来学习。

为使文化知识成功地从父母那里传递给孩子,双方都需要拥有保持注意力的有效方法。

随着孩子的成长,他们也会渐渐关注父母对自己的反应,父母也会开始注重对孩子价值观和目标的培养。

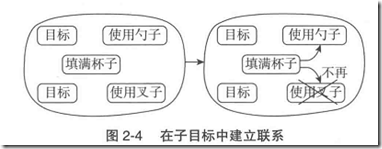

学习如何得到自己想要的东西是一回事,而了解自己应该想要什么是另一回事。在“尝试和错误”的常规学习中,我们改善了实现已有目标的方法。然而,当有“自我意识”进行目标反思时,我们就非常有可能改变目标的优先级。这里强调的是自豪和羞愧等自我意识情感发挥着独特的作用,它们帮我们了解结果而非方法。

价值观和目标的形成受到我们所依恋的人的影响和左右,至少在价值观形成早期如此。

印刻者

我们不仅需要学习获得成功的方法,还要学习如何避免最为常见的错误。这暗示我们,精神联系应该通过成功机制加以“巩固”,但当某种行动不起作用时也应受到压制。

印刻者(imprimer):指孩子依恋的对象。

依恋性学习模式

为何个人价值的发展取决于儿童时代的依恋呢?看看两者是如何相关的:失去父母的尊重,将不利于孩子健康成长;如果父母自己想要赢得朋友们的尊重,便会要求孩子的“行为”得到社会的接受和认可。

学习、快乐和信用赋能

在重塑记忆方面,快乐到底扮演着什么样的作用?

大脑必须首先描述If和Then, 你学习的质量将取决于以下两条描述的内容:

- If 描述了相关特征和面临情况之间的关系

- Then 描述了取得成功的步骤

人们开始学习时,不仅仅是学习“制造联系”的问题,还是在学习制造能够被联系起来的结构。这意味着我们既需要寻找表现外部事件的方法,也需要寻找表达内部相关精神状态的方法。

价值体系的塑造

个人特质部分取决于不同人的遗传因素,但部分却是由社会依恋网塑造的。

探索、解释以及学习是孩子们最为持久的驱动力。

幼儿和动物的依恋

是什么因素造成孩子将会对谁产生依恋?身体方面的培养发挥着很大的作用。以下两种因素更为重要:

- 人们的反应速度;

- 交互强度。

当婴幼儿的印刻者不在场时,婴幼儿会在较长时间内处于伤害之中。

独处的孩子没有获得足够多的生存智慧,因此,我们需要延长孩子和印刻者相处的时间,在这段时间里孩子不得不向印刻者学习。

谁是我的印刻者

自律,构建目标一致的自我模型

公众印刻

究竟什么因素使得这些“名人”如此受欢迎。引人注目的外貌特征是其中一个因素。同时,他们擅长营造各种情感状态。最有效的技巧是让每一个听众都产生这样一种感觉:“一个很重要的人在和我说话”,相应的,听众觉得自己也参与进去了,因此也更能主动地进行回应。

本章主要解释 人们是如何选择自己的目标的。一些目标是基于天生的本能,由我们的基因决定的;而另一些目标是通过学习(尝试和错误)实现已有目标的次级目标。至于高层次目标,认为是由一种特殊的机器体系形成的,这种特殊的机器体系指我们对依恋对象价值观的继承,因为这些价值观积极地响应了我们的需要,在我们体内产生了“自我意识”情感,如羞愧和自豪。

起初,印刻者离我们很近,但一旦我们有了印刻者的“思维模型”,当印刻者不在场时,我们就可以使用这些模型来“升华”目标。最终,这些模型就成了我们所谓的良心、理想和道德规范。所以,依赖教会我们的是结果而不是方式,也把父母的梦想强加到了我们身上。

830

830

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?