2.6 C5层-卷积层

**输入数据:**S4层的全部16个单元特征map(与s4全相连)

卷积核大小:5*5

卷积核种类(通道数):120

输出数据(输出特征图output feature map):1*1

2.7 F6层-全连接层

**输入数据:**120维向量

**输出数据:**84维向量

2.8 Output层-全连接层

**输入数据:**84维向量

**输出数据:**10维向量

三、代码实现(采用的激活函数为relu函数)

3.1 搭建网络框架

(1)导包:

import torch

import torch.nn as nn

import torch.nn.functional as F

(2)**定义卷积神经网络:**由于训练数据采用的是彩色图片(三通道),因此与上面介绍的通道数有出入。

class Net(nn.Module):

def __init__(self):

super(Net,self).__init__()

self.conv1 = nn.Conv2d(3,6,5)

self.conv2 = nn.Conv2d(6,16,5)

self.fc1 = nn.Linear(16*5*5,120)

self.fc2 = nn.Linear(120,84)

self.fc3 = nn.Linear(84,10)

def forward(self,x):

x = self.conv1(x)

x = F.relu(x)

x = F.max_pool2d(x,(2,2))

x = F.max_pool2d(F.relu(self.conv2(x)),2)

x = x.view(-1,x.size()[1:].numel())

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

(3)**测试网络效果:**相当于打印初始化部分,可以查看网络的结构

net = Net()

print(net)

3.2 定义数据集

(1)导包:

import torchvision

import torchvision.transforms as transforms

(2)下载数据集:

解决Downloading data from https://www.cs.toronto.edu/~kriz/cifar-10-python.tar.gz国内下载速度缓慢的问题:

解决方法:

①下载文件:**下载地址:**https://pan.baidu.com/s/1Nh28RyfwPNNfe_sS8NBNUA

提取码:1h4x

②将下载好的文件重命名为cifar-10-batches-py.tar.gz

③将文件保存至相应地址下即可

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.5,0.5,0.5),(0.5,0.5,0.5))

])

trainset = torchvision.datasets.CIFAR10(root='./data',train=True,download=True,transform=transform)

testset = torchvision.datasets.CIFAR10(root='./data',train=False,download=True,transform=transform)

trainloader = torch.utils.data.DataLoader(trainset,batch_size=4,shuffle=True,num_workers=0)

testloader = torch.utils.data.DataLoader(testset,batch_size=4,shuffle=False,num_workers=0)

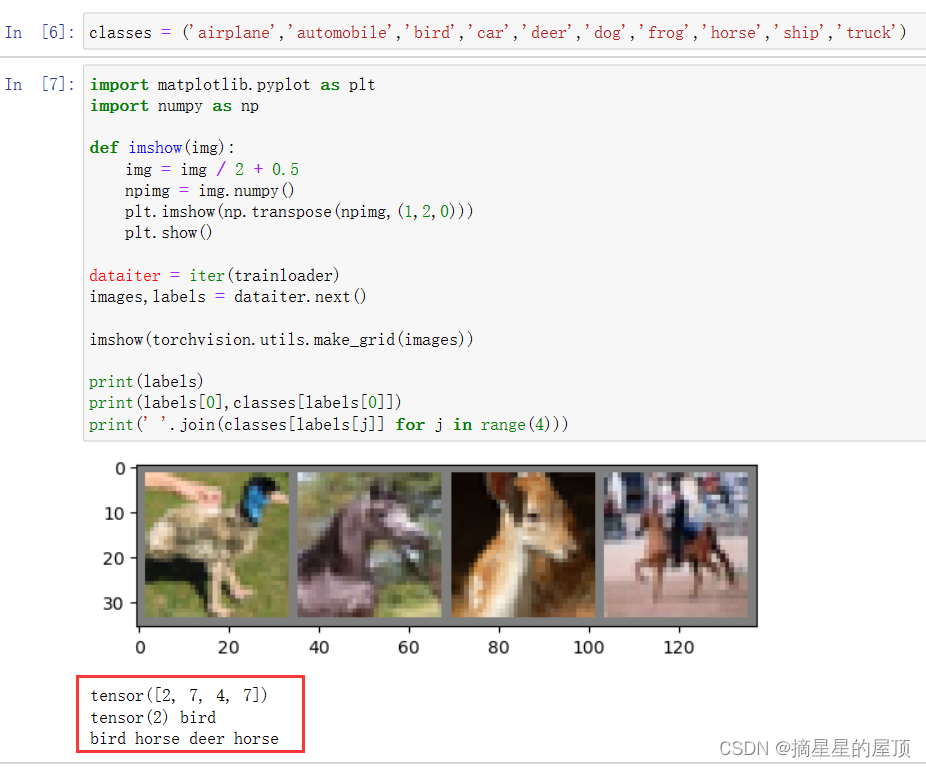

(3)定义元组:进行类别名的中文转换

classes = ('airplane','automobile','bird','car','deer','dog','frog','horse','ship','truck')

(4)运行数据加载器:使用绘图函数查看数据加载效果

import matplotlib.pyplot as plt

import numpy as np

def imshow(img):

img = img / 2 + 0.5

npimg = img.numpy()

plt.imshow(np.transpose(npimg,(1,2,0)))

plt.show()

dataiter = iter(trainloader)

images,labels = dataiter.next()

imshow(torchvision.utils.make_grid(images))

print(labels)

print(labels[0],classes[labels[0]])

print(' '.join(classes[labels[j]] for j in range(4)))

3.3 定义损失函数与优化器

(1)**定义损失函数:**交叉熵损失函数

criterion = nn.CrossEntropyLoss()

(2)**定义优化器:**让网络进行更新,不断更新好的参数,达到更好的效果

import torch.optim as optim

optimizer = optim.SGD(net.parameters(),lr=0.001,momentum=0.9)

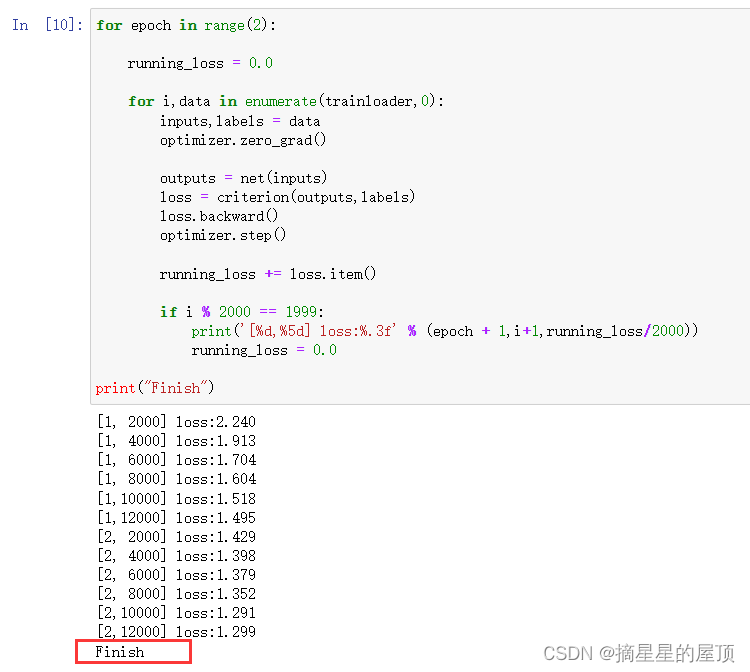

3.4 训练网络

for epoch in range(2):

running_loss = 0.0

for i,data in enumerate(trainloader,0):

inputs,labels = data

optimizer.zero_grad()

outputs = net(inputs)

loss = criterion(outputs,labels)

loss.backward()

optimizer.step()

running_loss += loss.item()

if i % 2000 == 1999:

print('[%d,%5d] loss:%.3f' % (epoch + 1,i+1,running_loss/2000))

running_loss = 0.0

print("Finish")

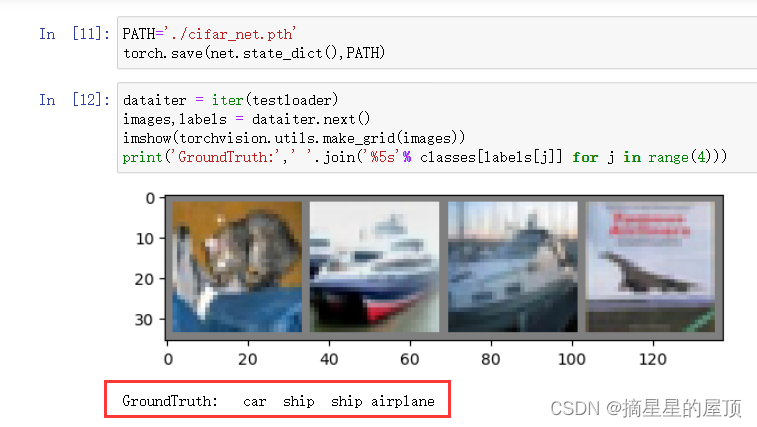

3.5 测试网络

(1)**保存学习好的网络参数:**将权重文件保存到本地,之后可以直接调用该文件

PATH='./cifar_net.pth'

torch.save(net.state_dict(),PATH)

(2) 测试一组图片的训练效果

dataiter = iter(testloader)

images,labels = dataiter.next()

imshow(torchvision.utils.make_grid(images))

print('GroundTruth:',' '.join('%5s'% classes[labels[j]] for j in range(4)))

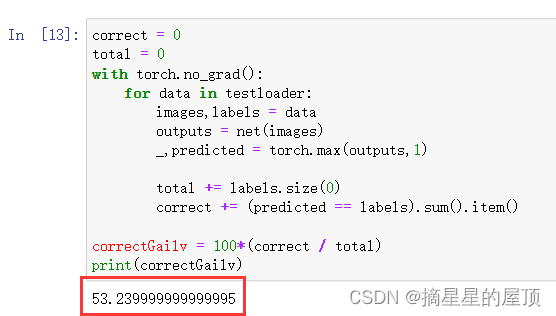

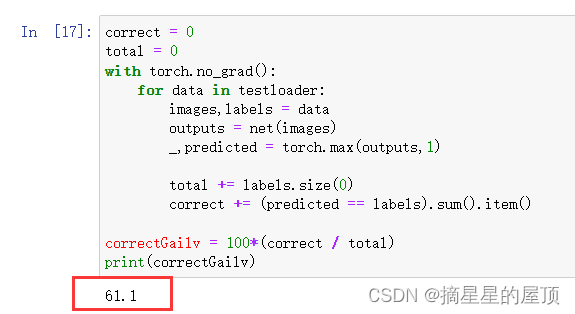

(3)观察整个训练集的测试效果

correct = 0

total = 0

with torch.no_grad():

for data in testloader:

images,labels = data

outputs = net(images)

_,predicted = torch.max(outputs,1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

correctGailv = 100*(correct / total)

print(correctGailv)

注意:可通过修改epoch中训练的轮数提高准确率。通过将epoch训练的轮数从2修改为10,准确率可得到较大提高,如下图所示:

四、小结

(1)与“目前的CNN”相比,LeNet有以下几个不同点:

①激活函数不同:LeNet使用sigmoid函数,而目前的CNN中主要使用ReLU函数,在上面的代码中也使用的是ReLU函数;

②原始的LeNet中使用子采样(subsampling)缩小中间数据的大小,而目前的CNN中Max池化是主流。

(2)存在的疑问:

①卷积层的神经元节点个数与卷积层的输出通道数的关系?

卷积层的神经元节点个数=卷积层的输出feature map的元素数目(即输出feature map的宽,高和通道数之积)。每个输出通道上的神经元是参数共享的,所以可认为卷积层的神经元节点个数=卷积层的输出feature map的通道数(即卷积核的个数)。

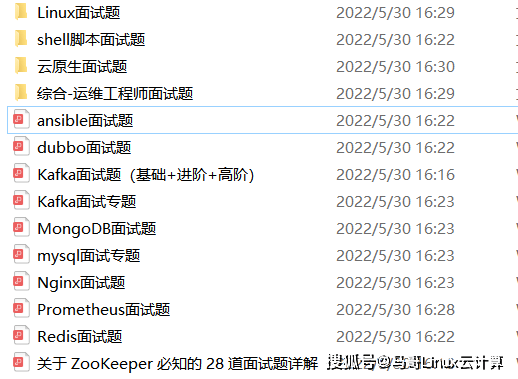

为了做好运维面试路上的助攻手,特整理了上百道 【运维技术栈面试题集锦】 ,让你面试不慌心不跳,高薪offer怀里抱!

这次整理的面试题,小到shell、MySQL,大到K8s等云原生技术栈,不仅适合运维新人入行面试需要,还适用于想提升进阶跳槽加薪的运维朋友。

本份面试集锦涵盖了

- 174 道运维工程师面试题

- 128道k8s面试题

- 108道shell脚本面试题

- 200道Linux面试题

- 51道docker面试题

- 35道Jenkis面试题

- 78道MongoDB面试题

- 17道ansible面试题

- 60道dubbo面试题

- 53道kafka面试

- 18道mysql面试题

- 40道nginx面试题

- 77道redis面试题

- 28道zookeeper

总计 1000+ 道面试题, 内容 又全含金量又高

- 174道运维工程师面试题

1、什么是运维?

2、在工作中,运维人员经常需要跟运营人员打交道,请问运营人员是做什么工作的?

3、现在给你三百台服务器,你怎么对他们进行管理?

4、简述raid0 raid1raid5二种工作模式的工作原理及特点

5、LVS、Nginx、HAproxy有什么区别?工作中你怎么选择?

6、Squid、Varinsh和Nginx有什么区别,工作中你怎么选择?

7、Tomcat和Resin有什么区别,工作中你怎么选择?

8、什么是中间件?什么是jdk?

9、讲述一下Tomcat8005、8009、8080三个端口的含义?

10、什么叫CDN?

11、什么叫网站灰度发布?

12、简述DNS进行域名解析的过程?

13、RabbitMQ是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

17、如何重置mysql root密码?

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

17、如何重置mysql root密码?

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

本文详细介绍了使用PyTorch实现LeNet-5风格的卷积神经网络,包括卷积层、全连接层的配置,以及如何处理CIFAR-10数据集,展示了从网络构建、数据预处理到训练和测试的完整流程。

本文详细介绍了使用PyTorch实现LeNet-5风格的卷积神经网络,包括卷积层、全连接层的配置,以及如何处理CIFAR-10数据集,展示了从网络构建、数据预处理到训练和测试的完整流程。

101

101

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?