网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

–executor-memory 1G

–total-executor-cores 1

examples/jars/spark-examples_2.11-2.3.2.jar

10

上述命令参数表示含义如下:

* 1、–master spark://hadoop01:7077:指定Master的地址是hadoop01节点

* 2、–executor-memory1G:指定每个executor的可用内存为1G

* 3、–total-executor-cores 1:指定每个executor使用的CPU核心数为1个

按【回车键】提交Spark作业后,观察Spark集群管理界面,其中“Running Applications”列表表示当前Spark集群正在计算的作业,执行几秒后,刷新界面,在Completed Applications表单下,可以看到当前应用执行完毕,返回控制台查看输出信息,出现了“`Pi is roughly 3.140691140691141`”,说明Pi值已经被计算完毕。,如下图所示。

计算出来的结果准确是由参数(命令中最后的10)决定的,这个参数越大,准确度超高。

在高可用模式提交任务时,可能涉及多个Master,在提交任务时,需要让SparkContext指向一个Master列表 ,执行提交任务的命令如下。

bin/spark-submit

–class org.apache.spark.examples.SparkPi

–master spark://hadoop01:7077,hadoop02:7077,hadoop03:7077

–executor-memory 1G

–total-executor-cores 1

examples/jars/spark-examples_2.11-2.3.2.jar

10

## 总结

在体验第一个Spark程序之前,确保已经安装好了Spark,并且配置环境变量和启动Spark集群。

首先,在终端中输入以下命令启动Spark集群:

sbin/start-all.sh

接着,创建一个新的Spark应用程序,命名为SparkPi,并在该应用程序中编写代码计算Pi的近似值。

import org.apache.spark.{SparkConf, SparkContext}

object SparkPi {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setAppName(“SparkPi”)

val sc = new SparkContext(conf)

val slices = if (args.length > 0) args(0).toInt else 2

val n = 100000 \* slices

val count = sc.parallelize(1 to n, slices).map { i =>

val x = Math.random() \* 2 - 1

val y = Math.random() \* 2 - 1

if (x \* x + y \* y <= 1) 1 else 0

}.reduce(_ + _)

println("Pi is roughly " + 4.0 \* count / n)

sc.stop()

}

}

代码解释:

1. 创建SparkConf对象,设置应用程序的名称为"SparkPi"。

2. 使用SparkConf创建SparkContext对象,该对象将作为Spark应用程序的入口点。

3. 通过命令行参数获取切片的数量(默认为2),计算需要生成的随机点的总数。

4. 使用parallelize方法创建一个RDD,该RDD包含了1到n的数字,并指定了切片的数量。

5. 对每个数字进行映射操作,生成一个随机点,并判断该点是否在圆内。

6. 对所有随机点的结果进行reduce操作,得到圆内点的数量。

7. 根据公式计算Pi的近似值。

8. 打印结果并停止SparkContext。

保存代码到一个文件中,例如"SparkPi.scala"。

接下来,在终端中输入以下命令来编译和打包程序:

$SPARK_HOME/bin/spark-submit --class SparkPi --master spark:// SparkPi.jar

其中,"“是Spark集群的URL,例如"spark://localhost:7077”。

程序会开始运行,输出Pi的近似值。

最后,可以在Spark集群的Web界面上查看运行日志和结果。

通过体验第一个Spark程序,我们了解了Spark应用程序的基本结构和运行方式。可以进一步学习和探索更复杂的Spark程序,以及使用Spark的其他功能和API。

转载自:<https://blog.csdn.net/u014727709/article/details/132240278>

欢迎 👍点赞✍评论⭐收藏,欢迎指正

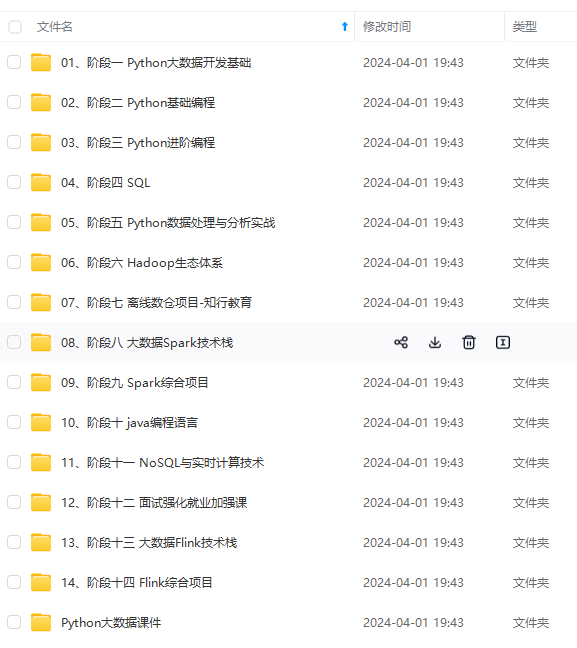

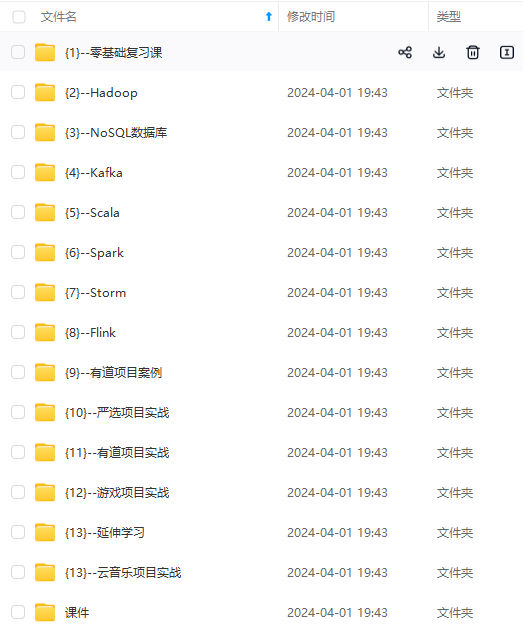

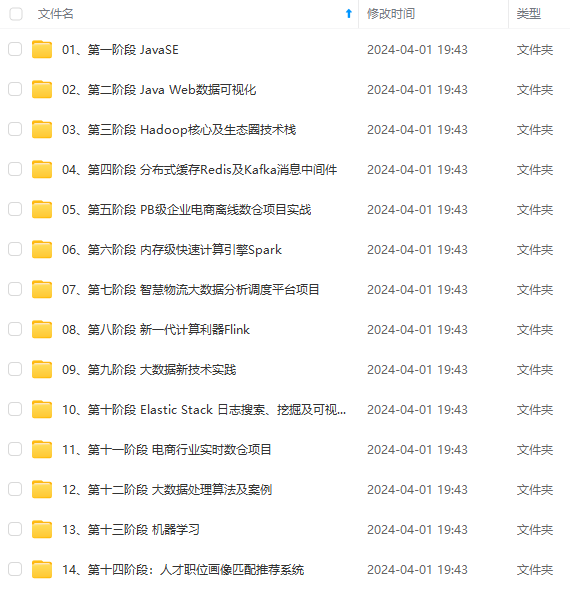

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

1157

1157

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?