3.1一元线性回归

正交回归的误差是点到直线的垂直距离

线性回归的误差是点到同横坐标的线上的点的纵坐标差——最小二乘法

二值离散特征:好看为1,不好看为2

有序的多值离散特征:小为1,中为2,大为3

无序的多值离散特征:黄为[1,0,0],黑为[0,1,0],白为[0,0,1]

初始化a=[0,0,0];

if(“=黄”) a[1]=1;

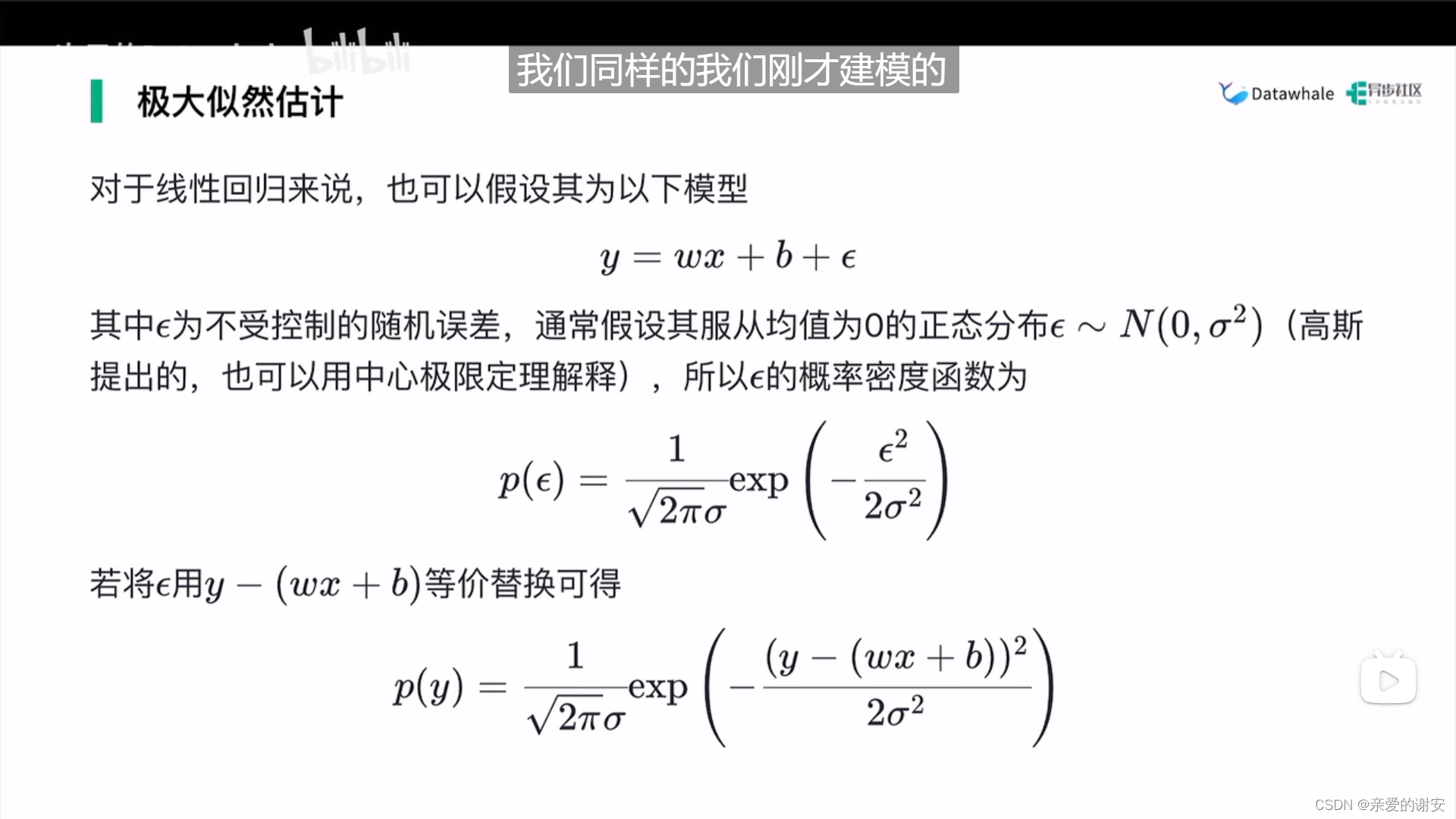

极大似然估计

对一个随机变量,如果我能大概感觉它是一个什么分布(比如正态分布),那么这个分布的参数要怎么求呢(比如μ和σ)?

我们认为那些使得观测样本出现概率最大的分布就是我们要的分布,也就是说,存在某些参数,使得观测样本出现的概率最大,这些参数就是我们要的。

举个例子,一大堆西瓜里,红色果肉和黄色果肉的比例我们不知道。那么随机抽样10个西瓜,重复很多次,发现红色果肉和黄色果肉的比例是9:1的出现次数最多,那么有理由认为,这么一大堆西瓜里面,红色果肉和黄色果肉的比例大概是9:1。(有点费西瓜哈)

一般而言,知道概率密度函数,通过独立同分布可知,各个样本的概率密度函数相乘得到联合密度函数,使得联合密度函数max的参数就是我们要求的参数。

遇到连乘、指数等比较难算的时候可以取对数。

一般而言,误差都是服从均值0的正态分布,高斯大佬提出的。

和最小二乘法殊途同归。

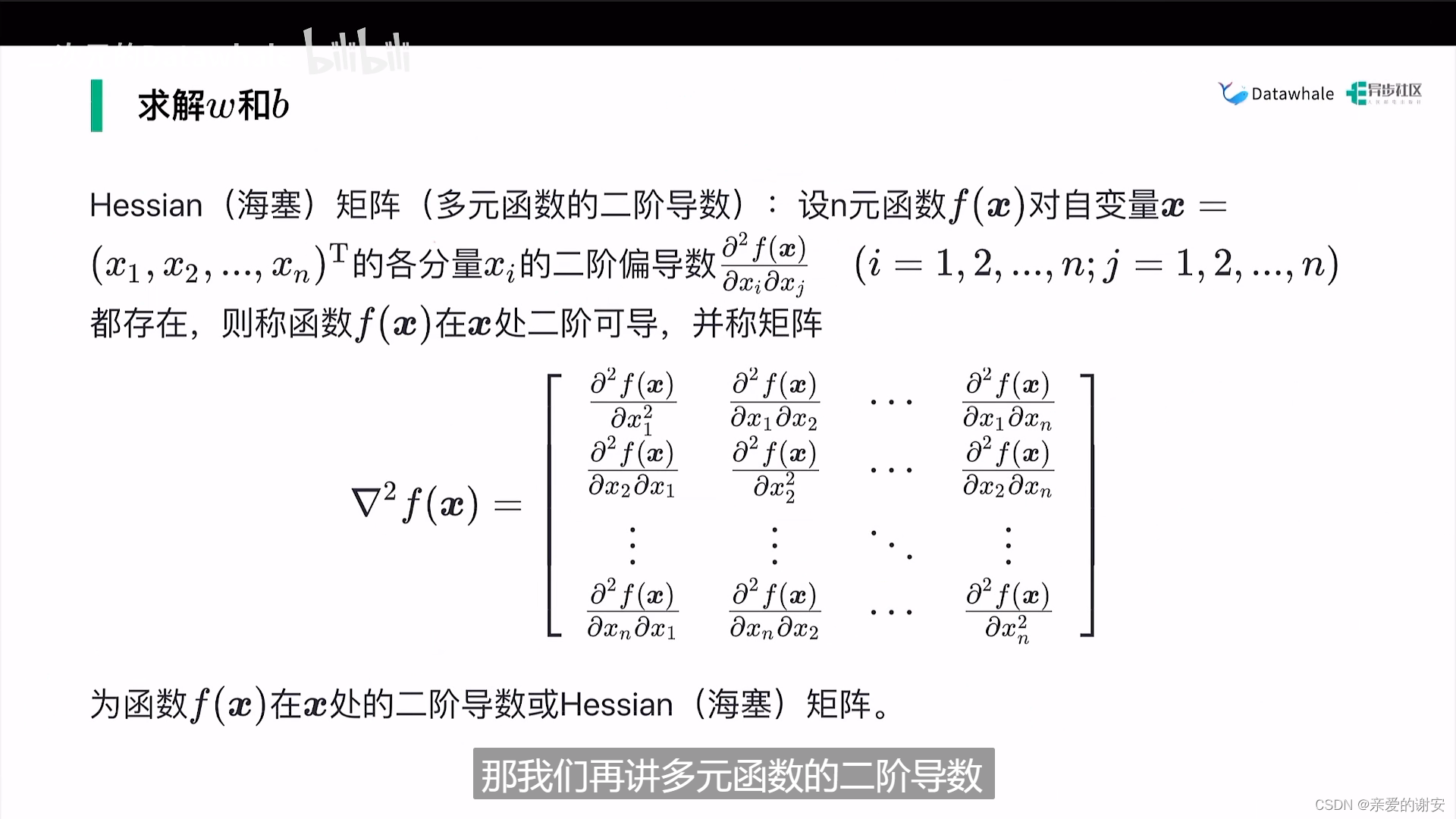

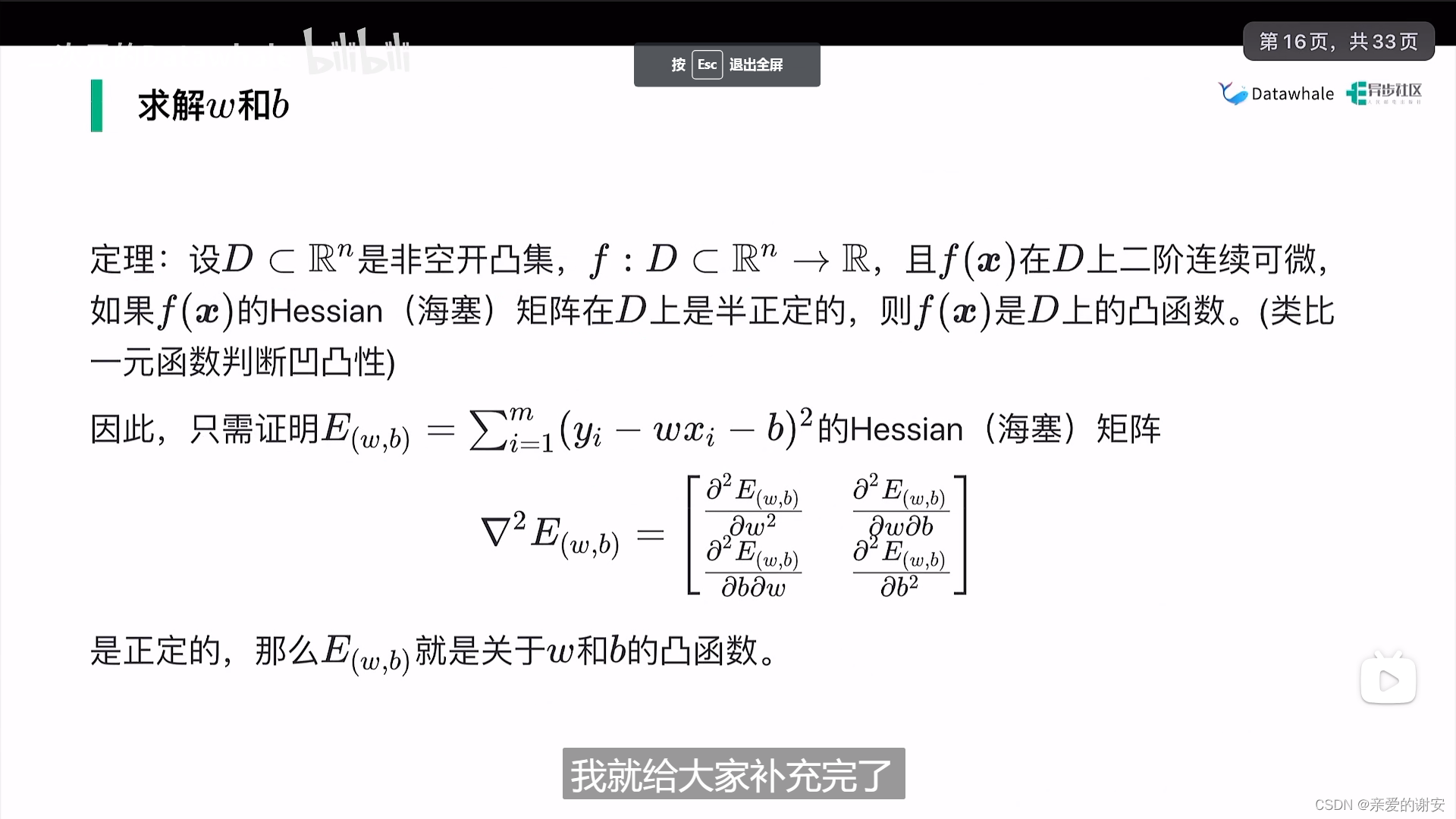

如果要能取最小值,先证函数的凸性,再一阶导等于0求。

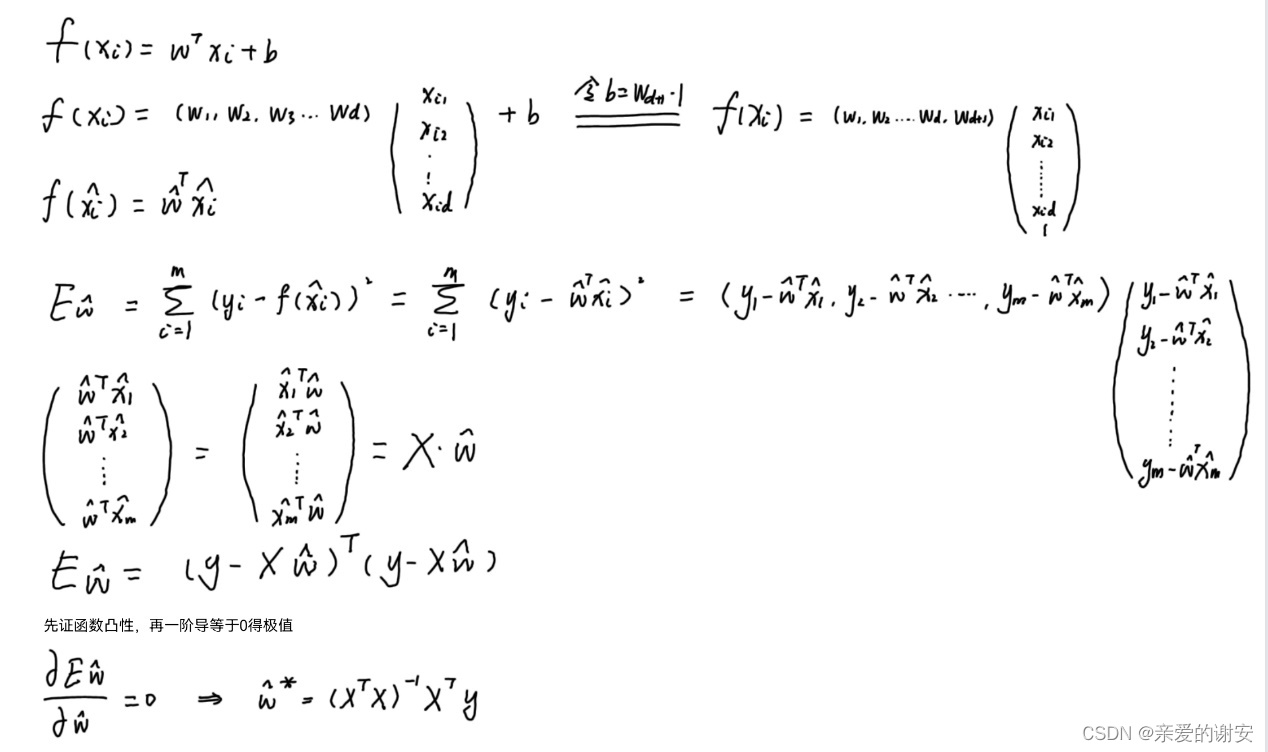

3.2多元线性回归

3.3对数几率回归

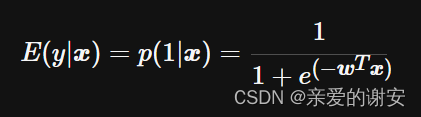

在线性模型的基础上套下面的函数,能够实现分类功能。

???

近似阶跃的单调可微函数

3.4二分类线性判别分析

从几何的角度,让全体训练样本经过投影后:

-异类样本的中心尽可能远

-同类样本的中心尽可能近

参考:

周志华,《机器学习》(西瓜书)

二次元的Datawhale,爱敲代码的异步社区,www.bilibli.com,BV1Mh411e7VU,【吃瓜教程】《机器学习公式详解》(南瓜书)与西瓜书公式推导直播合集

112

112

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?