自学动手学深度学习系列(可以直接对照图片代码)

多层感知机(MLP)从零实现

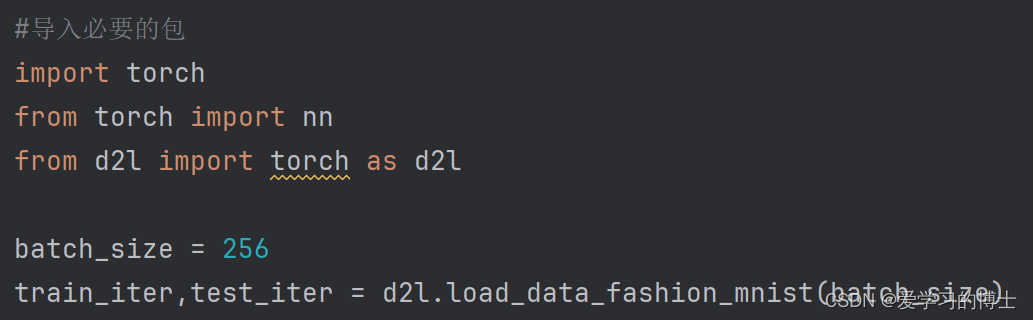

import torch

from torch import nn

from d2l import torch as d2l

batch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)

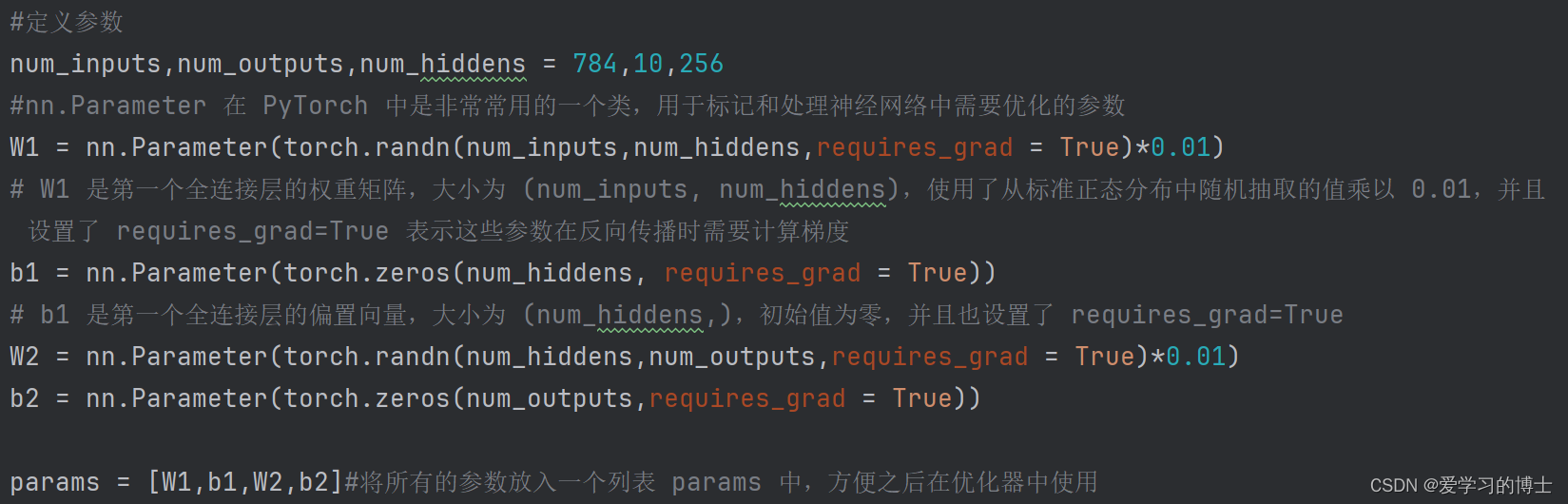

num_inputs, num_outputs, num_hiddens = 784, 10, 256

num_inputs, num_outputs, num_hiddens = 784, 10, 256

W1 = nn.Parameter(torch.randn(

num_inputs, num_hiddens, requires_grad=True) * 0.01)

# W1 是第一个全连接层的权重矩阵,大小为 (num_inputs, num_hiddens),使用了从标准正态分布中随机抽取的值乘以 0.01,并且设置了 requires_grad=True 表示这些参数在反向传播时需要计算梯度。

b1 = nn.Parameter(torch.zeros(num_hiddens, requires_grad=True))

# b1 是第一个全连接层的偏置向量,大小为 (num_hiddens,),初始值为零,并且也设置了 requires_grad=True

W2 = nn.Parameter(torch.randn(

num_hiddens, num_outputs, requires_grad=True) * 0.01)

# W2 是第二个全连接层的权重矩阵,大小为 (num_hiddens, num_outputs),同样是从标准正态分布中随机抽取的值乘以 0.01,并且设置了 requires_grad=True

b2 = nn.Parameter(torch.zeros(num_outputs, requires_grad=True))

# b2 是第二个全连接层的偏置向量,大小为 (num_outputs,),初始值为零,并且也设置了 requires_grad=True

params = [W1, b1, W2, b2]

#将所有的参数放入一个列表 params 中,方便之后在优化器中使用

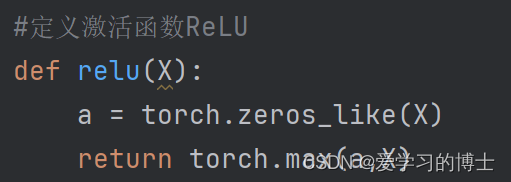

def relu(X):

a = torch.zeros_like(X)

return torch.max(X, a)

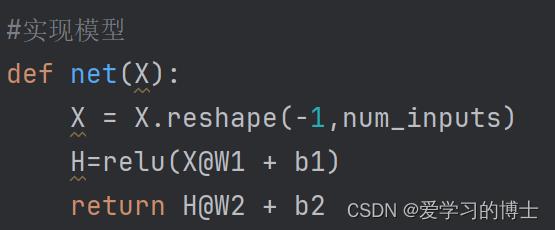

def net(X):

X = X.reshape((-1, num_inputs))

#这一行将输入 X 重塑为一个二维张量,第一维的大小由原始输入的维度决定,第二维的大小为 num_inputs,即输入特征的数量。这样做是为了确保输入的维度正确匹配第一层权重矩阵 W1 的期望维度

H = relu(X@W1 + b1) # 这里“@”代表矩阵乘法实现了第一层的前向传播

#X@W1 执行了矩阵乘法,将输入 X 与第一层的权重矩阵 W1 相乘,得到的结果是一个中间特征表示,relu(...) 表示对这个结果应用 ReLU 激活函数,确保输出非负

return (H@W2 + b2) #实现了第二层的前向传播,H@W2 执行了矩阵乘法,将第一层的输出 H 与第二层的权重矩阵 W2 相乘,得到最终的输出

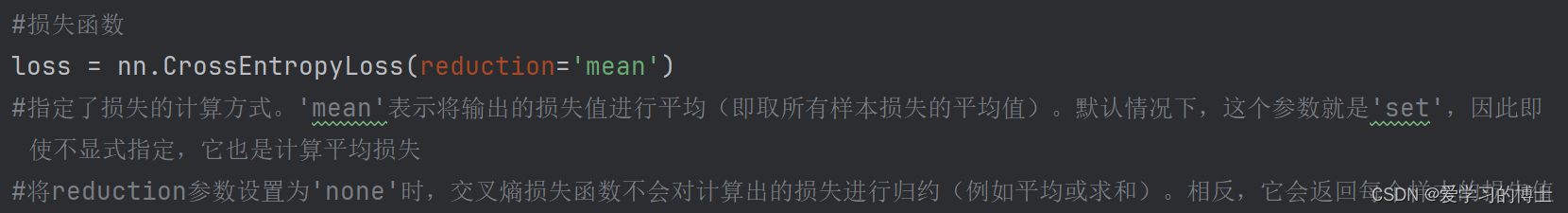

loss = nn.CrossEntropyLoss(reduction='none')

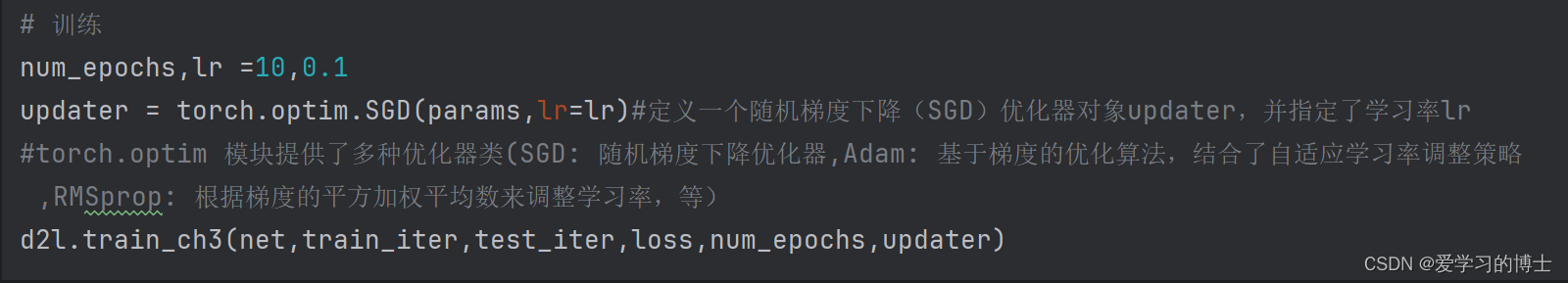

num_epochs, lr = 10, 0.1

updater = torch.optim.SGD(params, lr=lr)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, updater)

d2l.predict_ch3(net, test_iter)

633

633

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?