每周跟踪AI热点新闻动向和震撼发展 想要探索生成式人工智能的前沿进展吗?订阅我们的简报,深入解析最新的技术突破、实际应用案例和未来的趋势。与全球数同行一同,从行业内部的深度分析和实用指南中受益。不要错过这个机会,成为AI领域的领跑者。点击订阅,与未来同行! 订阅:https://rengongzhineng.io/

Mathstral:数学领域的革命性AI工具

为了增强解决复杂多步骤逻辑推理的高级数学问题的能力,Mathstral正式发布 (https://huggingface.co/mistralai/mathstral-7B-v0.1),旨在为科学界贡献力量。这次发布是我们支持学术项目的更广泛努力的一部分,Mathstral是在我们与Project Numina合作的背景下生产的。

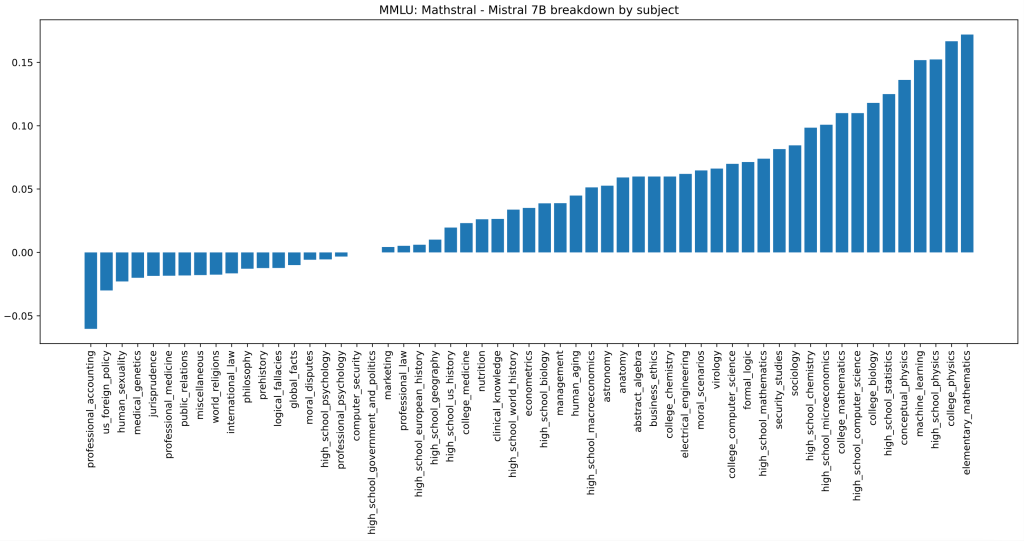

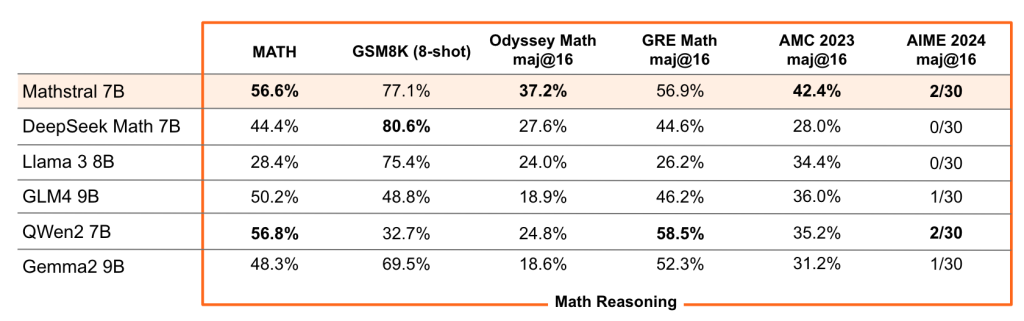

类似于艾萨克·牛顿在他那个时代的地位,Mathstral依托于Mistral 7B,专注于STEM(科学、技术、工程和数学)学科。在各种行业标准基准测试中,它在同类规模中实现了最先进的推理能力。具体来说,它在MATH测试中达到了56.6%的成绩,在MMLU测试中达到了63.47%的成绩,并且展示了Mathstral 7B和Mistral 7B在不同学科中的MMLU表现差异。

Mathstral 7B的学科细分表现

Mathstral是为特定用途构建模型时实现的卓越性能/速度平衡的又一个例子——这种开发理念在la Plateforme中积极推广,特别是在其新的微调功能中。

Mathstral 7B详细基准测试

Mathstral在推理时间计算增加的情况下能够显著提高结果:使用多数投票法时,Mathstral 7B在MATH测试中得分为68.37%,在64个候选者中使用强奖励模型时得分为74.59%。

Mathstral是一个指令模型——可以按其文档使用或微调。其权重托管在HuggingFace上。现在可以使用mistral-inference试用Mathstral,并使用mistral-finetune进行调整。

Codestral Mamba:革新AI架构的下一步

在发布Mixtral系列之后,Codestral Mamba是Mistral研究和提供新架构的又一努力成果。它可供免费使用、修改和分发,希望为架构研究开辟新的视角。Codestral Mamba的设计得到了Albert Gu和Tri Dao的帮助。

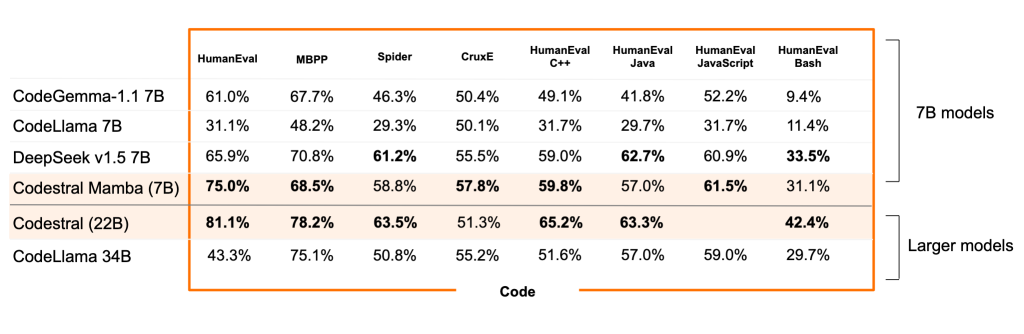

与Transformer模型不同,Mamba模型具有线性时间推理的优势,并且理论上能够建模无限长度的序列。它允许用户与模型进行广泛互动,并能快速响应,无论输入长度如何。这种效率对于代码生产力用例尤为重要——因此,Mistral训练了具有高级代码和推理能力的模型,使其能够与SOTA基于Transformer的模型表现相当。

详细的Codestral Mamba基准测试

Codestral Mamba (https://console.mistral.ai/)在上下文检索能力上的表现已经过测试,最高支持到256k个token。预计它将成为一个出色的本地代码助手!

可以使用mistral-inference SDK部署Codestral Mamba,该SDK依赖于Mamba的GitHub存储库中的参考实现。该模型还可以通过TensorRT-LLM部署。对于本地推理,请关注llama.cpp的支持。原始权重可从HuggingFace下载。这是一个指令模型,具有7,285,403,648个参数。

为了方便测试,Codestral Mamba已在la Plateforme上提供(codestral-mamba-2407),以及其“大姐”Codestral 22B。虽然Codestral Mamba是根据Apache 2.0许可提供的,Codestral 22B则根据商业许可提供自我部署或社区许可供测试使用。

629

629

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?