目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于卷积神经网络的校园垃圾分类自动识别

设计思路

一、课题背景与意义

随着城市化进程的加快和环保意识的提高,垃圾分类已成为现代社会的重要课题。有效的垃圾分类不仅能减少环境污染,还能提高资源的再利用率。手动垃圾分类效率低且容易出现误分。利用深度学习和计算机视觉技术,可以实现对垃圾图像的自动识别和分类,从而提高垃圾处理效率,推动可持续发展。

二、算法理论原理

2.1 卷积神经网络

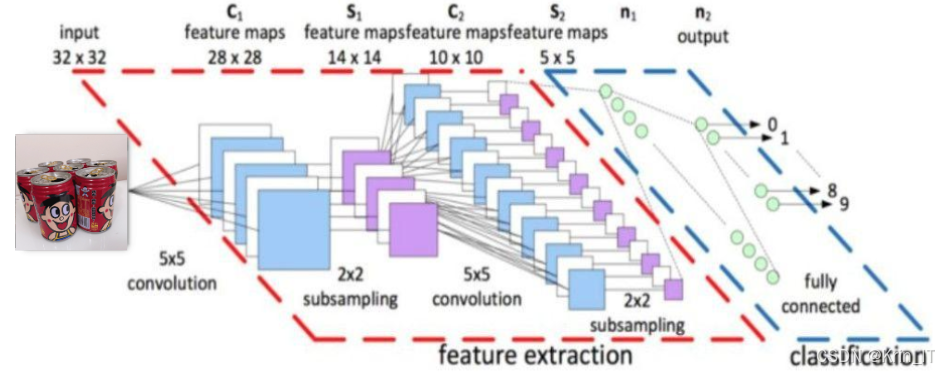

卷积神经网络由多层结构组成,主要包括卷积层、池化层和全连接层。卷积层通过卷积操作提取输入图像中的局部特征,并生成特征图。每个卷积核在图像上滑动,计算加权和,从而捕捉到图像的边缘、纹理和形状等信息。池化层则用于对特征图进行降采样,减少特征图的维度,降低计算复杂性,同时增强模型的鲁棒性。常见的池化操作包括最大池化和平均池化。最后,全连接层将提取到的特征映射到特定的类别进行分类,输出垃圾的种类信息。

在垃圾分类任务中,CNN通过层层堆叠的卷积层和池化层进行特征提取。每一层的卷积操作都能够学习到更为复杂和抽象的特征。例如,低层卷积层可能识别出基本的边缘特征,而高层卷积层则可能识别出更复杂的形状和模式,从而形成对垃圾类别的深层理解。通过训练,CNN能够自动调整卷积核的权重,使得特征提取过程更加高效。

2.2 YOLOv5算法

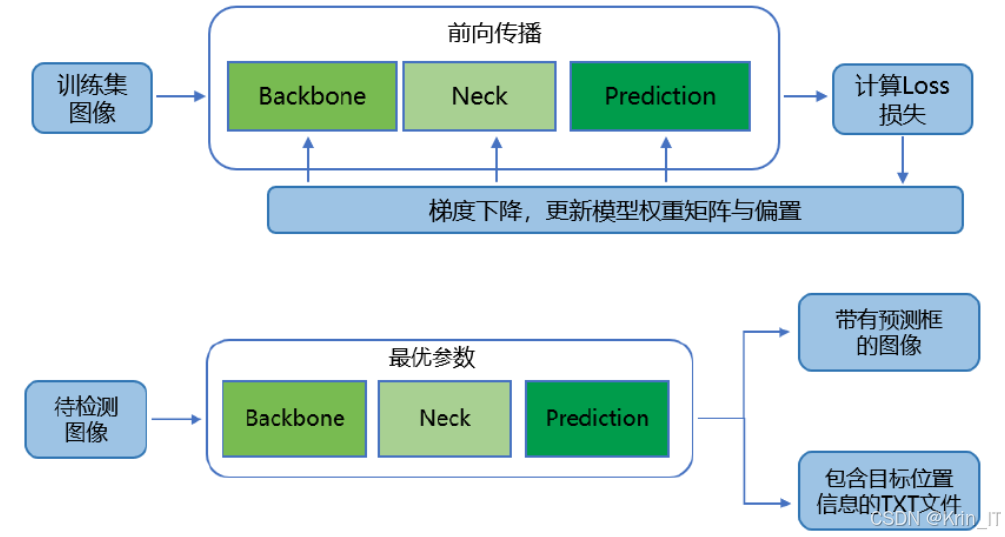

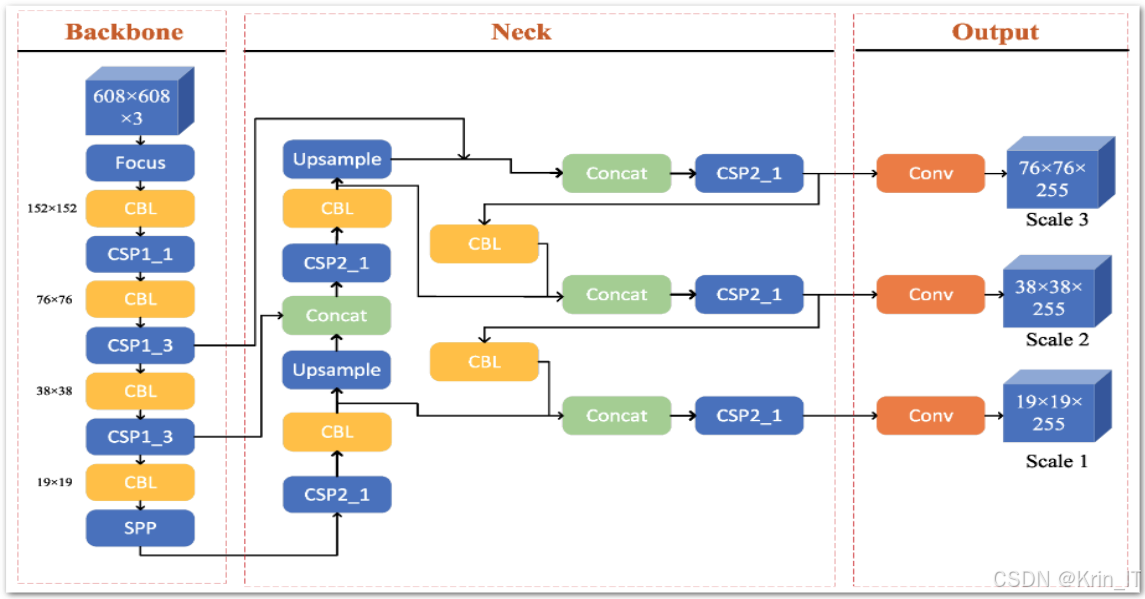

YOLOv5是一种基于卷积神经网络(CNN)的实时目标检测算法,其核心思想是将目标检测任务视为回归问题,通过单一的神经网络同时进行边界框回归和类别预测。YOLOv5的网络结构主要包括主干网络、特征提取网络和头部网络。主干网络负责从输入图像中提取特征,通常采用CSPNet等高效的卷积结构,以提高特征提取的速度和准确性。特征提取网络用于融合不同尺度的特征信息,使得模型能够更好地检测不同大小的垃圾目标。最后,头部网络则负责生成最终的边界框和类别概率,通过对特征图的处理,输出检测结果。

YOLOv5在特征融合方面采用了特征金字塔结构,使得模型能够有效地处理多尺度的目标。在垃圾分类任务中,垃圾的大小和形状各异,特征金字塔通过结合来自不同层次的特征图,能够增强模型对小目标的检测能力。YOLOv5还通过引入自适应的锚框机制,自动为不同类别的垃圾生成合适的锚框,提高了检测精度。YOLOv5的多尺度检测策略使得网络在不同尺度下都能够检测到目标,进一步提升了模型的整体性能。这种特征融合和多尺度检测的机制,使得YOLOv5能够在复杂的垃圾场景中提供准确的识别结果。

在垃圾分类任务中,YOLOv5的训练过程通常包括数据准备、模型配置和超参数调整。首先,需准备一个高质量的垃圾分类数据集,并进行标注。使用YOLOv5自带的训练脚本,可以快速开始训练,并根据训练结果调整超参数。YOLOv5还支持数据增强技术,进一步提升模型的泛化能力。训练完成后,通过评估指标对模型性能进行评估,以确保模型的准确性和鲁棒性。根据评估结果,可能需要进行模型的微调或重训练,以优化检测效果。

三、检测的实现

3.1 数据集

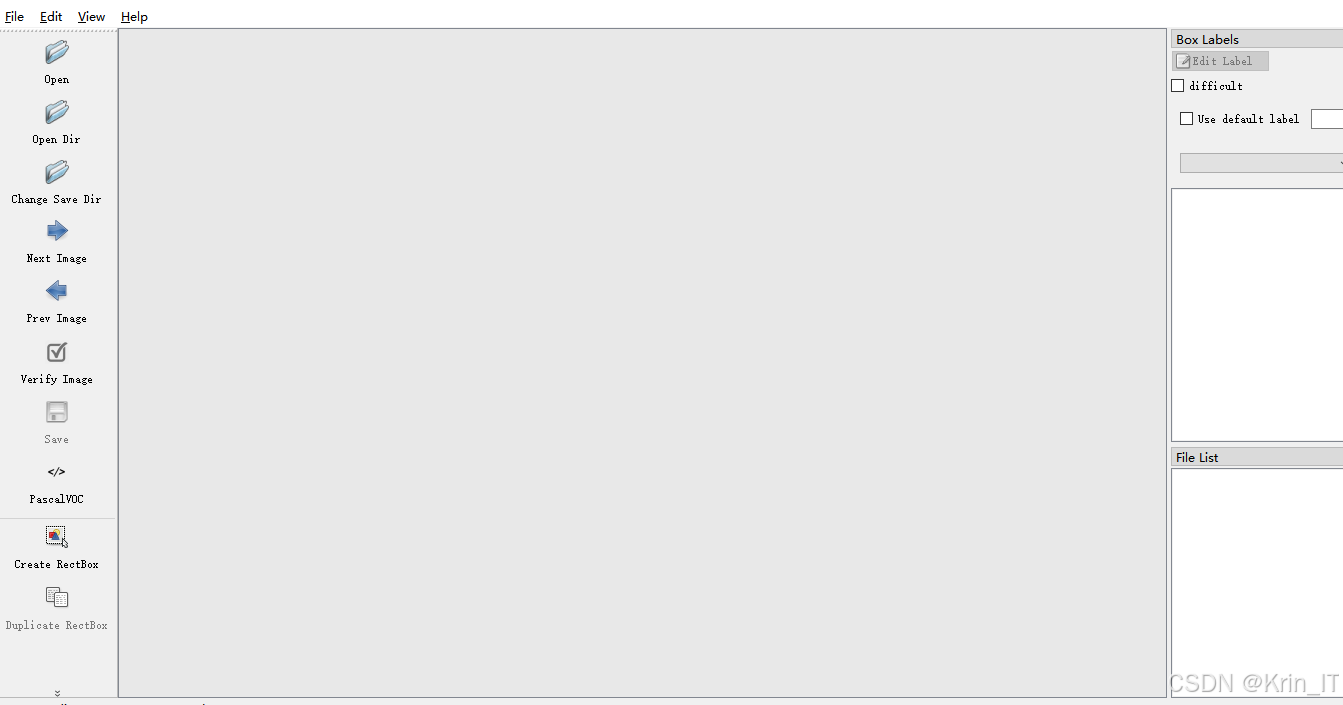

为了确保数据的多样性与代表性,采用自主拍摄和互联网采集相结合的方式。在自主拍摄时,选择不同的场景和光照条件,拍摄各种类型的垃圾样本,如塑料瓶、纸张、食品包装等。这样可以捕捉到垃圾的不同状态和形态。同时,通过互联网收集公开的垃圾图像,进一步扩展数据集的规模,确保涵盖各种垃圾类型,适应不同的分类需求。使用LabelImg等专业标注工具,对收集到的垃圾图像进行准确标注。标注过程包括框选每个垃圾对象,并为其分配相应的类别标签。标注完成后,生成相应的标注文件,这些文件将用于后续的模型训练。

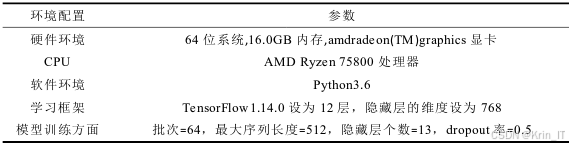

3.2 实验环境搭建

深度学习框架为构建、训练、优化和推理深度神经网络提供了必要的基础工具,使开发者能够更高效地进行相关工作。这些框架不仅简化了复杂的计算过程,还提供了丰富的功能和灵活的接口,帮助开发者快速实现各种深度学习算法。在众多深度学习框架中,PyTorch因其高度的扩展性和可移植性而受到广泛欢迎,尤其在学术研究和工业应用中表现出色。它的动态计算图特性使得模型的调试和修改变得更加直观和方便,同时,PyTorch拥有一个活跃的开发者社区,提供了大量的资源和支持,极大地推动了深度学习的研究和应用。

3.3 实验及结果分析

对校园垃圾图像进行准备和预处理。这包括数据集的收集、标注和划分。首先,进行图像采集,既可以通过实地拍摄校园内的垃圾,还可以从互联网获取公开的垃圾图像。在数据标注过程中,使用LabelImg等工具为每张图像标注垃圾类别(如可回收物、有害垃圾、湿垃圾、干垃圾等),并生成相应的标注文件。接着,将标注完成的数据集分为训练集、验证集和测试集,通常采用70%-20%-10%的比例,以确保模型评估的准确性和代表性。

# 示例代码:数据集划分

import os

import shutil

import random

def split_dataset(source_dir, train_dir, val_dir, test_dir, split_ratio=(0.7, 0.2, 0.1)):

all_images = os.listdir(source_dir)

random.shuffle(all_images)

train_count = int(len(all_images) * split_ratio[0])

val_count = int(len(all_images) * split_ratio[1])

train_images = all_images[:train_count]

val_images = all_images[train_count:train_count + val_count]

test_images = all_images[train_count + val_count:]

for img in train_images:

shutil.copy(os.path.join(source_dir, img), os.path.join(train_dir, img))

for img in val_images:

shutil.copy(os.path.join(source_dir, img), os.path.join(val_dir, img))

for img in test_images:

shutil.copy(os.path.join(source_dir, img), os.path.join(test_dir, img))

split_dataset('/path/to/images', '/path/to/train', '/path/to/val', '/path/to/test')在校园垃圾分类任务中,卷积神经网络(CNN)可以用于图像分类,而YOLOv5则适合进行目标检测。配置模型时,需要设置超参数,如学习率、批量大小、训练轮数等。对于YOLOv5,需准备相关的配置文件,指定数据集路径和模型架构,并选择相应的预训练权重进行微调。通过适当的配置,可以提高模型在垃圾分类任务中的表现。在训练过程中,利用反向传播算法调整模型权重。对于CNN,输入预处理后的图像,计算损失函数,并通过优化算法(如Adam或SGD)更新模型参数。YOLOv5则通过特征提取和目标检测的方式,优化边界框回归和分类损失。在训练过程中,监控损失值和准确率,以评估模型的表现,并根据训练结果进行必要的调节,确保模型逐步收敛。

# 示例代码:CNN的训练示例

import torch

import torch.nn as nn

import torch.optim as optim

model = CNNModel() # 假设已定义CNNModel

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

for epoch in range(num_epochs):

for images, labels in train_loader: # 假设已定义train_loader

optimizer.zero_grad()

outputs = model(images)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()训练完成后,使用评估指标对模型进行效果评估。对于分类模型,可以计算准确率、精确率和召回率。对于YOLOv5,可以使用mAP(平均精度均值)来评估目标检测性能。通过混淆矩阵可视化分类结果,帮助识别模型在不同类别上的表现。根据评估结果,可能需要对模型进行进一步的优化,如调整超参数、增加数据增强或采用更复杂的网络结构,以提升模型的性能。

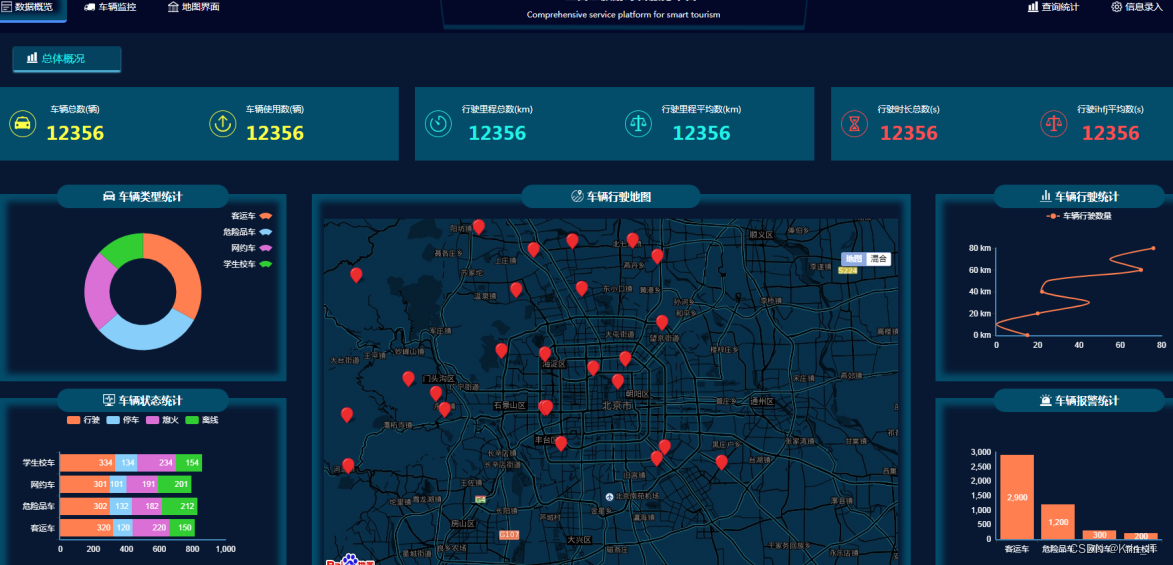

实现效果图样例:

创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

275

275

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?