深层神经网络

前面几周学习了一层隐藏层和没有隐藏层的神经网络,这一周针对于深层神经网络学习。

对于一个神经网络,最主要的就是前向传播和反向传播还有梯度下降

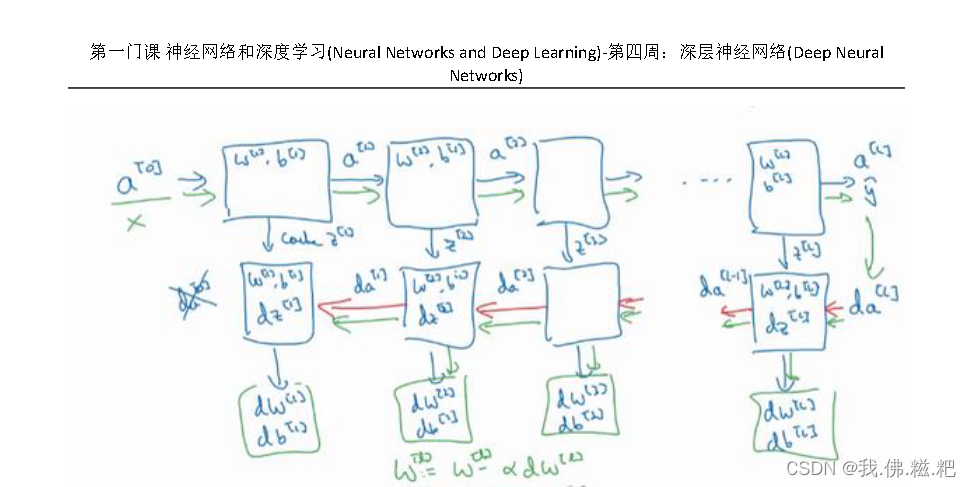

这是整个神经网络的计算图,我将逐步做笔记

前向传播

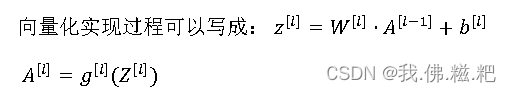

公式如图,每一层的计算都需要上一层的输出作为输入,因此这里只能用一个for循环来一层一层计算

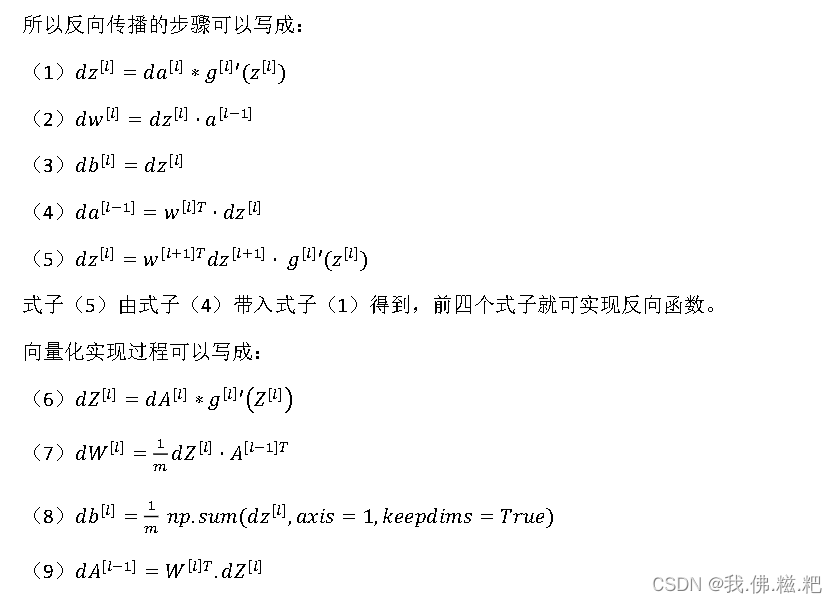

反向传播

矩阵维数

矩阵维数主要是看你这一层的节点有多少,回忆矩阵乘法,结果的高度即节点数,是由w的高度决定的,也就是说,有几个节点w的高度就是几

参数和超参数

参数就是w和b,超参数是指这个参数能影响最终参数的参数,比如学习率a。

多尝试几个超参数,能找到一个很合适的超参数使得神经网络的效率和准确性变高

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?