strings:

html页面所有呈现在web上的字符串,即标签的内容

stripped_string:

html页面所有呈现在web上的非空字符串

接下来尝试爬取百度的标语“百度一下,你就知道”

首先我们通过requests来建立请求,可以通过查看源代码找到对应部分

如下所示:

所以直接通过调用

代码如下:

import requests

from bs4 import BeautifulSoup

r=requests.get(“https://www.baidu.com/”)

r.encoding=“utf-8”

soup=BeautifulSoup(r.text)

title=soup.title

print(title)

结果如图所示:

3.标签常用属性

每一个标签在bs4中也是一个对象,被称为tag对象,以糯米为例,常见结构如下:

其中尖括号(<>)中标签的名字为 name,其他项为attrs,尖括号之间的内容为string

所以常见的标签属性分为4种

name:

字符串、标签的名字

attrs:

字典、包含了原来页面tag的所有属性,比如href

contrnts:

列表、tag下所有子tag的内容

string:

字符串、tag所包含的文本,网页中的真实文字

由于html可以在标签中嵌套其他的标签,所以string返回遵循以下原则

①如果标签内没有其他标签,string属性返回其中的内容

②如果标签内部还有标签,但只有一个标签,string返回最里面的标签内容

③如果内部超过1层嵌套标签,则返回为none

依然以百度为例,我们需要找到第一个标签的string代码应当如下:

import requests

from bs4 import BeautifulSoup

r=requests.get(“https://www.baidu.com/”)

r.encoding=“utf-8”

soup=BeautifulSoup(r.text)

print(soup.a.string)

结果如图所示:

4.调用find()与find_all()

html中,同一个特标签会有很多内容,比如百度首页一共有13处,但值返回第一处

所以这时候需要通过find与find_all来寻找,这两个方法都会遍历html文档按照条件返回内容

使用方法如下:

BeautifulSoup.find_all(name,attrs,recursive,string,limit)

name:以标签名字进行搜索,名字用字符串类型表示

attrs:按照标签的属性来搜索,需要列出属性的名字和值,用json方法表示

recursive:设置查找层次,只查找当前标签的西一层时使用recursiv=false

string:按照关键字查找string属性内容,采用string=开始

limit:返回结果个数,默认全部

至于find()使用方法如find_all()相同,

BeautifulSoup.find_all(name,attrs,recursive,string)

区别在于find()只搜索第一个结果,find_all()返回所有结果。

我们尝试来通过find_all()来获取所有含有“百度”这一关键词的标签

首先需要调用re库,re是python的标准库可以采用compile()对字符串的检索

所以代码如下:

import requests

import re

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上前端开发知识点,真正体系化!

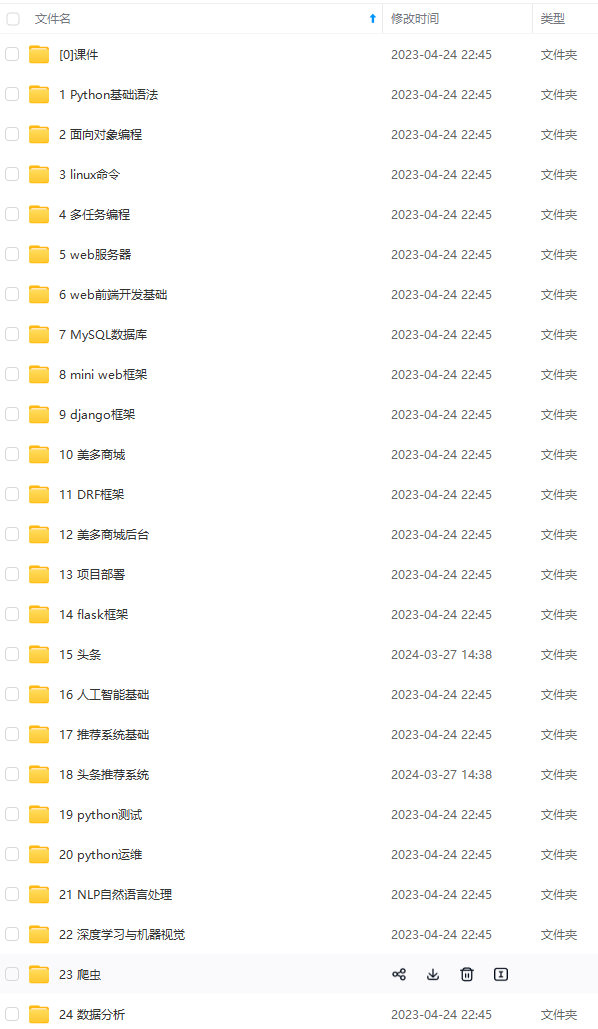

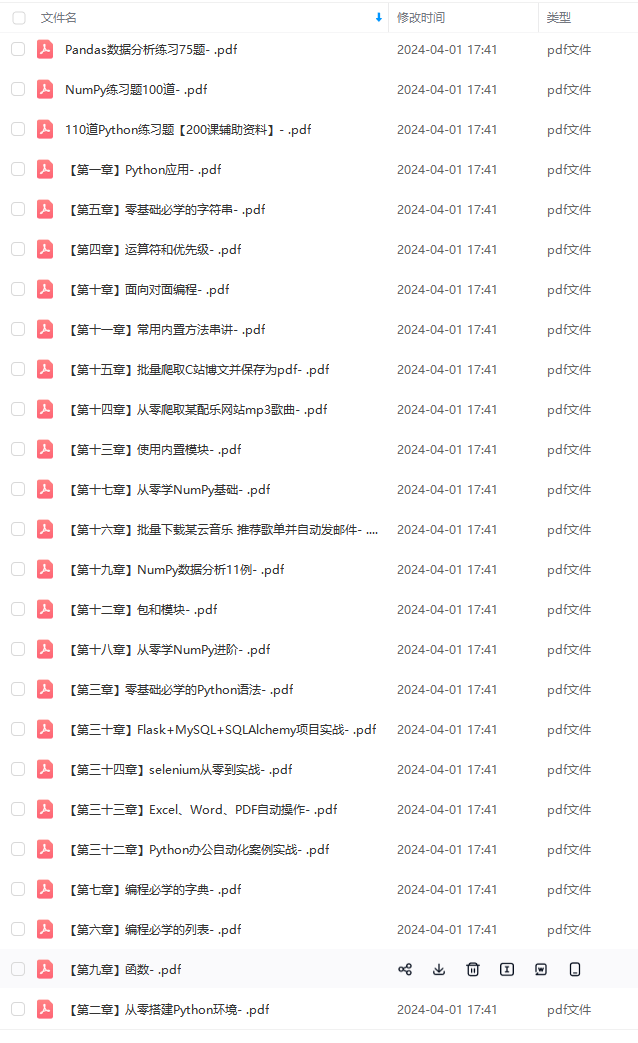

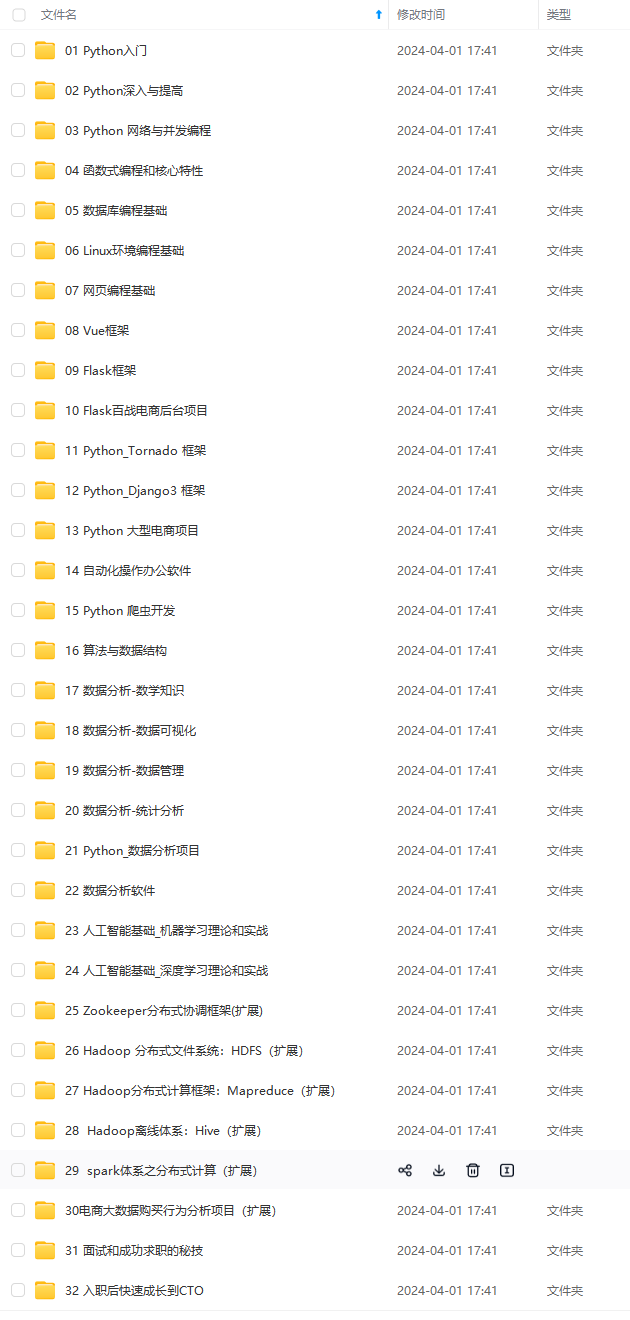

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以扫码获取!!!(备注Python)

//img-blog.csdnimg.cn/img_convert/9f49b566129f47b8a67243c1008edf79.png)

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上前端开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以扫码获取!!!(备注Python)

本文介绍了如何使用Python的requests和BeautifulSoup库抓取HTML页面内容,以百度标语为例,展示了如何通过find和find_all方法定位并提取特定标签的字符串。同时提到了HTML标签的常见属性和搜索策略。

本文介绍了如何使用Python的requests和BeautifulSoup库抓取HTML页面内容,以百度标语为例,展示了如何通过find和find_all方法定位并提取特定标签的字符串。同时提到了HTML标签的常见属性和搜索策略。

1985

1985

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?