引言

近邻算法是一种常用的监督学习算法,主要用于分类和回归问题。它通过测量不同数据点之间的距离来找出与给定数据点最相似的数据点,并根据这些相似数据点的类别或数值来预测给定数据点的类别或数值。

一、近邻算法的基本原理

近邻算法的基本原理是“物以类聚,人以群分”。它认为在特征空间中,相似的数据点更可能属于同一类别或具有相似的数值。

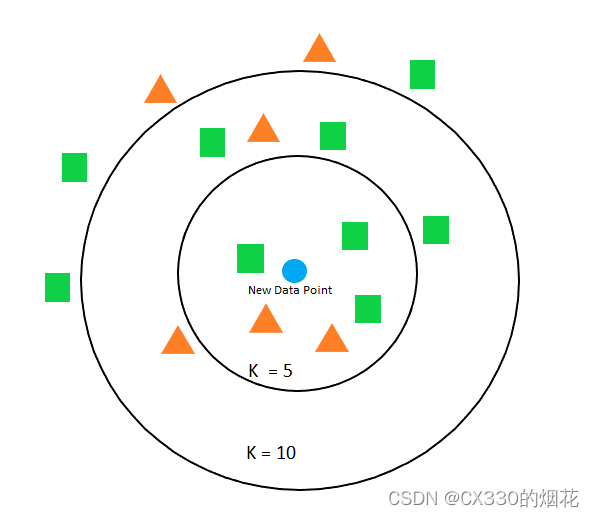

因此,对于给定的数据点,可以通过计算它与训练集中其他数据点之间的距离,找到距离最近的k个数据点(k值通常根据具体任务来设定),然后根据这k个数据点的类别或数值来预测给定数据点的类别或数值。

二、近邻算法的实现步骤

近邻算法的实现步骤相对简单,主要包括以下几步:

1 计算距离

对于给定的数据点,计算它与训练集中每个数据点之间的距离。常用的距离度量方法包括欧氏距离、曼哈顿距离等。

2 找到k个近邻

根据计算出的距离,找出距离给定数据点最近的k个数据点。

3 做出预测

根据这k个近邻的类别或数值,通过多数投票或平均值等方法,预测给定数据点的类别或数值。

4 实践

在这个示例中,我将使用Python的scikit-learn库来展示如何使用KNN算法进行简单的分类任务。我们将使用著名的鸢尾花(Iris)数据集,它是一个多类别分类问题的标准数据集。

首先,确保你已经安装了scikit-learn库。

import numpy as np

from sklearn import datasets

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.neighbors import KNeighborsClassifier

from sklearn.metrics import classification_report, confusion_matrix

# 加载鸢尾花数据集

iris = datasets.load_iris()

X = iris.data

y = iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 数据标准化

scaler = StandardScaler()

X_train = scaler.fit_transform(X_train)

X_test = scaler.transform(X_test)

# 创建KNN分类器实例

knn = KNeighborsClassifier(n_neighbors=3)

# 训练模型

knn.fit(X_train, y_train)

# 预测测试集结果

y_pred = knn.predict(X_test)

# 评估模型

print("Confusion Matrix:")

print(confusion_matrix(y_test, y_pred))

print("\nClassification Report:")

print(classification_report(y_test, y_pred))

在这个例子中,我首先加载了鸢尾花数据集,并将其分为特征(X)和目标变量(y)。然后,我将数据集划分为训练集和测试集。由于KNN对特征的尺度很敏感,我使用StandardScaler对特征进行了标准化处理。

接下来,我创建了一个KNeighborsClassifier的实例,并指定了n_neighbors参数为3,意味着我将使用3个最近的邻居来进行预测。然后,我使用训练数据拟合模型,并对测试集进行预测。

最后,我打印出了混淆矩阵和分类报告来评估模型的性能。这些指标可以帮助我们了解模型在各类别上的表现,以及整体的分类精度。

三、近邻算法的应用场景

近邻算法在许多领域都有广泛的应用,例如:

1 图像识别

可以通过提取图像的特征,利用近邻算法对图像进行分类或识别。

2 文本分类

可以将文本转化为特征向量,然后利用近邻算法对文本进行分类。

3 推荐系统

可以根据用户的历史行为和其他用户的相似行为,利用近邻算法为用户推荐相似的物品或服务。

四、近邻算法的优缺点

优点:

1 简单易懂

近邻算法的原理和实现步骤相对简单,容易理解和实现。

2 无需参数估计

近邻算法不需要对参数进行估计,避免了过拟合和欠拟合的问题。

3 对异常值敏感

近邻算法对异常值比较敏感,可以有效地处理一些噪声数据。

缺点:

1 计算量大

对于大规模数据集,计算每个数据点与其他数据点之间的距离可能会非常耗时。

2 维数灾难

当特征维度很高时,距离计算的复杂性会增加,导致算法性能下降。

3 对数据分布敏感

近邻算法的效果受数据分布的影响较大,如果数据分布不均匀,可能会导致预测结果不准确。

五、总结与展望

近邻算法是一种简单而有效的监督学习算法,在许多领域都有广泛的应用。然而,它也存在一些缺点,如计算量大、维数灾难等。

未来可以研究如何优化距离计算、降低算法复杂度、处理高维数据等问题,以提高近邻算法的性能和应用范围。同时,也可以探索将近邻算法与其他机器学习算法相结合的方法,以充分利用各自的优点,提高预测精度和稳定性

KNN算法如何处理缺失值

KNN(k-Nearest Neighbors)算法在处理缺失值时通常有两种主要策略:

1 删除含有缺失值的样本

这是一种直接的处理方式,即简单地移除数据集中包含缺失值的样本。这种方法简单易行,但可能导致数据集的规模减小,尤其是当缺失值较多时,可能会丢失大量有用的信息。

2 填充缺失值:

对于含有缺失值的样本,可以选择一个合适的值来填充这些缺失值。填充的方法有很多,以下是一些常见的填充策略:

1)使用固定值填充:

比如,对于数值型特征,可以使用0、均值、中位数或众数等作为填充值;对于分类特征,可以使用最常见的类别作为填充值。

2)使用其他字段的信息填充:

根据数据集中其他字段的信息来预测或推断缺失值。例如,可以使用回归或分类算法来预测缺失值。

3)使用插值方法填充:

对于时间序列数据,可以使用插值方法(如线性插值、多项式插值等)来估算缺失值。

4)使用KNN算法本身来填充:

使用KNN算法来预测缺失值。具体来说,对于每个含有缺失值的样本,可以基于其最近的k个邻居的平均值或众数来填充缺失值。

5)使用机器学习模型填充:

可以使用其他机器学习模型(如决策树、随机森林、神经网络等)来预测缺失值。这些模型可以在训练时学习到数据中的模式,并用于预测缺失值。

需要注意的是,填充缺失值可能会引入一定的误差或偏差,因此应该谨慎选择填充策略,并尽量使用可靠的方法来估算缺失值。

在处理完缺失值之后,KNN算法就可以正常地进行距离计算和分类了。

在KNN中,距离计算通常基于特征之间的相似度或距离度量(如欧氏距离、余弦相似度等),而缺失值的处理会影响这些计算的结果。因此,选择合适的缺失值处理策略对于KNN算法的性能至关重要。

437

437

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?