一、引言

反向传播算法(Backpropagation,简称BP算法)是深度学习领域最为核心的算法之一,它为神经网络提供了一种高效计算梯度的方法,使得基于梯度的优化成为可能。自20世纪80年代被重新发现并广泛应用以来,反向传播算法已经成为训练多层神经网络的标准方法,推动了深度学习革命的发展。

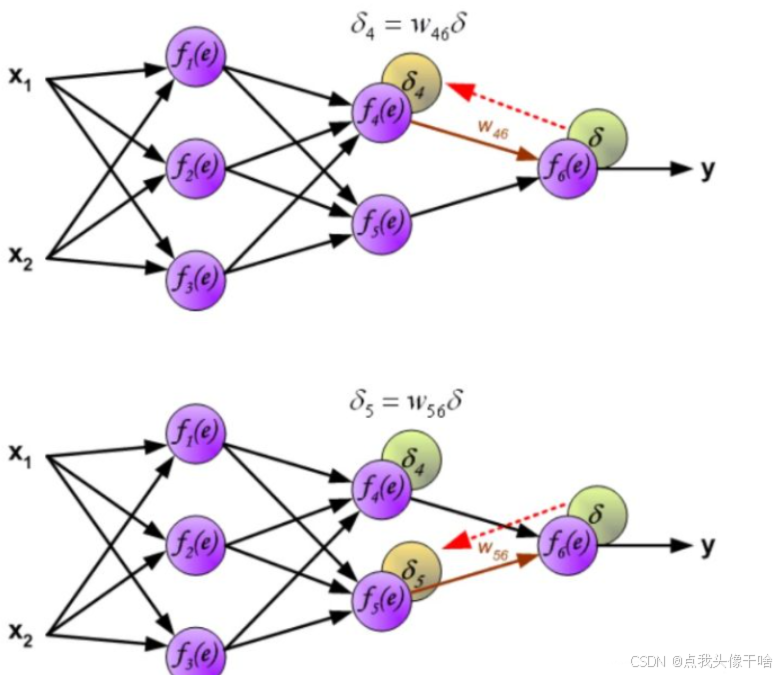

反向传播算法的本质是链式法则(Chain Rule)在神经网络中的巧妙应用,它通过从输出层向输入层反向传播误差信号,计算网络中每个参数相对于损失函数的梯度。这些梯度随后被用于优化算法(如随机梯度下降)来更新网络参数,从而最小化损失函数。

二、前向传播与计算图

2.1 神经网络的前向传播

在理解反向传播之前,首先需要了解前向传播(Forward Propagation)的过程。

前向传播是指输入数据通过神经网络的各层变换,最终得到输出的过程。

订阅专栏 解锁全文

订阅专栏 解锁全文

1384

1384

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?