被秀到了!贝叶斯+深度学习,一跃成为AI顶会新晋“收割机”!光NaurIPS就有多篇,比如在预测任务中,速度狂飙10000倍的LCPFN;参数量狂跌94%的Meat-BO……

主要在于:贝叶斯在处理不确定性和模型选择方面具有显著优势,可以帮助深度学习模型更好地应对不确定性,提高预测性能和过拟合控制力;同时,其通过引入先验知识和不确定性量化,还能增强深度学习模型的可解释性。这便意味着,对这两方面要求高的任务,都能用该方法重做一遍。

更特别的是,贝叶斯网络代码实现非常简单,只要修改模型中的线性层就好。且与Transformer、LSTM等也能很好地融合,可发挥空间很大!

为让大家能抓住这波风口,早点发出自己的文章,我给大家准备了12种创新思路和源码,几乎都来自顶会!

论文原文+开源代码需要的同学看文末

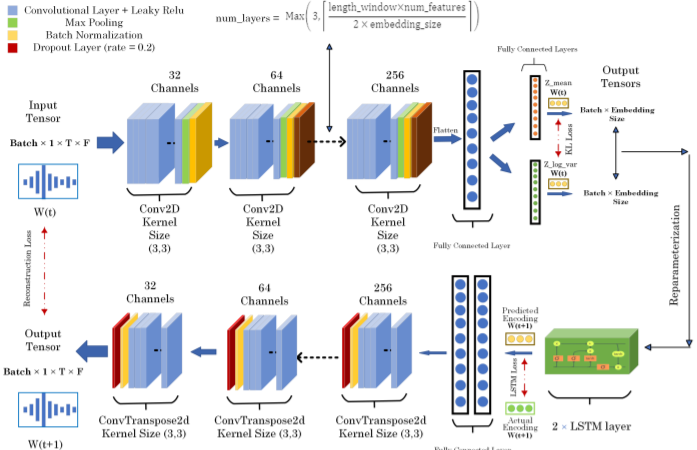

Unsupervised Bayesian Surprise Detection in Spatial Audio with Convolutional Variational Autoencoder and LSTM Model

内容:文章提出了一种无监督的贝叶斯惊喜检测框架,专门用于空间音频数据的分析。该框架利用卷积变分自编码器(CVAE)来提取音频特征,并使用长短期记忆网络(LSTM)来建模音频数据的时间动态。通过这种结合,系统能够在没有标签的情况下自动识别和检测音频流中的异常或惊喜事件,这对于监控、安全和音频分析等领域具有潜在的应用价值。

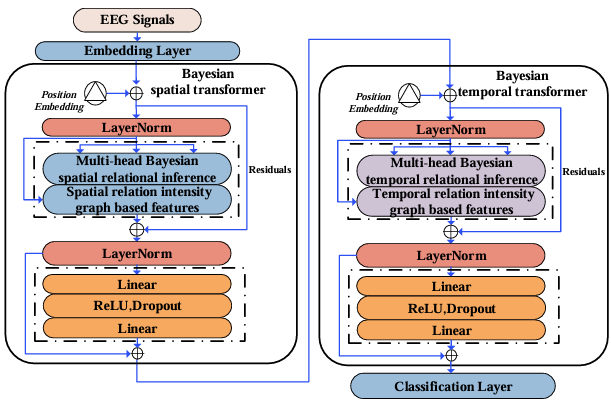

BSTT: A BAYESIAN SPATIAL-TEMPORAL TRANS FORMER FOR SLEEP STAGING

内容:论文介绍了一种名为BSTT的新型神经网络模型,用于睡眠分期。BSTT能够自适应地推断睡眠期间大脑的空间-时间关系,并通过一个精心设计的贝叶斯关系推理组件进行空间-时间特征建模。

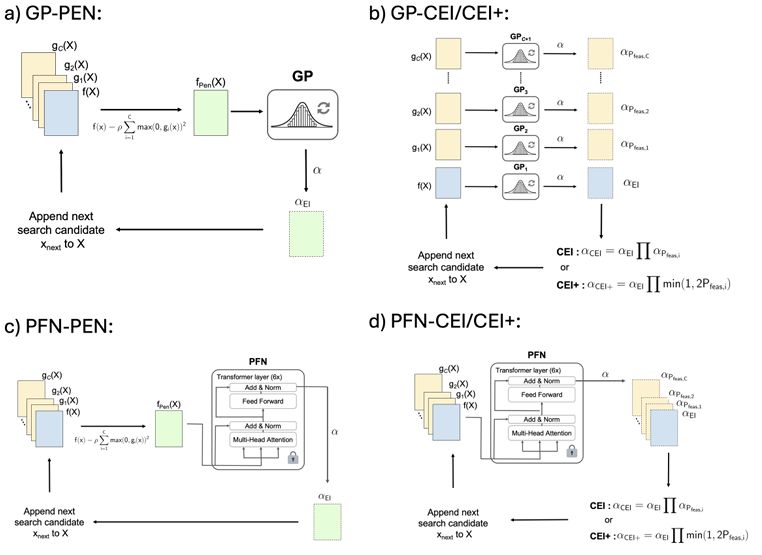

Fast and Accurate Bayesian Optimization with Pre-trained Transformers for Constrained Engineering Problems

内容:论文介绍了一种BO框架,用于解决工程中的约束优化问题。与传统依赖高斯过程(GP)的BO方法不同,该方法使用先验数据拟合网络(PFN)来推断约束和最优解,无需迭代重训练。

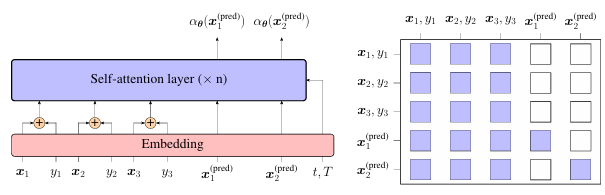

End-to-End Meta-Bayesian Optimisation with Transformer Neural Processes

内容:文章介绍了一种端到端的元贝叶斯优化方法,该方法结合了神经过程。这种方法利用Transformer架构来增强神经过程模型,使其能够更有效地处理高维数据和复杂的函数关系,从而在贝叶斯优化问题中实现更准确的预测和决策。

码字不易,欢迎大家点赞评论收藏!

关注下方《AI科研技术派》

回复【12贝深】获取完整论文

👇

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?