先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

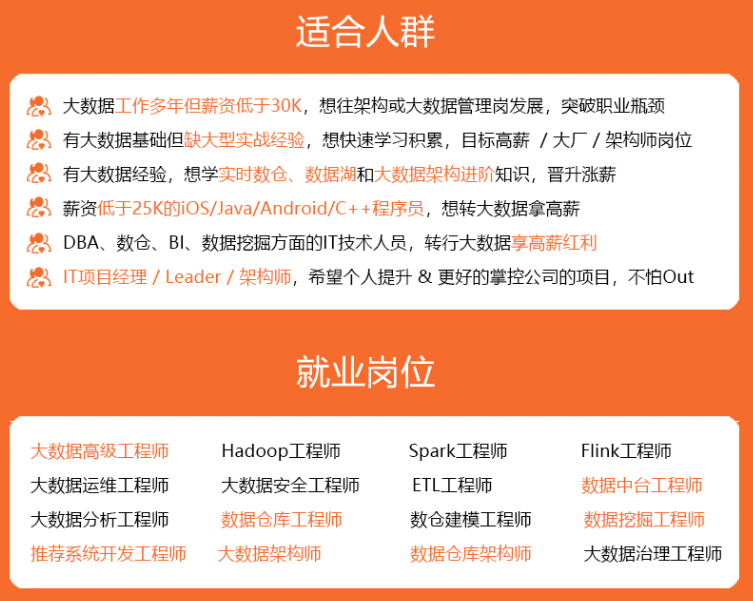

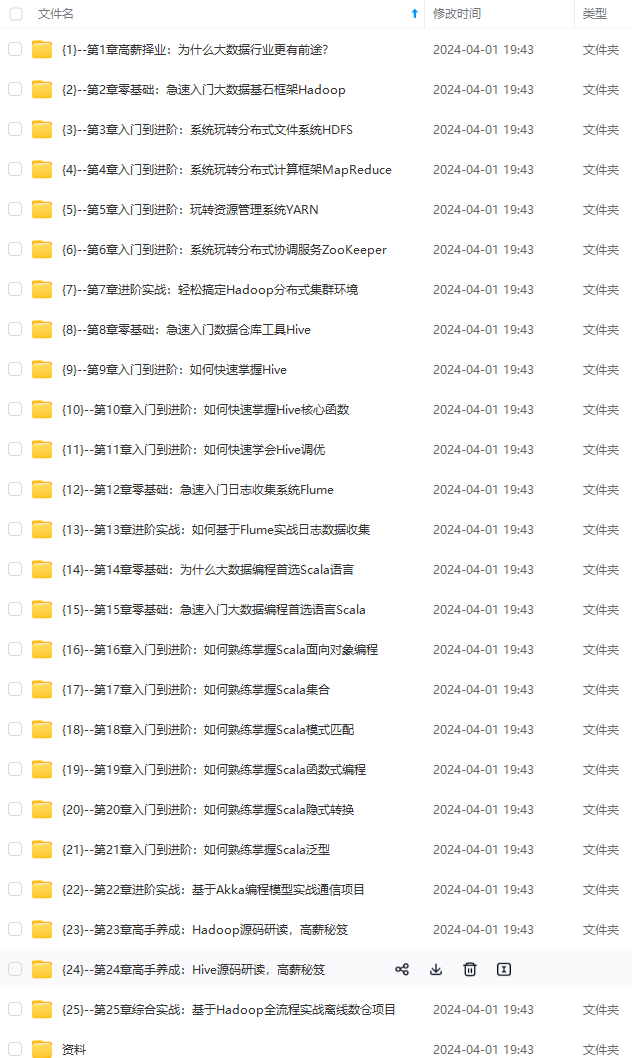

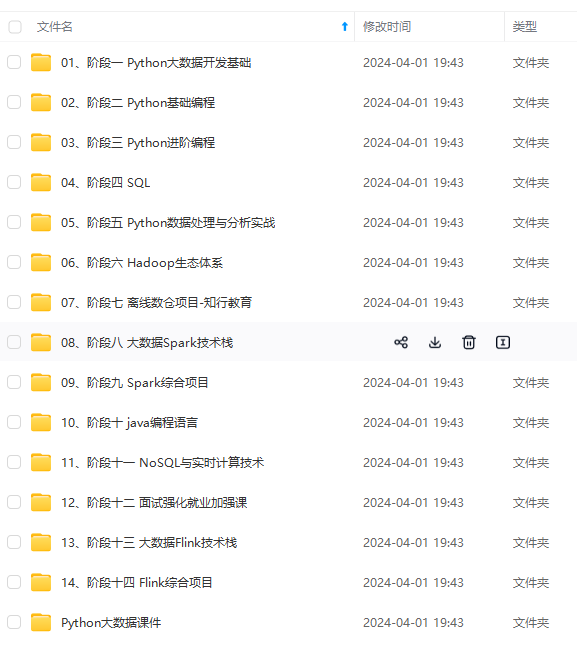

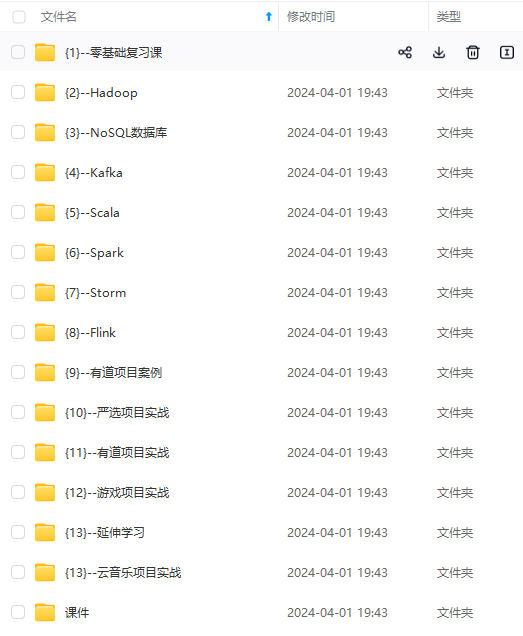

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

👸小媛:bit 哥我来了。

🐶1_bit:昨天不是去教过你来吗?怎么你今天又来了?

👸小媛:是嘛,昨天教的那一点不够打牙祭,希望 bit 哥多教一点。

dog:1_bit:emm,你是不是要缠着我不放来。

👸小媛:bit 哥,年龄是有距离的,所以你别自恋了我不会缠着你的。

dog:1_bit:那你还来?

👸小媛:这是对知识的渴望。

dog:1_bit:emm,行吧。

👸小媛:多谢 bit 哥。

dog:1_bit:那我们先讲一个超链接标签 <a></a> 标签吧。

👸小媛:什么是超链接?

dog:1_bit:emm,就是内容链接,可以跳转到一个资源或者说一个网址,懂了吧?

👸小媛:原来如此。

dog:1_bit:那我们先看看超链接标签<a></a> 吧。.

👸小媛:好的。

dog:1_bit:完成一个超链接的标签编写非常简单,首先我们需要在 <a></a> 之间指定显示的文本:

<a>这里跳转到我的博客</a>

👸小媛:接下来怎么设置跳转的目标呢?

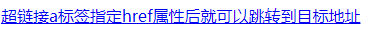

dog:1_bit:我们只需要在这个 <a></a> 标签的起始标签 <a> 中指定一个 href 属性,这个时候就可以跳转到目标地址了。

<a href="https://blog.csdn.net/A757291228">超链接a标签指定href属性后就可以跳转到目标地址</a>

👸小媛:那个 href 后面双引号中就是跳转的地址吗?

dog:1_bit:是的,此时显示的时候将会是以下的呈现形式。

👸小媛:点击后就可以跳转到目标地址呢,明白了。

dog:1_bit:接下来我们再试试 <bdo></bdo> 标签。

👸小媛:这又是什么鬼,感觉英文逐渐变难。

dog:1_bit:哈哈哈,我们只需要记住他们的作用就可以了。

👸小媛:好像说的也是。

dog:1_bit: <bdo></bdo> 标签是反向输出的意思。

👸小媛:哈?自己打自己吗?

dog:1_bit:emm,其实就是一个文本按照你指定的方式去显示。

👸小媛:例如呢?

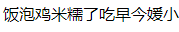

dog:1_bit:例如有一个文本是“小媛今早吃了糯米鸡泡饭”,我们想让这个文本在显示的时候第一个字变成最后一个字,然后反向从后面显示,这个时候就可以用到 <bdo></bdo>了。

👸小媛:唔,明白了。但是我声明一点,我没有吃糯米鸡泡饭,我都不知道这是啥。

dog:1_bit:好了,我们先看看示例吧。

<bdo dir="rtl">小媛今早吃了糯米鸡泡饭</bdo>

👸小媛:然后呢?

dog:1_bit:你运行看一遍。

👸小媛:反向输出了。

dog:1_bit:我们仔细看一下 <bdo></bdo>标签中的 dir 属性。dir 属性为 rtl 时就表示 right to left,意思是从右到左输出显示,如果 dir 属性为 ltr 意思就是 left to right,就是正常的从左到右显示。

👸小媛:明白了。

dog:1_bit:那我们把这个知识点做个笔记记录到那个 html 文件之中吧。

<!DOCTYPE html>

<html lang="zh">

<head>

<meta charset="UTF-8">

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

:vip204888 (备注大数据)**

[外链图片转存中...(img-arjFFSaJ-1713404796058)]

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

2403

2403

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?