先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

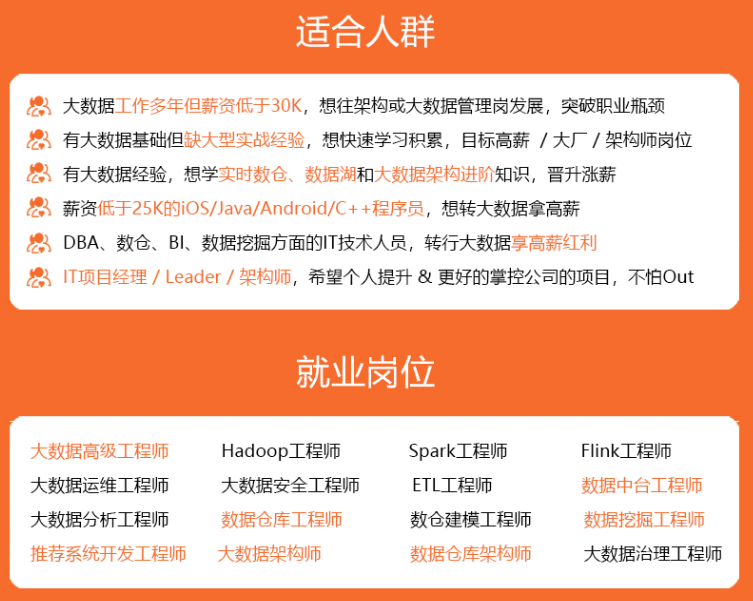

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

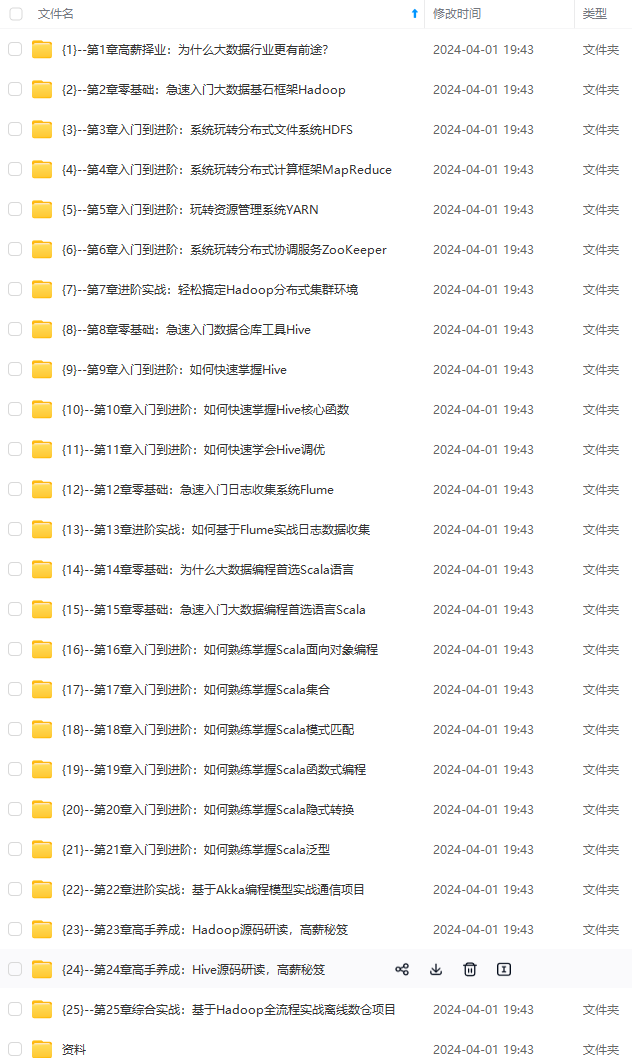

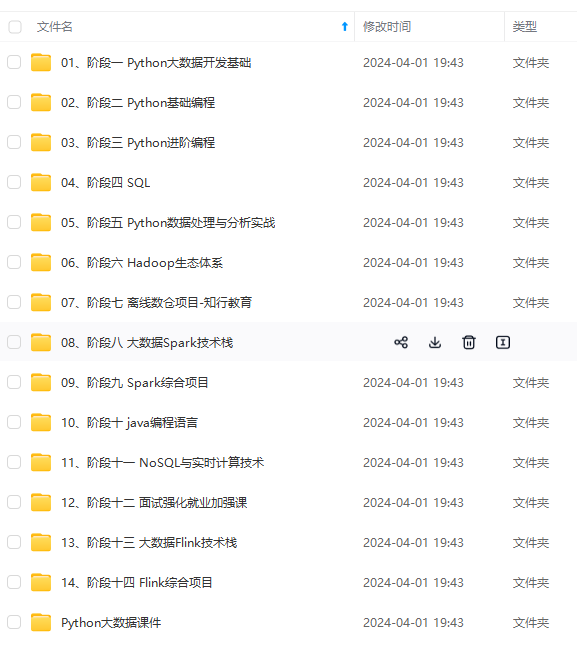

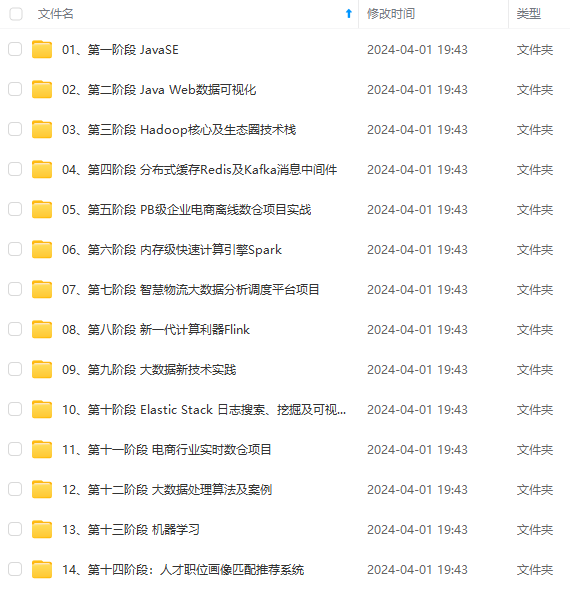

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

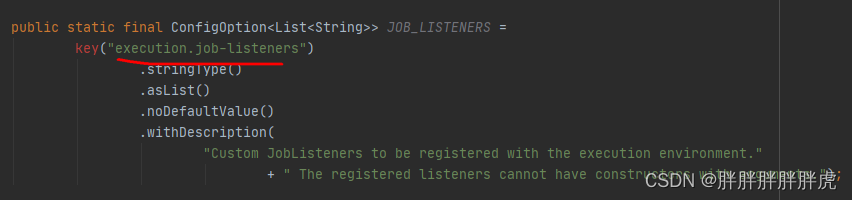

ConfigOptions.key("execution.atlas.job-listeners")

.stringType()

.asList()

.noDefaultValue()

.withDescription("JobListenerFactories to be registered for the execution.");

一点说明:官方Flink1.12.0 版本之后支持配置`execution.job-listeners`,因此自己添加了个配置属性`execution.atlas.job-listeners` 进行区分,

`org.apache.flink.configuration.DeploymentOptions`

###### 任务提交

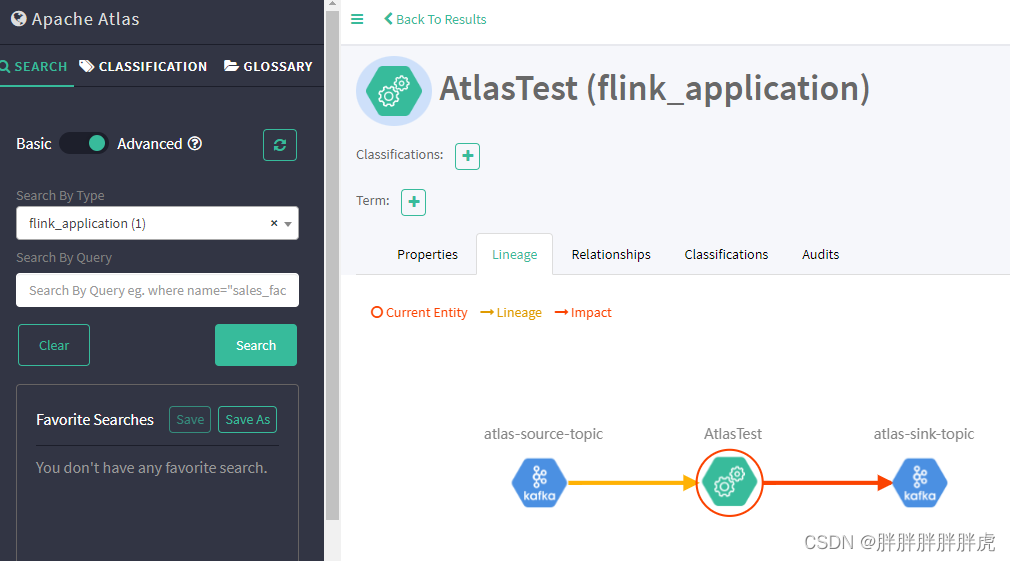

flink run -m yarn-cluster -ys 1 -yjm 1024 -ytm 1024 -c com.nufront.bigdata.v2x.test.AtlasTest /opt/v2x-1.0-SNAPSHOT.jar

###### 测试任务

public class AtlasTest {

public static void main(String[] args) throws Exception {

//TODO 1.获取执行环境

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

env.setParallelism(1);

env.disableOperatorChaining();

// TODO kafka消费

// 配置 kafka 输入流信息

Properties consumerprops = new Properties();

consumerprops.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, "10.0.2.67:9092");

consumerprops.put(ConsumerConfig.GROUP_ID_CONFIG, "group1");

consumerprops.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, "false");

consumerprops.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, "latest");

consumerprops.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

consumerprops.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

// 添加 kafka 数据源

DataStreamSource<String> dataStreamSource = env.addSource(new FlinkKafkaConsumer<>("atlas-source-topic", new SimpleStringSchema(), consumerprops));

// 配置kafka输入流信息

Properties producerprops = new Properties();

producerprops.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "10.0.2.67:9092");

// 配置证书信息

dataStreamSource.addSink(new FlinkKafkaProducer<String>("atlas-sink-topic", new KeyedSerializationSchemaWrapper(new SerializationSchema<String>(){

@Override

public byte[] serialize(String element) {

return element.getBytes();

}

}), producerprops));

env.execute("AtlasTest");

}

}

###### flink on yarn 日志输出

###### 修改 json 解析方式

`org.apache.atlas.utils.AtlasJson#toJson`

public static String toJson(Object obj) {

String ret;

if (obj instanceof JsonNode && ((JsonNode) obj).isTextual()) {

ret = ((JsonNode) obj).textValue();

} else {

// 修改 json 处理方式:fastjson,原来的ObjectMapper.writeValueAsString() 一度卡住不往下执行

// ret = mapper.writeValueAsString(obj);

ret = JSONObject.toJSONString(JSONObject.toJSON(obj));

LOG.info(ret);

}

return ret;

}

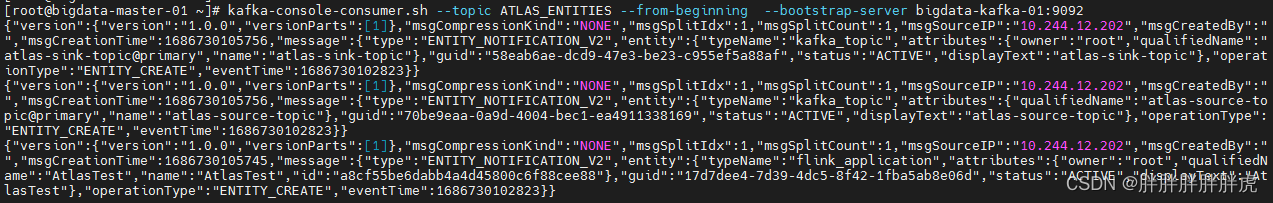

###### 查看目标 kafka 对应topic

###### flinksql

Caused by: java.lang.ClassCastException: org.apache.flink.table.runtime.operators.sink.SinkOperator cannot be cast to org.apache.flink.streaming.api.operators.StreamSink

`org.apache.atlas.flink.hook.FlinkAtlasHook#addSinkEntities`

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

链图片转存中...(img-CacpB0hY-1713283676950)]

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

416

416

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?