先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

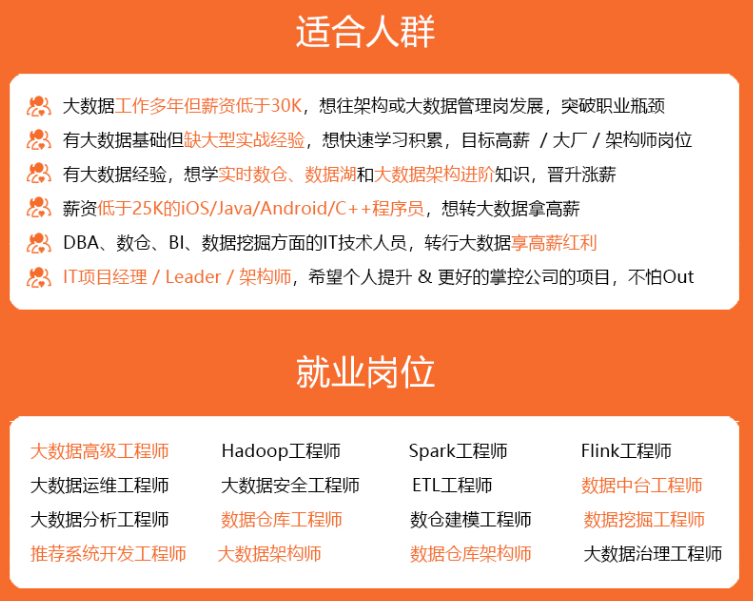

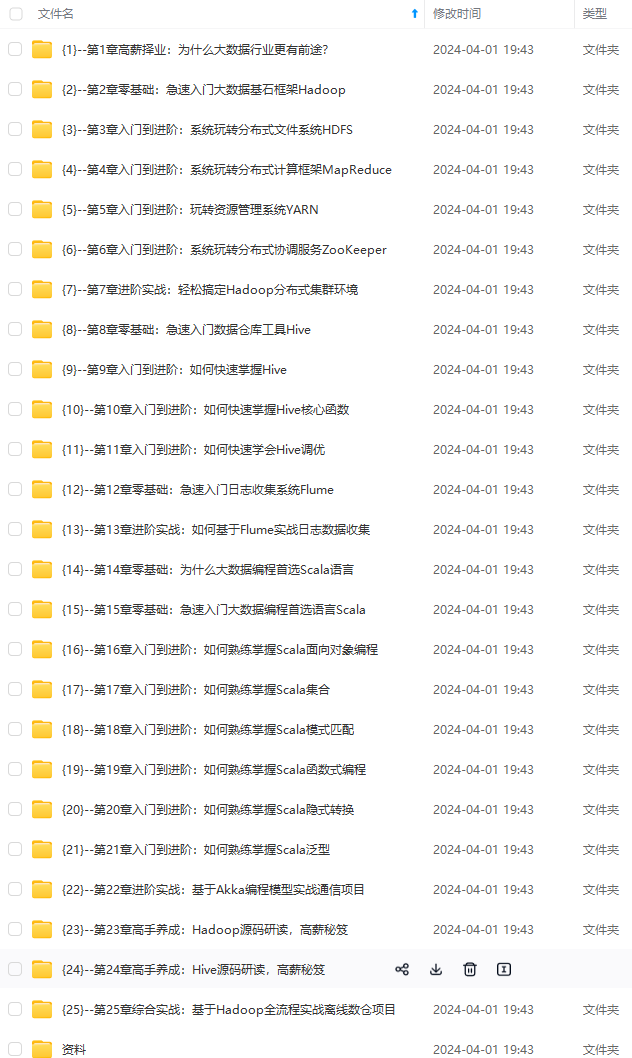

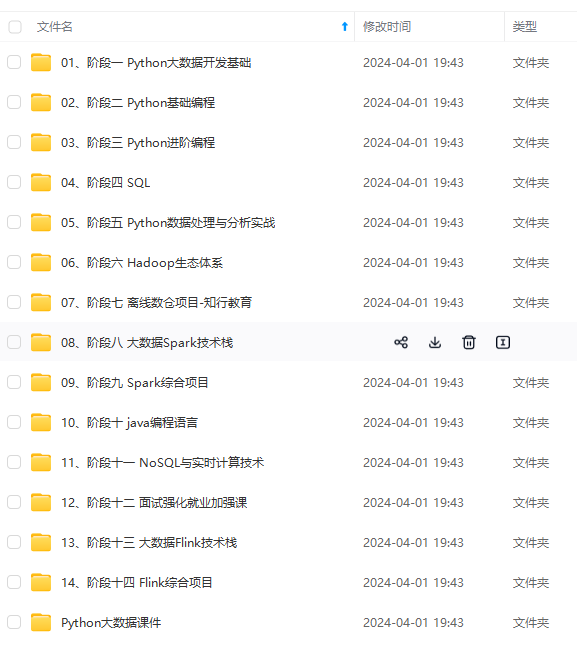

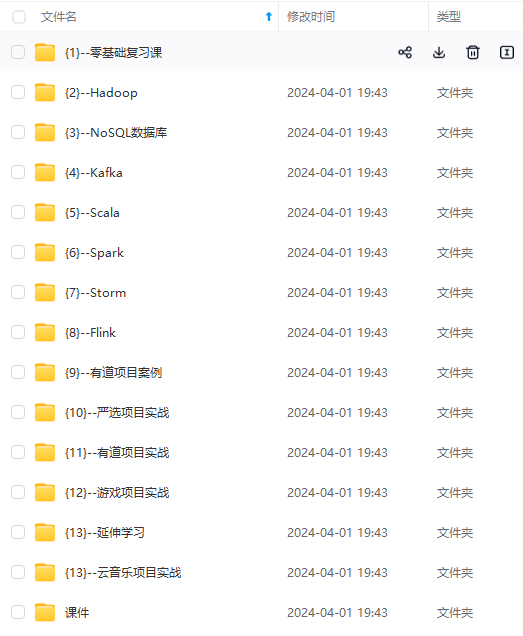

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

driver

executor - 一个JVM进程

1.1.2 调度

master (ResourceManager) - 资源的调度和分配

worker (NodeManager) - 一台服务器上

2 Spark Core

- RDD : 弹性分布式数据集

- 累加器:分布式共享只写变量

- 广播变量:分布式共享只读变量

2.1 RDD

- 弹性

存储的弹性:内存与磁盘的自动切换;

容错的弹性:数据丢失可以自动恢复;

计算的弹性:计算出错重试机制;

分片的弹性:可根据需要重新分片。

- 分布式:数据存储在大数据集群不同节点上

- 数据集:RDD 封装了计算逻辑,并不保存数据

- 数据抽象:RDD 是一个抽象类,需要子类具体实现

- 不可变:RDD 封装了计算逻辑,是不可以改变的,想要改变,只能产生新的RDD,在新的RDD 里面封装计算逻辑

- 可分区、并行计算

// 配置运行对象

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("spark")

val sc = new SparkContext(sparkConf)

// 打印结果并关闭连接

rdd1.collect().foreach(println)

sc.stop()

2.2.1 创建RDD

1. 内部:parallelize 、makeRDD

val rdd1 = sparkContext.parallelize( List(1,2,3,4),5) // 5:并行度-执行任务数量

val rdd2 = sparkContext.makeRDD( List(1,2,3,4))

2. 文件:

val rdd = sc.textFile(path = '') // 绝对or相对路径

val rdd = sc.textFile(path = 'data') // 目录

val rdd = sc.textFile(path = 'data/1*') // 通配符

2.2.2 并行度与分区

1.分区数描述的是数据源,是个相对静态的概念。决定task数

2.并行度描述的是计算引擎一次要同时处理的分区数,是根据资源情况临时决定的

。根据task+executor core数3.并行度小于等于分区数

2.2.3 转换算子

SparkRDD——转换算子_sparkrdd转换算子有-CSDN博客

1. 单value(只使用1个RDD)

1. map

将数据进行转换,数据量不会增加和减少。int input,一对一

val mapRDD = rdd.map(num => num*2)

val mapRDD = rdd.map(_ => num*2)

val mapRDD = rdd.map(num => ""+num)

2. mapPartitions

以分区为单位将一个分区内的数据进行批处理操作,且可以执行过滤操作

以分区为单位,传入迭代器(iter =>),输出迭代器(list(().iterator)

map类似串行,mapPartitions类似批处理,因此后者性能较高。但mapPartitions算子计算时将分区数据全部加载进内存,等处理完整个分区后才释放内存,因此在内存不足时建议使用map。

3. mapPartitionsWithIndex

功能类似mapPartiutions算子,只是加入了每个分区的索引,可以选择性的对某些分区进行操作

4. flatMap

扁平化操作,即将集合嵌套类型的数据或者可转换为嵌套集合的类型的数据转换为非嵌套集合. 每个元素生成多个输出元素,eg字符串分词

5. glom

将元素合并为分区数量的数组,不需要传参数

6. groupBy

通过给定函数计算所得key进行分组,返回一个键值对,键为key的类型,值为Iterable,有shuffer

7. filter

将数据根据相应规则进行过滤,符合的保留,不符合的丢弃,过滤后分区不变。

8. sample

抽样算子

9. distinct

去重算子,将传入的数据集中相同的数据去除多余的保留一个

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-bIe5fevE-1713324677831)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

本文介绍了一位技术专家分享的大数据学习资料,包括从零基础到进阶的全面内容,覆盖95%以上知识点,强调了系统学习和实践的重要性。作者提供了一份包含大厂面经、学习笔记等在内的全套资料,以及如何获取的联系方式。

本文介绍了一位技术专家分享的大数据学习资料,包括从零基础到进阶的全面内容,覆盖95%以上知识点,强调了系统学习和实践的重要性。作者提供了一份包含大厂面经、学习笔记等在内的全套资料,以及如何获取的联系方式。

8258

8258

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?