先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

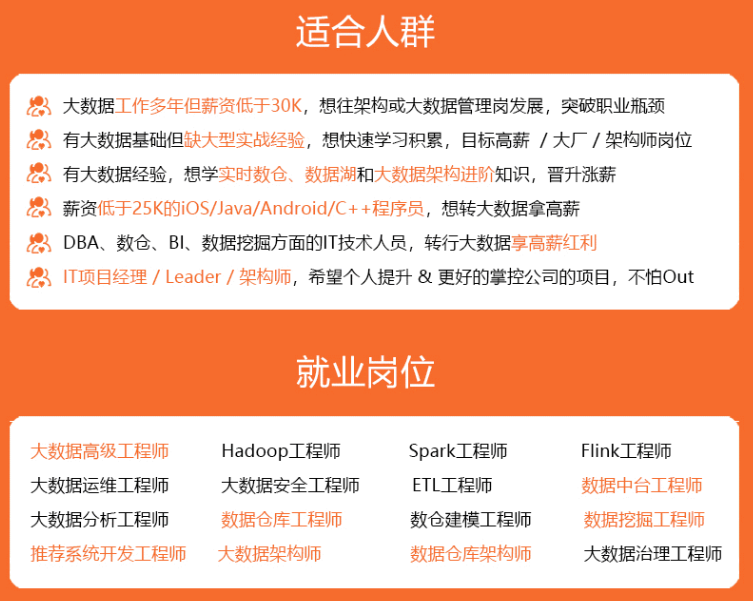

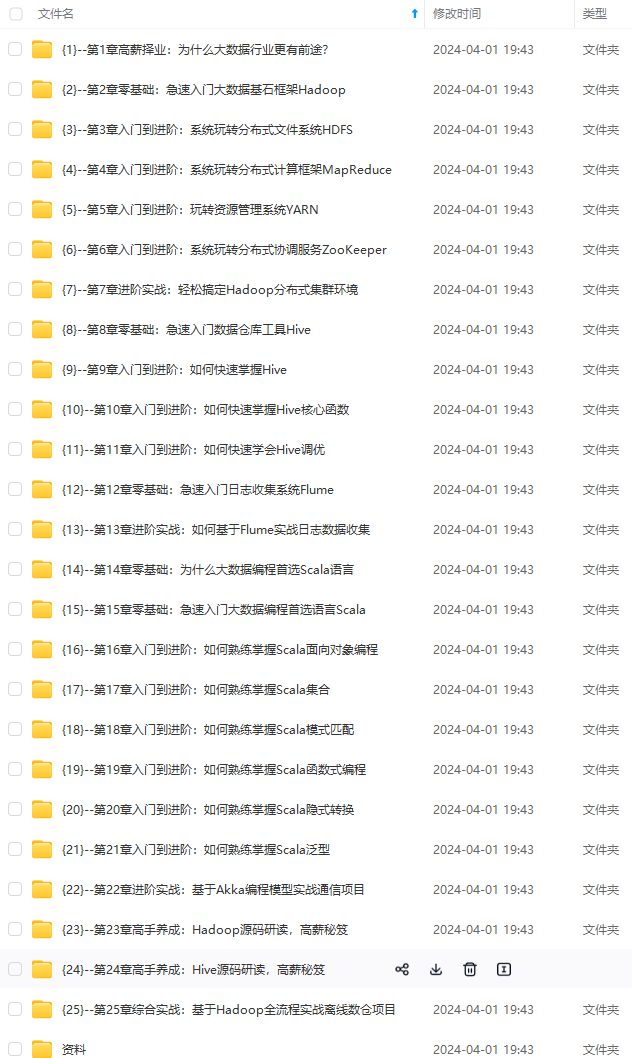

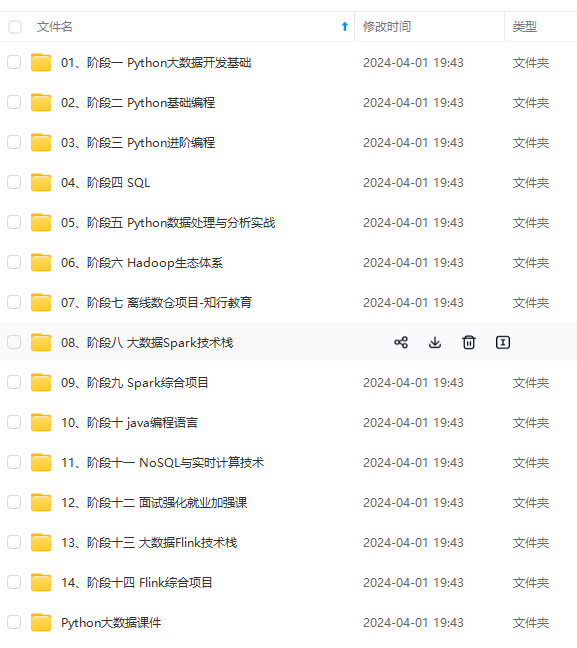

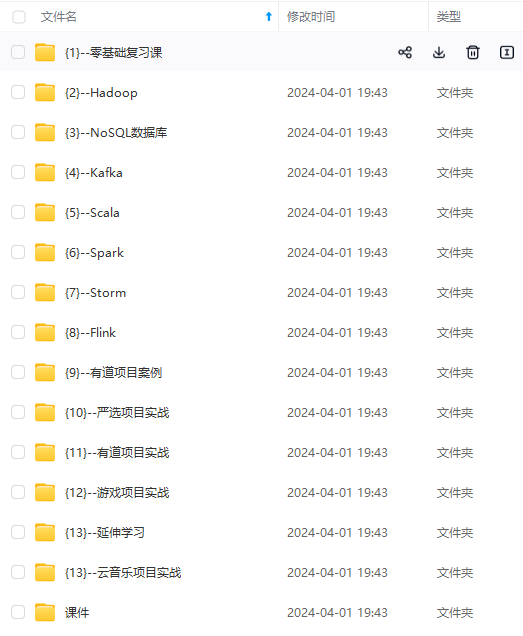

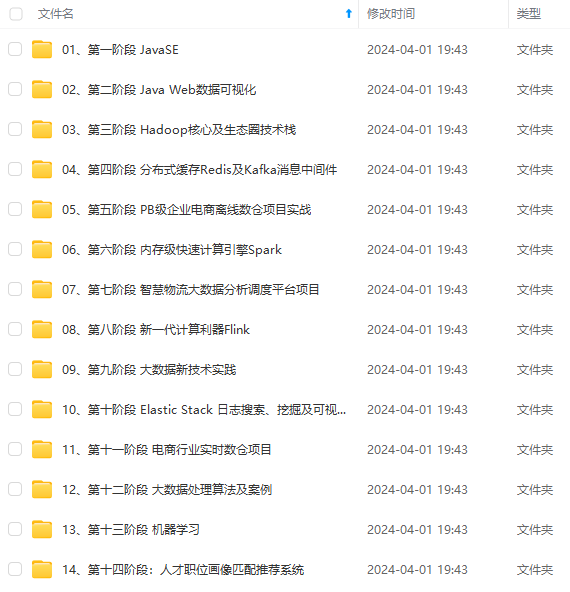

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

参照给出的英文文档word.txt,使用scala编程读取文件,并且编写一个函数判断文档中的每个单词是否为回文单词,若是则输出该单词。

实现思路及步骤:

(1)读取word.txt数据,将数据

(2)使用flatMap()方法获取缓存区里面的数据,并使用空格进行分割。

(3)定义函数isPalindrom(word:String)

(4) 在函数中判断单词正向与逆向是否一样,若是则输出该单词

(5)调用isPalindrom 函数

import scala.io.Source

object PalindromeFilter {

def main(args: Array[String]): Unit = {

val filePath = "word.txt" // 更改为实际的文本文件路径

// 读取文本文件数据

val words = Source.fromFile(filePath).getLines().flatMap(_.split(" "))

// 过滤回文单词并输出

words.filter(isPalindrome).foreach(println)

}

// 判断单词是否为回文

def isPalindrome(word: String): Boolean = {

word == word.reverse

}

}

3. 使用scala编程输出九九乘法表:

实验目标:

(1) 掌握scala循环的使用

(2) 掌握scala函数式编程

实验说明:

九九乘法表是我国古代人民的智慧结晶,在春秋战国时代就已经在筹算中运算,到明代则改良病用在算盘上。现需要使用scala编程输出九九乘法表,要求输出效果如图所示:

- 使用scala编程输出九九乘法表:

xxxxxxxxxx mkdir -p /u01/app/12.2.0/gridmkdir -p /u01/app/gridmkdir -p /u01/app/oracle/product/12.2.0/dbhome_1chown -R grid:oinstall /u01chown -R oracle:oinstall /u01/app/oraclechmod -R 775 /u01/css

(1) 掌握scala循环的使用

(2) 掌握scala函数式编程

实验说明:

九九乘法表是我国古代人民的智慧结晶,在春秋战国时代就已经在筹算中运算,到明代则改良病用在算盘上。现需要使用scala编程输出九九乘法表。

object chengfabiao{

def main(args: Array[String]): Unit = {

for (i<-1 to 9){

for (j<-1 to i){

print(j+"*"+i+"="+(i*j)+"\t")

}

println()

}

}

}

第二次实验

要去掉Spark中的日志输出,有几种不同的方法可以实现:

import org.apache.log4j.{Level, Logger}

val rootLogger = Logger.getRootLogger()

rootLogger.setLevel(Level.ERROR)

请根据给定的实验数据,在spark-shell中通过编程来计算以下内容:

学生填写代码以及给出最终结果

(1) 该系总共有多少学生;

答案为: 人

(2) 该系共开设来多少门课程;

答案为 门

(3) Tom同学的总成绩平均分是多少;

Tom同学的平均分为 分

(4) 求每名同学的选修的课程门数;

答案共 265行

(5) 该系DataBase课程共有多少人选修;

答案为 人

val rdd= sc.textFile("file:///home/spark/score.txt")

1.

val count = rdd.map(line=>line.split(",")(0)).distinct().count

2.

val countCourse = rdd.map(line=>line.split(",")(1)).distinct().count

3.

val sum = rdd.filter(line=>line.split(",")(0)=="Tom")

val avg = sum.map(name=>(name.split(",")(0),name.split(",")(2).toInt)).mapValues(x=>(x,1)).reduceByKey((x,y)=>(x._1+y._1,x._2+y._2)).mapValues(x=>(x._1/x._2)).collect()

4.

val countC = rdd.map(row=>(row.split(",")(0),row.split(",")(1))).mapValues(x=>(x,1)).reduceByKey((x,y)=>(" ",x._2+y._2)).mapValues(x =>x._2).foreach(println)

5

val countPeople = rdd.filter(line=>line.split(",")(1)=="DataBase").count

实验说明:

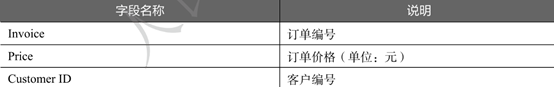

现有一份某电商2020年12月份的订单数据文件onlin_retail.csv,记录了每位顾客每笔订单的购物情况,包含三个数据字段,字段说明如下表所示。现需要统计每位客户的总消费金额,并筛选出消费金额在前50名的客户。

实现思路及步骤:

(1) 读取数据并创建RDD

(2) 通过map()方法分割数据,选择客户编号和订单价格字段组成键值对数据

(3) 使用reduceByKey()方法计算每位客户的总消费金额

(4) 使用sortBy()方法对每位客户的总消费金额进行降序排序,取出前50条数据

val rdd= sc.textFile("file:///home/spark/online_retail.txt")

val bianhao = rdd.mapPartitionsWithIndex((index, iter) => {

if (index == 0) {

iter.drop(1) // 跳过第一行

} else {

iter

}

}).map(line => {

val fields = line.split(",").map(_.trim)

if (fields.length > 1 && fields(0).nonEmpty) {

Some((fields(0), fields(1).toDouble))

} else {

None

}

}).filter(_.isDefined).map(_.get)

bianhao.collect().foreach(println)

bianhao.take(10).foreach(println)

val totalSpentPerCustomer = bianhao.map{ case (customerId, price) => (customerId, price) }.reduceByKey(_ + _)

totalSpentPerCustomer.collect().foreach(println)

totalSpentPerCustomer.take(10).foreach(println)

val jiangxu = totalSpentPerCustomer.sortBy(_._2, ascending = false)

jiangxu.take(50).foreach(println)

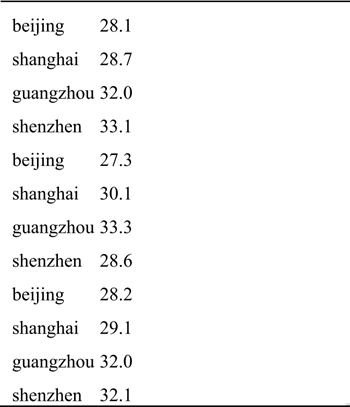

实验说明:

现有一份各城市的温度数据文件avgTemperature.txt,数据如下表所示,记录了某段时间范围内各城市每天的温度,文件中每一行数据分别表示城市名和温度,现要求用spark编程计算出各城市的平均气温。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-YryQNMYb-1713211959567)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

227

227

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?