@Override

public void afterBulk(long executionId, BulkRequest request, BulkResponse response) {

// 执行之后调用

System.out.println("成功" + request.numberOfActions() + "条数据,用时" + response.getTook());

}

@Override

public void afterBulk(long executionId, BulkRequest request, Throwable failure) {

// 失败时调用

System.out.println("失败" + request.numberOfActions() + "条数据");

System.out.println("失败" + failure);

}

};

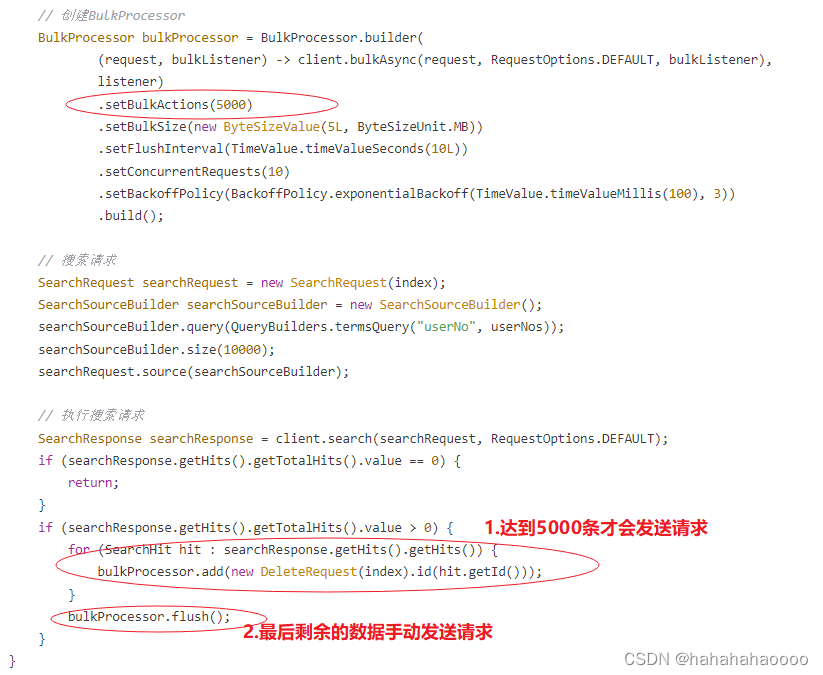

BulkProcessor bulkProcessor = BulkProcessor.builder(

(request, bulkListener) -> client.bulkAsync(request, RequestOptions.DEFAULT, bulkListener),

listener)

.setBulkActions(5000)

.setBulkSize(new ByteSizeValue(5L, ByteSizeUnit.MB))

.setFlushInterval(TimeValue.timeValueSeconds(10L))

.setConcurrentRequests(10)

.setBackoffPolicy(BackoffPolicy.exponentialBackoff(TimeValue.timeValueMillis(100), 3))

.build();

SearchRequest searchRequest = new SearchRequest(index);

SearchSourceBuilder searchSourceBuilder = new SearchSourceBuilder();

searchSourceBuilder.query(QueryBuilders.termsQuery("userNo", userNos));

searchSourceBuilder.size(10000);

searchRequest.source(searchSourceBuilder);

SearchResponse searchResponse = client.search(searchRequest, RequestOptions.DEFAULT);

if (searchResponse.getHits().getTotalHits().value == 0) {

return;

}

if (searchResponse.getHits().getTotalHits().value > 0) {

for (SearchHit hit : searchResponse.getHits().getHits()) {

bulkProcessor.add(new DeleteRequest(index).id(hit.getId()));

}

bulkProcessor.flush();

bulkProcessor.close();

client.close();

}

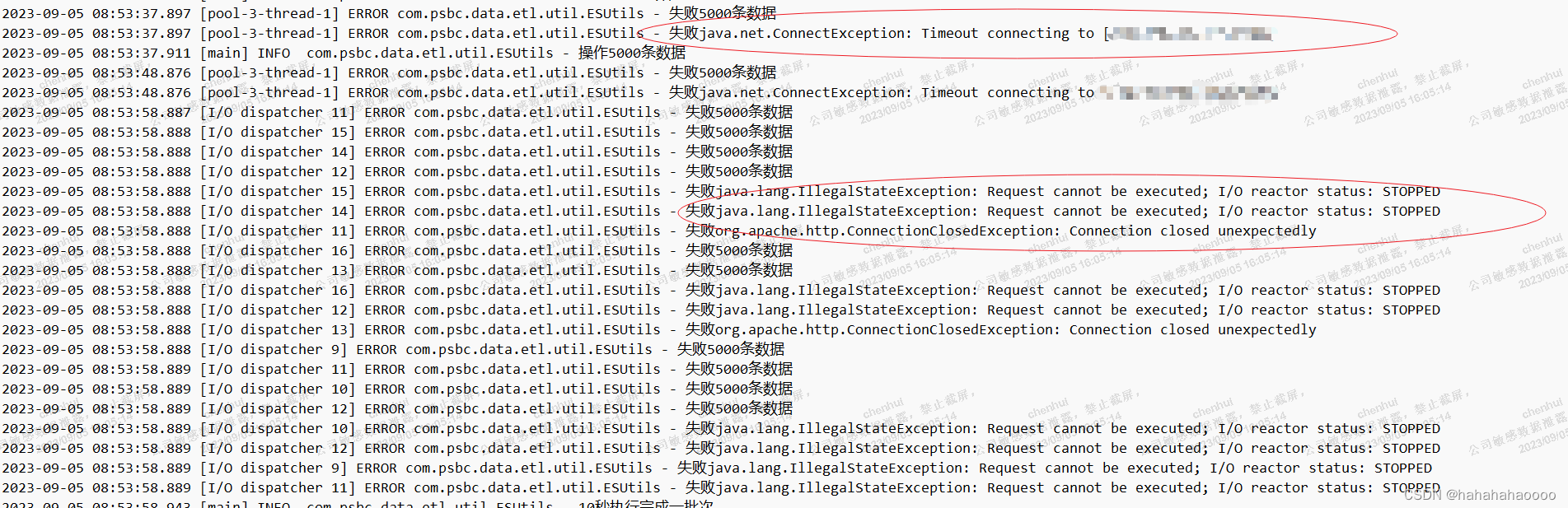

2.遇到的问题连接超时和io问题,这是因为发起的线程太多了上面我设置了10个线程,一个线程5000的数据,.setBulkActions(5000) .setConcurrentRequests(10) 因为线程太多导致有一个线程不成功的话就会导致缺少数据,后面解决把.setBulkActions(2000) .setConcurrentRequests(1)就成功导入1000万数据成功了

3.遇到的坑

最后一次如果没有达到5000的不会发送请求,手动刷新一次.flush,关闭客户端不能立马关闭不然会出现I/O异常,使用bulkProcessor.awaitClose( timeout: executeTime/1000,TimeUnit.SECoNDS);关闭,加在flush的后面一行

4.最终代码成功导入一千万数据到es完整代码耗时30分钟

public static void bulksaveByUserNoRequest(String index, List userNos) throws IOException {

//创建ES客户端

try (RestHighLevelClient client = getClient()) {

BulkProcessor.Listener listener = new BulkProcessor.Listener() {

@Override

public void beforeBulk(long executionId, BulkRequest request) {

// 执行之前调用

System.out.println(“操作” + request.numberOfActions() + “条数据”);

}

@Override

public void afterBulk(long executionId, BulkRequest request, BulkResponse response) {

// 执行之后调用

System.out.println("成功" + request.numberOfActions() + "条数据,用时" + response.getTook());

}

@Override

public void afterBulk(long executionId, BulkRequest request, Throwable failure) {

// 失败时调用

System.out.println("失败" + request.numberOfActions() + "条数据");

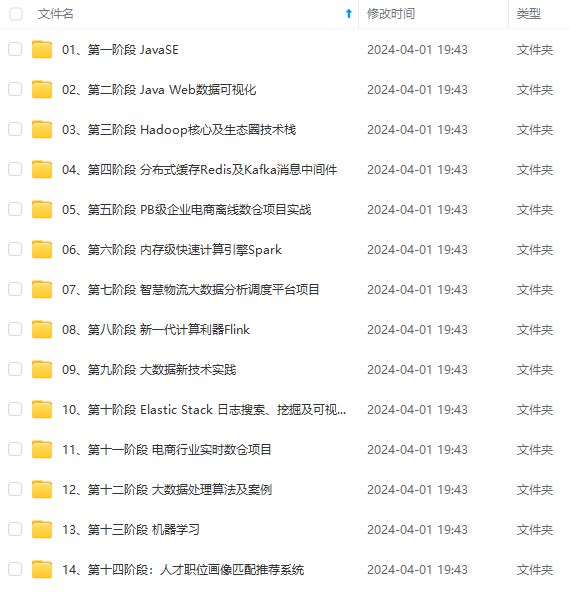

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

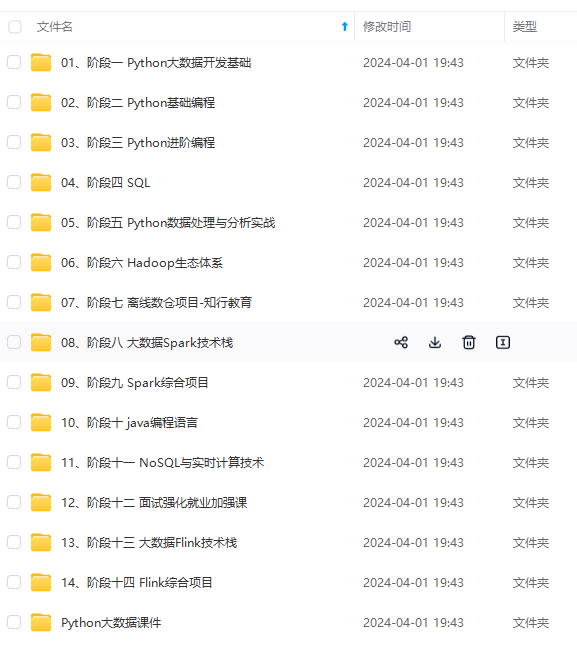

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

战项目、大纲路线、讲解视频,并且后续会持续更新**

481

481

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?