网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

n\times n

n×n,核形状为

f

×

f

f\times f

f×f,那么经过卷积核作用后,得到的输出形状为

(

n

−

f

1

)

×

(

n

−

f

1

)

(n-f+1)\times (n-f+1)

(n−f+1)×(n−f+1)。可以看出,通常情况下输出特征会由于卷积核的作用而减小。而深度神经网络中,由于卷积核的作用,会导致我们的输出过早的变的很小,导致我们无法构建深层的神经网络。本章介绍另外两个影响输出形状的方法,扩充(padding)和步幅(stride)。

- 有时候,输出远远小于输入,这是因为卷积核的影响,而在原始图像较小的情况下,任意丢失很多信息,这个时候我们需要使用填充是解决此问题。

- 有时,我们可能希望大幅降低图像的宽度和高度。例如,我们发现一个图像实在是太大了。这个时候使用步幅可以快速将输出变小。

1. padding

为了构建深度神经网络,你需要学会使用的一个基本的卷积操作就是padding。首先让我们来回忆一下卷积是如何计算的:

这其实有两个缺陷:

- 第一个是如果每一次使用一个卷积操作,我们的图像都会缩小。 例如我们从 6x6 通过一个 3x3的卷积核,做不了几次卷积,我们的图片就会变得非常小,也许它会缩小到只有1x1。

- 第二个缺陷是图片角落或者边际上的像素只会在输出中被使用一次 因为它只通过那个3x3的过滤器(filter)一次 然而图片中间的一个像素,会有许多3x3的过滤器(filter)在那个像素上重叠 所以相对而言 角落或者边界上的像素被使用的次数少很多,这样我们就丢失了许多图片上靠近边界的信息。

所以为了同时解决上述的两个问题。我们能做的是在使用卷积操作前,对图片进行填充,通常是用0来进行填充,具体如下所示。

我们可以沿着图像边缘再填充一层像素。这样那么3×3的图像就被我们填充成了一个5×5的图像。如果你用2×2的卷积核对这个5×5的图像卷积,我们得到的输出就不是2×2,而是4×4的图像,你就得到了一个尺寸比原始图像3×3还大图像。习惯上,我们都用用0去填充,如果

p

p

p是填充参数,在这个案例中,

p

=

1

p=1

p=1,因为我们在周围都填充了一个像素点,输出也就变成了

(

n

2

p

−

f

1

)

×

(

n

2

p

−

f

1

)

(n+2p-f+1)×(n+2p-f+1)

(n+2p−f+1)×(n+2p−f+1)。所以,要是我们想要保持图像大小不变,则意味着

2

p

−

f

1

=

0

2p-f+1=0

2p−f+1=0,则

p

=

f

−

1

2

p=\frac{f-1}{2}

p=2f−1,在后面我们的卷积核通常会设置为奇数。

为了指定卷积操作中的padding,我们可以指定

p

p

p的值。以上就是padding,下面我们讨论一下如何在卷积中设置步长。

2.步幅(stride)

卷积窗口从输入张量的左上角开始,向下、向右滑动。 在前面的例子中,我们默认每次滑动一个元素。 但是,有时候为了高效计算或是缩减采样次数,卷积窗口可以跳过中间位置,每次滑动多个元素。卷积中的步幅是另一个构建卷积神经网络的基本操作,例如,下面是一个步幅为3的情况。

如果我们用一个

f

×

f

f×f

f×f的过滤器卷积一个

n

×

n

n×n

n×n的图像,padding为

p

p

p,步幅为

s

s

s,在这个例子中

s

=

3

s=3

s=3,因为现在我们不是一次移动一个步长,而是一次移动

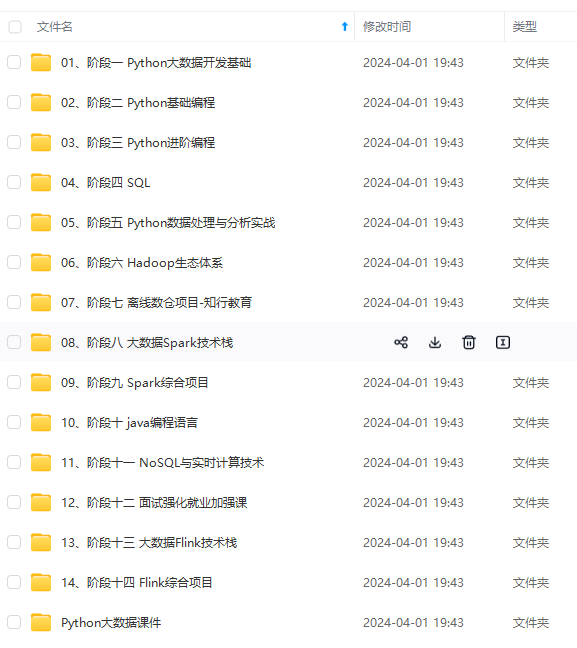

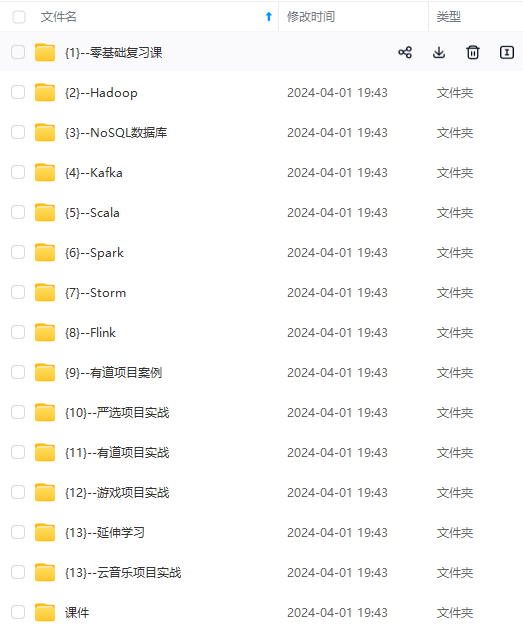

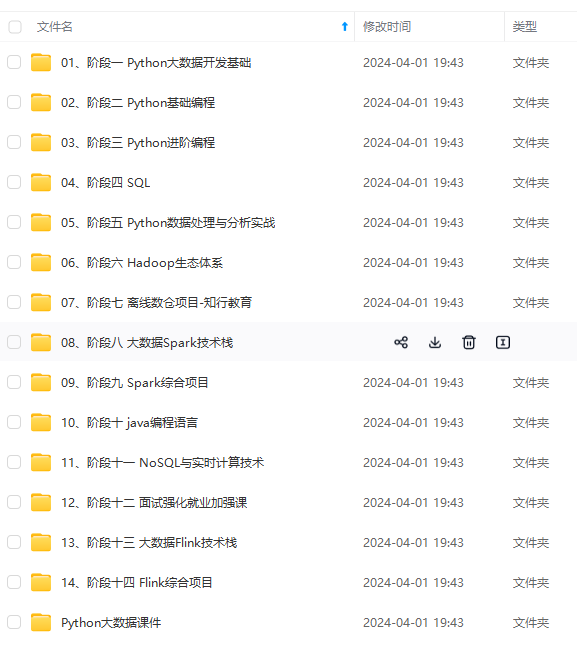

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

3

s=3

s=3,因为现在我们不是一次移动一个步长,而是一次移动

[外链图片转存中…(img-svyYW0F1-1715771795982)]

[外链图片转存中…(img-wazgVWMw-1715771795982)]

[外链图片转存中…(img-TYclVEb6-1715771795982)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

4653

4653

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?