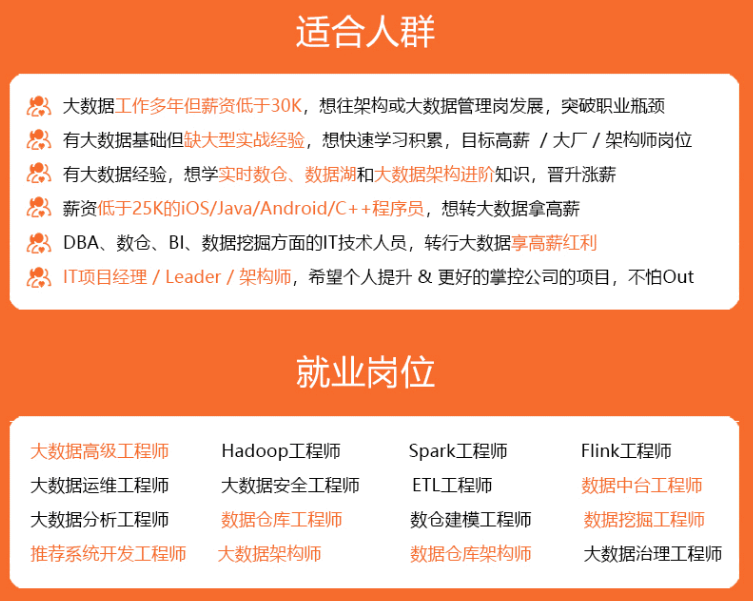

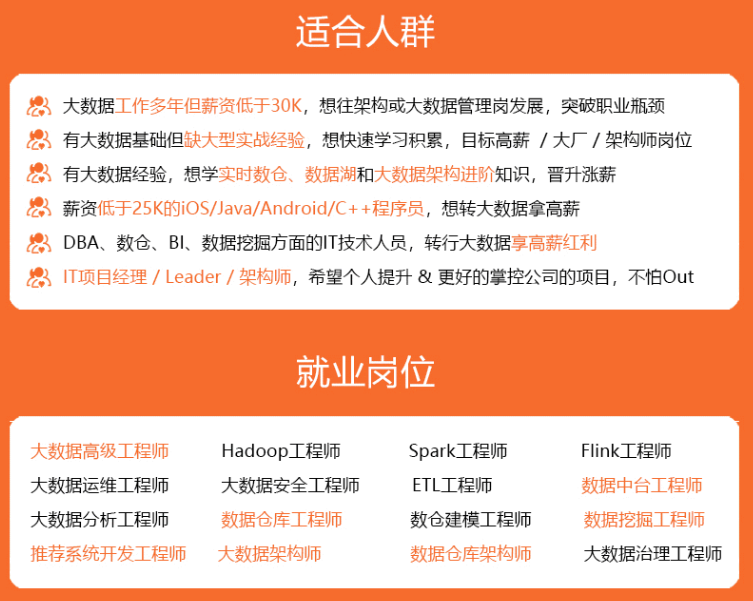

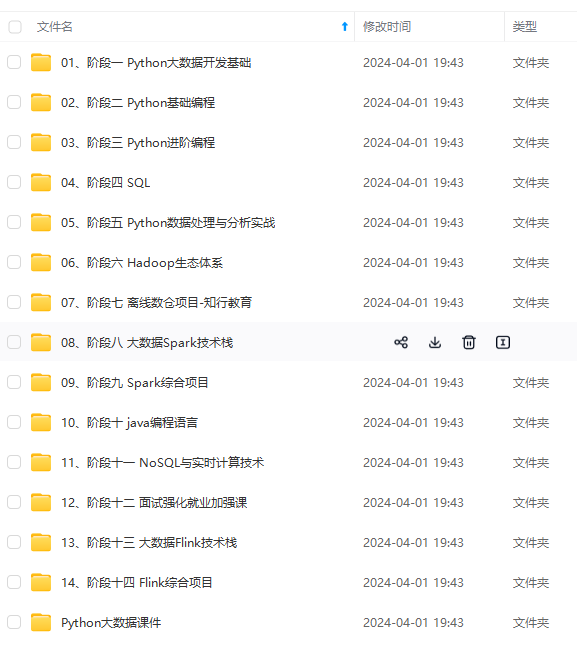

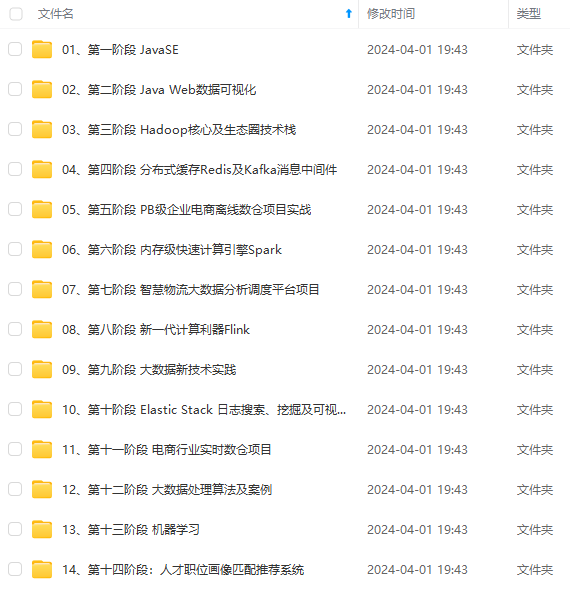

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

在处理机器学习算法时,因为数据库太大而无法放置进内存的情况很常见。

这就引出了如下的问题:

如何加载我的大容量数据文件?

当因我尝试运行数据集算法而导致程序崩溃时,我该怎么办?

你能帮我解决内存不足的问题吗?

在这篇文章中, 我想找出一些你会考虑的一些建议。

分配更多内存

某些机器学习工具或数据库可能受到默认内存配置的限制。检查是否可以重新配置工具或数据库来使其分配到更多内存。Weka 是一个很好的例子, 在该示例中, 您可以在启动应用程序时将内存增加为参数。

使用较小的样本

**是否确实需要处理所有数据?**随机抽取数据的样本, 例如前1000行或10万列。在对所有数据 (使用渐进式数据加载技术) 拟合最终模型之前, 请使用这个较小的示例来解决问题。

我认为这是一个很好的做法, 在一般的机器学习中,这种方式可以让你快速得到抽查的算法和周转的结果。您还可以考虑,对用于匹配一个算法的数据量进行灵敏度分析, 而不是用模型技能。也许有一个递减反馈的自然点, 让你可以使用其作为你小样本的一个合适的大小值。

使用具有更多内存的计算机

**你必须在你的电脑上工作吗?**也许你可以访问一台更大的计算机, 是以你电脑的内存的数量级倍数存在的那种。例如,在云服务上租用大内存服务器就是一个好的选择是;例如亚马逊 Web 服务, 它提供的机器的 RAM 为每小时还不到一美元。我发现这种方法在过去非常有用。

更改数据格式

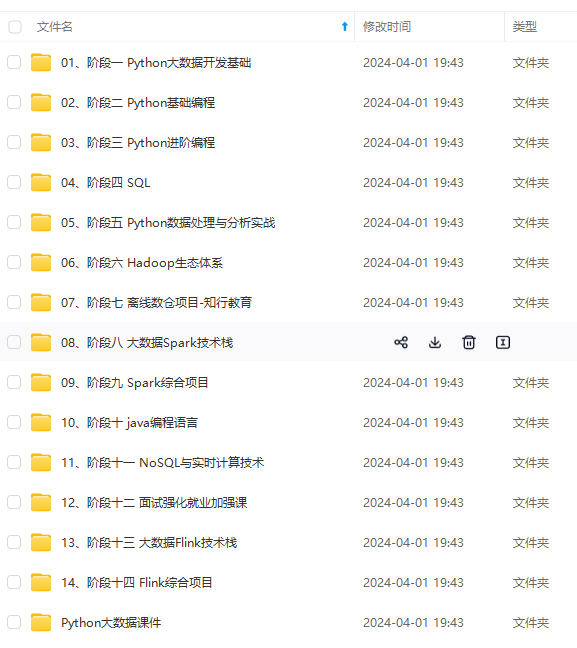

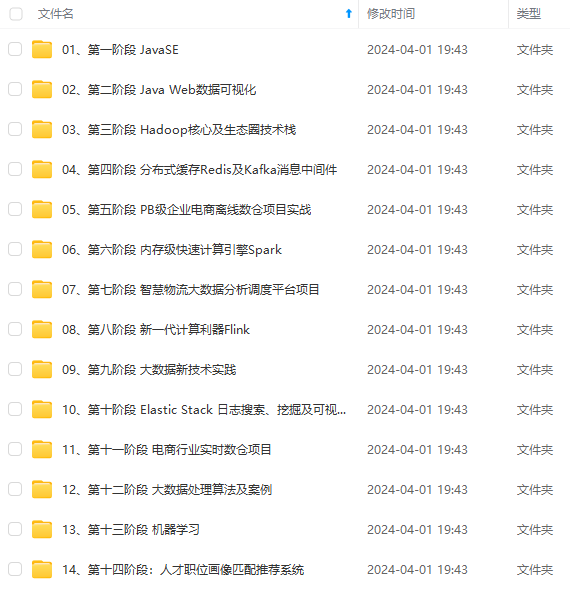

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

ttps://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?