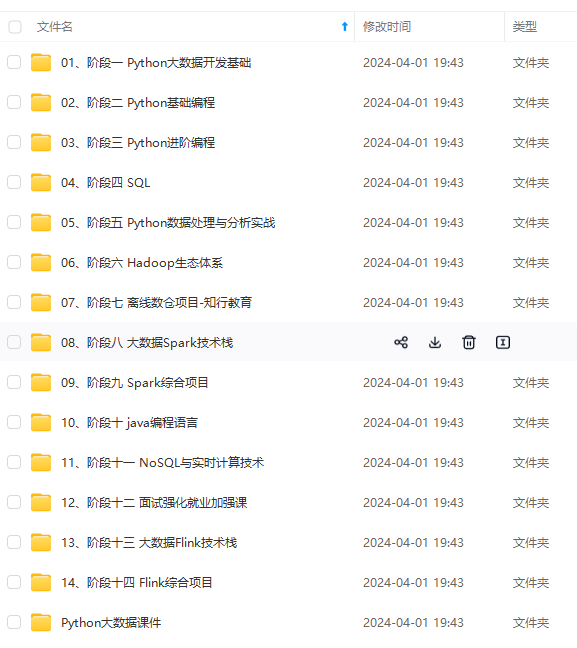

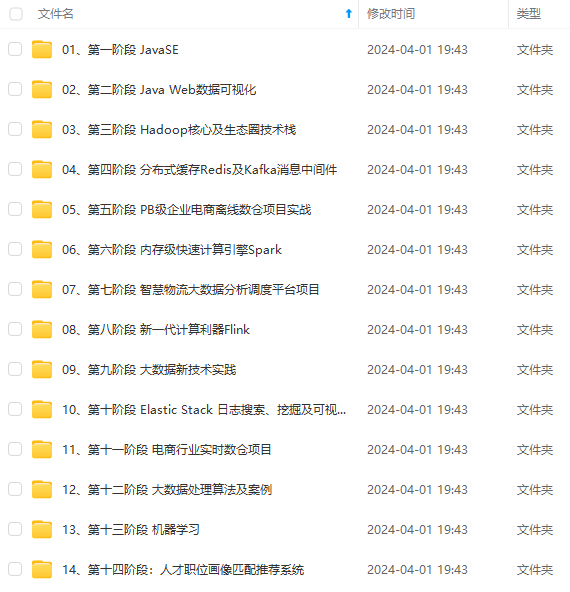

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

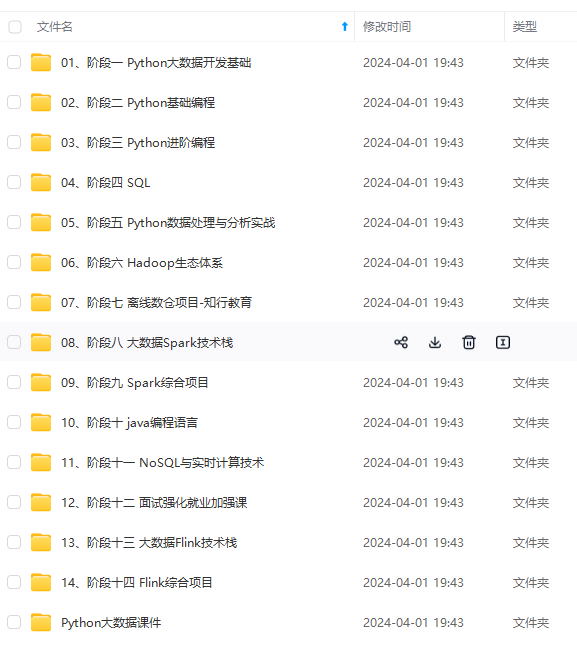

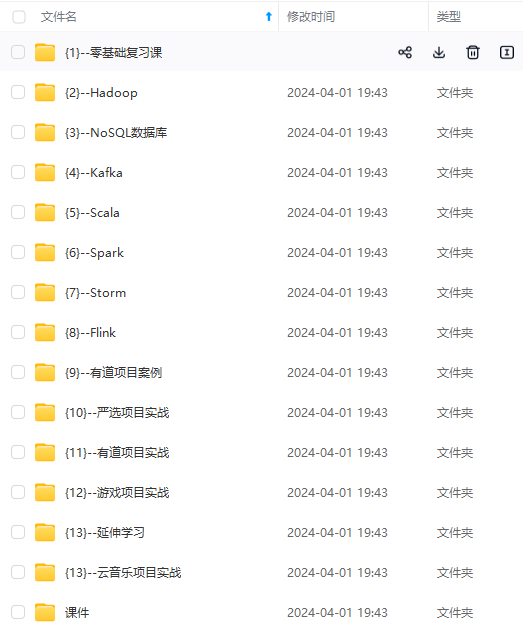

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

由于基分类器是构建在训练样本的自助抽样集上的,只有约 63.2% 原样本集出现在中,而剩余的 36.8% 的数据作为包外数据,可以用于基分类器的验证集。

经验证,包外估计是对集成分类器泛化误差的无偏估计

无偏估计:就是认为所有样本出现的概率一样

有偏估计:就是偏重那些出现次数多的样本,认为样本的概率是不一样的

包外估计的用途

- 当基学习器是决策树时,可使用包外样本来辅助剪枝 ,或用于估计决策树中各结点的后验概率以辅助对零训练样本结点的处理;

- 当基学习器是神经网络时,可使用包外样本来辅助早期停止以减小过拟合 。

2.2.3 随机森林api介绍

sklearn.ensemble.RandomForestClassifier(n_estimators=10, criterion=’gini’, max_depth=None, bootstrap=True, random_state=None, min_samples_split=2)

-

n_estimators:integer,optional(default = 10)森林里的树木数量120,200,300,500,800,1200- 在利用最大投票数或平均值来预测之前,你想要建立子树的数量。

-

Criterion:string,可选(default =“gini”)- 分割特征的测量方法

-

max_depth:integer或None,可选(默认=无)- 树的最大深度 5,8,15,25,30

-

max_features="auto”,每个决策树的最大特征数量- If “auto”, then max_features=sqrt(n_features).

- If “sqrt”, then max_features=sqrt(n_features)(same as “auto”).

- If “log2”, then max_features=log2(n_features).

- If None, then max_features=n_features.

-

bootstrap:boolean,optional(default = True)- 是否在构建树时使用放回抽样

-

min_samples_split内部节点再划分所需最小样本数- 这个值限制了子树继续划分的条件,如果某节点的样本数少于min_samples_split,则不会继续再尝试选择最优特征来进行划分,默认是2。

- 如果样本量不大,不需要管这个值。如果样本量数量级非常大,则推荐增大这个值。

-

min_samples_leaf叶子节点的最小样本数- 这个值限制了叶子节点最少的样本数,如果某叶子节点数目小于样本数,则会和兄弟节点一起被剪枝, 默认是1。

- 叶是决策树的末端节点。 较小的叶子使模型更容易捕捉训练数据中的噪声。

-

min_impurity_split: 节点划分最小不纯度- 这个值限制了决策树的增长,如果某节点的不纯度(基于基尼系数,均方差)小于这个阈值,则该节点不再生成子节点。即为叶子节点 。

继续使用 机器学习算法(4)—— 决策树算法 一文中“泰坦尼克号乘客生存预测” 案例

from sklearn.model_selection import GridSearchCV

from sklearn.ensemble import RandomForestClassifier

estimator = RandomForestClassifier()

# 定义超参数的选择列表

param = {"n\_estimators": [120,200,300,500,800,1200], "max\_depth": [5, 8, 15, 25, 30]}

# 使用GridSearchCV进行网格搜索

estimator = GridSearchCV(estimator,param_grid=param,cv=2)

estimator.fit(x_train,y_train)

score = estimator.score(x_test,y_test)

注意:

- 随机森林的建立过程

- 树的深度、树的个数等需要进行超参数调优

2.2.4 随机森林案例

2.3 Bagging 小结

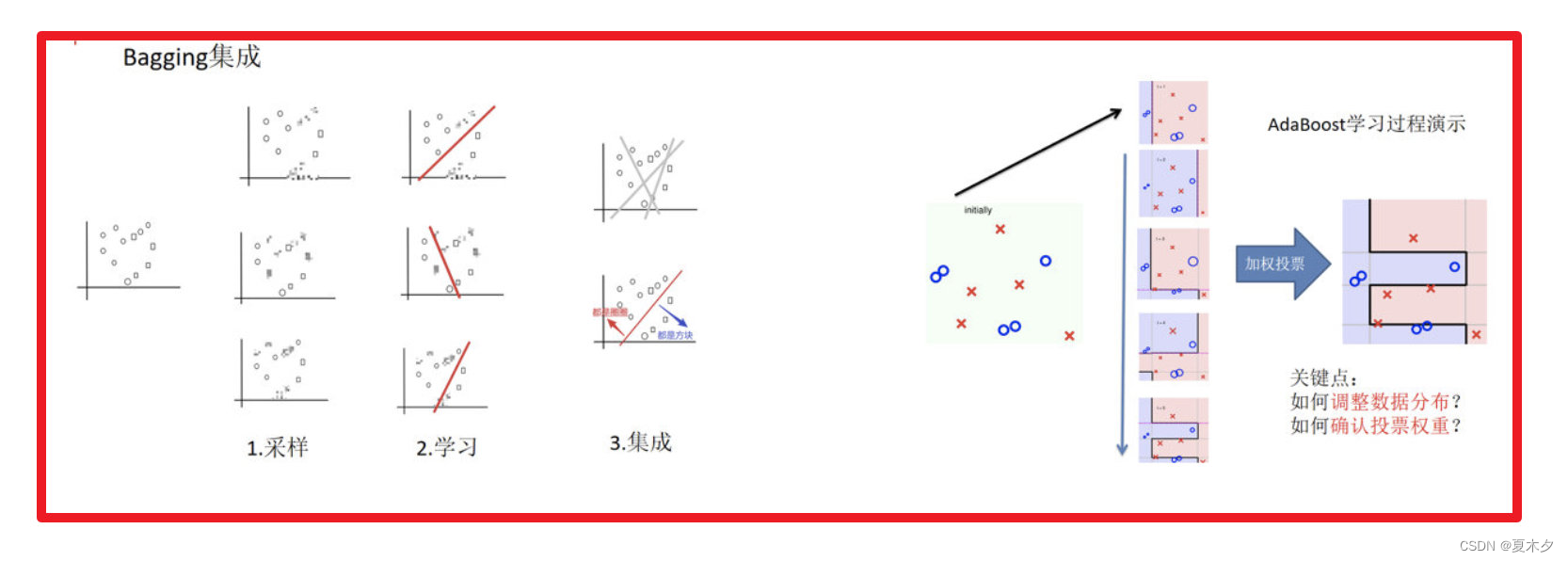

Bagging + 决策树/线性回归/逻辑回归/深度学习… = bagging集成学习方法

经过上面方式组成的集成学习方法:

- 均可在原有算法上提高约2%左右的泛化正确率

- 简单, 方便, 通用

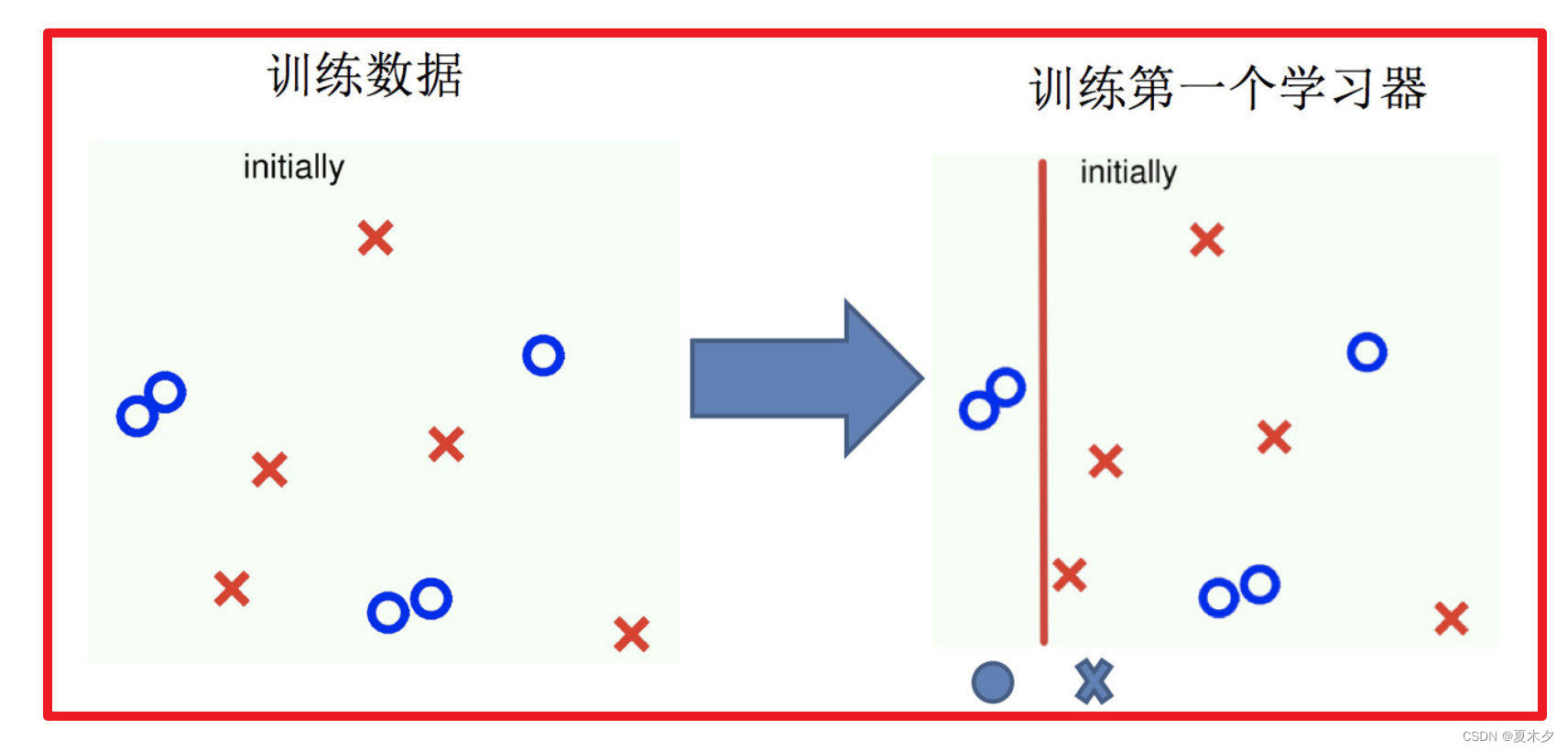

3 Boosting

3.1 Boosting 集成原理

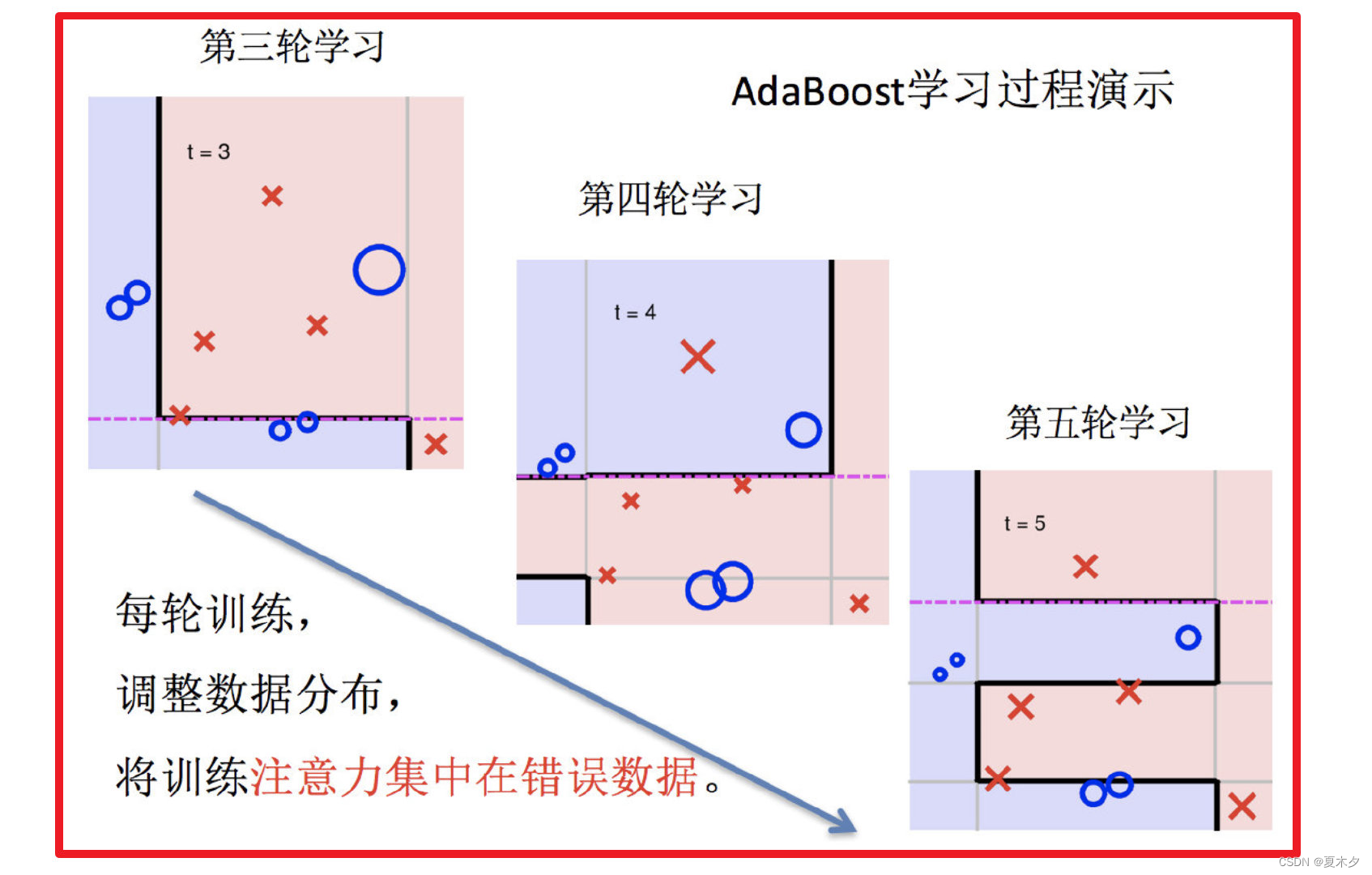

随着学习的积累从弱到强

简而言之:每新加入一个弱学习器,整体能力就会得到提升

代表算法:Adaboost,GBDT,XGBoost,LightGBM

实现过程:

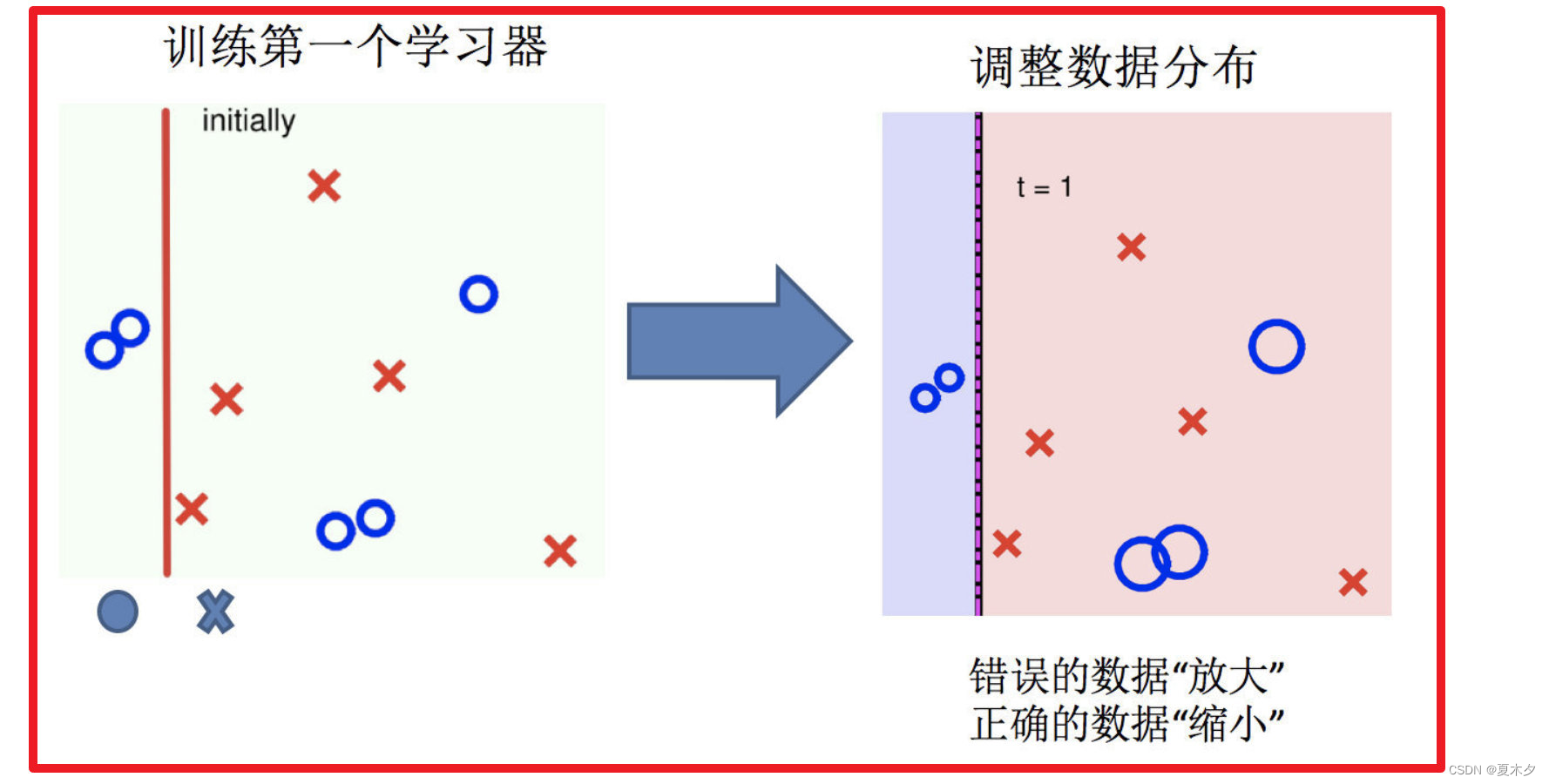

- 训练第一个学习器

- 调整数据分布

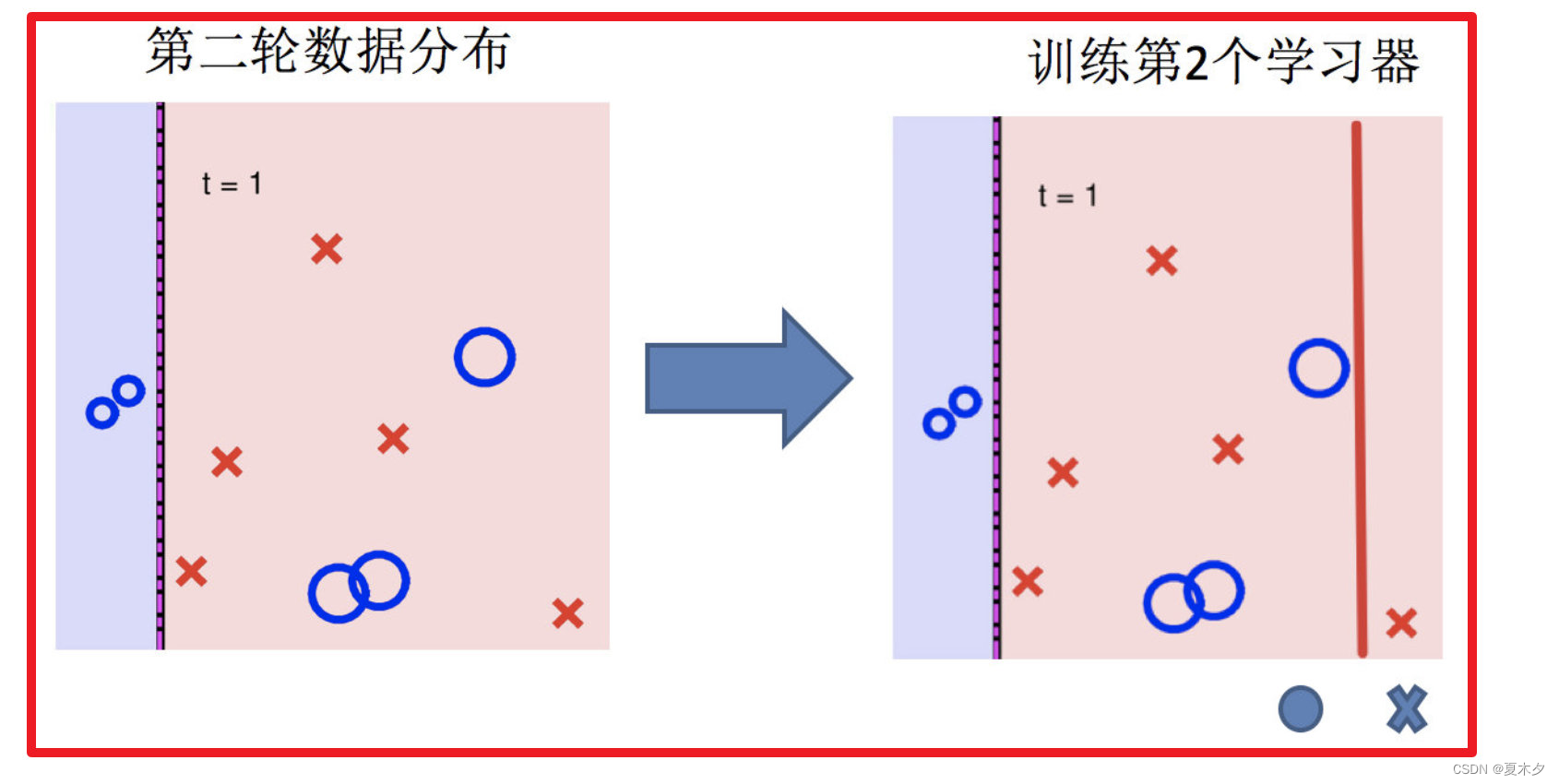

3. 训练第二个学习器

4. 再次调整数据分布

5. 依次训练学习器,调整数据分布

3.2 与 Bagging 的区别

区别一:数据方面

- Bagging:对数据进行采样训练;

- Boosting:根据前一轮学习结果调整数据的重要性。

区别二:投票方面

- Bagging:所有学习器平权投票;

- Boosting:对学习器进行加权投票(正确率高的话给的权重更大)

区别三:学习顺序

- Bagging的学习是并行的,每个学习器没有依赖关系;

- Boosting学习是串行,学习有先后顺序。

区别四:主要作用

- Bagging主要用于提高泛化性能(解决过拟合,也可以说降低方差)

- Boosting主要用于提高训练精度 (解决欠拟合,也可以说降低偏差)

3.3 AdaBoost

from sklearn.ensemble import AdaBoostClassifier

3.4 GBDT

GBDT 的全称是 Gradient Boosting Decision Tree,梯度提升树,在传统机器学习算法中,GBDT算的上TOP3的算法。

首先,GBDT使用的决策树是CART回归树,无论是处理回归问题还是二分类以及多分类,GBDT使用的决策树通通都是都是CART回归树。

为什么不用CART分类树呢?

因为GBDT每次迭代要拟合的是梯度值,是连续值所以要用回归树。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

6649

6649

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?