先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

// 使用 try-with-resource 方式关闭JDBC连接 无需手动关闭

try (ClickHouseConnection conn = clickHouseDataSource.getConnection()) {

// clickhouse 通过游标的方式读取数据

Statement stmt = conn.createStatement();

ResultSet rs = stmt.executeQuery(SQL);

while (rs.next()) {

String name = rs.getString(1);

output.collect(new CHTestPO(name));

}

}

}

@Override

public void cancel() {

}

}

## 自定义Sink

### 需额外引入依赖

<!-- Flink-Connector-Jdbc -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-jdbc_${scala.binary.version}</artifactId>

</dependency>

### Java 对sql语句处理的两个对象

1. PreparedStatement对象:能够对预编译之后的sql语句进行处理【SQL 语句预编译:通过`占位符'?'`实现,可以防止sql注入】

2. Statement对象:只能对静态的sql语句进行处理

### 核心代码

/**

* 使用 Flink-jdbc-connector + 批量写入 + sql语句的预编译 写入 Clickhouse

*/

public class ClickHouseJdbcSink {

private final SinkFunction<T> sink;

private final static String NA = "null";

public ClickHouseJdbcSink(String sql, int batchSize, String url) {

sink = JdbcSink.sink(

sql,

// 对sql语句进行预编译

new ClickHouseJdbcStatementBuilder<T>(),

// 设置批量插入数据

new JdbcExecutionOptions.Builder().withBatchSize(batchSize).build(),

// 设置ClickHouse连接配置

new JdbcConnectionOptions.JdbcConnectionOptionsBuilder()

.withUrl(url)

.build()

);

}

public SinkFunction<T> getSink() {

return this.sink;

}

/\*\*

* 对预编译之后的sql语句进行占位符替换

*

* @param ps: PreparedStatement对象 下标从 1 开始

* @param fields: clickhouse表PO对象的属性字段

* @param object: clickhouse表PO对象的属性字段所对应的数据类型

*/

public static void setPreparedStatement(

PreparedStatement ps,

Field[] fields,

Object object) throws IllegalAccessException, SQLException {

// 遍历 Field[]

for (int i = 1; i <= fields.length; i++) {

// 取出每个Field实例

Field field = fields[i - 1];

// 指示反射的对象在使用时应该取消 Java 语言访问检查

field.setAccessible(true);

// 通过Field实例的get方法返回指定的对象

Object o = field.get(object);

if (o == null) {

ps.setNull(i, 0);

continue;

}

// 这里统一设为字符型

String fieldValue = o.toString();

// 变量和常量的比较,通常将常量放前,可以避免空指针

if (!NA.equals(fieldValue) && !"".equals(fieldValue)) {

// 替换对应位置的占位符

ps.setObject(i, fieldValue);

} else {

ps.setNull(i, 0);

}

}

}

}

对sql语句进行预编译

@Slf4j

public class ClickHouseJdbcStatementBuilder implements JdbcStatementBuilder {

@Override

public void accept(PreparedStatement preparedStatement, T t) throws SQLException {

/\* \*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*\*

* Java通过反射获取类的字段:

*

* 1. getDeclaredFields():获取所有的字段,不会获取父类的字段

* 2. getFields(): 只能会public字段,获取包含父类的字段

*

* *********************/

Field[] fields = t.getClass().getDeclaredFields();

// 将获取到的字段替换sql预编译之后的占位符。

try {

ClickHouseJdbcSink.setPreparedStatement(preparedStatement, fields, t);

} catch (IllegalAccessException e) {

log.error("sql 预编译失败", e);

e.printStackTrace();

}

}

}

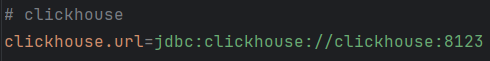

## ClickHouse读写工具类

public class ClickHouseUtil {

private static final String URL;

static {

ParameterTool parameterTool = ParameterUtil.getParameters();

URL = parameterTool.get("clickhouse.url");

}

/\*\*

* 读取clickhouse

*/

public static DataStream read(StreamExecutionEnvironment env, String sql) {

return env.addSource(new ClickHouseSource(URL, sql));

}

/\*\*

* 批量写入ClickHouse

*/

public static DataStreamSink batchWrite(

DataStream dataStream,

String sql,

int batchSize) {

//生成 SinkFunction

ClickHouseJdbcSink<T> clickHouseJdbcSink =

new ClickHouseJdbcSink<T>(sql, batchSize, URL);

return dataStream.addSink(clickHouseJdbcSink.getSink());

}

}

## 测试一下

public class ClickHouseUtilTest {

@DisplayName("测试Flink+jdbc+游标读取Clickhouse")

@Test

void testRead() throws Exception {

StreamExecutionEnvironment env =

StreamExecutionEnvironment.getExecutionEnvironment();

// 设置并行度1

env.setParallelism(1);

// 从default数据库的user表中读取数据

String sql = "select \* from default.user";

DataStream<CHTestPO> ds = ClickHouseUtil.read(env, sql);

// 打印数据流中的元素

ds.print("clickhouse");

// 执行程序

env.execute();

}

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-eeKbiy8k-1713363256390)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1237

1237

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?