1. 特征工程

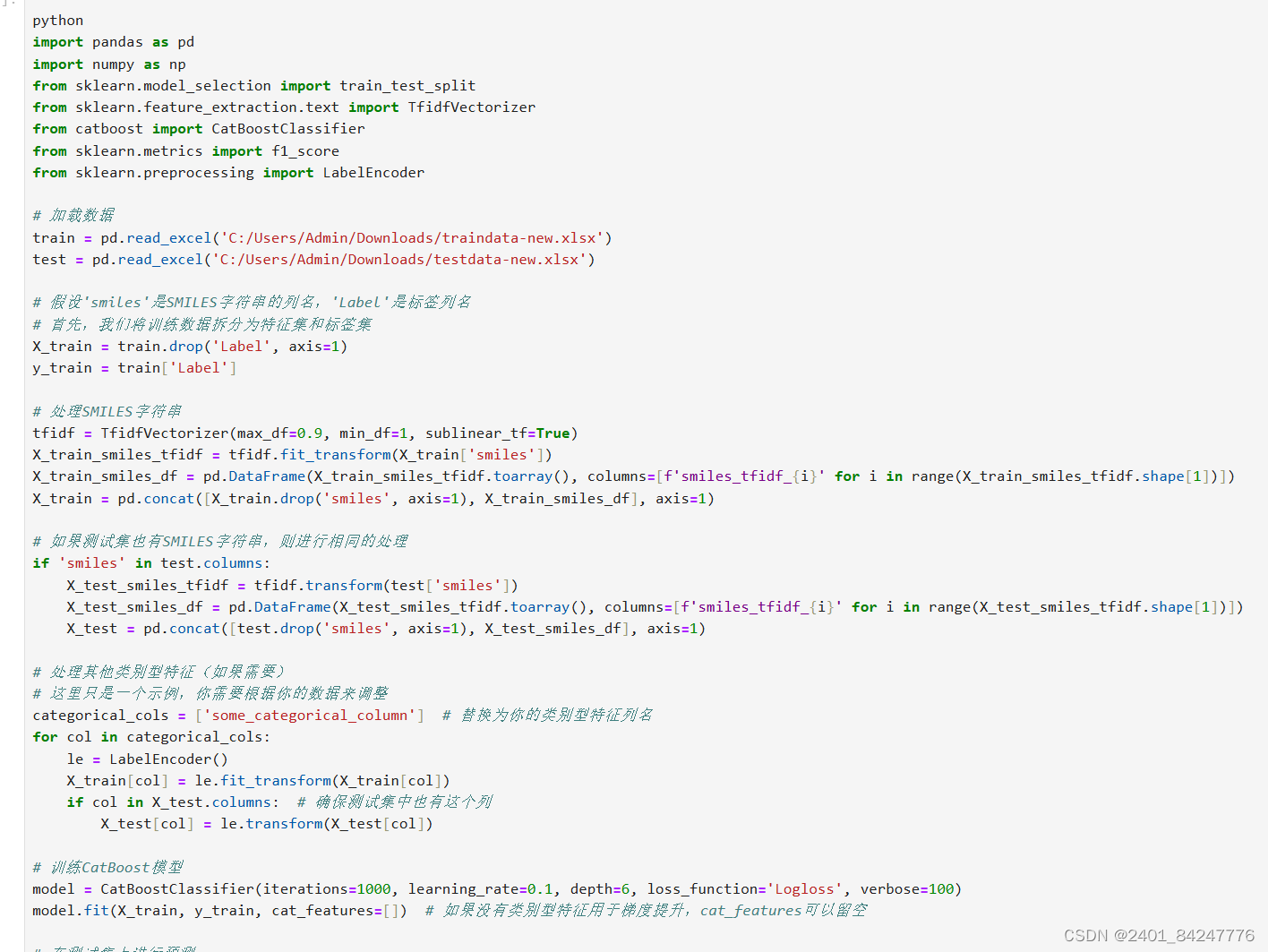

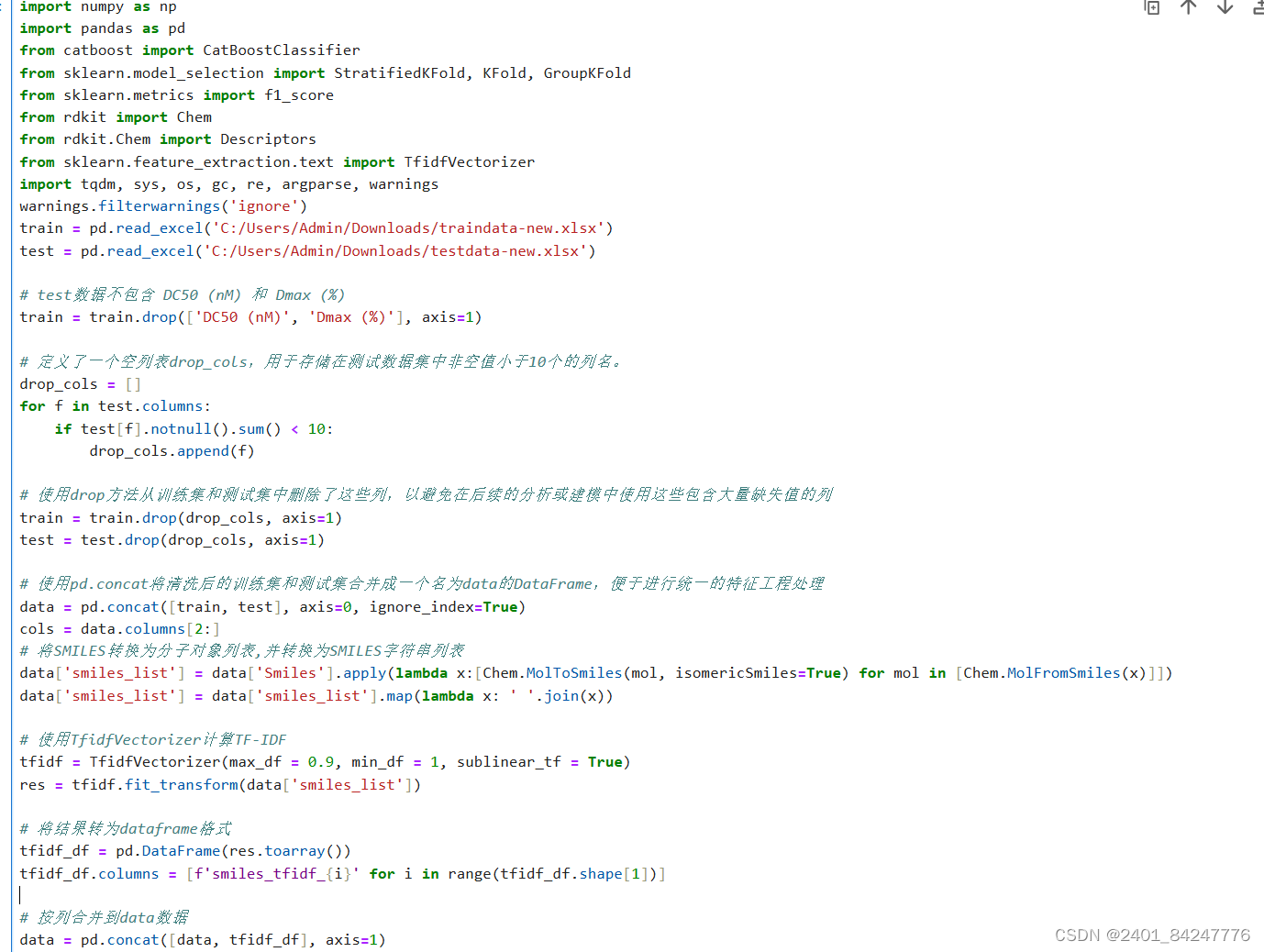

1.1 SMILES字符串处理

增加化学特征:除了使用TF-IDF处理SMILES字符串外,可以考虑使用RDKit库中的其他化学描述符(如分子量、氢键受体/给体数、logP等)作为额外的特征。

分子指纹:使用Morgan指纹(也称为半径指纹)或其他类型的分子指纹来捕捉分子结构的更多细节。

1.2 类别型特征处理

更精细的编码:对于类别型特征,可以尝试使用目标编码(Target Encoding)或M-Estimate Encoding等更复杂的编码方式,这些方式通常比简单的标签编码更有效。

2. 模型选择与调优

2.1 模型选择

尝试不同的模型:除了CatBoostClassifier外,可以尝试其他如XGBoost、LightGBM、RandomForest等模型,看哪种模型在交叉验证中表现最好。

混合模型:使用模型堆叠(Stacking)或投票(Voting)等集成学习方法,结合多个模型的预测结果来提高整体精度。

2.2 参数调优

网格搜索:使用GridSearchCV或RandomizedSearchCV对模型参数进行调优,找到最优的参数组合。

交叉验证:增加交叉验证的折数,如从5折增加到10折,以获得更稳定的模型评估结果。

3. 数据预处理

3.1 缺失值处理

更复杂的缺失值填充:对于缺失值,除了直接删除外,可以尝试使用均值、中位数、众数或基于模型的预测值进行填充。

特征重要性分析:在进行特征选择时,可以考虑特征的重要性,去除那些对模型预测贡献不大的特征。

3.2 标准化与归一化

数据标准化:对于数值型特征,进行标准化处理(Z-score标准化),使得所有特征都具有相同的尺度。

交叉验证:使用交叉验证(如k折交叉验证)来评估模型的性能,并减少过拟合的风险。交叉验证可以帮助你了解模型在不同数据子集上的表现,并给出更可靠的性能估计。

模型解释性:虽然CatBoost通常比黑盒模型(如深度神经网络)更易于解释,但在实际应用中仍然需要关注模型的解释性。你可以使用特征重要性评分、部分依赖图等工具来解释模型的预测结果,并了解哪些特征对预测结果的影响最大。

532

532

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?