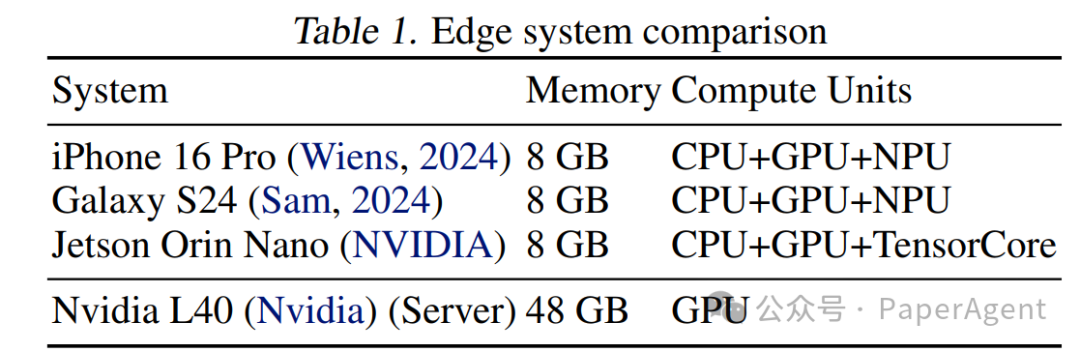

边缘设备(如手机)因内存和计算能力有限,运行RAG面临巨大挑战;

例如:一个存储了523万条记录的向量数据库的索引大小为18.5 GB,而手机通常只有4-12 GB的主内存。

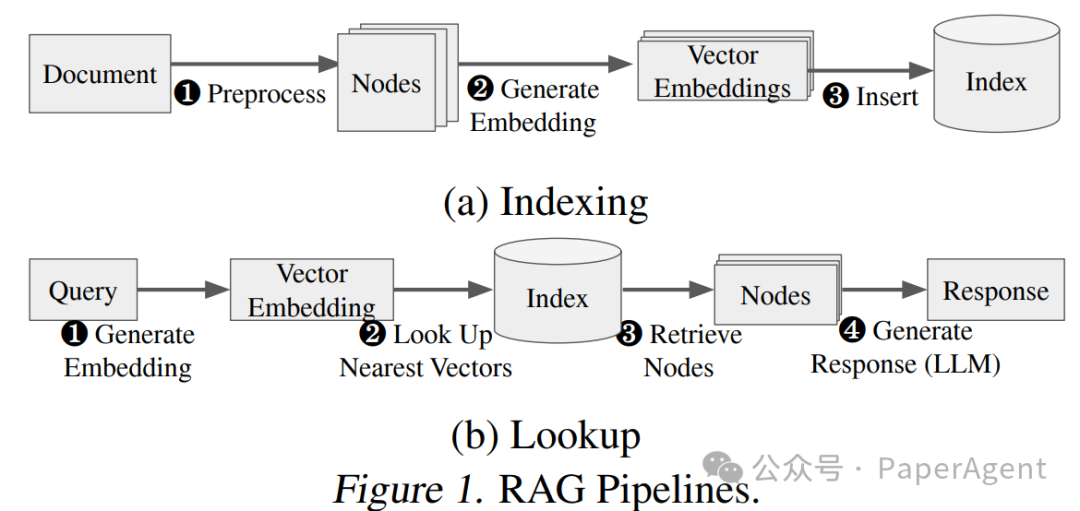

RAG的Pipeline

因此,谷歌等提出一种EdgeRAG系统:通过选择性存储,不是所有向量都存储,只有在检索过程中真正需要的嵌入向量才会被生成和存储,此外,还采用自适应缓存策略,以减少冗余计算并进一步优化延迟。

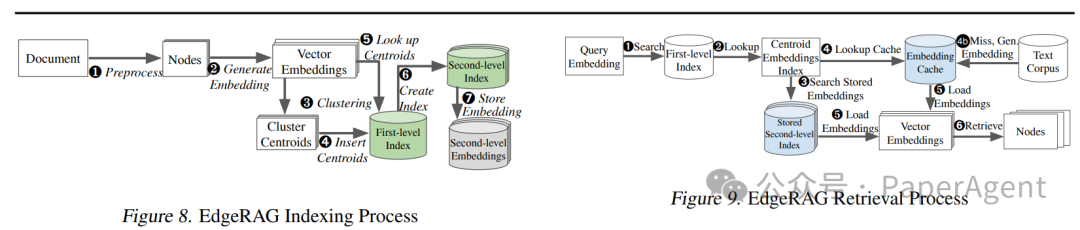

EdgeRAG索引过程

-

数据预处理与聚类:文本语料库被分割成较小的数据块,为每个数据块生成嵌入向量,然后进行聚类。聚类中心被存储在第一级索引中.

-

嵌入向量的存储决策:对于每个聚类中的数据块,计算生成嵌入向量的成本。如果成本超过预定义的服务级别目标(SLO),则存储整个数据块的嵌入向量;否则,丢弃嵌入向量以优化存储.

EdgeRAG检索过程

-

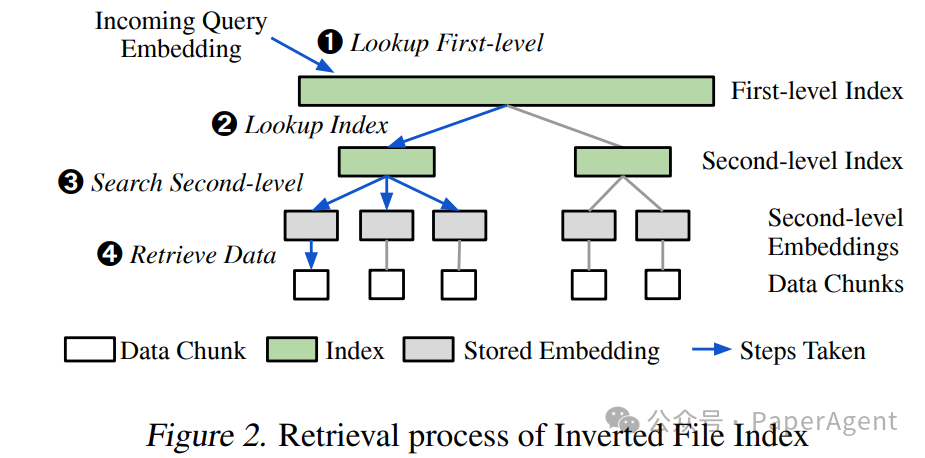

查找最相似的聚类中心:首先识别与查询嵌入向量最相似的聚类中心.

-

嵌入向量的获取:检查是否已预计算并存储了该聚类的嵌入向量。如果存在,则加载这些嵌入向量;如果不存在,则查找嵌入缓存。如果缓存命中,则加载缓存中的嵌入向量;如果缓存未命中,则重新生成嵌入向量并更新缓存.

-

数据块的检索:查找最接近的匹配嵌入向量,并检索相关的数据块.

EdgeRAG插入与删除

-

插入过程:新添加的数据块会被分配到最近的聚类中心,并更新相应的索引。如果更新后的聚类嵌入向量的生成成本超过SLO,则重新生成并存储嵌入向量.

-

删除过程:首先定位相应的聚类,然后移除相关嵌入向量,并更新聚类索引。如果生成嵌入向量的成本低于SLO,则可以删除整个聚类的嵌入向量.

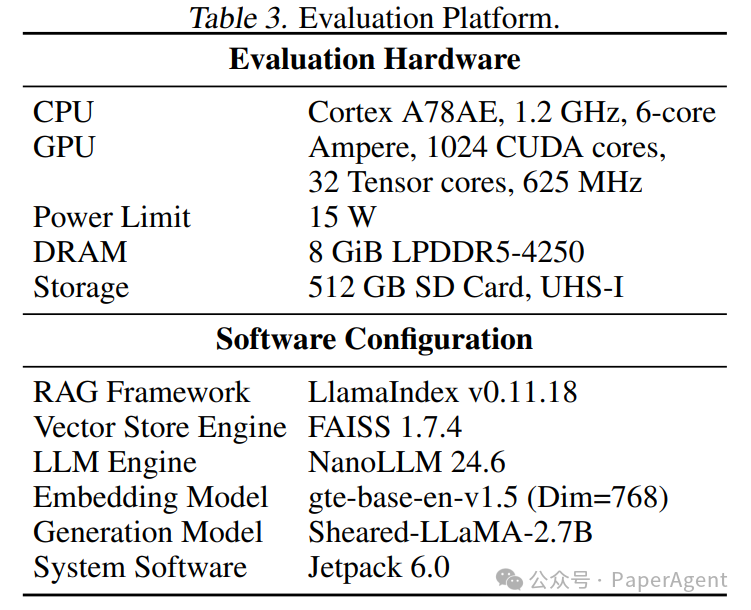

平台与数据集:在Nvidia Jetson Orin Nano平台上进行评估,使用了来自BEIR基准测试套件的六个数据集.

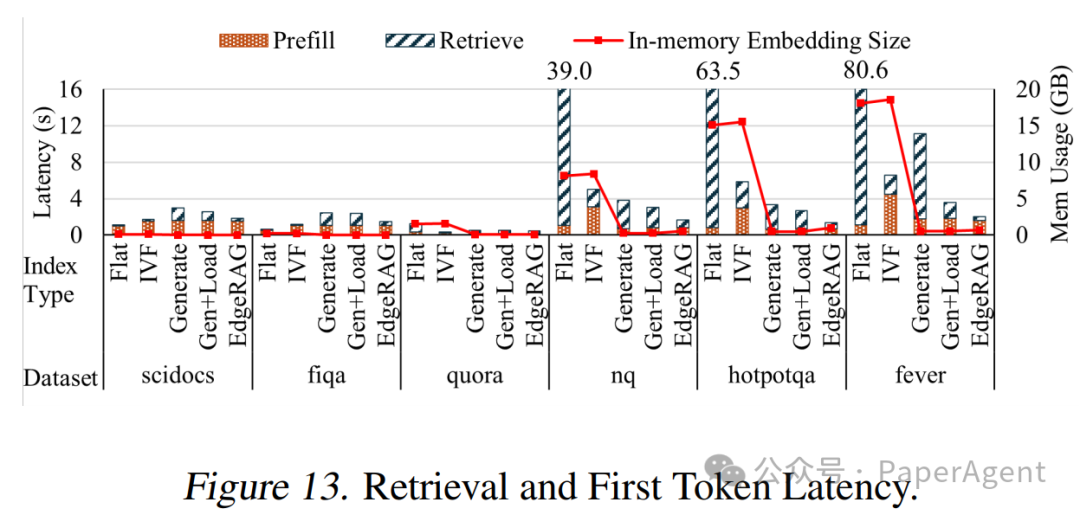

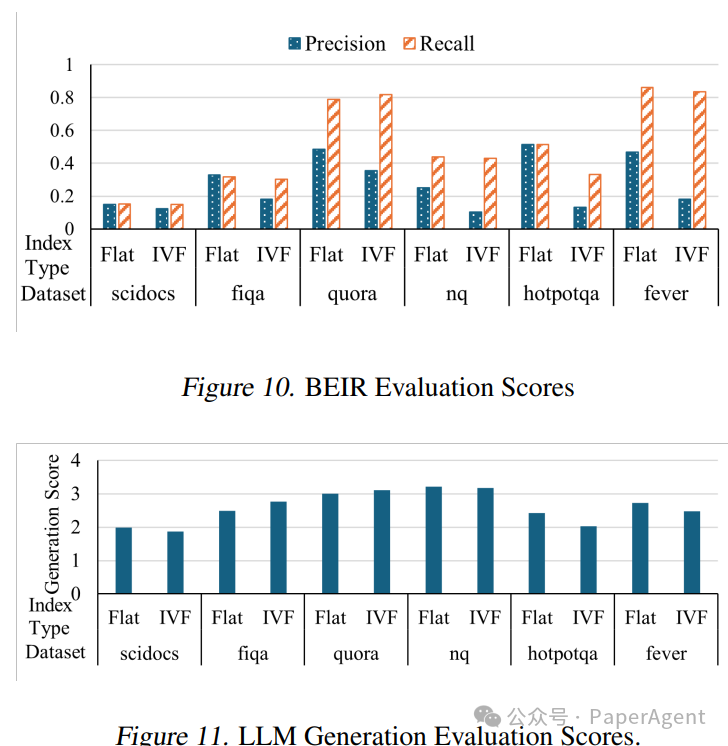

EdgeRAG在时间到第一个标记(TTFT)延迟方面比基线IVF索引平均快1.8倍,对于大型数据集则快3.82倍。同时,EdgeRAG在保持与平面索引基线相似的生成质量的同时(仅有 5% 以内的差异),允许所有评估的数据集适应内存并避免内存抖动.

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?