一、爬虫基础概念回顾

在开始进阶实战之前,我们先来回顾一下爬虫的基础概念。爬虫,顾名思义,就是像蜘蛛一样在网络上爬行的程序。它通过模拟浏览器发送请求,获取网页内容,然后提取出我们需要的数据。

爬虫的基本流程包括:发送请求、获取响应、解析页面、提取数据、存储数据等步骤。在这个过程中,我们需要关注的关键点有:请求头的设置、响应状态码的判断、页面解析方法的选择、数据的清洗和存储等。

二、反爬虫机制与应对策略

随着爬虫技术的广泛应用,网站也开始采取各种反爬虫机制来保护自己的数据。常见的反爬虫机制包括:User-Agent检测、IP限制、验证码验证、动态加载数据等。

针对这些反爬虫机制,我们需要采取相应的应对策略。例如,对于User-Agent检测,我们可以通过设置随机的User-Agent来模拟不同的浏览器;对于IP限制,我们可以使用代理IP来隐藏真实的IP地址;对于验证码验证,我们可以使用OCR技术来识别验证码;对于动态加载数据,我们则需要分析JavaScript代码,找到数据的真实来源。

三、页面解析与数据提取

页面解析和数据提取是爬虫开发中的关键环节。对于简单的静态页面,我们可以使用正则表达式或XPath等技术进行解析。但是,对于复杂的动态页面或AJAX加载的页面,这些方法可能就不再适用。

在这种情况下,我们需要借助浏览器的自动化工具,如Selenium或Puppeteer,来模拟浏览器的行为,获取动态加载的数据。同时,我们还可以使用BeautifulSoup等库来辅助解析页面结构,提取我们需要的数据。

代码示例:使用Selenium获取动态加载数据

下面是一个使用Selenium获取动态加载数据的简单示例:

from selenium import webdriver

from selenium.webdriver.common.by import By

# 创建Chrome浏览器驱动对象

driver = webdriver.Chrome()

# 打开目标网页

driver.get('https://example.com')

# 等待页面加载完成

driver.implicitly_wait(10)

# 定位到需要的数据元素

elements = driver.find_elements(By.CSS_SELECTOR, 'your-selector')

# 提取数据并处理

data = []

for element in elements:

# 提取单个元素的数据

item_data = element.text

data.append(item_data)

# 关闭浏览器驱动

driver.quit()

# 打印提取到的数据

print(data)

在上面的示例中,我们首先创建了一个Chrome浏览器的驱动对象,然后打开了目标网页。接着,我们使用implicitly_wait方法等待页面加载完成。最后,我们通过CSS选择器定位到了需要的数据元素,并提取了其中的文本数据。

这只是一个简单的示例,实际开发中可能还需要处理更复杂的页面结构和数据格式。但是,通过掌握基本的页面解析和数据提取技术,并结合具体的业务需求进行分析和调试,我们就能够逐步攻克这些难题。

四、动态加载数据与AJAX请求分析

在现代网页中,很多数据都是通过AJAX异步加载的,这意味着数据并不是在页面初次加载时就全部呈现在HTML中,而是在用户与页面交互(如滚动、点击)时,通过JavaScript动态请求并插入到页面中。因此,要获取这些数据,我们需要分析AJAX请求,并模拟这些请求以获取数据。

- 分析AJAX请求

首先,我们需要使用浏览器的开发者工具(通常按F12打开)来分析AJAX请求。在Network选项卡中,我们可以观察到页面加载过程中发起的所有请求,包括AJAX请求。通过筛选和检查这些请求,我们可以找到数据的真实来源。

- 模拟AJAX请求

一旦我们找到了数据的AJAX请求,我们就可以使用Python的requests库来模拟这些请求。通常,我们需要设置正确的请求头(包括User-Agent、Cookie等),以及可能的请求体或参数。

代码示例:模拟AJAX请求获取数据

import requests

import json

# 设置请求头

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Cookie': 'your\_cookie\_here', # 替换为你的Cookie

# 其他必要的请求头...

}

# 发起AJAX请求

url = 'https://example.com/ajax\_endpoint' # 替换为真实的AJAX请求URL

response = requests.get(url, headers=headers)

# 检查响应状态码

if response.status_code == 200:

# 解析响应内容,通常为JSON格式

data = response.json()

# 处理数据...

else:

print(f"请求失败,状态码:{response.status\_code}")

在上面的示例中,我们首先设置了请求头,包括User-Agent和Cookie。然后,我们使用requests.get方法发起GET请求(如果是POST请求则使用requests.post)。最后,我们检查响应状态码,如果状态码为200,则解析响应内容为JSON格式,并处理数据。

五、处理登录与会话

很多网站的数据需要用户登录后才能访问。在这种情况下,我们需要处理登录与会话。通常,登录过程涉及发送包含用户名和密码的请求,服务器验证成功后返回一个会话标识(如Cookie或Token),后续请求需要携带这个会话标识以维持登录状态。

- 登录过程模拟

首先,我们需要找到登录页面的URL和请求参数。通常,登录请求是一个POST请求,包含用户名、密码和其他可能的参数。我们可以使用requests.post方法发送登录请求,并获取响应中的会话标识。

- 维持会话状态

一旦我们获取了会话标识,我们就需要在后续的请求中携带它。对于Cookie,我们可以将其添加到请求头中;对于Token,我们可能需要将其添加到请求体或请求头的特定字段中。

代码示例:处理登录与会话

import requests

# 登录请求参数

login_data = {

'username': 'your\_username',

'password': 'your\_password',

# 其他可能的参数...

}

# 发送登录请求

login_url = 'https://example.com/login' # 替换为真实的登录URL

response = requests.post(login_url, data=login_data)

# 检查登录是否成功,并获取Cookie

if response.status_code == 200:

# 假设登录成功后服务器会返回包含Cookie的响应头

cookie = response.headers.get('Set-Cookie')

# 在后续请求中携带Cookie

headers = {

'Cookie': cookie,

# 其他必要的请求头...

}

# 使用携带Cookie的请求头获取数据...

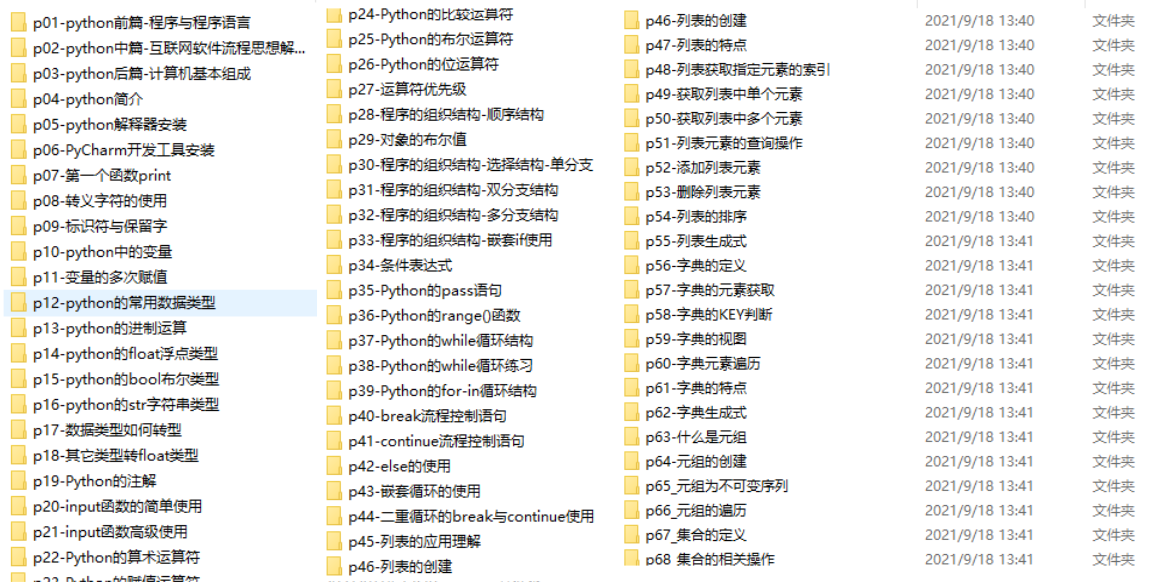

现在能在网上找到很多很多的学习资源,有免费的也有收费的,当我拿到1套比较全的学习资源之前,我并没着急去看第1节,我而是去审视这套资源是否值得学习,有时候也会去问一些学长的意见,如果可以之后,我会对这套学习资源做1个学习计划,我的学习计划主要包括规划图和学习进度表。

分享给大家这份我薅到的免费视频资料,质量还不错,大家可以跟着学习

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里无偿获取](https://bbs.csdn.net/topics/618317507)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

2449

2449

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?