-

如何简单爬虫微信公众号

-

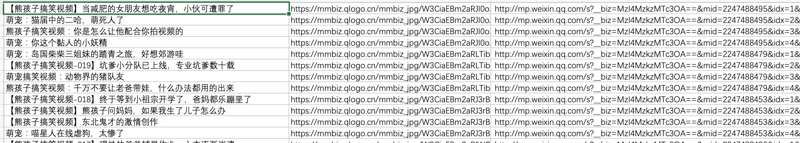

获取信息:标题、摘要、封面、文章地址

-

自动批量下载公众号内的视频

操作步骤:

1、先自己申请一个公众号

2、登录自己的账号,新建文章图文,点击超链接

代码

import re

import requests

import jsonpath

import json

headers = {

“User-Agent”: “Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_3) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/67.0.3396.99 Safari/537.36”,

“Host”: “mp.weixin.qq.com”,

“Referer”: “https://mp.weixin.qq.com/cgi-bin/appmsg?t=media/appmsg_edit&action=edit&type=10&isMul=1&isNew=1&lang=zh_CN&token=1862390040”,

“Cookie”: “自己获取信息时的cookie”

}

def getInfo():

for i in range(80):

token random 需要要自己的 begin:参数传入

url = “https://mp.weixin.qq.com/cgi-bin/appmsg?token=1904193044&lang=zh_CN&f=json&ajax=1&random=0.9468236563826882&action=list_ex&begin={}&count=5&query=&fakeid=MzI4MzkzMTc3OA%3D%3D&type=9”.format(str(i * 5))

response = requests.get(url, headers = headers)

jsonRes = response.json()

titleList = jsonpath.jsonpath(jsonRes, “$…title”)

coverList = jsonpath.jsonpath(jsonRes, “$…cover”)

urlList = jsonpath.jsonpath(jsonRes, “$…link”)

遍历 构造可存储字符串

for index in range(len(titleList)):

title = titleList[index]

cover = coverList[index]

url = urlList[index]

scvStr = “%s,%s, %s,\n” % (title, cover, url)

with open(“info.csv”, “a+”, encoding=“gbk”, newline=‘’) as f:

f.write(scvStr)

获取结果(成功):

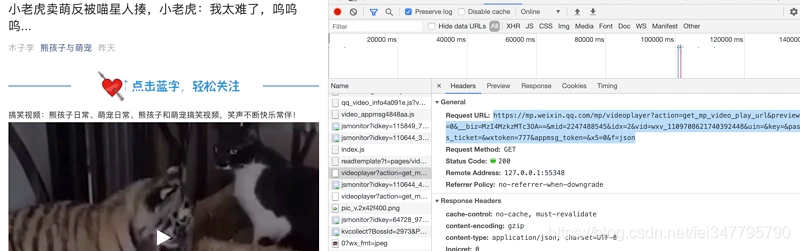

通过对单篇视频文章分析,我找到了这个链接:

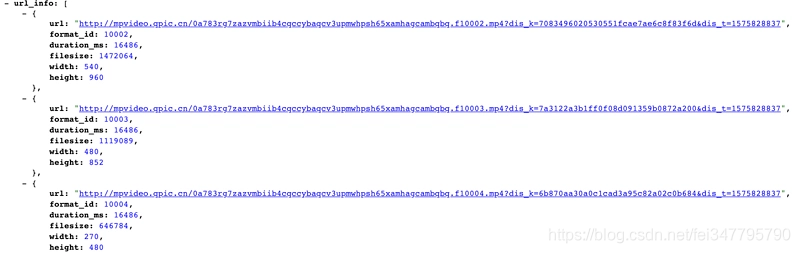

通过网页打开发现,是视频的网页下载链接:

哎,好像有点意思了,找到了视频的网页纯下载链接,那就开始吧。

发现链接里的有一个关键参数vid 不知道哪来的?

和获取到的其他信息也没有关系,那就只能硬来了。

通过对单文章的url请求信息里发现了这个参数,然后进行获取。

response = requests.get(url_wxv, headers=headers)

我用的是正则,也可以使用xpath

jsonRes = response.text # 匹配:wxv_1105179750743556096

dirRe = r"wxv_.{19}"

result = re.search(dirRe, jsonRes)

感谢每一个认真阅读我文章的人,看着粉丝一路的上涨和关注,礼尚往来总是要有的:

① 2000多本Python电子书(主流和经典的书籍应该都有了)

② Python标准库资料(最全中文版)

③ 项目源码(四五十个有趣且经典的练手项目及源码)

④ Python基础入门、爬虫、web开发、大数据分析方面的视频(适合小白学习)

⑤ Python学习路线图(告别不入流的学习)

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

7987

7987

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?