现在我就将带领大家深入了解Stable Diffusion的使用技巧和操作流程。

今天的内容包括:出图的基本操作、模型的下载使用说明。

一、出图的基本操作

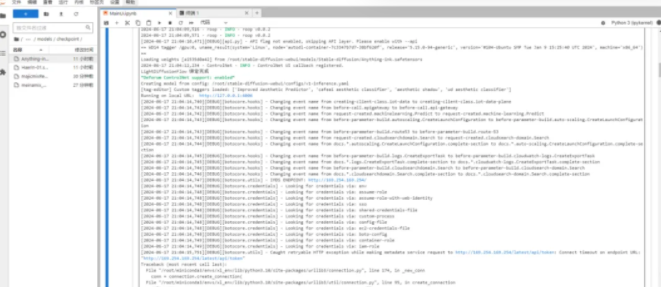

在出图之前,我们先来了解一下SD操作界面常用的一些功能

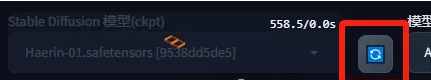

1、模型选择 :选择合适的大模型

2、文生图 :通过输入提示词,让AI生成图片

3、图生图 :在已经输入文字指令的基础上,通过一张参考图片,让AI根据提示词生成类似的效果。

4、附加功能

:提高生成图片的分辨率

5、提示词 :根据提示词在图片中输出对应的元素

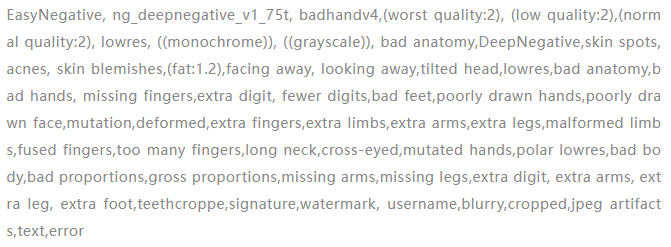

6、反向词 :根据反向词在图片中不出现对应的元素

7、采样方法 :AI画图不同的算法,日常使用中,以下截图中的都可以进行选择

8、采样迭代步数:AI画图时,会有一系列的加噪和去噪的过程。迭代步数越多,图像越清晰。超过20之后幅度减小,耗时也更长。(电脑配置好一点的可以设置在25-30之间,配置稍微低一点的,设置在20-25之间)

9、高清修复:在较低宽高的图片生成后,进一步优化画质。

10、Refiner:风格重绘

11、宽高:设定图片分辨率

12、生成批次和每批数量:生成批次为每批次生成的图片张数,每次数量为生成多少批次。比如生成批次为3,每批数量为4,那么就会一共生成12张图片

13、提示词相关性:数值越高,AI生成的图片越靠近提示词。一般选用7-12较为合适。

14、随机种子:骰子表示随机生成图片,刷新箭头是依据上一张生成的图片继续创作。

出图步骤

①选择模型

目前模型的种类大致分为三种:写真系、二次元、2.5D(类似3D动漫效果)

获取模型的方法:

1)科学上网下载:https://civitai.com

2)国内下载地址:https://www.liblib.art (每天赠送300点数)

下载完模型之后放入之前介绍的models文件夹里的Stable-diffusion文件夹就可以了。

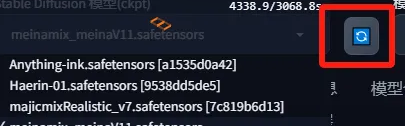

然后回到操作界面刷新就可以选择到了

②写提示词

1)提示词

提示词与Midjourney中的类似,想了解的朋友可以看看之前Midjourney有关出图提示词的内容。(目前SD只识别英文)。

2)反向词

想要图片效果更好的话,应该要加上反向词,也就是不希望图片中出现的东西。(有时候人物图片会出现多手多脚的情况)

反向词一般情况下都是通用的,下面是整理好的,复制进去就可以了。

③参数设置

根据常用功能的介绍进行配置就可以了。

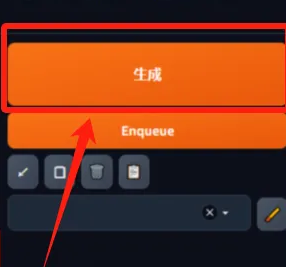

以上步骤配置完之后就可以生成图片了。

我们来给个简单的提示词,看看效果吧。

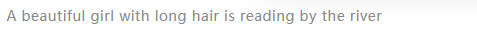

提示词:一个漂亮的长发姑娘在河边看书

写真效果

二次元效果

二、模型的下载使用说明

1、模型下载:

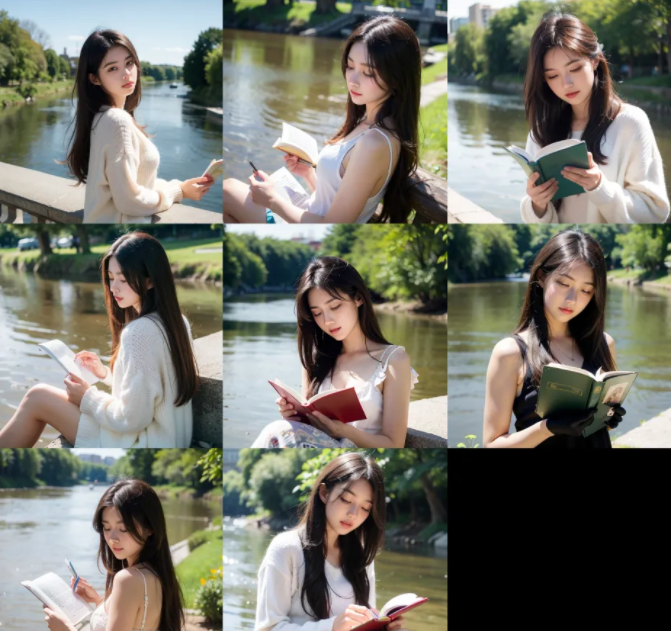

作者是在https://civitai.com进行的模型下载

在下载的时候有个小技巧,如下步骤(使用的是chrome浏览器)

此方法适用于本地或云端部署。

①选择需要下载的模型点击Download按钮

②在chrome的下载界面,右键点击下载的文件,复制下载链接,然后去迅雷里面下载(网页下面很慢,迅雷下载速度起飞)

2、模型上传:

本地部署的SD有关模型的上传就不多说了,直接放在本地文件夹就行。

使用云端产品部署的话,模型的存放磁盘大小有一定的限制,如果超过了需要另外收费。

今天再给大家介绍下云端部署的时候,模型存放网盘的上传方式。

在上篇文章中介绍的4款云端部署的产品当中,经过亲测之后,比较推荐的是AutoDL产品,优势:

1、价格按照分钟计算,2、支持阿里云盘,模型上传方便。

其他产品问题:揽睿星舟在使用上1分钟就算1小时收费,性价比较低;其他2款产品只支持百度网盘,如果没有网盘会员下载模型及其慢。

操作步骤:

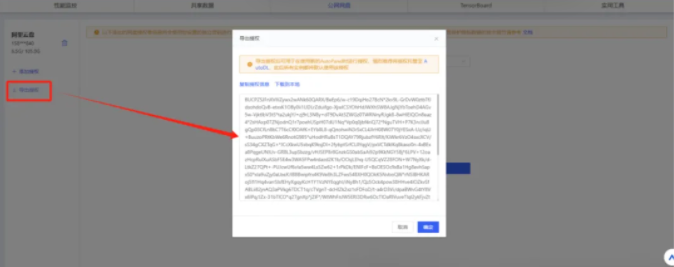

第一步:绑定网盘

在实例列表中点击AutoPanel

选择公共网盘,点击添加授权,进行阿里云盘授权

接着点击导出授权,将授权信息复制出来

最后点击菜单栏中的设置,选择公共网盘,将授权信息复制进去确认即可。

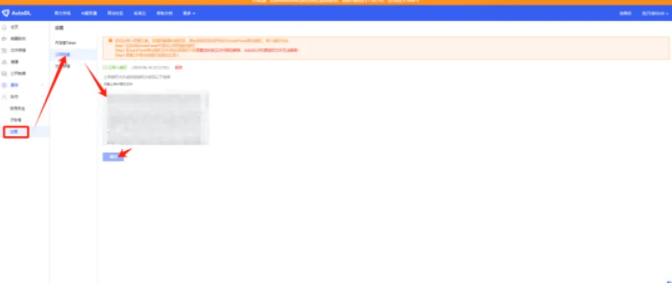

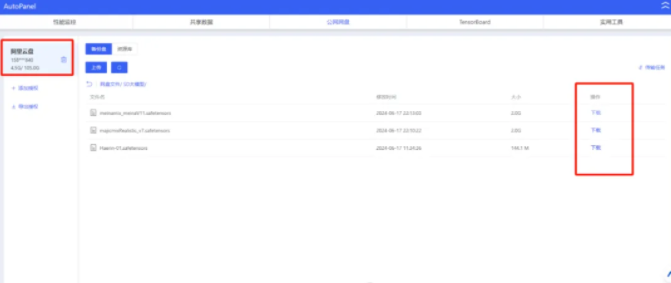

第二步:下载使用模型

在绑定完成之后,就可以下载阿里云盘中的模型了

点击下载,按照提示确认下载

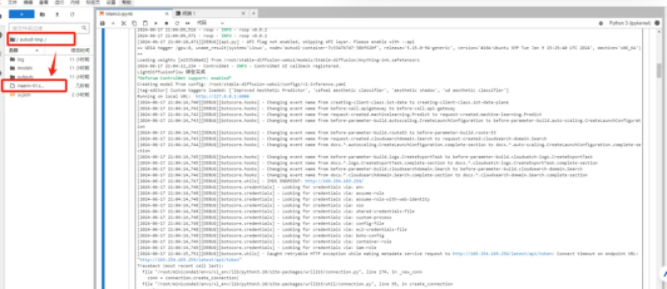

下载完成之后,在autodl-tmp目录下就可以看到模型了

接着将模型剪切放入autodl-tmp/models/checkpoint目录下

最后去SD操作界面刷新一下,就可以选择模型啦

如果大家因为没有梯子或其他原因下载不了模型的,这里我将安装包和模型都打包好了直接分享出来

提示词

Stable Diffusion 最强提示词手册

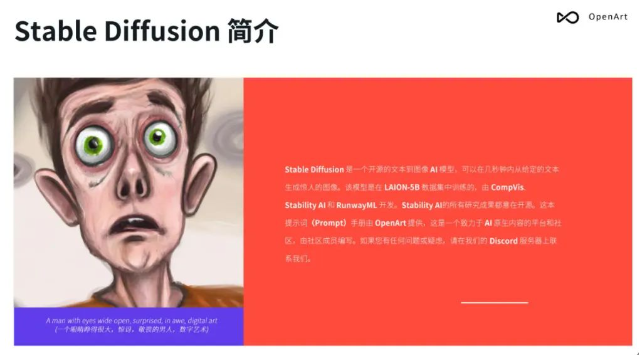

- Stable Diffusion介绍

- OpenArt介绍

- 提示词(Prompt) 工程介绍

- …

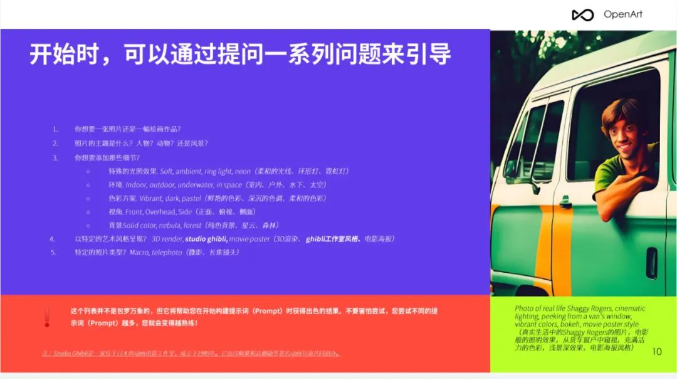

第一章、提示词格式

- 提问引导

- 示例

- 单词的顺序

- …

有需要的朋友,可以点击下方卡片免费领取!

第二章、修饰词(Modifiers)

- Photography/摄影

- Art Mediums/艺术媒介

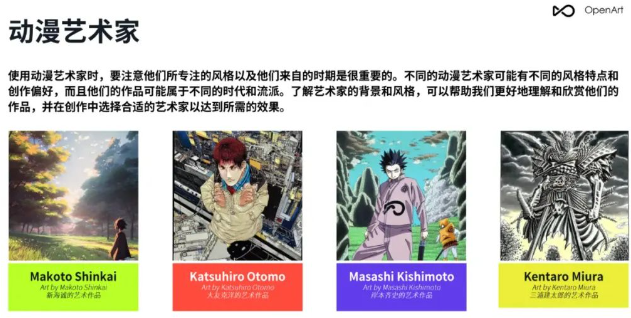

- Artists/艺术家

- Illustration/插图

- Emotions/情感

- Aesthetics/美学

- …

第三章、 Magic words(咒语)

- Highly detailed/高细节

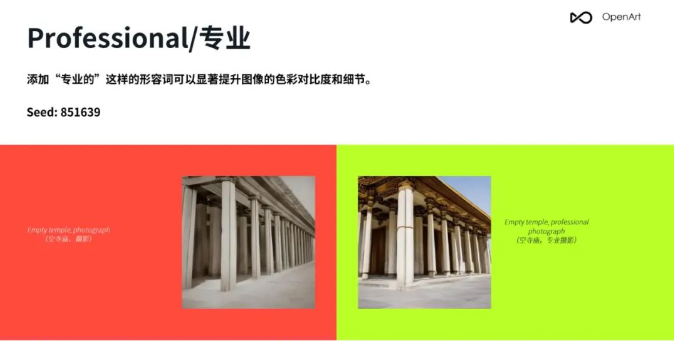

- Professional/专业

- Vivid Colors/鲜艳的颜色

- Bokeh/背景虚化

- Sketch vs Painting/素描 vs 绘画

- …

第四章、Stable Diffusion参数

- Resolution/分辨率

- CFC/提词相关性

- Step count/步数

- Seed/种子

- Sampler/采样

- 反向提示词(Prompt)

第5章 img2img(图生图),in/outpainting(扩展/重绘)

- 将草图转化为专业艺术作品

- 风格转换

- lmg2lmg 变体

- Img2lmg+多个AI问题

- lmg2lmg 低强度变体

- 重绘

- 扩展/裁剪

- …

第6章 重要提示

- 词语的顺序和词语本身一样重要

- 不要忘记常规工具

- 反向提示词(Prompt)

- …

第7章 OpenArt展示

- 提示词 (Prompt)

- 案例展示

- …

篇幅有限,这里就不一一展示了,有需要的朋友可以点击下方的卡片进行领取!

502

502

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?