前言

【导读】你是否曾被复杂的AI工具界面所困扰,渴望有一个直观、易用的平台来释放你的创造力?今天,我们为你带来了 ComfyUI 的全面解析,帮助你从零开始构建适合自己的工作流。无论你是AI新手还是资深玩家,ComfyUI 都将为你提供强大的支持。

一,Stable Diffusion 基础

所有的AI设计工具,模型和插件,都已经整理好了,👇获取~

为了更好的理解和使用 ComfyUI, 在探索 ComfyUI 之前,让我们先了解 Stable Diffusion 的核心原理。

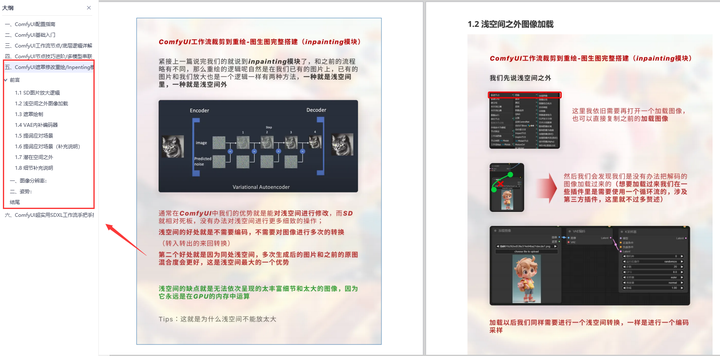

Stable Diffusion 是一种基于扩散模型的生成式AI模型,在训练过程中,模型接收带噪声的图像作为输入,并被训练以预测去噪后的图像。通过重复这个去噪过程,模型最终学会从随机噪声生成高质量图像。

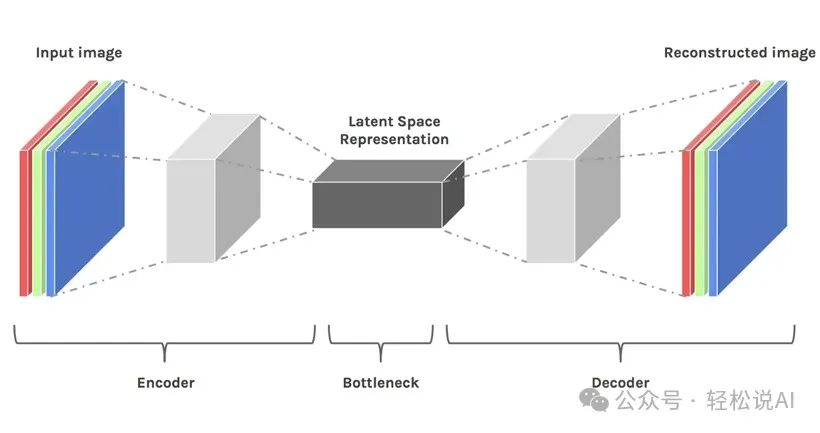

Stable Diffusion 使用了一种称为潜在扩散模型(latent diffusion model)的变体,它在较低维度的潜在空间中执行去噪,从而提高了计算效率和生成质量。

Stable Diffusion 的另一个关键创新是将文本编码器(如CLIP)与扩散模型相结合,使其能够根据文本提示生成相关图像。文本编码器将提示映射到与潜在扩散模型兼容的潜在空间,指导图像生成过程朝着与提示语义一致的方向进行。

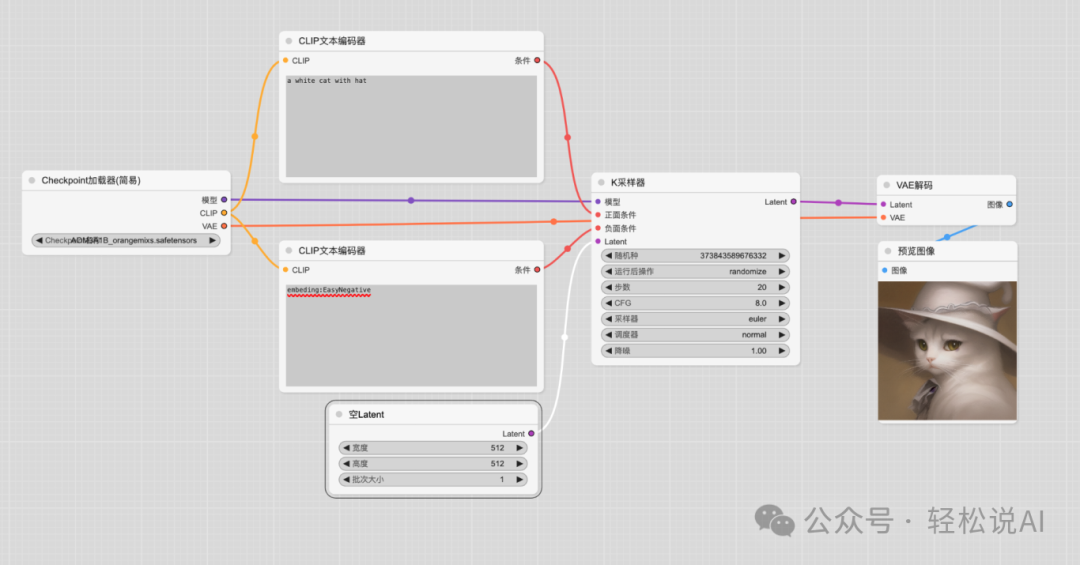

了解了 Stable Diffusion 的基本原理后,那么就很容易的理解到文生图的逻辑就是:把一段文本通过文本编码器转换为向量值,这个向量值可以捕捉文本的语义信息并与图像空间中的向量值对齐,然后生成一张随机噪声图像逐渐降噪为目标图像。

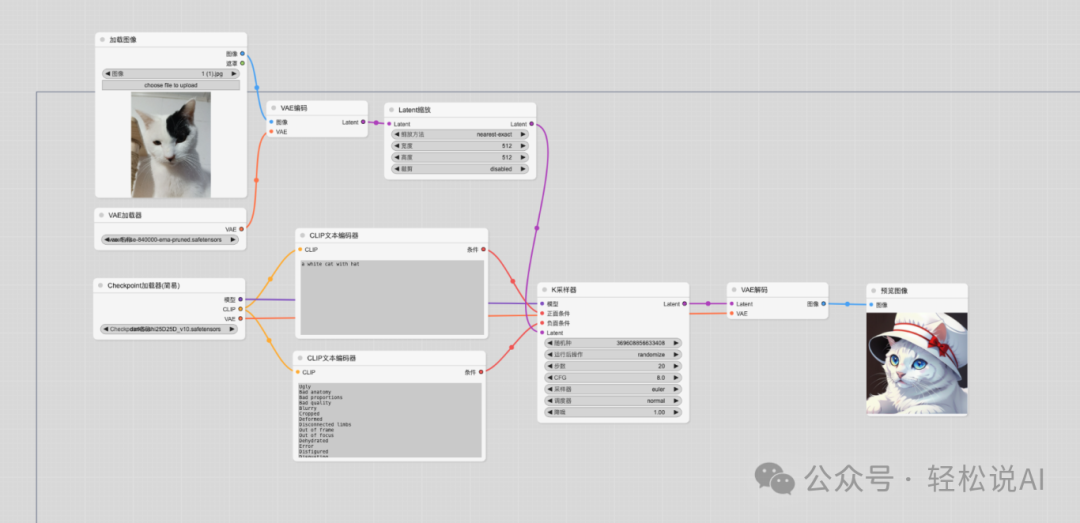

图生图也是类似的原理,把图片转换为向量值,进行扩散与反向扩散过程。图生视频,就是连续产生N多张图生图,然后把这些图片拼接为视频。

二、ComfyUI 基础及特点

ComfyUI 作为一款 Stable Diffusion 客户端工具,其基于节点的可视化操作能够让我们清楚的看到 Stable Diffusion 在生成内容时的每一个步骤,方便我们更好的理解 stable diffusion 的本质;并且其支持添加新的功能节点和处理模块,这进一步增强了其可扩展性和高级操作;同时可以将工作流保存为 JSON 文件,方便地进行分享。

三、ComfyUI 核心节点介绍

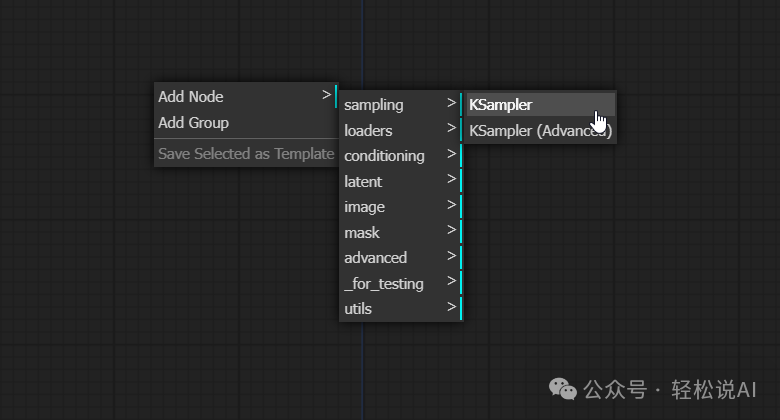

- 采样器(KSampler)

功能概述:采样器在扩散模型的去噪过程中发挥着关键作用,负责生成下一个时间步的去噪图像。

潜在空间与像素空间:潜在空间是在GPU内存中进行的运算,通过对像素空间进行多重多维度压缩,实现高效的图形运算。

多样化的采样器选择:ComfyUI提供了多种采样器,如euler_ancestral、dpmpp2m、dpmppsde等,以满足不同用户的需求。

- Checkpoints加载器

加载 SD 模型:加载预训练的stable diffusion模型checkpoints,包括.ckpt, .safetensors等

主流大模型推荐:

-

SDXL 1.0 (Turbo):StabilityAI 最新开源的图像生成大模型,参数总量达到百亿级别,无需太多Lora,提示词理解能力提升,多种风格

-

AbyssOrangeMix3 ( aka 深渊橘, AOM3):融合模型,动漫二次元模型,脱胎于 Anything 大模型,人物与场景的展现较为全面,搭配专用 VAE orangemix.vae.pt

-

Counterfeit:风格:3D写实,细节丰富,光影效果出色,特点:旨在生成高度逼真的图像,特别擅长人物肖像、服装材质和复杂场景,适合电影概念设计

- VAE(变分自编码器)

滤镜、微调与色彩饱和度提升:VAE为您的作品增添独特滤镜、微调效果和更高的色彩饱和度,让您的AI艺术作品更具艺术感。

- AnimateDiff

视频创作的得力助手:AnimateDiff 是一个基于动画视频训练的扩散模型,让您的AI艺术作品更加流畅、自然。

- ControlNet

引导扩散过程,提升可控性与精度:ControlNet通过增加额外控制条件,引导Stable Diffusion 的扩散过程,让您的艺术创作更加精准、可控。

- LCM(潜在一致性模型)

高效生成高分辨率图像:LCM通过创新性的方法,实现了高效生成高分辨率图像的能力,让您的AI艺术创作更加高效、实时。

四、工作流构建与分享

下面让我们来一步步的构建出一个视频转绘工作流,首先,我们可以先构建一个最基本的文生图工作流。

然后基于这个工作流,我们增加图像加载与处理的节点,构建出图生图工作流;

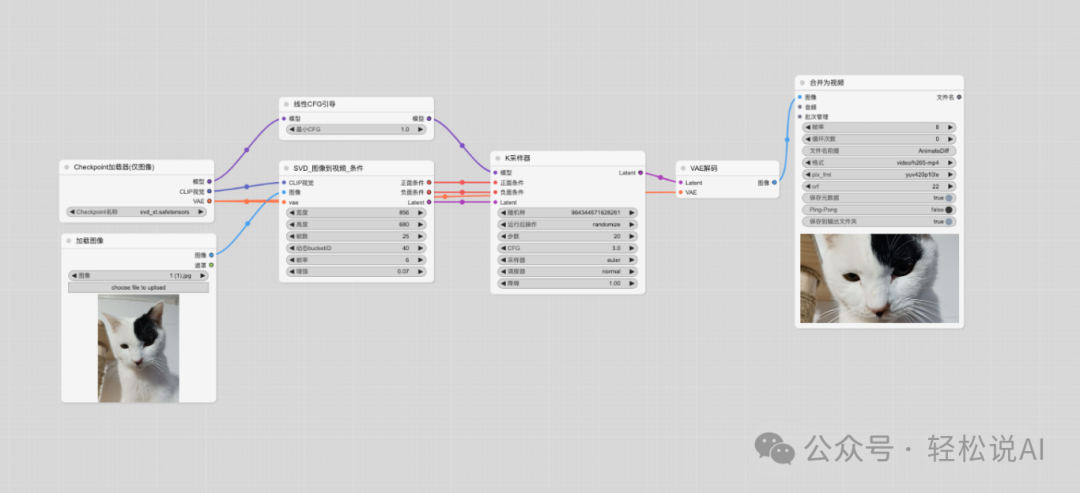

接着,我们使用 SVD 模型,将图像生成视频;

如果猫看腻了,那我们换个清新的图生成视频;

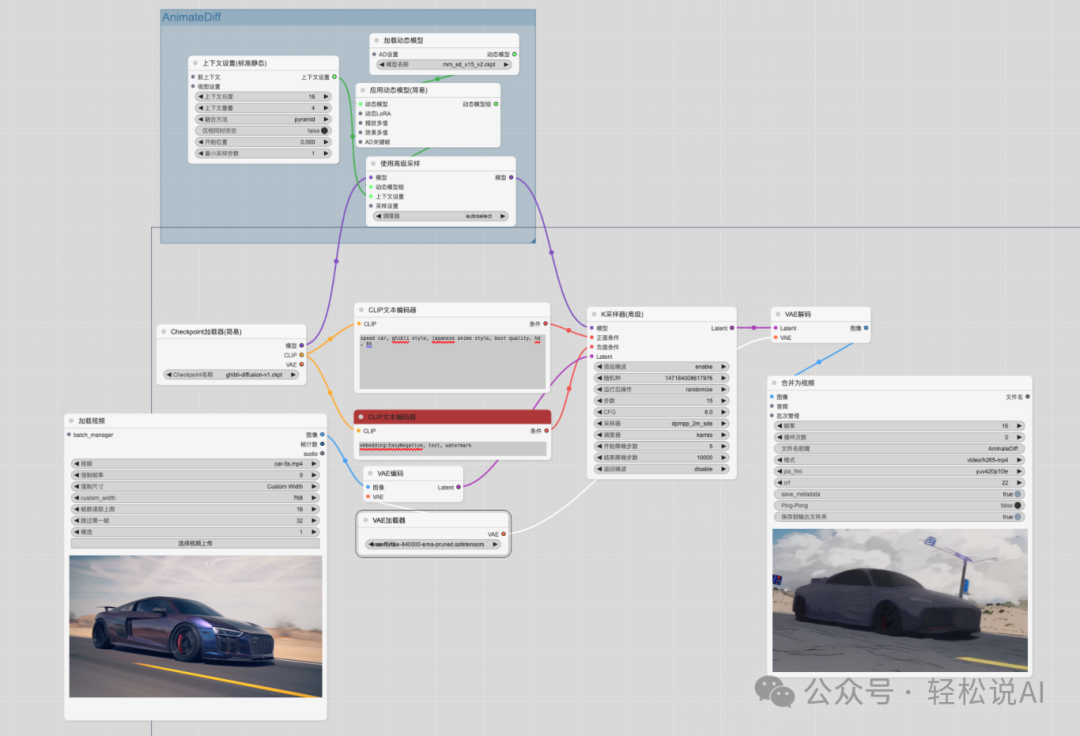

最后,我们来体验下视频转绘的风采,将一段视频转换为另一个风格;

游戏风视频转绘为动漫风

猫咪现实风转绘为卡通风

五、一些资源推荐

为了帮助你更好地使用ComfyUI,我们为你推荐了一些优质资源,包括教程、案例分享和社区论坛等。在这里,你可以找到其他用户的经验分享,也可以与其他创作者交流心得。

-

ComfyUI 官方文档: https://blenderneko.github.io/ComfyUI-docs/

-

ComfyUI Examples:https://comfyanonymous.github.io/ComfyUI_examples/

-

awesome-comfyui:https://github.com/lucianosb/awesome-comfyui

-

ComfyUI 工作流分享 :

https://comfyworkflows.com/

https://openart.ai/workflows/dev

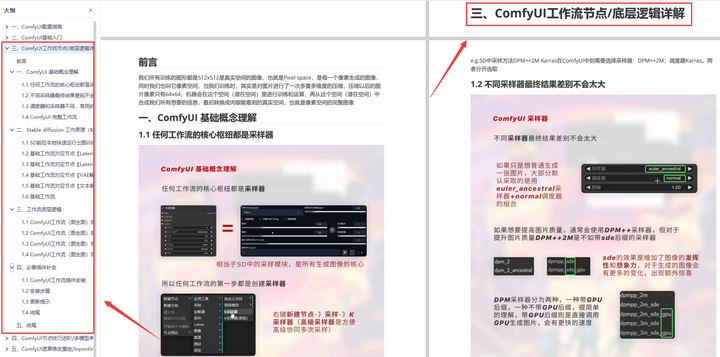

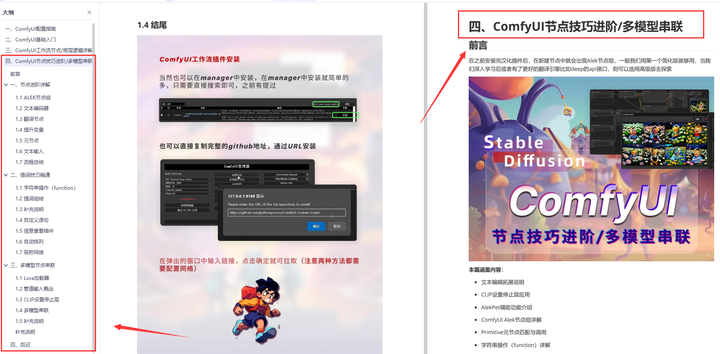

为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

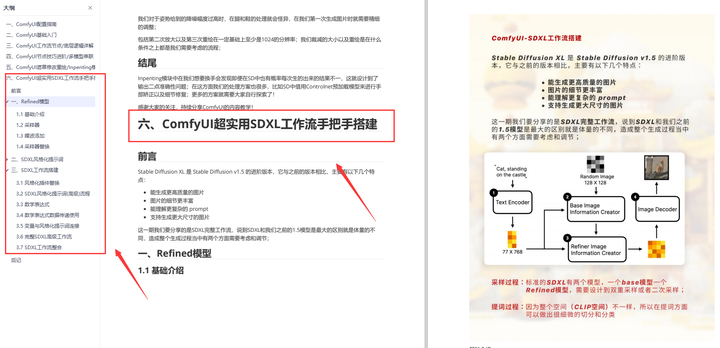

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

689

689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?