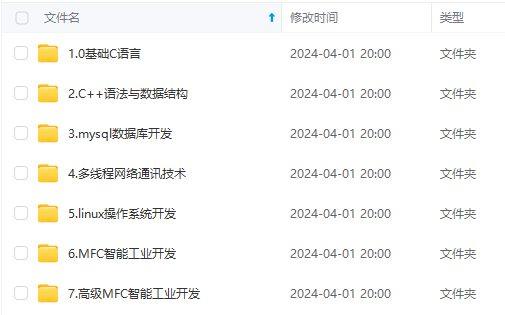

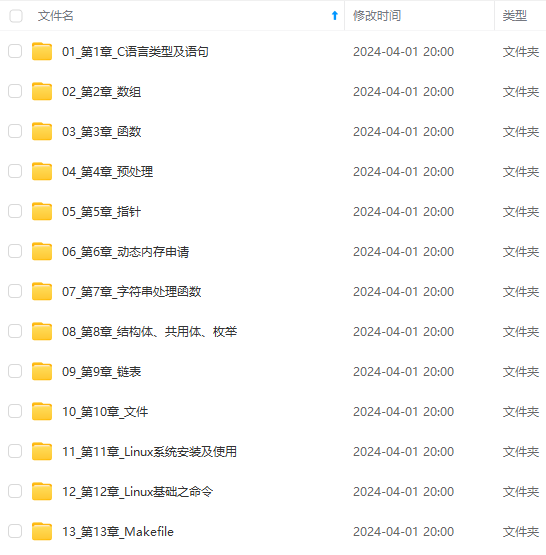

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上C C++开发知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

y = y.scatter(dim,index,src)

#则:

y [ index[i][j] ] [j] = src[i][j] #if dim==0

y[i] [ index[i][j] ] = src[i][j] #if dim==1

我们举一个实际的例子:

import torch

x = torch.randn(2,4)

print(x)

y = torch.zeros(3,4)

y = y.scatter_(0,torch.LongTensor([[2,1,2,2],[0,2,1,1]]),x)

print(y)

#结果为:

tensor([[-0.9669, -0.4518, 1.7987, 0.1546],

[-0.1122, -0.7998, 0.6075, 1.0192]])

tensor([[-0.1122, 0.0000, 0.0000, 0.0000],

[ 0.0000, -0.4518, 0.6075, 1.0192],

[-0.9669, -0.7998, 1.7987, 0.1546]])

'''

scatter后:

y[ index[0][0] ] [0] = src[0][0] -> y[2][0]=-0.9669

y[ index[1][3] ] [3] = src[1][3] -> y[1][3]=1.10192

'''

#如果src为标量,则代表着将对应位置的数值改为src这个标量

那么这个函数有什么作用呢?其实可以利用这个功能将pytorch 中mini batch中的返回的label(特指[ 1,0,4,9 ],即size为[4]这样的label)转为one-hot类型的label,举例子如下:

import torch

mini_batch = 4

out_planes = 6

out_put = torch.rand(mini_batch, out_planes)

softmax = torch.nn.Softmax(dim=1)

out_put = softmax(out_put)

print(out_put)

label = torch.tensor([1,3,3,5])

one_hot_label = torch.zeros(mini_batch, out_planes).scatter_(1,label.unsqueeze(1),1)

print(one_hot_label)

上述的这个例子假设是一个分类问题,我设置out_planes=6,是假设总共有6类,mini_batch是我们送入的网络的每个mini_batch的样本数量,这里我们不设置网络,直接假设网络的输出为一个随机的张量 ,通常我们要对这个输出进行softmax归一化,此时就代表着其属于每个类别的概率了。说到这里都不是重点,就是为了方便理解如何使用scatter,将size为[mini_batch]的张量,转为size为[mini_batch, out_palnes]的张量,并且这个生成的张量的每个行向量都是one-hot类型的了。通过看下面的输出结果就完全能够理解了。

tensor([[0.1202, 0.2120, 0.1252, 0.1127, 0.2314, 0.1985],

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化的资料的朋友,可以添加戳这里获取](https://bbs.csdn.net/topics/618668825)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

6069

6069

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?