现在AI领域有大量的实验人员在探索最高效的思考方式,以应用在大语言模型上,好让模型的能力越来越强、算力需求越来越少。

既然AI在模仿人类思考,甚至把思考能力不断推向极限,那么人为什么不能学一学AI的思考能力?

今天我们再来看看,如何把大语言模型的训练方法,用在自己身上,把自身学习的方式从底层改写一遍!

01 大语言模型的训练方法与启示

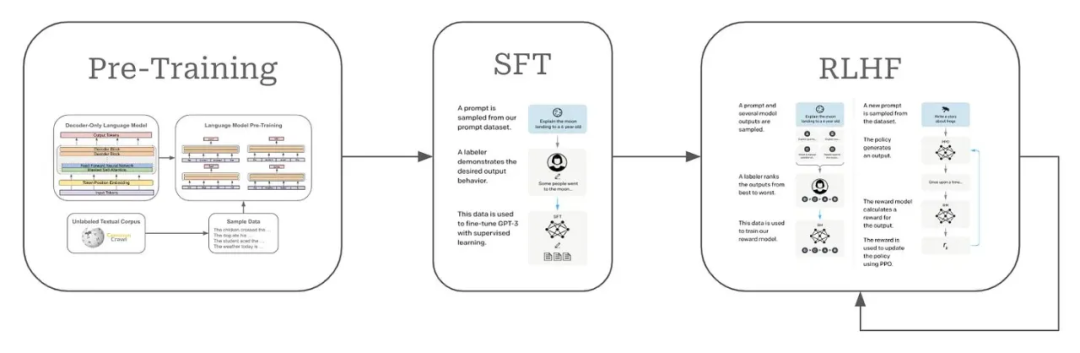

当下任何一个大语言模型(LLM)的训练,都可以分成三大核心阶段:预训练(Pre-training)、监督微调(SFT)和基于人类反馈的强化学习(RLHF)。

1. 预训练(Pre-training):广泛涉猎,建立对世界的基本认知

在预训练阶段,研究人员会搜集海量的无标注文本数据,作为模型的“学习素材”。这些文本覆盖面极广,可以是新闻报道、百科词条、小说对话、科研论文,也可以是各种论坛帖子、社交媒体内容等等。只要涉及文字的地方,都可能成为AI的预训练数据来源。

而预训练的本质任务就是:预测下一个词。

举个例子,当模型读到“今天天气真好,我想去___”时,它需要根据前文猜测填入“公园”或“散步”等更符合语境的词。你可能会觉得“就这么点儿事?”,可实际上,这种预测几乎就能让模型掌握语言的结构、语法以及大量事实性内容。因为在海量的文本阅读中,模型逐渐学会了:怎样的词序和搭配更常见?哪个概念跟哪个概念容易一起出现?不同主题的文本里常见的词汇是什么?等等。

但预训练有一个问题,虽然模型经过了训练,但不知道如何将所学应用到具体任务中。它可能不知道回答问题时的常见格式、该使用怎样的社交礼仪、又或如何结合上下文选择更好的表达。

你看这像不像上过高中的学生?读过非常多的书,涉猎很多学科,但未必知道如何解决真实世界的复杂问题。

博览群书,却缺乏“做事能力”。

这就是预训练。

2. 监督微调(SFT):*知道要做什么*,对齐真实社会

如果只知道读书学习,那就容易成为书呆子。

所以,每个父母都会对孩子言传身教,告诉他们在不同场景应该说什么话、有什么样的行为举止等等。这就是让孩子懂的真实社会,相当于人类学习中的社会化过程,我们学习社会规范、礼仪,掌握沟通技巧,培养问题解决能力,形成价值观。

这一步就对应着监督微调(SFT),作用是让大模型懂得人类指令意图,知道要做什么。

研究人员会准备大量“指令-回答”示例,教模型如何回答人类提出的问题。

模型在SFT中逐渐学会模仿示范:写文章要条理清晰、解题时先列步骤、写诗词要注意韵律等等。

我们人类也一样,如果只读过很多书(预训练)但从没接受过“老师”或“前辈”亲授具体方法,就会缺乏把知识“落实到位”的能力。SFT阶段可以类比为我们在学校、职场、考证培训或师徒制中学到的标准化流程与方法论。

3. 强化学习(RL):在实践与反馈中迭代,决定了最终“水平上限”

SFT让模型“懂规矩”,但它能否在未知情境中举一反三,关键要靠强化学习(RL)。

以前叫RLHF,随着对齐研究的场景和反馈来源不断扩展,从单纯的人类反馈(RLHF)变为多元化的自动或混合反馈后,人们习惯用更通用的“RL”来概括所有基于强化学习的优化方式。

RL的核心思路叫:边干边学,靠奖惩机制来迭代。

在RL里,模型通过自我尝试和人类或环境反馈相结合,不断修正策略。若答案好,就给奖励;若答案不合意,就给惩罚或负面信号,这么做既能让模型生成更贴近人类价值观的内容,也能使其在复杂场景中学习高水平决策逻辑。

DeepSeek-R1为什么对算力需求少?就是因为淡化了SFT,通过RL找到一些人类示例里从未出现过的“特殊解法”,这种思路也可能使模型在未知问题上更有创意,但由于缺乏人类指令样本的束缚,语言或格式可能显得“怪异”。比如我让DeepSeek写一篇短文,关于“人为什么需要学习”,结果如下:

这段内容真的充满了赛博感,初看惊艳,再看真的没什么价值,拼凑概念的能力是真一流。

网友还总结了DeepSeek写内容最常出现的词语:回望、褶皱、熵增、量子、引力、潮汐、时光、永恒、火种…

当然如果加一些特殊限定词,比如模仿鲁迅、柏拉图的文风,DeepSeek也能模仿地很像。

OpenAI的GPT系列(如GPT-3.5、GPT-4)典型地执行了预训练-SFT-RL三步,且在每一步都投入了巨大资源。它们知识面广、表达规范、对价值观对齐较好,在多种任务上表现强势。但缺点是算力要求高。

4.RL决定了模型能力

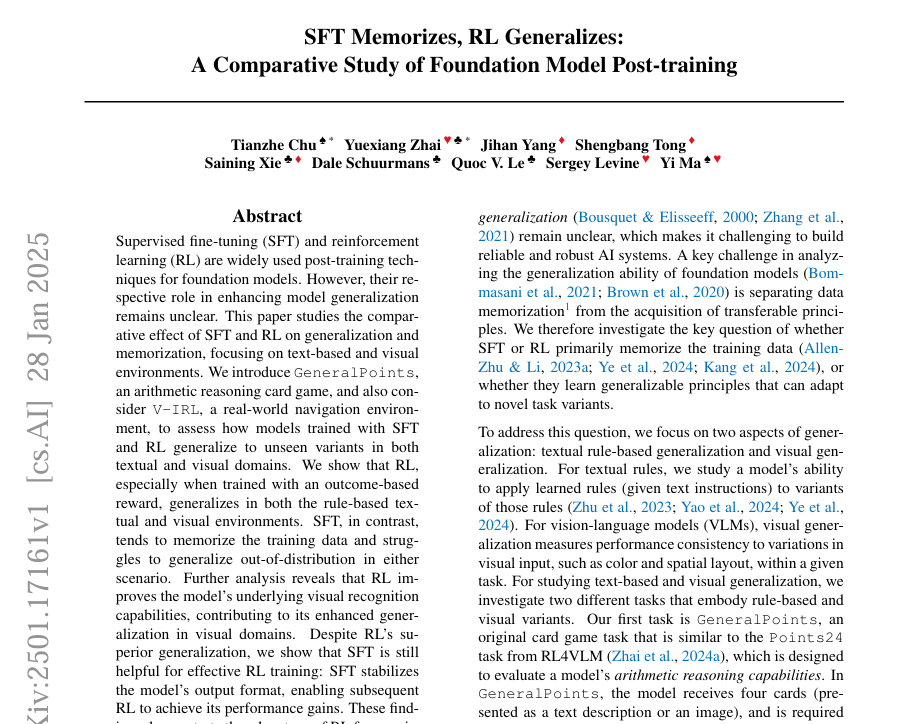

有一篇论文叫《SFT Memorizes, RL Generalizes: AComparative Study of Foundation Model Post-training》[1],论文有一个非常有意思的洞见:少量的SFT(约1K样本)加上大量的RL训练,能够达到最佳效果。

意思就是:

1.SFT主要帮助模型学习遵循指令的基本能力,过度依赖SFT可能导致模型过度拟合特定的回答模式,限制其灵活性。

2.RL能够帮助模型学习更灵活、更多样化的回答策略。在RL过程中,模型能够探索更广泛的回答空间,从而提高其适应性和创造性。

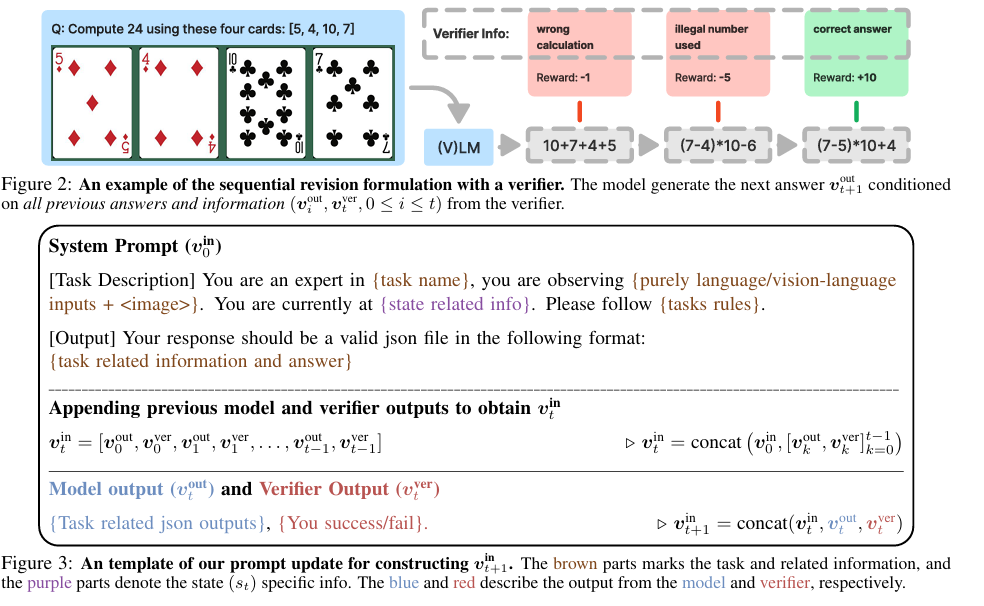

论文中有一个实验,给四张扑克牌,用这四张牌凑成点数24。结果发现:

仅经过SFT训练的模型,对于见过的训练,模型能准确输出,但没见过的训练,模型就容易出错。

而经过SFT+RL训练的模型,不仅能正确处理已见过的输入,还能正确处理未见过的输入。

我看现实还真就是这样。

我们目前的教育培养了太多只经过预训练和SFT的人才,这些人在标准化考试和结构化环境中表现出色,能够快速掌握和应用既定知识,但因为缺少RL,他们往往缺乏创新思维和解决非常规问题的能力,在面对全新挑战时容易不知所措。

另一方面,那些没有经过系统教育,主要依靠RL方式成长的人,比如那些没上过多少学,主要靠自己摸索的人,他们的学习过程往往较慢,起点可能较低,而且成才率低。但是,这些人一旦脱颖而出就可能具有更强大的适应能力、更灵活的思维方式,以及在面对新挑战时更强的创新能力。

亨利·奥利弗在《第二幕:大器晚成者能告诉你关于成功与重塑人生的那些事》一书中讲:

所谓晚熟者(late bloomer),就是那些开花比较晚的人。

他们或许年过半百还没有什么成就,也没做出什么人人称道的事情,甚至根本没人觉得他们能成功,结果他们突然抓住某个机遇,就起飞了。

别人看来这是奇迹,但你知道,这是大器晚成。

奥利弗考察各种研究和真实案例,认为晚熟者在遇到机遇大展身手之前,都有一个“低效的准备期”(inefficient preparation)。

他们并没有为一个特定目标而奋斗,不是一上来就认准了要做什么,否则也不会晚熟。但他们的确是在默默地做些准备,尽管他们可能不知道自己是在做准备。而这种低效反而是个好事儿。因为他们在此期间练就了一身本领,只不过他们尚未觉察;他们还准备好了经验和思维,只待厚积薄发。

这就是人生的第二幕剧。

第一幕剧时,你已经尝遍人生辛酸苦辣,但随着时间过去,机遇到来,你受到了使命的召唤,你要自己拉开第二幕剧——大器晚成者的英雄之旅。

我还想再对比一下现实中的富二代和普通家庭的孩子。

富二代出生在经济宽裕的环境里,从小有条件接受最好的教育(优质数据预训练),家长、老师给他们提供了清晰明确的行为规范与社交礼仪(SFT)。长大后进入社会,他们往往又能从家庭、行业前辈和导师那里获得及时的反馈与纠正(RL),因此在职场竞争中更容易快速达到一定高度。

而普通家庭的孩子由于家庭背景和资源有限,早期无法获得大量精心设计的专业指导(SFT阶段不足),但他们往往更早被迫接触真实社会(更早进入RL阶段)。为了突破局限,这些孩子必须在不断试错和反馈中自主摸索生存与成长的策略。

虽然初期可能会“语言”笨拙或处事欠缺章法,表现不够突出,但通过吃足够多的苦,经过反复试错、自我纠正,他们逐渐在未知环境中找到属于自己的独特解法——这就类似DeepSeek在RL阶段中摸索出来的非典型但有效的策略。

当然富二代可能因为毅力不足,在RL阶段受不了“反复试错”这份苦,不想花费大力气去迭代升级,就可能习惯于在框架明确、目标清晰的情境中执行任务,遇到前所未见的难题或超出以往经验范围时,有时反而表现得过于谨慎。

反观普通出身、缺乏资源支持的人,他们从一开始就被迫在不断的实践试错中进化成长。虽然早期可能经常犯错,也可能走一些弯路,但长此以往,他们培养出了极强的自主适应力、泛化力和创造力——一种即使在资源不足的情况下也能迅速找到“特别策略”的能力。

这种人在社会中会形成“野路子”的优势,他们不一定完全遵循传统规范,可能在外人看来显得“怪异”,但往往更具适应力、创造性和自主进化的潜力。

所以,AI的训练方法真能给我们巨大的启示!

02 AI时代如何学习?

1.大量知识积累:读万卷书、行万里路、阅人无数(对应AI的预训练阶段)

没有经过大量知识训练的头脑容易充满偏见,容易被自己有限的经验所束缚,难以跳出固有思维框架。就像一个人如果从未接触过其他文化,很可能会认为自己的生活方式是唯一正确的。

这样的人还会因为缺乏广泛的见闻,容易被片面或虚假的信息所误导。这就像一个AI模型如果训练数据不足,很容易产生偏差或错误的输出。

[所以,通识有什么用?]

历史学用大量真实案例训练我们解决真实问题的能力。

它让我们看到人类社会中各种关系的复杂性和重复性,当你在现实生活中遇到一个棘手的情况时,你很可能会想起历史上的某个类似事件。

比如,你正面临公司内部的权力斗争,你可能会想到春秋战国时期的各种政治博弈。这不是说你要照搬古人的做法,而是让你意识到这种情况可能的发展方向和潜在后果。读历史能让你在面对复杂局面时保持冷静和洞察力,这是一种无价的能力。

社会学则教会我们以更宏观的视角看待社会现象。

很多人喜欢说"现在的年轻人都怎么怎么样",但社会学会提醒你:这种笼统的说法是否有实证依据?是否考虑了不同社会阶层、地域、教育背景的差异?社会学训练我们避免过于简单化的归因,而是去寻找社会现象背后的结构性因素。

它让我们明白,个人的行为往往受到更大的社会力量的影响,这种认识能帮助我们更客观地看待社会问题,而不是简单地归咎于个人。

经济学的核心在于理解资源如何在社会中分配和使用。

当你听到有人说"政府应该多印钱来解决贫困问题"时,经济学会让你想到通货膨胀的风险。当你看到某个行业突然爆红时,经济学会提醒你考虑供需关系的变化。

经济学思维能帮助你在日常生活中做出更明智的决策,无论是个人投资还是职业选择。它教会我们权衡机会成本,理解激励机制如何影响人的行为,这些都是在复杂世界中生存所必需的技能。

哲学教会我们批判性思维。

哲学训练我们质疑既有的假设,探索事物的本质。当你听到"AI将取代人类工作"这样的说法时,哲学会促使你思考:什么是工作的本质?人类的价值是否仅仅在于完成特定任务?哲学还教会我们处理矛盾和悖论。

在这个充满不确定性的时代,能够在矛盾中寻找平衡,在模糊中找到清晰,在混乱中找到秩序,能接纳多种不同的思维模式,能整合不一样的意见观点,这就是哲学气质。

当然,现在大学里学这些专业容易找不到工作。

我觉得一个办法是,先学理科找工作,再辅以通识,让自己后劲十足。

而且,纯理工科知识(公式、算法、工程原理等)往往具有可编程、可量化的特征,这些内容对 AI 来说相对容易学习、处理和复现;对人类来说,却需要多年训练才能熟练掌握。

但许多“软技能”或“模糊技能”(如领导力、情商、创造力、审美、复杂交涉等)具有不可编程、难以描述的特征,AI 目前无法在深度或质量上完全替代人类。恰恰这些才是现代社会中人类更应着力发展的关键能力,也正是“实践”阶段能够帮助我们不断磨炼之处。

2.专业技能培养(对应AI的监督微调阶段)

**培养专业技能、学别人的套路,可以加快你的进步和积累,**比如有一个好的导师能帮你少走弯路,指出你的盲点,给你提供行业内部的洞见。一个好的家庭教育则能从小培养你的学习能力和思维方式,为你未来的发展奠定基础。

但要注意,过度依赖专业能力也有风险。就像AI模型如果只依赖固定套路,可能会过度拟合,失去灵活性。人类也是如此,如果只按照既定的路径和方法学习,可能会错过创新的机会。

在过去,专业化是成功的关键。社会分工越细,专业程度越高,收入就越可观。但AI的出现正在改变这个格局。

现在,仅仅精通一个领域已经不够了。就像SFT阶段的AI模型,如果只在单一任务上表现出色,很容易被更全面的模型取代。人类也是如此,过度专业化可能让我们在AI时代变得脆弱,因为以后各大专业公司肯定会用自己多年积累的优质数据,训练出独属于自己的模型,然后用来解决同一领域的绝大多数问题。

但这并不意味着专业技能不重要,我们需要的是在掌握专业技能的同时,保持开放和学习的心态。想想那些顶尖的AI研究者,他们不仅精通计算机科学,还需要懂数学、统计学,甚至哲学和伦理学;顶级投资人很少有金融学出身,但不少都是学哲学的。

3.现实世界摸爬滚打(对应AI的强化学习阶段)

在现实世界经过长期强化学习的这类人非常稀缺,但每个练出来的人,都非常厉害。

你看马斯克,他不断尝试新领域,从PayPal到特斯拉,再到SpaceX。每次冒险都是一次实践学习,每次失败都是宝贵的反馈。他不仅在一个领域取得成功,而是跨界创新,把看似不相关的技术融合在一起。

李嘉诚从小贩做起,一步步建立商业帝国。他的成功不是来自书本,而是来自市场的每一次反馈。涉足房地产、零售、能源等多个领域,每次决策都是基于对市场的敏锐洞察。这种洞察力正是通过无数次的尝试和调整磨练出来的。

乔布斯的人生轨迹也很能说明这一点,他从被自己创立的公司赶出来,到东山再起,他把科技和人文完美结合,这种跨界思维正是源于他广泛的兴趣和持续的学习。

这些人还有一个特点,那就是拥有长思维链。你会发现这批人做事非常专注,所以能想问题想的特别深,想得特别深,所以能找对战略目标。

一项针对“Underthinking”现象的研究发现[2],模型若频繁更换思路反而徒增无效尝试,不如深入挖掘一条思路再回溯修正。

我们在处理复杂项目或科研时,也应避免东一榔头、西一棒子的浮躁做法,而要“一条思路深挖,回溯检查,再对比其他思路”。这种的战略风格既能减少资源浪费,也能提高解决问题的准确度。

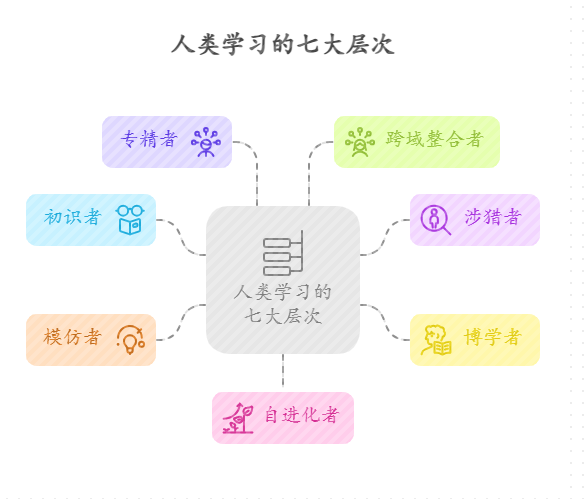

03 人类学习的七大层次

我让GPT根据这三个训练阶段,划分了人类学习的“七大层次”:

- 初识者(Naive Beginner)

- 特征:对大多数领域缺乏了解,往往连“预训练”都不充分。

- 表现:遇到任何问题都只能瞎猜或依赖他人帮助,缺乏自主学习能力。

- 典型场景:青少年早期或刚踏入陌生领域的“零基础”成年人。

- 涉猎者(Casual Learner)

- 特征:有一定的知识面,但很浅层,主要出于兴趣或偶尔碰触,未深入专业学习。

- 表现:类似AI在预训练很少的情况下,仅仅知道“皮毛信息”,或“一知半解”。

- 典型场景:爱好者,浏览各种科普,缺乏系统积淀或实践。

- 博学者(Foundation Learner)

- 特征:接受过较好的通识教育和丰富阅读量,对许多领域都有基本概念,但未必经过强化训练。

- 表现:知识储备很大,可以谈资甚广,但如果没有实操或RL,就难以转化成“解决问题”的能力。

- 在现代社会,如果博学者永远停留在“书本”或“谈资”阶段,知识就只能是一种谈论素材,而难以支撑真正的成就。

- 模仿者(Patterned Performer)

- 特征:经过了类似“SFT”式的教导,熟悉某些现成的操作流程或范式。

- 表现:能快速解决标准化问题,但高度依赖“前人经验”,遇到变化或新场景可能束手无策。

- 优点是效率高;缺点是创新力弱。

- 专精者(Professional Executor)

- 特征:在特定领域里,不但接受了系统化培训,还通过一定时间的实践积累,能熟练运用并产生较高产出。

- 表现:对行业通行规则非常熟悉,能独当一面,但跨专业或面对重大新挑战时,仍可能手足无措。

- 跨域整合者(Interdisciplinary Synthesizer)

- 特征:具备多领域交叉背景,或在若干专业实践中不断突破,能相互启发、融会贯通。

- 表现:既有“博学”基础,又通过实践形成跨学科综合能力,往往能提出新思路或新产品。

- 这是更接近“自进化者”的前置阶段:人不但掌握了一门领域,还可跳脱出单一视角,开始进行更高级的融合创新。

- 自进化者(Autonomous Innovator)

- 特征:在广泛知识和深度实践的双重基础上,保持持续迭代的心态与方法,能够面对未知问题仍然快速摸索出有效方案。

- 表现:他们往往能够利用 AI 或其它工具来辅助自己,但并不被工具束缚,而是能不断打破常规,发明创造,甚至形成新的行业标准或理论。

你可以自己对照一下自己在哪个阶段。

04 结语

我看现在很多人都强调提示词工程。

比如一个好的提示词应该是如何如何的。

这的确有用。

但我始终觉得,创造性的任务,怎么可能用精确性的词语“提示”出来呢?

那种灵光一闪的感觉,往往是模糊而不确定的,而且模型的输出也是不确定的,时而告诉你买“海蓝宝”,时而告诉你买“黑曜石”。

提示词再厉害,也不可能一下子得到想要很好的答案。甚至,答案好不好,关键还是在“我们自己”:

- 你能不能快速判断AI的结果是好是坏?

- 你有没有能力从AI给出的多个方案中挑选最佳的?

- 你是否能够将AI的输出与你的专业知识结合,创造出更有价值的内容?

- 你是否具备将AI的答案转化为实际可行方案的能力?

AI的输出往往需要多次迭代和人为干预才能达到理想效果,真正的高手知道如何引导AI,如何解读其输出,如何将AI的创意与自己的专业知识结合。

他们不会被AI的结果所束缚,而是将其视为创意的起点或灵感的来源。

所以,与其过分纠结于完美的提示词,不如多花时间提升自己的思维能力和创造力,学会快速评估AI的输出,培养将模糊想法转化为具体方案的能力,这才是在AI时代不变的那个“一”。

昔之得一者:天得一以清;地得一以宁;神得一以灵;谷得一以盈;万物得一以生;侯王得一以为天下正。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

大模型全套学习资料领取

这里我整理了一份AI大模型入门到进阶全套学习包,包含学习路线+实战案例+视频+书籍PDF+面试题+DeepSeek部署包和技巧,需要的小伙伴文在下方免费领取哦,真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?