在监督学习中,实现损失函数、做梯度下降很容易,而且基本上调节参数就能够得到好的结果。但是在强化学习中想要获得好结果就没有这么简单,算法中有许多变化的部分导致难以 调试。

Policy Gradient不通过误差反向传播,它通过观测信息选出一个行为直接进行反向传播,利用reward奖励直接对选择行为的可能性进行增强和减弱,好的行为会被增加下一次被选中的概率,不好的行为会被减弱下次被选中的概率。

PPO算法思想

PPO算法是一种Policy Gradient算法,Policy Gradient算法对步长敏感,但是又难以选择合适步长。PPO提出新的目标函数可以再多个训练步骤实现小批量的更新,解决了Policy Gradient算法中步长难以确定的问题。

PPO算法实现方案

Policy Gradient算法中,Agent又被称为Actor,Actor对于一个特定任务,都有自己的一个策略,策略通常用一个神经网络表示,其参数为θ。从一个特定的状态state出发,一直到任务的结束,被称为一个完整的eposide。在每一步,都能获得一个奖励r,一个完整的任务所获得的最终奖励被称为R。

Policy Gradient算法在更新策略时,基本思想就是增加reward大的动作出现的概率,减小reward小的策略出现的概率。假设现在有一种情况,r

eward在无论何时都是正的,对于没有采样到的动作,它的reward是0。因此,如果一个比较好的动作没有被采样到,而采样到的不好的动作得到了一个比较小的正reward,那么没有被采样到的好动作的出现概率会越来越小,这显然是不合适的,因此需要增加一个奖励基线,让reward有正有负。

最后

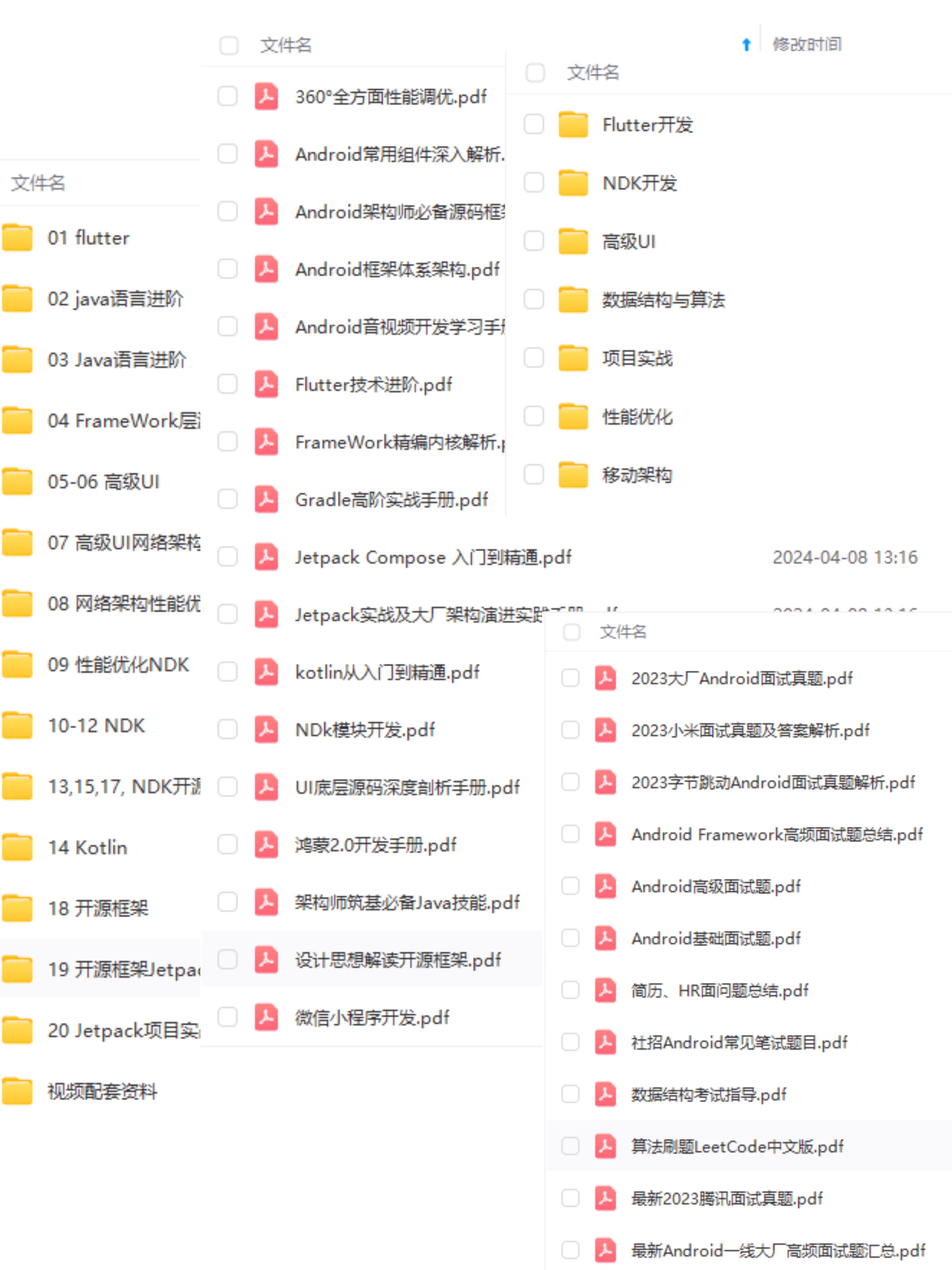

小编这些年深知大多数初中级Android工程师,想要提升自己,往往是自己摸索成长,自己不成体系的自学效果低效漫长且无助。

因此我收集整理了一份《2024年Android移动开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人

都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

资料⬅专栏获取

让我们一起学习成长!

资料⬅专栏获取

621

621

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?