Stable Baselines3 (SB3) 是一个强化学习的开源库,基于 PyTorch 框架构建。它是 Stable Baselines 项目的继任者,旨在提供一组可靠且经过良好测试的RL算法实现,便于研究和应用。StableBaseline3主要被应用于机器人控制、游戏AI、自动驾驶、金融交易等领域。

你可以使用sb3快速进行模型训练,同时使用SwanLab进行实验跟踪与可视化。

1.引入SwanLabCallback

python

复制代码from swanlab.integration.sb3 import SwanLabCallback

SwanLabCallback是适配于 Stable Baselines3 的日志记录类。

SwanLabCallback可以定义的参数有:

- project、experiment_name、description 等与 swanlab.init 效果一致的参数, 用于SwanLab项目的初始化。

- 你也可以在外部通过

swanlab.init创建项目,集成会将实验记录到你在外部创建的项目中。

2.传入model.learn

python复制代码from swanlab.integration.sb3 import SwanLabCallback

...

model.learn(

...

callback=SwanLabCallback(),

)

在model.learn的callback参数传入SwanLabCallback实例,即可开始跟踪。

3.完整案例代码

下面是一个PPO模型的简单训练案例,使用SwanLab做训练可视化和监控:

python复制代码import gymnasium as gym

from stable_baselines3 import PPO

from stable_baselines3.common.monitor import Monitor

from stable_baselines3.common.vec_env import DummyVecEnv

import swanlab

from swanlab.integration.sb3 import SwanLabCallback

config = {

"policy_type": "MlpPolicy",

"total_timesteps": 25000,

"env_name": "CartPole-v1",

}

def make_env():

env = gym.make(config["env_name"], render_mode="rgb_array")

env = Monitor(env)

return env

env = DummyVecEnv([make_env])

model = PPO(

config["policy_type"],

env,

verbose=1,

)

model.learn(

total_timesteps=config["total_timesteps"],

callback=SwanLabCallback(

project="PPO",

experiment_name="MlpPolicy",

verbose=2,

),

)

swanlab.finish()

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

资源分享

大模型AGI学习包

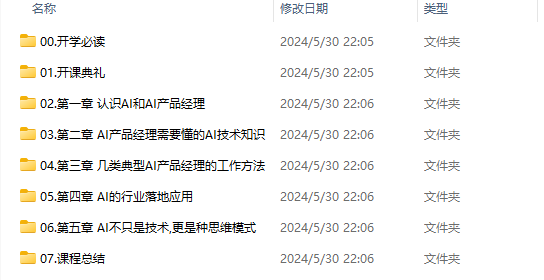

资料目录

- 成长路线图&学习规划

- 配套视频教程

- 实战LLM

- 人工智能比赛资料

- AI人工智能必读书单

- 面试题合集

《人工智能\大模型入门学习大礼包》,可以扫描下方二维码免费领取!

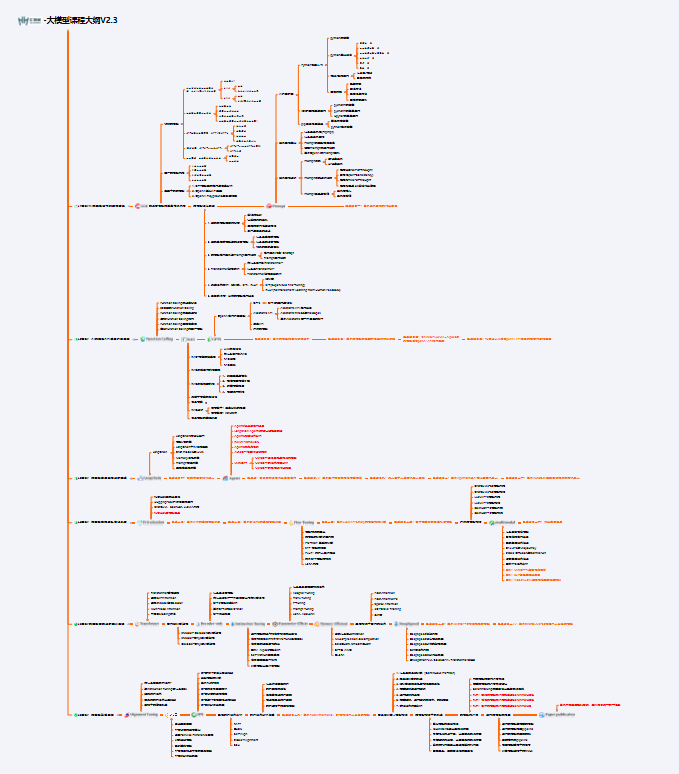

1.成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图&学习规划。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

2.视频教程

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,其中一共有21个章节,每个章节都是当前板块的精华浓缩。

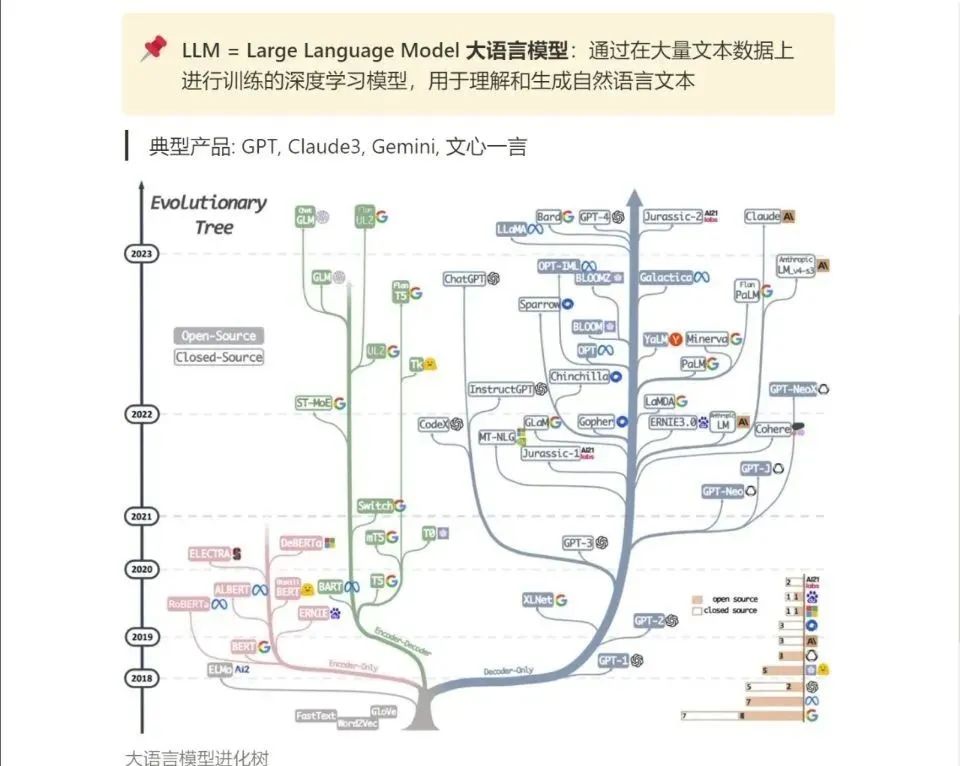

3.LLM

大家最喜欢也是最关心的LLM(大语言模型)

《人工智能\大模型入门学习大礼包》,可以扫描下方二维码免费领取!

1589

1589

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?