点击蓝字

关注我们

AI TIME欢迎每一位AI爱好者的加入!

7月8日上午,ICML 2023-国际机器学习会议预讲会在2023世界人工智能大会成功举办。

本次论坛由AI TIME主办,东浩兰生(集团)有限公司协办。ICML已经成为机器学习领域最受推崇、最有影响力的顶级学术会议之一,本次论坛AI TIME邀请了来自MIT、CMU、UIUC、清华大学、上海交通大学、中国人民大学、浙江大学、中国科学技术大学的青年优秀学者,分享他们发表在ICML 2023上的前沿工作,与观众共同探讨机器学习领域的理论和应用。

上海交通大学助理教授王韫博为大家带来《生成式人工智能:技术革命新时代》的报告,带领大家回顾了AI for Science的发展历程,围绕生成式人工智能为大家介绍了相关的理论研究,并展望探索了AIGC在将来可以应用的领域和方向。

中国人民大学高瓴人工智能学院准聘副教授刘勇分享了《图神经网络的泛化误差分析》报告,从图神经网络的研究背景、具体概念、泛化分析等方面深入浅出地介绍了相关研究,并提出下一步的研究工作是分析更复杂的GNN模型,探索具有更好表现力的模型。

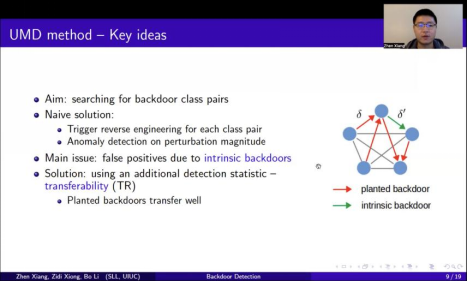

伊利诺伊大学香槟分校Secure Learning Lab的博士后研究员向臻报告了《针对X2X类型后门攻击的无监督检测》,分享了一种无监督模型检测方法——UMD,通过对抗性(源、目标)类对的联合推理来有效检测X2X后门攻击。

中国科学技术大学博士生张载熙带来《Learning Subpocket Prototypes for Generalizable Structure-based Drug Design》的报告,该研究主要关注基于蛋白质结构的药物分子设计问题,利用生物化学领域蛋白质口袋的相关性知识,实现了更加可泛化的药物分子生成模型。

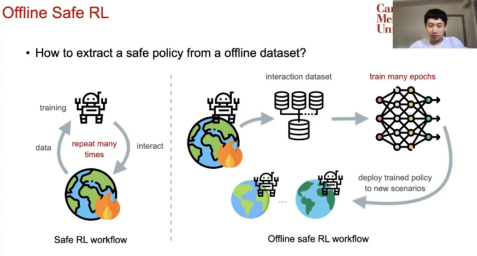

卡内基梅隆大学的博士生刘祖欣分享了关于离线安全强化学习的最新工作《从离线数据中学习安全通用的强化学习策略》,对于Offline safe RL,传统的基于约束优化的训练可能并不是很有效,该研究探讨了如何从离线数据当中学习到一个比较安全的策略,并提出了一系列有趣的观点。

浙江大学博士生朱同天分享了《去中心化以泛化?关于去中心化SGD与SAM的渐进等价性》的相关工作,他在报告中指出,去中心化的学习方法可能比传统认知的中心化的训练方法泛化性能更好,不仅有通讯效率、隐私保护上的优势,也能让算法的泛化性能更好。

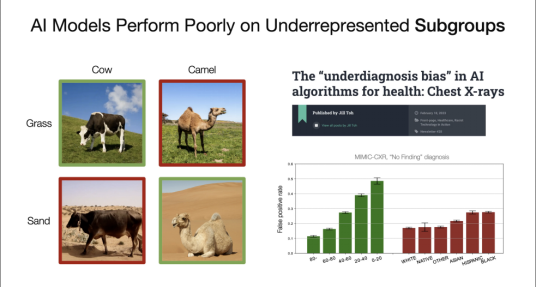

麻省理工学院计算机与人工智能实验室博士生杨宇喆报告了《深入研究子群体分布偏移》的研究,他针对子群体偏移的实际问题,提出了全面的框架SubpopBench,并进行了各类对比实验的说明与细致的分析。

清华大学博士生徐韧喆为观众带来《多玩家多臂老虎机中可分享手臂的竞争问题》的报告,介绍了一种多用户多臂老虎机的框架,分析了Nash均衡的形式,并基于Nash均衡提出一种在线学习算法,从理论上证明当所有用户遵循该策略时会有好的收敛性质,性能是鲁棒的。

ICML 2023

本次ICML2023预讲会为观众提供了一个交流学习、深入讨论机器学习研究的平台,希望通过本次ICML2023预讲会,能够聚集更多机器学习领域的爱好者探索研究,促进思维碰撞,推动人工智能领域的发展。

记得关注我们呀!每天都有新知识!

关于AI TIME

AI TIME源起于2019年,旨在发扬科学思辨精神,邀请各界人士对人工智能理论、算法和场景应用的本质问题进行探索,加强思想碰撞,链接全球AI学者、行业专家和爱好者,希望以辩论的形式,探讨人工智能和人类未来之间的矛盾,探索人工智能领域的未来。

迄今为止,AI TIME已经邀请了1100多位海内外讲者,举办了逾550场活动,超600万人次观看。

我知道你

在看

哦

~

点击 阅读原文 观看回放!

30

30

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?