在2024年5月15日凌晨,谷歌在美国加利福尼亚州山景城举办了年度开发者大会I/O 2024。这次发布会由谷歌CEO桑达尔·皮查伊(Sundar Pichai)主持,全程历时两小时。在这场会议中,皮查伊共提及“AI”121次,展示了多项重磅产品和技术更新。

简要剖析会议的部分主要关键信息:

-

全新Gemini模型:升级与创新

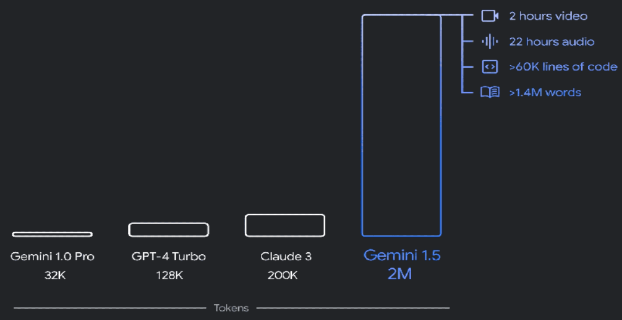

此次大会上,谷歌宣布了对其核心AI模型Gemini的重大升级。Gemini 1.5 Pro的上下文窗口从100万个token扩展到200万个token,这一升级极大地提升了模型处理长文本和复杂任务的能力。Gemini 1.5 Pro不仅在图像和视频理解方面表现卓越,还能够遵循复杂的指示,如指定产品级行为的指示,涵盖角色、格式和风格等。开发者可以通过Gemini Advanced订阅服务体验这一最新版本,支持超过150个国家的35种语言。

为了满足低延迟和低成本的需求,谷歌还发布了轻量化模型Gemini 1.5 Flash。

相比于Gemini 1.5 Pro,Flash版本响应速度更快,成本更低,每百万tokens仅需0.35美元。尽管体积更小,Gemini 1.5 Flash仍具备100万个标记的长上下文窗口,适用于摘要、聊天应用、图像和视频字幕、长文档和表格的数据提取等多种任务。

-

搜索引擎的全面AI改造

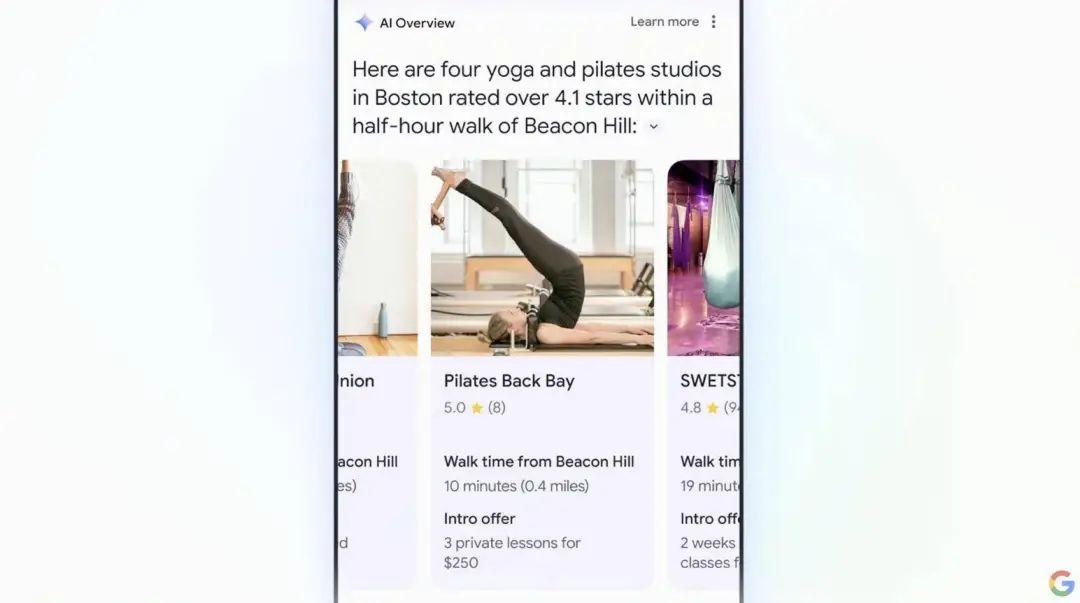

谷歌还对其搜索引擎进行了全面的AI改造。搜索负责人莉兹·里德(Liz Reid)宣布,谷歌搜索将结合Gemini的多步推理、规划和多模态功能,推出AI Overviews。用户可以上传演示视频,AI将通过搜索论坛和互联网找到解决方案。此外,用户还可以向定制的Gemini模型提出复杂的问题,甚至在用户不知道问什么的情况下,Google也能给出建议。具体新功能说明如下:

1.AI Review:用户可以通过在搜索结果的顶部,获取由 AI 大模型生成的摘要,以此简化整个搜索过程,让复杂问题的检索过程,变得简单。

2.Multi-step reasoning:通过全新的多步推理,以后我们做一些生活、工作和出行的计划,会变得非常简单。比如你可以通过搜索栏来找到「附近最好的瑜伽馆」,随后附近所有关于瑜伽馆的介评价评分、课程推荐、距离等重要信息,都会被分类成块,十分清楚地在搜索结果中显示。如下图所示。

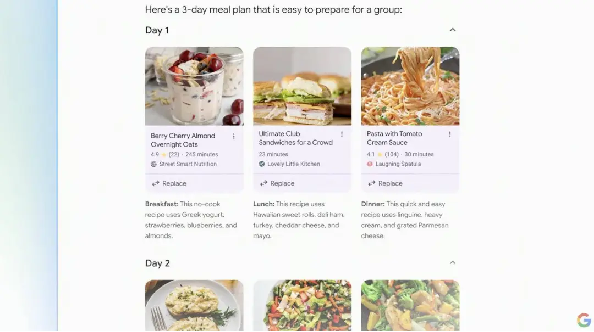

3.Planning in Search:定制计划。比如你现在正在重新调整膳食结构、从头安排饮食计划,不想在早餐、午餐和晚餐时吃通心粉和奶酪。直接把需求抛给搜索框,Google Search 就能给你一份按照要求且合理安排的全新一周食谱。如下图所示。 若用户有改变条件和细节需求,搜索的结果也会根据最新的提示实时更新。

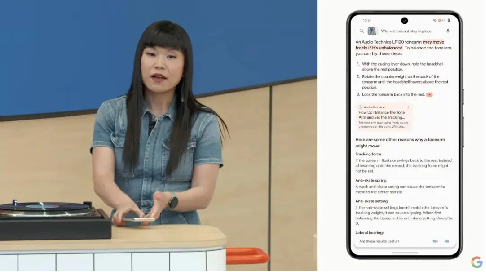

4. Ask with Video:它相当于一本装在手机里的百科全书。比如唱片的零部件不起作用了不知道从何下手,相机的快门突然失灵......以前可能要大费周折地寄回厂家售后,但现在用 Google 设备的镜头拍下问题所在,Google Search 就能根据你所遇到的问题初步诊断,一些小故障还能当场给出解决方案。

如上图所示,在发布会的实时演示里,AI 还把整个的修理步骤一一列出,按照屏幕上的指示,演示者很快就能解决小麻烦。

从技术上讲,这个功能是通过 AI 逐帧分解视频,把每一帧的关键信息导入 Gemini 的长触点窗口挨个分析,并梳理网络中相关的文章、论坛、视频等,从中找到见解,以此实现了 Ask with Video 的智能建议。

-

AI智能体Project Astra:未来的万能助手

谷歌发布了新的AI智能体Project Astra,旨在实现通用AI的愿景。

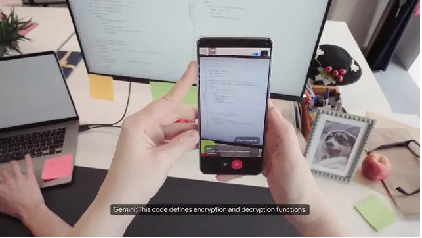

在发布会上,谷歌展示了Astra的原型运作视频。用户可以通过手机摄像头对准物体并与其交互,Astra能够实时识别物体并进行语音互动。例如,Astra能够通过手机摄像头或智能眼镜看到的内容来分析响应语音命令成功地识别出代码序列、为电路图提出改进建议;当用户问Astra眼镜放在哪里时,Astra能够快速准确地回答,这表明Astra能够通过摄像头记录并记忆用户的物品位置。

据介绍,谷歌在Gemini的基础上开发了Astra的原型,可以通过连续编码视频帧、将视频和语音输入组合到事件时间线中以实现更快地处理信息。通过语音模型,谷歌也强化了智能助手的说话能力,让其能够给出更快速的回应。不过有AI从业者称,在演示视频中,谷歌AI助手的回应速度似乎还是会比GPT-4o稍慢些,语音所表现出的感情色彩也似乎平淡一些。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?