1、函数原型及参数说明

- sklearn.decomposition.PCA(n_components=None, copy=True, whiten=False)

参数说明:

n_components:

意义:PCA算法中所要保留的主成分个数n,也即保留下来的特征个数n

类型:int 或者 string,缺省时默认为None,所有成分被保留。

赋值为int,比如n_components=1,将把原始数据降到一个维度。

赋值为string,比如n_components='mle',将自动选取特征个数n,使得满足所要求的方差百分比。

copy:

类型:bool,True或者False,缺省时默认为True。

意义:表示是否在运行算法时,将原始训练数据复制一份。若为True,则运行PCA算法后,原始训练数据的值不 会有任何改变,因为是在原始数据的副本上进行运算;若为False,则运行PCA算法后,原始训练数据的 值会改,因为是在原始数据上进行降维计算。

whiten:

类型:bool,缺省时默认为False

意义:白化,使得每个特征具有相同的方差。关于“白化”,可参考:Ufldl教程

2、PCA对象的属性

components_ :返回具有最大方差的成分。

explained_variance_ratio_:返回 所保留的n个成分各自的方差百分比。

n_components_:返回所保留的成分个数n。

mean_:

noise_variance_:

3、PCA对象的方法

fit()可以说是scikit-learn中通用的方法,每个需要训练的算法都会有fit()方法,它其实就是算法中的“训练”这一步骤。因为PCA是无监督学习算法,此处y自然等于None。

fit(X),表示用数据X来训练PCA模型。

函数返回值:调用fit方法的对象本身。比如pca.fit(X),表示用X对pca这个对象进行训练。

newX=pca.fit_transform(X),newX就是降维后的数据。

将降维后的数据转换成原始数据,X=pca.inverse_transform(newX)

将数据X转换成降维后的数据。当模型训练好后,对于新输入的数据,都可以用transform方法来降维。

此外,还有get_covariance()、get_precision()、get_params(deep=True)、score(X, y=None)等方法,以后用到再补充吧。

4、example

以一组二维的数据data为例,data如下,一共12个样本(x,y),其实就是分布在直线y=x上的点,并且聚集在x=1、2、3、4上,各3个。

- >>> data

- array([[ 1. , 1. ],

- [ 0.9 , 0.95],

- [ 1.01, 1.03],

- [ 2. , 2. ],

- [ 2.03, 2.06],

- [ 1.98, 1.89],

- [ 3. , 3. ],

- [ 3.03, 3.05],

- [ 2.89, 3.1 ],

- [ 4. , 4. ],

- [ 4.06, 4.02],

- [ 3.97, 4.01]])

data这组数据,有两个特征,因为两个特征是近似相等的,所以用一个特征就能表示了,即可以降到一维。下面就来看看怎么用sklearn中的PCA算法包。

(1)n_components设置为1,copy默认为True,可以看到原始数据data并未改变,newData是一维的,并且明显地将原始数据分成了四类。

- >>> from sklearn.decomposition import PCA

- >>> pca=PCA(n_components=1)

- >>> newData=pca.fit_transform(data)

- >>> newData

- array([[-2.12015916],

- [-2.22617682],

- [-2.09185561],

- [-0.70594692],

- [-0.64227841],

- [-0.79795758],

- [ 0.70826533],

- [ 0.76485312],

- [ 0.70139695],

- [ 2.12247757],

- [ 2.17900746],

- [ 2.10837406]])

- >>> data

- array([[ 1. , 1. ],

- [ 0.9 , 0.95],

- [ 1.01, 1.03],

- [ 2. , 2. ],

- [ 2.03, 2.06],

- [ 1.98, 1.89],

- [ 3. , 3. ],

- [ 3.03, 3.05],

- [ 2.89, 3.1 ],

- [ 4. , 4. ],

- [ 4.06, 4.02],

- [ 3.97, 4.01]])

(

2)将copy设置为False,原始数据data将发生改变。

- >>> pca=PCA(n_components=1,copy=False)

- >>> newData=pca.fit_transform(data)

- >>> data

- array([[-1.48916667, -1.50916667],

- [-1.58916667, -1.55916667],

- [-1.47916667, -1.47916667],

- [-0.48916667, -0.50916667],

- [-0.45916667, -0.44916667],

- [-0.50916667, -0.61916667],

- [ 0.51083333, 0.49083333],

- [ 0.54083333, 0.54083333],

- [ 0.40083333, 0.59083333],

- [ 1.51083333, 1.49083333],

- [ 1.57083333, 1.51083333],

- [ 1.48083333, 1.50083333]])

(3)n_components设置为'mle',看看效果,自动降到了1维。

- >>> pca=PCA(n_components='mle')

- >>> newData=pca.fit_transform(data)

- >>> newData

- array([[-2.12015916],

- [-2.22617682],

- [-2.09185561],

- [-0.70594692],

- [-0.64227841],

- [-0.79795758],

- [ 0.70826533],

- [ 0.76485312],

- [ 0.70139695],

- [ 2.12247757],

- [ 2.17900746],

- [ 2.10837406]])

(4)对象的属性值

- >>> pca.n_components

- 1

- >>> pca.explained_variance_ratio_

- array([ 0.99910873])

- >>> pca.explained_variance_

- array([ 2.55427003])

- >>> pca.get_params

- <bound method PCA.get_params of PCA(copy=True, n_components=1, whiten=False)>

我们所训练的pca对象的n_components值为1,即保留1个特征,该特征的方差为2.55427003,

占所有特征的方差百分比为0.99910873,意味着几乎保留了所有的信息。get_params返回各个参数的值。

(5)对象的方法

- >>> newA=pca.transform(A)

对新的数据A,用已训练好的pca模型进行降维。

- >>> pca.set_params(copy=False)

- PCA(copy=False, n_components=1, whiten=False)

设置参数。

1、函数原型及参数说明

- sklearn.decomposition.PCA(n_components=None, copy=True, whiten=False)

参数说明:

n_components:

意义:PCA算法中所要保留的主成分个数n,也即保留下来的特征个数n

类型:int 或者 string,缺省时默认为None,所有成分被保留。

赋值为int,比如n_components=1,将把原始数据降到一个维度。

赋值为string,比如n_components='mle',将自动选取特征个数n,使得满足所要求的方差百分比。

copy:

类型:bool,True或者False,缺省时默认为True。

意义:表示是否在运行算法时,将原始训练数据复制一份。若为True,则运行PCA算法后,原始训练数据的值不 会有任何改变,因为是在原始数据的副本上进行运算;若为False,则运行PCA算法后,原始训练数据的 值会改,因为是在原始数据上进行降维计算。

whiten:

类型:bool,缺省时默认为False

意义:白化,使得每个特征具有相同的方差。关于“白化”,可参考:Ufldl教程

2、PCA对象的属性

components_ :返回具有最大方差的成分。

explained_variance_ratio_:返回 所保留的n个成分各自的方差百分比。

n_components_:返回所保留的成分个数n。

mean_:

noise_variance_:

3、PCA对象的方法

fit()可以说是scikit-learn中通用的方法,每个需要训练的算法都会有fit()方法,它其实就是算法中的“训练”这一步骤。因为PCA是无监督学习算法,此处y自然等于None。

fit(X),表示用数据X来训练PCA模型。

函数返回值:调用fit方法的对象本身。比如pca.fit(X),表示用X对pca这个对象进行训练。

newX=pca.fit_transform(X),newX就是降维后的数据。

将降维后的数据转换成原始数据,X=pca.inverse_transform(newX)

将数据X转换成降维后的数据。当模型训练好后,对于新输入的数据,都可以用transform方法来降维。

此外,还有get_covariance()、get_precision()、get_params(deep=True)、score(X, y=None)等方法,以后用到再补充吧。

4、example

以一组二维的数据data为例,data如下,一共12个样本(x,y),其实就是分布在直线y=x上的点,并且聚集在x=1、2、3、4上,各3个。

- >>> data

- array([[ 1. , 1. ],

- [ 0.9 , 0.95],

- [ 1.01, 1.03],

- [ 2. , 2. ],

- [ 2.03, 2.06],

- [ 1.98, 1.89],

- [ 3. , 3. ],

- [ 3.03, 3.05],

- [ 2.89, 3.1 ],

- [ 4. , 4. ],

- [ 4.06, 4.02],

- [ 3.97, 4.01]])

data这组数据,有两个特征,因为两个特征是近似相等的,所以用一个特征就能表示了,即可以降到一维。下面就来看看怎么用sklearn中的PCA算法包。

(1)n_components设置为1,copy默认为True,可以看到原始数据data并未改变,newData是一维的,并且明显地将原始数据分成了四类。

- >>> from sklearn.decomposition import PCA

- >>> pca=PCA(n_components=1)

- >>> newData=pca.fit_transform(data)

- >>> newData

- array([[-2.12015916],

- [-2.22617682],

- [-2.09185561],

- [-0.70594692],

- [-0.64227841],

- [-0.79795758],

- [ 0.70826533],

- [ 0.76485312],

- [ 0.70139695],

- [ 2.12247757],

- [ 2.17900746],

- [ 2.10837406]])

- >>> data

- array([[ 1. , 1. ],

- [ 0.9 , 0.95],

- [ 1.01, 1.03],

- [ 2. , 2. ],

- [ 2.03, 2.06],

- [ 1.98, 1.89],

- [ 3. , 3. ],

- [ 3.03, 3.05],

- [ 2.89, 3.1 ],

- [ 4. , 4. ],

- [ 4.06, 4.02],

- [ 3.97, 4.01]])

(

2)将copy设置为False,原始数据data将发生改变。

- >>> pca=PCA(n_components=1,copy=False)

- >>> newData=pca.fit_transform(data)

- >>> data

- array([[-1.48916667, -1.50916667],

- [-1.58916667, -1.55916667],

- [-1.47916667, -1.47916667],

- [-0.48916667, -0.50916667],

- [-0.45916667, -0.44916667],

- [-0.50916667, -0.61916667],

- [ 0.51083333, 0.49083333],

- [ 0.54083333, 0.54083333],

- [ 0.40083333, 0.59083333],

- [ 1.51083333, 1.49083333],

- [ 1.57083333, 1.51083333],

- [ 1.48083333, 1.50083333]])

(3)n_components设置为'mle',看看效果,自动降到了1维。

- >>> pca=PCA(n_components='mle')

- >>> newData=pca.fit_transform(data)

- >>> newData

- array([[-2.12015916],

- [-2.22617682],

- [-2.09185561],

- [-0.70594692],

- [-0.64227841],

- [-0.79795758],

- [ 0.70826533],

- [ 0.76485312],

- [ 0.70139695],

- [ 2.12247757],

- [ 2.17900746],

- [ 2.10837406]])

(4)对象的属性值

- >>> pca.n_components

- 1

- >>> pca.explained_variance_ratio_

- array([ 0.99910873])

- >>> pca.explained_variance_

- array([ 2.55427003])

- >>> pca.get_params

- <bound method PCA.get_params of PCA(copy=True, n_components=1, whiten=False)>

我们所训练的pca对象的n_components值为1,即保留1个特征,该特征的方差为2.55427003,

占所有特征的方差百分比为0.99910873,意味着几乎保留了所有的信息。get_params返回各个参数的值。

(5)对象的方法

- >>> newA=pca.transform(A)

对新的数据A,用已训练好的pca模型进行降维。

- >>> pca.set_params(copy=False)

- PCA(copy=False, n_components=1, whiten=False)

设置参数。

1、PCA算法介绍

主成分分析(Principal Components Analysis),简称PCA,是一种数据降维技术,用于数据预处理。一般我们获取的原始数据维度都很高,比如1000个特征,在这1000个特征中可能包含了很多无用的信息或者噪声,真正有用的特征才100个,那么我们可以运用PCA算法将1000个特征降到100个特征。这样不仅可以去除无用的噪声,还能减少很大的计算量。

PCA算法是如何实现的?

简单来说,就是将数据从原始的空间中转换到新的特征空间中,例如原始的空间是三维的(x,y,z),x、y、z分别是原始空间的三个基,我们可以通过某种方法,用新的坐标系(a,b,c)来表示原始的数据,那么a、b、c就是新的基,它们组成新的特征空间。在新的特征空间中,可能所有的数据在c上的投影都接近于0,即可以忽略,那么我们就可以直接用(a,b)来表示数据,这样数据就从三维的(x,y,z)降到了二维的(a,b)。

问题是如何求新的基(a,b,c)?

一般步骤是这样的:先对原始数据零均值化,然后求协方差矩阵,接着对协方差矩阵求特征向量和特征值,这些特征向量组成了新的特征空间。具体的细节,推荐Andrew Ng的网页教程:Ufldl 主成分分析 ,写得很详细。

2、PCA算法实现

语言:Python

函数库:Numpy

根据上面提到的一般步骤来实现PCA算法

(1)零均值化

假如原始数据集为矩阵dataMat,dataMat中每一行代表一个样本,每一列代表同一个特征。零均值化就是求每一列的平均值,然后该列上的所有数都减去这个均值。也就是说,这里零均值化是对每一个特征而言的,零均值化都,每个特征的均值变成0。实现代码如下:

- def zeroMean(dataMat):

- meanVal=np.mean(dataMat,axis=0)

- newData=dataMat-meanVal

- return newData,meanVal

函数中用numpy中的mean方法来求均值,axis=0表示按列求均值。

该函数返回两个变量,newData是零均值化后的数据,meanVal是每个特征的均值,是给后面重构数据用的。

- newData,meanVal=zeroMean(dataMat)

- covMat=np.cov(newData,rowvar=0)

numpy中的cov函数用于求协方差矩阵,参数rowvar很重要!若rowvar=0,说明传入的数据一行代表一个样本,若非0,说明传入的数据一列代表一个样本。因为newData每一行代表一个样本,所以将rowvar设置为0。

covMat即所求的协方差矩阵。

(3)求特征值、特征矩阵

调用numpy中的线性代数模块linalg中的eig函数,可以直接由covMat求得特征值和特征向量:

- eigVals,eigVects=np.linalg.eig(np.mat(covMat))

eigVals存放特征值,行向量。

eigVects存放特征向量,每一列带别一个特征向量。

特征值和特征向量是一一对应的

(4)保留主要的成分[即保留值比较大的前n个特征]

第三步得到了特征值向量eigVals,假设里面有m个特征值,我们可以对其排序,排在前面的n个特征值所对应的特征向量就是我们要保留的,它们组成了新的特征空间的一组基n_eigVect。将零均值化后的数据乘以n_eigVect就可以得到降维后的数据。代码如下:

- eigValIndice=np.argsort(eigVals)

- n_eigValIndice=eigValIndice[-1:-(n+1):-1]

- n_eigVect=eigVects[:,n_eigValIndice]

- lowDDataMat=newData*n_eigVect

- reconMat=(lowDDataMat*n_eigVect.T)+meanVal

- return lowDDataMat,reconMat

代码中有几点要说明一下,首先argsort对特征值是从小到大排序的,那么最大的n个特征值就排在后面,所以eigValIndice[-1:-(n+1):-1]就取出这个n个特征值对应的下标。【python里面,list[a:b:c]代表从下标a开始到b,步长为c。】

reconMat是重构的数据,乘以n_eigVect的转置矩阵,再加上均值meanVal。

OK,这四步下来就可以从高维的数据dataMat得到低维的数据lowDDataMat,另外,程序也返回了重构数据reconMat,有些时候reconMat课便于数据分析。

贴一下总的代码:

-

- def zeroMean(dataMat):

- meanVal=np.mean(dataMat,axis=0)

- newData=dataMat-meanVal

- return newData,meanVal

-

- def pca(dataMat,n):

- newData,meanVal=zeroMean(dataMat)

- covMat=np.cov(newData,rowvar=0)

-

- eigVals,eigVects=np.linalg.eig(np.mat(covMat))

- eigValIndice=np.argsort(eigVals)

- n_eigValIndice=eigValIndice[-1:-(n+1):-1]

- n_eigVect=eigVects[:,n_eigValIndice]

- lowDDataMat=newData*n_eigVect

- reconMat=(lowDDataMat*n_eigVect.T)+meanVal

- return lowDDataMat,reconMat

3、选择主成分个数

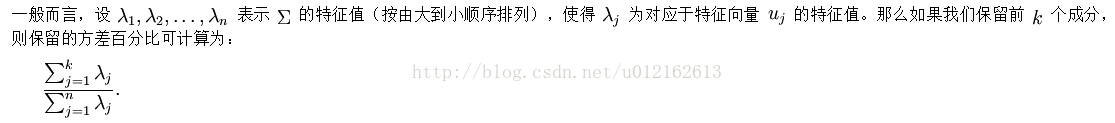

文章写到这里还没有完,应用PCA的时候,对于一个1000维的数据,我们怎么知道要降到几维的数据才是合理的?即n要取多少,才能保留最多信息同时去除最多的噪声?一般,我们是通过方差百分比来确定n的,这一点在Ufldl教程中说得很清楚,并且有一条简单的公式,下面是该公式的截图:

根据这条公式,可以写个函数,函数传入的参数是百分比percentage和特征值向量,然后根据percentage确定n,代码如下:

- def percentage2n(eigVals,percentage):

- sortArray=np.sort(eigVals)

- sortArray=sortArray[-1::-1]

- arraySum=sum(sortArray)

- tmpSum=0

- num=0

- for i in sortArray:

- tmpSum+=i

- num+=1

- if tmpSum>=arraySum*percentage:

- return num

那么pca函数也可以重写成百分比版本,默认百分比99%。

- def pca(dataMat,percentage=0.99):

- newData,meanVal=zeroMean(dataMat)

- covMat=np.cov(newData,rowvar=0)

- eigVals,eigVects=np.linalg.eig(np.mat(covMat))

- n=percentage2n(eigVals,percentage)

- eigValIndice=np.argsort(eigVals)

- n_eigValIndice=eigValIndice[-1:-(n+1):-1]

- n_eigVect=eigVects[:,n_eigValIndice]

- lowDDataMat=newData*n_eigVect

- reconMat=(lowDDataMat*n_eigVect.T)+meanVal

- return lowDDataMat,reconMat

1、函数原型及参数说明

- sklearn.decomposition.PCA(n_components=None, copy=True, whiten=False)

参数说明:

n_components:

意义:PCA算法中所要保留的主成分个数n,也即保留下来的特征个数n

类型:int 或者 string,缺省时默认为None,所有成分被保留。

赋值为int,比如n_components=1,将把原始数据降到一个维度。

赋值为string,比如n_components='mle',将自动选取特征个数n,使得满足所要求的方差百分比。

copy:

类型:bool,True或者False,缺省时默认为True。

意义:表示是否在运行算法时,将原始训练数据复制一份。若为True,则运行PCA算法后,原始训练数据的值不 会有任何改变,因为是在原始数据的副本上进行运算;若为False,则运行PCA算法后,原始训练数据的 值会改,因为是在原始数据上进行降维计算。

whiten:

类型:bool,缺省时默认为False

意义:白化,使得每个特征具有相同的方差。关于“白化”,可参考:Ufldl教程

2、PCA对象的属性

components_ :返回具有最大方差的成分。

explained_variance_ratio_:返回 所保留的n个成分各自的方差百分比。

n_components_:返回所保留的成分个数n。

mean_:

noise_variance_:

3、PCA对象的方法

fit()可以说是scikit-learn中通用的方法,每个需要训练的算法都会有fit()方法,它其实就是算法中的“训练”这一步骤。因为PCA是无监督学习算法,此处y自然等于None。

fit(X),表示用数据X来训练PCA模型。

函数返回值:调用fit方法的对象本身。比如pca.fit(X),表示用X对pca这个对象进行训练。

newX=pca.fit_transform(X),newX就是降维后的数据。

将降维后的数据转换成原始数据,X=pca.inverse_transform(newX)

将数据X转换成降维后的数据。当模型训练好后,对于新输入的数据,都可以用transform方法来降维。

此外,还有get_covariance()、get_precision()、get_params(deep=True)、score(X, y=None)等方法,以后用到再补充吧。

4、example

以一组二维的数据data为例,data如下,一共12个样本(x,y),其实就是分布在直线y=x上的点,并且聚集在x=1、2、3、4上,各3个。

- >>> data

- array([[ 1. , 1. ],

- [ 0.9 , 0.95],

- [ 1.01, 1.03],

- [ 2. , 2. ],

- [ 2.03, 2.06],

- [ 1.98, 1.89],

- [ 3. , 3. ],

- [ 3.03, 3.05],

- [ 2.89, 3.1 ],

- [ 4. , 4. ],

- [ 4.06, 4.02],

- [ 3.97, 4.01]])

data这组数据,有两个特征,因为两个特征是近似相等的,所以用一个特征就能表示了,即可以降到一维。下面就来看看怎么用sklearn中的PCA算法包。

(1)n_components设置为1,copy默认为True,可以看到原始数据data并未改变,newData是一维的,并且明显地将原始数据分成了四类。

- >>> from sklearn.decomposition import PCA

- >>> pca=PCA(n_components=1)

- >>> newData=pca.fit_transform(data)

- >>> newData

- array([[-2.12015916],

- [-2.22617682],

- [-2.09185561],

- [-0.70594692],

- [-0.64227841],

- [-0.79795758],

- [ 0.70826533],

- [ 0.76485312],

- [ 0.70139695],

- [ 2.12247757],

- [ 2.17900746],

- [ 2.10837406]])

- >>> data

- array([[ 1. , 1. ],

- [ 0.9 , 0.95],

- [ 1.01, 1.03],

- [ 2. , 2. ],

- [ 2.03, 2.06],

- [ 1.98, 1.89],

- [ 3. , 3. ],

- [ 3.03, 3.05],

- [ 2.89, 3.1 ],

- [ 4. , 4. ],

- [ 4.06, 4.02],

- [ 3.97, 4.01]])

(

2)将copy设置为False,原始数据data将发生改变。

- >>> pca=PCA(n_components=1,copy=False)

- >>> newData=pca.fit_transform(data)

- >>> data

- array([[-1.48916667, -1.50916667],

- [-1.58916667, -1.55916667],

- [-1.47916667, -1.47916667],

- [-0.48916667, -0.50916667],

- [-0.45916667, -0.44916667],

- [-0.50916667, -0.61916667],

- [ 0.51083333, 0.49083333],

- [ 0.54083333, 0.54083333],

- [ 0.40083333, 0.59083333],

- [ 1.51083333, 1.49083333],

- [ 1.57083333, 1.51083333],

- [ 1.48083333, 1.50083333]])

(3)n_components设置为'mle',看看效果,自动降到了1维。

- >>> pca=PCA(n_components='mle')

- >>> newData=pca.fit_transform(data)

- >>> newData

- array([[-2.12015916],

- [-2.22617682],

- [-2.09185561],

- [-0.70594692],

- [-0.64227841],

- [-0.79795758],

- [ 0.70826533],

- [ 0.76485312],

- [ 0.70139695],

- [ 2.12247757],

- [ 2.17900746],

- [ 2.10837406]])

(4)对象的属性值

- >>> pca.n_components

- 1

- >>> pca.explained_variance_ratio_

- array([ 0.99910873])

- >>> pca.explained_variance_

- array([ 2.55427003])

- >>> pca.get_params

- <bound method PCA.get_params of PCA(copy=True, n_components=1, whiten=False)>

我们所训练的pca对象的n_components值为1,即保留1个特征,该特征的方差为2.55427003,

占所有特征的方差百分比为0.99910873,意味着几乎保留了所有的信息。get_params返回各个参数的值。

(5)对象的方法

- >>> newA=pca.transform(A)

对新的数据A,用已训练好的pca模型进行降维。

- >>> pca.set_params(copy=False)

- PCA(copy=False, n_components=1, whiten=False)

设置参数。

1732

1732

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?