导读:几何机器学习和基于图的机器学习是当前最热门的研究课题之一。在过去的一年中,该领域的研究发展迅猛。在本文中,几何深度学习先驱 Michael Bronstein 和 Petar Veličković 合作,采访了多位杰出的领域专家,总结了该领域过去一年中的研究亮点,并对该方向在 2022 年的发展趋势进行了展望。

本文为《2021 几何&图机器学习大盘点 | 几何深度学习先驱 Michael Bronstein长文解读》下篇,编译自https://towardsdatascience.com/predictions-and-hopes-for-geometric-graph-ml-in-2022-aa3b8b79f5cc#0b34

作者:Michael Bronstein

牛津大学DeepMind人工智能教授、Twitter图机器学习负责人

编译:熊宇轩

校对:李梦佳

01

推理、近似、泛化仍是图机器学习领域重要开放性问题

随着人们在越来越多的标准 GNN 对比基准上取得的性能趋于饱和,GNN 层的新归纳偏置的发展也逐渐变慢。实际上,「Open Graph」对比基准提供的一些任务现在似乎也依赖于非架构的技巧(例如,利用外部数据或对输出进行后处理)来提升性能。

然而,图上的推理问题仍然有很大的研究空间。此时,边不仅仅对信息聚合起到简单的引导租用,它们还与数据在图上的传递方式有关。此外,为了实现真正的推理能力,我们还需要一定程度的泛化,这对现有的消息传递机制的泛化性能提出了重大挑战。2021 年,一些有趣的新型 GNN 与推理和仿真有关。

Bruno Ribeiro:

该领域的研究目前尚处于起步阶段,有许多可以提升泛化性(尤其是分布外泛化)的方法。

「想要展望未来(2022 年),就需要回顾遥远的过去的研究,及其和 2021 年论文的联系。」——Bruno Ribeiro,普渡大学助理教授

现代统计学的创始人 Karl Pearson、R.A.Fisher 和 Charles Spearman 的理论有两个盲点:(1)因果。(2)公理化概率。而这两点如今在图机器学习领域产生了有趣的分支。

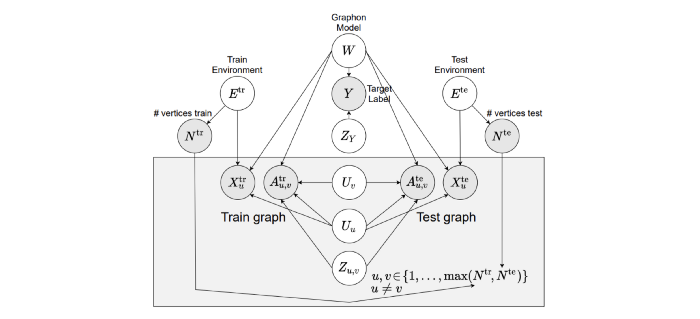

2021 年,因果成为了研究 GNN 的泛化性能的重要视角。解决分布外(OOD)任务是最简单的因果应用。在机器学习场景下,我们可能需要处理具有不同分布的测试数据和训练数据。在不能使用测试数据的情况下爱,鲁棒的分类器需要对这种分布的偏移具有不变性(反事实不变性)。虽然 GNN 可以为任意尺寸的图创建表征,但只在小图上训练的图分类器往往在大的测试图(OOD)上的泛化性能较差,反之亦然。针对反事实不变性,一些研究者使用 Lovász & Szegedy 的图极限结论,说明可以使用诱导子图表征获取对上述 OOD 任务具有尺寸不变性的全图表征。此外,还有一些研究人员年提出了基于任务相关的子图来学习图表征,这些子图对与任务无关的子图具有不变性,使得图分类器能够在这些任务中不受任务无关的 OOD 子图分布偏移的影响。2022 年,图机器学习和因果之间将产生新的联系。

图注:Bevilacqua 等人说明了如何在图分类任务上实现尺度不变 OOD 泛化,他们使用显式的因果模型,对分布偏移建模。

除了因果及其对 OOD 的影响,Bruno 还强调了通过仔细的公理化在支撑 GNN 架构方面所取得的进展:公理化概率描述生成数据的分布的属性而不是给出一个函数形式。例如,我们知道一个随机变量序列的分布具有置换不变性(可交换)。这为图机器学习的快速发展铺平了道路。事实上,这种几何公理化还没有完成。目前最前沿的研究结果仍然需要构建神经架构,其设计并不是完全由已知的数据属性(公理)驱动。现在一些最先进的方法由数据后处理驱动(以使数据适应架构)。

2021 年出现了一些朝进一步几何公理化进展的工作:额外的公理有益于图表示架构,我们可以学习使用图的拓扑曲率来避免信息瓶颈。2022 年,我们有望看到图机器学习架构公理化方面取得进一步的进展,例如:链接预测的公理化、研究因果链接预测方法。

唐建:

有关推理和泛化的研究有助于知识图谱推理。最近,我们利用寻路算法的直接知识构建了一种最先进的知识图谱推理方法。唐建指出,现有的知识图谱推理算法通常只适用于转导场景,而不适用于归纳场景。在去年的 NeurIPS 上,我们提出了一个基于 GNN 的通用且灵活的框架 神经 Bellman-Ford 网络(NBFNet),用于图的链接预测。NBFNet 通用性很强,涵盖了许多传统的基于路径的方法,在转导和归纳的环境下都可以应用于同构图和多关系图(例如,知识图谱)。它优于现有的方法,在转导和归纳环境下有很大的优势,取得了新的最先进的结果。我相信 NBFNet 将来会成为图链接预测的标准框架。

Mila唐建专访:Bengio领路,缘起生物梦,AI如何变革生物制药

02

图在强化学习中日渐流行,但仍有很大探索空间

强化学习仍然是当今人工智能研究中最活跃的领域之一。图和对称性普遍存在于强化学习场景下:通常存在于强化学习智能体的结构中,或者在环境的表示中。强化学习中的核心数学对象马尔可夫决策过程(MDP),实际上也是状态和动作的图。

去年,Petar 预测 2021 年我们将看到 GNN 在强化学习领域全面开花。令人惊讶的是,两位研究在强化学习中应用几何方法的研究者得出了截然相反的结论。

「2021 年,在强化学习中应用图逐渐变得成熟。」——Vitaly Kurin,牛津大学博士生

「图神经网络已经对机器学习的诸多领域产生了巨大影响,但是强化学习例外。尽管几年前人们持乐观态度,但是在 2021 年,原始的图神经网络仍未在强化学习领域引起巨大的轰动。」——Elise van der Pol,阿姆斯特丹大学博士生

虽然结论不同,但两人强调的研究内容大体相似。维塔利强调:在2021年,RL中出现了两组值得注意的图形。第一种方法为已建立的RL基准使用图形表示(包括基于注意的模型)来提高泛化/迁移能力。例如,我们在连续控制[75 76]、多智能体RL研究[77 78]和机器人协同适应[79 80]方面的工作。我对第二组非常感兴趣,它将RL应用程序领域扩展到具有基于图形的状态和操作空间的环境。这一类包括电网管理[81]、组合优化[82]和寻找反例以打开图论中的猜想[83]。

Vaitaly Kurin:

2021 年,图在强化学习领域主要被用于两个方面:(1)将图表示用于已建立的强化学习对比基准(包括基于注意的模型)来提高泛化/迁移能力。例如,我们在连续控制、多智能体强化学习研究和机器人协同适应方面的工作。(2)将强化学习的应用领域扩展到具有基于图的状态和动作空间的环境。这类应用包括电网管理、组合优化和寻找反例以启发图论中的猜想。

图是将强化学习落地到现实世界中的关键,它们广泛存在于工业(芯片设计、代码建模、药物发现)和科学应用(物理、化学、生物、经济学)中。2022年将见证新的强化学习对比基准的「大爆发」,这将引领强化研究走向更实用的方向,并激励基础研究。

Elise van der Pol:

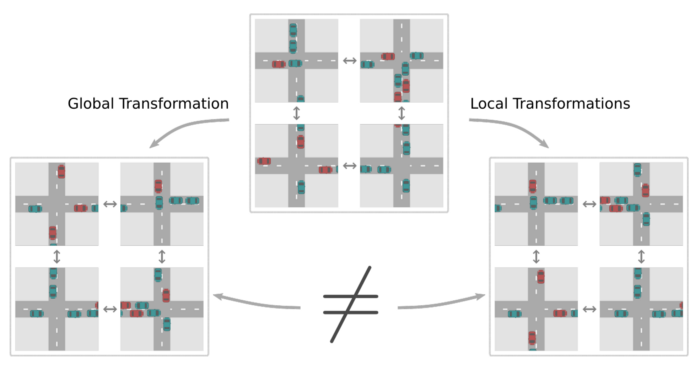

Kurin 等人的实验结果表明,即使在底层环境是图结构的情况下,与基于 Transformer 的方法相比,原始的图网络在强化学习方面性能较弱。虽然图网络还没有成为强化学习的一个更重要的部分,但 2021 年的一些研究工作仍说明了强化学习可以从图网络受益。例如:隐式规划与自监督学习的结合,使用 GNN 来引入归纳偏置、网络规划、编译器优化。此外,在2021年,我们还看到了对 Transformer 方法的一些初步研究,这些方法利用强化学习任务的序列化结构。也有人在多智能体强化学习中使用 Transformer 和 GAT 方法。此外,我们发现具有更多整合等变 GNN 的工作,例如:我们在等变多智能体协同方面的工作。

2022年,由于在普通图网络上取得了初步的成功,基于 Transformer 和类似 GAT 的方法将在强化学习中变得更加重要。基于图网络、等变性和强化学习的组合优化也有很大的潜力,例如在分子设计、网络规划和芯片设计方面。最后,互模拟、马尔科夫决策过程同态以及基于 GNN 的模型之间有更多的相互作用的空间。

图注:2021 年,几何深度学习在多智能体强化学习系统中的应用令人兴奋。它支持与任务的全局对称等变的策略函数,同时仍支持分布式运行。

03

AlphaFold 2 是几何机器学习领域的重要成果,也是结构生物学领域的范式转变

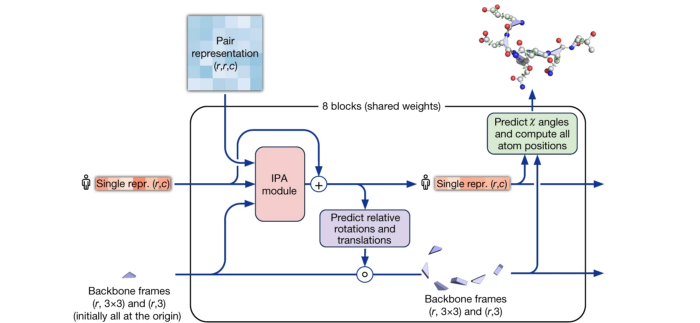

AlphaFold 2 是几何深度学习在 2021 年取得的重大进展,它是一种蛋白质结构预测架构,在蛋白质结构预测的关键评估(CASP14)竞赛中力压群雄。AlphaFold 2 模块的核心是不变点注意,它显式地考虑了蛋白质的几何形状。

Alexander Pritzel:

「过去几年间,深度学习成为了蛋白质结构预测的核心工具。」——Alexander Pritzel,DeepMind 研究科学家

2021年,我们发布了 AlphaFold 2 模型的源代码和一个由对大量模式生物的预测结果构成的数据库,我们计划将其扩展到大部分已知蛋白质。这使得研究人员可以使用预测的结构来解释他们的数据,从而加速了实验性蛋白质结构测定的进展。在映射蛋白质间相互作用网络方面也有初步的进展,例如:应用 AlphaFold 2 来理解真核生物相互作用以及人类蛋白质相互作用。2022年,我预计精确蛋白质结构预测的大数据集的出现将催生使用蛋白质结构预测蛋白质功能特性的新研究。

图推理是另一个我乐见其进展的领域。对于许多现实世界中的问题,不具备对底层图的先验知识,或者像分子图这样的自然图不是消息传递的图,所以图本身也是预测的一部分。通过使用模糊的传递性概念来推断图的想法是 AlphaFold 核心架构组件的动机之一。在过去的一年里,我们已经看到了机器学习成为生物学的核心工具,我希望看到该领域出现更多的工作,通过结合机器学习和实验方法,为细胞生物学的原子理解铺平道路。我也希望机器学习能够成为其它科学研究领域的核心工具。

图注:AlphaFold 2 在预测蛋白质折叠结构方面带来了突破,该架构的核心是通过几何等变性实现的「不变点注意力」模块。

AlphaFold 2 的成功让许多相关从业者重新评估了他们对几何深度学习的一些假设。此外,尽管 AlphaFold 2 可能是 2021 年最受关注的机器学习模型之一,但是 David Baker 的实验室在 2021 年完成的 RosettaFold 也令人印象深刻,它收到了 AlphaFold 思路和结果的启发,也是基于 SE(3)-等变性的几何深度学习架构。

Aasa Feragen :

AlphaFold 2 是微分几何问题被成功解决的范例,它提出了不变点注意力。在另外一些研究中,研究者们并没有显式地使用微分几何(例如,考虑拓扑的损失函数和配准模型,它们对无法保持拓扑的结果进行惩罚,但并没有真正量化它;另一些工作在不显式使用几何的情况下学习几何不变性)。

04

GNN 及其与 Transformer 模型的融合助力了药物研发和设计

针对小分子,GNN 也在一些任务中产生了一些重要的影响:推断溶解度或毒性、它们的量子化学性质,或它们作为候选药物的效果。

唐建:

「图机器学习通过在药物和材料发现方面的应用不断促进分子建模领域的发展。」——唐建,Mila 助理教授

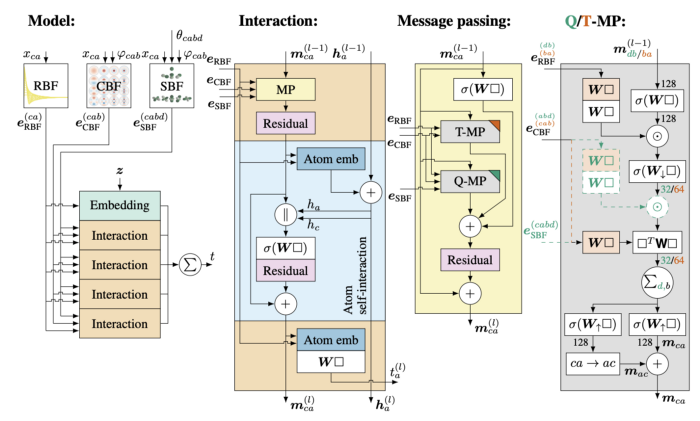

GemNet 算法尤其令我印象深刻,它为三维分子结构建模提供了一个通用的、富有表达力的框架,并在分子动力学仿真、公开的催化剂发现竞赛等任务中取得了目前最优的性能。2022 年,我相信我们会在这个方向上看到更多激动人心的进展(例如,蛋白质建模)。

图注:GemNet 是 2021 年活跃的图神经网络分子建模领域的亮点工作。

Dominique Beaini:

「由于分子具有图结构,并且知识图谱在有关蛋白质功能和疾病的研究中无处不在,药物发现是 GNN 研究中最火热的课题之一。」——Dominique Beaini,Valence Discovery 公司深度学习主任研究员

在药物发现领域中,根据分子图预测量子交互和三维结构是理解化学的最具挑战性的方面。尽管已经出现了一些关于该主题的研究工作,但模型往往过于具体,专为解决某一问题而设计,并不知道这些 3D 的知识在多大程度上可以迁移到不相关的任务中。相反,一个可以学习量子结构的通用 GNN 将能够将学习到的嵌入迁移到任何新的任务中,但这只有通过全连接 Transformer 才能实现,它可以捕获分子图以外的相互作用。

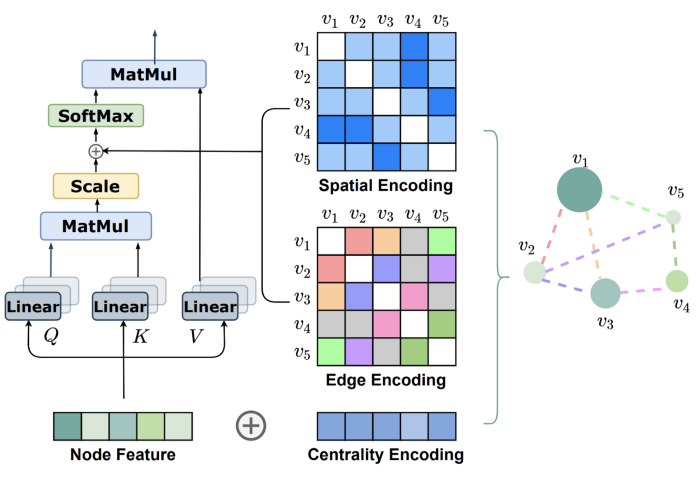

2021 年,一系列研究成功地将 Transformer 推广到图上。在 NeurIPS 2021 上,出现了两个在图数据上取得了优异性能的 Transformer 架构,即 SAN 和 Graphormer。Graphormer 在 OGB LSC 竞赛和 Facebook 催化剂竞赛中夺魁,展示出 Transformer 可以更好地捕获量子结构。Graphormer 在 OGB-molPCBA 排行榜上一骑绝尘,其学习到的嵌入可以迁移到不相关的生物任务中。图 Transformer 在小分子建模任务上取得了最先进的性能。

2022 年,关于图 Transformer 的更基本的挑战将得以解决。尽管图 Transformer 取得了初步的成功,但是它们在表达能力、对图结构的理解以及对更大图的可扩展性方面仍然有缺陷。我们希望在 2022 年解决这些问题。Transformer 将改变我们捕获量子和 3D 信息的方式,改变我们生成分子的方式,改变我们在化学任务之间迁移知识的方式。

Tianle Cai:

「2021 年,将 Transformer 架构引入图机器学习领域取得了令人激动的进展,各项研究通过不同的方法引入了图结构信息。」——Tianle Cai,普林斯顿大学博士生

Graphormer 在量子化学和分子动力学任务上的成功表明了 GNN 在科学计算方面的能力和潜力。此外,我们可以为 GNN 设计一些天然的对称性,这将使模型具备物理上的动机。

Transformer 架构在自然语言处理领域的流行很大程度上归功于我们可以使用在大数据集上预训练的模型(如 BERT、GPT、ViT 或 CLIP),这些模型似乎具有很好的泛化性能。图Transformer 架构具有很强的表达能力,但其泛化能力需要有足够的数据量来保证。

全连接图注意力的计算复杂度也是一个挑战:Transformer 具有关于节点数的平方级的时间和空间复杂度,这使得它难以处理大规模图。应该开发降低这种复杂度的技术,以便在更大的图上使用图 Transformer。

图注:Graphormer 采用了 Transformer 主干网络,同时针对图进行了创新。实验结果表明,Graphormer 是 2021 年最成功的 GNN 之一,尤其是对于计算化学的大规模挑战而言。

我们要进一步拓展当前的方法。从数据的角度来说,我们可以在更大的数据集上进行预训练,或使用 Sim2Real 的思路生成更多的数据。从模型的角度来说,我们可以设计线性图 Transformer 这种更高效的结构,或引入图粗化或采样技术。

05

AI主导的药物发现技术越来越多地使用了几何和图机器学习

虽然小分子建模的进展已经促成了虚拟药物筛选方面的突破,但将它们与 AlphaFold 的结构生物学结果相结合,可以为整个药物发现流程中大量重要应用打开大门。药物发现领域的许多新兴初创公司都意识到了这一点,并表示人工智能主导的药物发现方法是可行的。

Nathan Benaich:

几何和图机器学习方法在基于网格的仿真、mRNA 和蛋白质的结构预测等问题上取代了经典方法。展望未来,我希望几何和图机器学习能够解决自然科学和物理科学中越来越多的问题。实际上,这可能意味着人工智能主导的药物和材料设计的有效性将实现飞跃,特别是在多参数优化、性质预测和结合(Binding)方面。我期望在克服大型几何和图机器学习的内存瓶颈,以及解决深度对模型性能的影响等方面取得进展。

Dominique Beaini:

AlphaFold 最近在预测蛋白质折叠方面的成功激发了科学界的热情,即机器学习将对生物研究产生重大影响。许多公司正在利用 GNN 的最新进展,构建强大的药物发现平台。

融合这些进展的最直接的方法之一是为了融合这些进展,我们需要提供更精确的模型,以了解分子如何相互作用。到目前为止,大多数新兴技术都专注于分析分子。打破这一假设可能会带来一些迄今为止最令人兴奋的图表示学习应用。

「图机器学习已经改变了分析单个蛋白质(特别是小分子)的方式。但是如何建模它们之间的相互作用呢?」——Hannes Stärk,慕尼黑工业大学硕士生

图机器学习在分子预测方面的能力已被证实,GNN 在抗生素发现等重要领域取得了成功。利用分子的三维几何结构,图机器学习还通过 3D GNN(如 GemNet)或分子动力学(如NequIP)推动了量子化学的发展。E(3)-等变 GNNs 和几何深度学习已经成为对分子进行学习的重要元素。

3D GNN 也在蛋白质表示学习方面展现出了的强大性能,它们通过一些方法使在大分子上的计算得以进行。关于蛋白质的图机器学习极大地推进了蛋白质结构预测,从而推进了整个分子生物学领域的发展。

考虑到图机器学习在对单个分子进行预测的重要作用,我认为在建模分子相互作用方面的突破即将到来。虽然预测分子的固有特性很有趣,但了解蛋白质的相互作用,或者分子如何与病毒相互作用以抑制其功能,通常会有更现实的意义。2021 年,一些工作已经开始利用几何深度学习方法预测蛋白质与小分子或其它蛋白质相互作用的原子构型。

图机器学习在考虑几何性质的结合预测、预测多个分子的原子如何运动、预测分子存在交互关系时构象如何改变等方面具有很大的潜力。原有的引入 3D 信息很难处理这些涉及对多个分子建模的应用。因此,出现了许多创造性的想法来获取对称性和有关特定分子相互作用的先验几何知识。2022 年,图机器学习有望助力分子相互作用预测的发展。

06

基于图的方法助力量子机器学习

Guillaume Verdon:

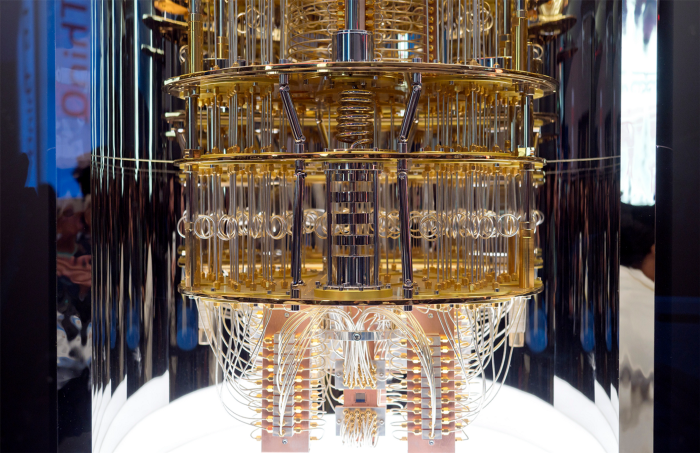

量子机器学习是机器学习和量子计算交叉的新兴研究领域,近年来,随着经典不可模拟量子计算机的出现,学术界和工业界对该领域的兴趣激增。量子机器学习能够从量子数据中学习量子模型和表示。由于自然本身可以通过量子力学解释,学习数据的量子表示可以帮助我们扩展经典机器学习的范围,在其本质层面上对自然建模。2021年,谷歌在 Sycamore 处理器上进行的实验证明了量子数据的量子机器学习具有指数级的扩展优势。对于该领域来说,这是令人激动的里程碑事件。

然而,量子机器学习仍然面临着一些挑战,主要的障碍是设计可伸缩、可训练、泛化性强的量子神经网络架构。最近,有一些研究工作从经典 GNN 中获得灵感,提出了相应的量子神经架构来解决这些问题,并成功地在量子硬件实现。量子系统的演化通常是由所谓的哈密顿量控制的,对于大多数系统来说,子系统(图)之间存在局部的耦合性。因此,在量子架构中添加图结构归纳偏置,对于建模量子系统的动力学和平衡特性是非常自然的。

「量子物理系统通常具有丰富和深刻的群对称性,可以用于量子架构设计,从而进一步提高使用量子计算机对这些系统建模的能力。2022 年,探索图以外的量子版几何深度学习理论,是一个令人激动的扩展图量子机器学习研究的方向。」——Guillaume Verdon,Alphabet X 量子机器学习主管

图注:量子计算机会是几何机器学习的下一个前沿吗?

参考链接参见原文:

https://towardsdatascience.com/predictions-and-hopes-for-geometric-graph-ml-in-2022-aa3b8b79f5cc#0b34

83

83

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?