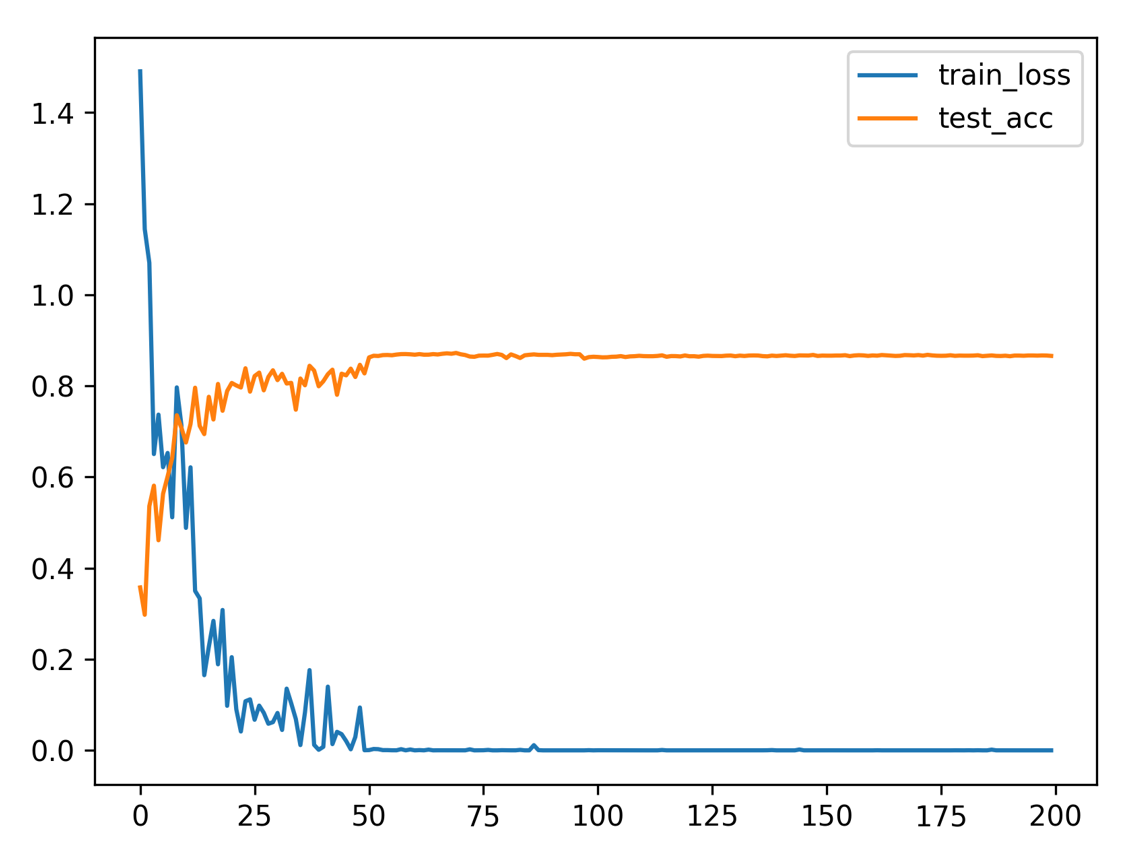

在上一篇博客中,使用深度学习的 ResNet34 网络在 CIFAR10 数据集上进行训练和测试,在100轮的实验中,ResNet34 网络取得了80%左右的准确率。相较于 LeNet-5 网络,准确率有了很大的提升。本篇文章将对上一次的 ResNet34 网络进行改进,主要改进的点有:

-

在最开始的卷积层中用更小(3*3)的卷积核,而且不缩小图片尺寸,相应的最后的平均池化的核改成4*4

class ResNet18(nn.Module): def __init__(self, block): super(ResNet18, self).__init__() self.conv1 = nn.Sequential( nn.Conv2d(3, 64, kernel_size=3, stride=1, padding=1), nn.BatchNorm2d(64), nn.ReLU(), nn.MaxPool2d(kernel_size=3, stride=1, padding=1) ) ...... self.avg_pool = nn.AvgPool2d(kernel_size=4) self.outlayer = nn.Linear(512, 10) -

在训练过程中调整学习率,每50个epoch,学习率降低0.1倍

if epoch % 50 == 0: lr = optimizer.state_dict()['param_groups'][0]['lr'] * (0.1 ** (epoch // 50)) for params in optimizer.param_groups: params['lr'] = lr

运行200个迭代,准确率提升了大约6%,达到了86%。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?