点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

论文作者 | 汽车人

编辑 | 自动驾驶之心

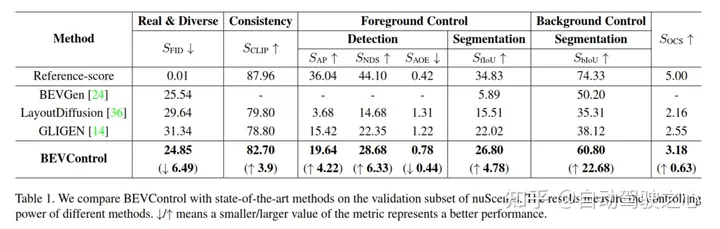

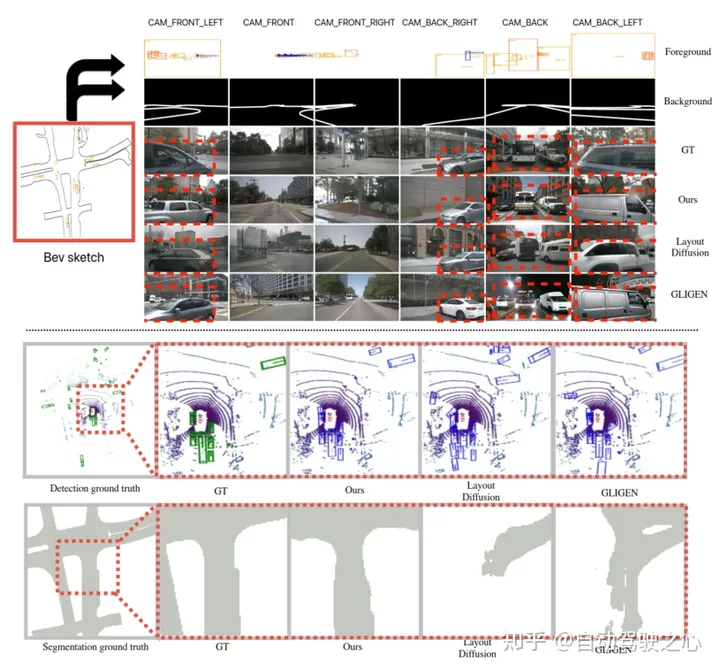

提升合成数据生成的质量,以及长尾场景的收集。实验表明,BEVControl在前景分割mIoU上显著优于最先进的方法BEVGen,从5.89提高到26.80。此外,表明,使用BEVControl生成的图像来训练下游感知模型,NDS得分平均提高1.29。

❝论文链接:BEVControl: Accurately Controlling Street-view Elements with Multi-perspective Consistency via BEV Sketch Layout

作者单位:天津大学,IHPC and CFAR,西湖大学

使用合成图像来提高感知模型的性能是计算机视觉中长期存在的研究挑战。它在具有多视图相机的以视觉为中心的自动驾驶系统中变得更加突出,因为一些长尾场景永远无法收集。在BEV分割布局的指导下,现有的生成网络在仅根据场景级别的指标进行评估时,似乎能够合成照片逼真的街景图像。然而,一旦放大,它们通常无法产生准确的前景和背景细节。为此,作者提出了一种两阶段生成方法,称为BEVControl,可以生成准确的前景和背景内容。与类似分割的输入相比,它还支持草图样式的输入,这对人类编辑来说更灵活。此外,提出了一个全面的多级评估协议,以公平地比较生成的场景、前景目标和背景几何体的质量。实验表明,BEVControl在前景分割mIoU上显著优于最先进的方法BEVGen,从5.89提高到26.80。此外,表明,使用BEVControl生成的图像来训练下游感知模型,NDS得分平均提高1.29。

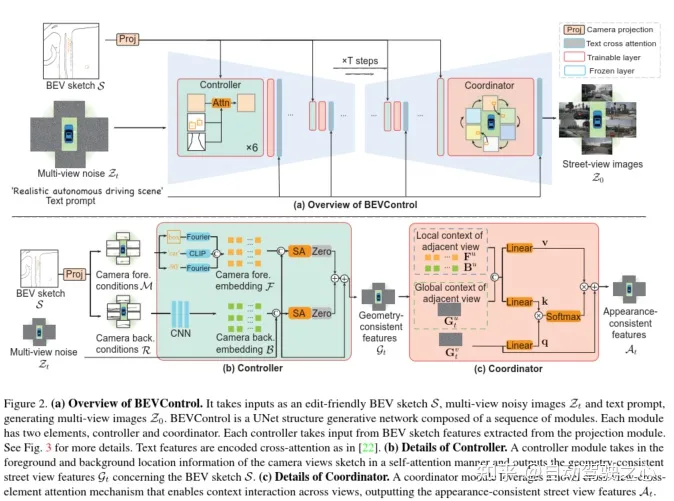

网络结构

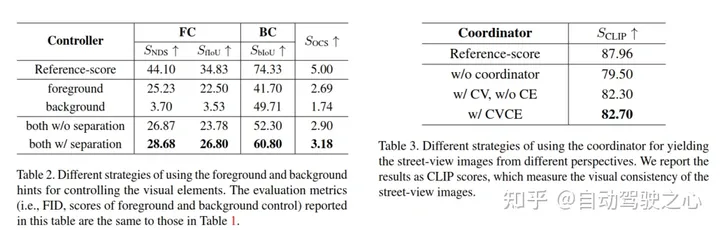

(a) BEV控制概述。它将输入作为编辑友好的BEV草图S、多视图噪声图像Zt和文本提示,生成多视图图像Z0。BEVControl是一个由一系列模块组成的UNet结构生成网络。每个模块有两个元素,控制器和协调器。每个控制器从投影模块中提取的BEV草图特征中获取输入,文本特征被编码为交叉注意。(b) 控制器的详细信息。控制器模块以自关注的方式获取摄像机视图草图的前景和背景位置信息,并输出与BEV草图S有关的几何一致的街景特征Gt。(c)协调器的细节,协调器模块利用一种新颖的跨视图跨元素注意力机制,实现跨视图的上下文交互,输出外观一致的街景特征At。

实验结果

① 全网独家视频课程

BEV感知、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、协同感知、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码学习)

视频官网:www.zdjszx.com

视频官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

近2000人的交流社区,涉及30+自动驾驶技术栈学习路线,想要了解更多自动驾驶感知(2D检测、分割、2D/3D车道线、BEV感知、3D目标检测、Occupancy、多传感器融合、多传感器标定、目标跟踪、光流估计)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、AI模型部署落地实战、行业动态、岗位发布,欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频,期待交流!

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦目标检测、语义分割、全景分割、实例分割、关键点检测、车道线、目标跟踪、3D目标检测、BEV感知、多模态感知、Occupancy、多传感器融合、transformer、大模型、点云处理、端到端自动驾驶、SLAM、光流估计、深度估计、轨迹预测、高精地图、NeRF、规划控制、模型部署落地、自动驾驶仿真测试、产品经理、硬件配置、AI求职交流等方向。扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】平台矩阵,欢迎联系我们!

146

146

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?