简介

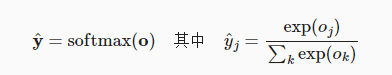

softmax函数能够将未规范化的预测变换为非负数并且总和为1,同时让模型保持 可导的性质。 为了完成这一目标,我们首先对每个未规范化的预测求幂,这样可以确保输出非负。 为了确保最终输出的概率值总和为1,我们再让每个求幂后的结果除以它们的总和。如下式:

手动实现的原理

1.随机w 和b,然后 Y= wX+b

2.确定softmax 函数 用于热编码

3.然后定义模型net, softmax(线性回归)

4.确定损失函数,这个损失函数是怎么求的?

取每一个的softmax(线性回归的值) 当中正确预测的概率,

看样子softmax 的损失函数就是预测的改了,

5.然后在梯度下降,修改w的值

937

937

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?