Retinal vessel segmentation of color fundus images using multiscale convolutional neural network with an improved cross-entropy loss function

采用改进的交叉熵损失函数的多尺度卷积神经网络对彩色眼底图像进行视网膜血管分割

关键词:视网膜血管分割、卷积神经网络、多尺度、叉损失函数、条件随机场

摘要

本文提出了一种基于卷积神经网络(CNN)和全连通条件随机场CRFs的眼底图像视网膜血管分割方法。分割过程主要分为两个步骤。首先,提出了一种改进的交叉熵损失函数的多尺度CNN结构来生成图像间的概率图。结合各中间层的特征图构造多尺度网络,以获取视网膜血管的更多细节信息。同时,我们提出的交叉熵损失函数忽略了相对简单样本的最小损失,以便更多地关注难样本的学习。其次,利用CRFs得到最终的二值分割结果,该方法考虑到眼底图像中所有像素之间的相互作用,利用更多的空间上下文信息。在两个公共数据集上对该方法的有效性进行了评价。与包括五种基于深度学习的方法在内的11个最先进的学习方法进行比较。结果表明,该方法可以检测到更多的微小血管,并能更精确地定位边缘。

1.介绍

现有的分割方法可以根据是否使用了标注的ground truth,将其分为有监督的和无监督的两类。显然,无监督的方法是根据血管的固有特征设计的,而不是依赖于手工标记的map。这些无监督的方法在不使用基本事实的情况下,根据血管结构和一些先验知识检测视网膜血管时表现良好。

同时,监督方法从注释结果中学习规则提取视网膜血管。一般来说,这些方法大多依靠先验知识或一系列复杂的处理来获得鉴别特征。

卷积神经网络CNN在不需要先验知识和额外预处理的情况下,通过一些卷积和池操作自动学习层次特征。近年来,由于CNN的高效率,在计算机视觉、医学图像处理、模式识别等方面得到了广泛的应用[13,14]。

为了更有效地分割视网膜血管,本文提出了一种结合多尺度CNN和CRFs的监督图像对图像的视网膜血管分割系统。首先,我们使用多尺度CNN得到一个概率图。提出的CNN模型采用多尺度结构,融合了丰富的多尺度信息,用于血管特征的综合描述。同时,我们开发了一种改进的损失函数,用于强调硬实例,有效地检测小目标,克服不平衡问题。然后,为了平滑粗概率图,我们将CNN输出概率图定义为CRFs模型的一元势,得到最终的分割图。最后,我们对两个公共数据集进行了实验,并进行了性能评估,验证了分割效果。在这两个数据集上的结果表明,我们的方法在灵敏度和准确性方面优于大多数最近的方法。这项工作的贡献主要体现在CNN建设的两个方面。

- 我们把所有中间的卷积特征都放到最后CNN分类器学习更丰富的多尺度信息[17],从而可以精确定位血管边缘,检测更多的微小血管。特别是结合各层的特征,充分利用各尺度的信息,提高了对血管边缘和微小薄壁血管的检测精度。

- 我们提出了一种改进的类平衡交叉熵损失函数,通过对血管边缘、细小薄血管等硬样本的分割,进一步提高了分割性能。

2.方法

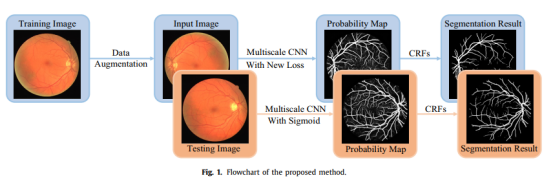

该方法的流程图如图1所示。我们首先提出一个多尺度CNN来学习概率图。采用多尺度CNN结构,从彩色眼底图像中识别特征。同时,提出了一种改进的交叉损耗函数,以突出实例。此外,我们使用CRF来减少噪声和边缘模糊,从而细化概率图,得到最终的分割结果。上述步骤的细节如下。

2.1多尺度卷积神经网络

2.1.1网络结构

所提出的多尺度CNN架构的框架如图2所示。我们的基本多尺度CNN结构来自于更丰富的卷积特征(RCF)[17],这是用于边缘检测任务的最新框架,它结合了完全卷积神经网络[18]和深度监督网络[19]的思想来检测图像到图像的边缘。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

438

438

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?