FT代表从时域到谱域的单个变换,而FrFT使我们能够在时间和频率之间的连续中间域上扫描变换族,由分数阶参数控制。

作为FT的直接推广,FrFT既以最简单的可能方式继承了FT的能力,又提供了额外的自由度,使得可选变换的连续体(因此神经模型中的可选信息流)是可访问的。

FNet的动机是获得具有无参数层的模型,是单个线性变换,而不是注意层。

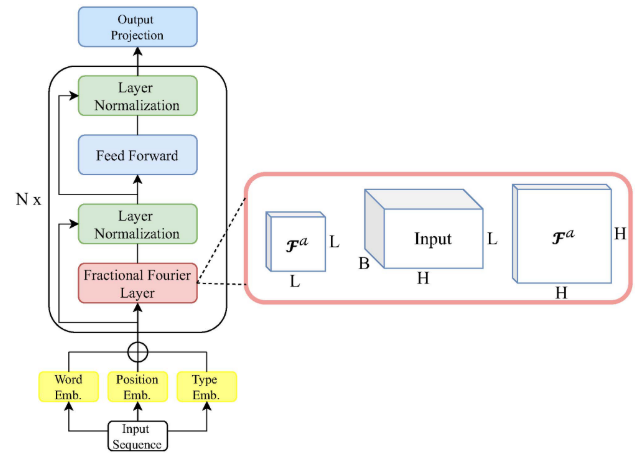

FrFNet体系结构由N个连续的编码器组成。使用FrFT层代替注意层。通过DFrFT矩阵计算输入层的FrFT

L:maximum sequence length

H:hidden dimension size

B:batch size

论文提出的FrFNet中,使用FrFT模块代替了注意力块,并在其中进行了离散DFrFT

首先,针对给定的分数阶和维数计算DFrFT矩阵

然后,通过矩阵乘法计算输入的2D-FrFT,由于DFrFT矩阵计算一次,因此没有额外成本。此外,与注意机制的线性变换不同,DFrFT不存在反向传播成本,因为它是确定性函数。

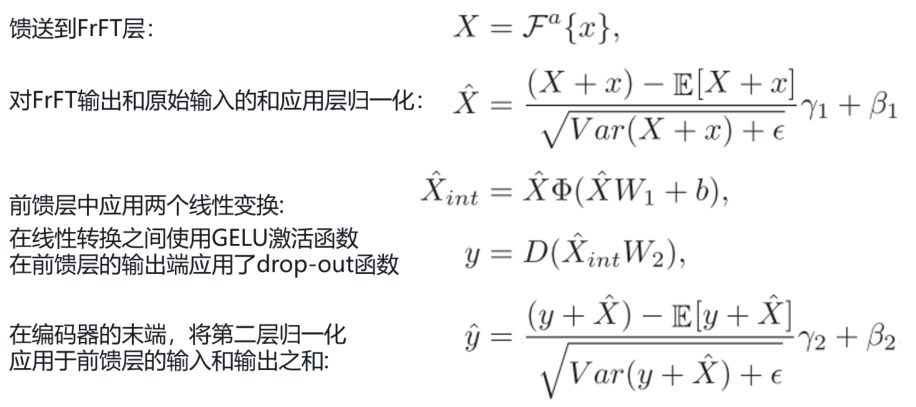

通过编码器层的FrFNet的数学表示如下:

其中x是输入嵌入或前一编码器的输出。γ1、β1、γ2和β2是层归一化的可学习参数。用于数值稳定性。W1、W2和B是前馈网络中的线性变换参数和偏置。Φ是高斯分布的累积分布函数。最后,D表示 drop-out 函数

在最后一个编码器块的末尾,对输出对数应用输出投影:

![]()

FrFNet减少了对于FNet的冗余性:

因此DFT具有共轭对称性。在二维矩阵中,M和N是维数,X[M− u,N − v]= X∗[u,v]。FNet模型忽略此属性,并由于重复的真实的值而进行冗余计算。然而,除非a =1,否则分数变换中不存在共轭对称。因此,FrFNet模型不执行任何冗余计算。

论文代码地址:

3020

3020

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?