引言

去年在一家公司实习,接触了一点人工智能。既然接触人工智能,那么语音识别、语音合成、人脸识别等等都是必不可少的。

本来已经是离开iOS开发这条路了,还剩下毕业设计要做,所以这段时间最后一次回来接触iOS了。

以后,估计没什么机会再接触iOS,都往着机器学习、深度学习方向去了。

废话不说了,记录一下,如何接入讯飞语音。

步骤

- 一、官网下载SDK

去讯飞语音开放平台下载iOS的SDK

讯飞语音开放平台

当然,你需要创建一个应用,然后才能下载iOS的SDK,应用选择语音识别的类型。(这里只是演示语音识别类型的接入,其余语音合成、人脸识别等等自己可以试试)

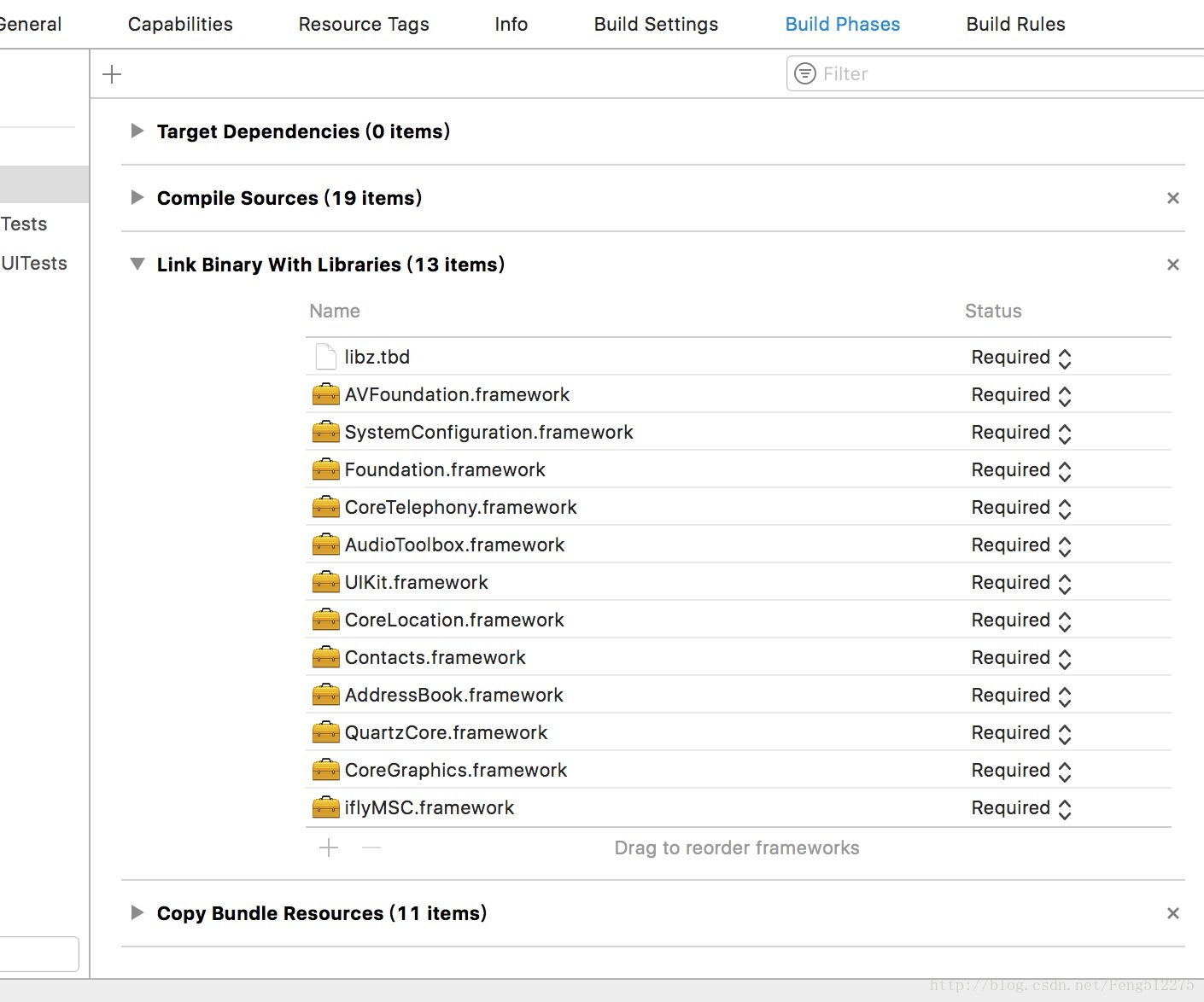

- 二、工程导入相应的包和文件

这里仅演示在线语音识别,离线的请按照文档来操作

iOS讯飞操作文档

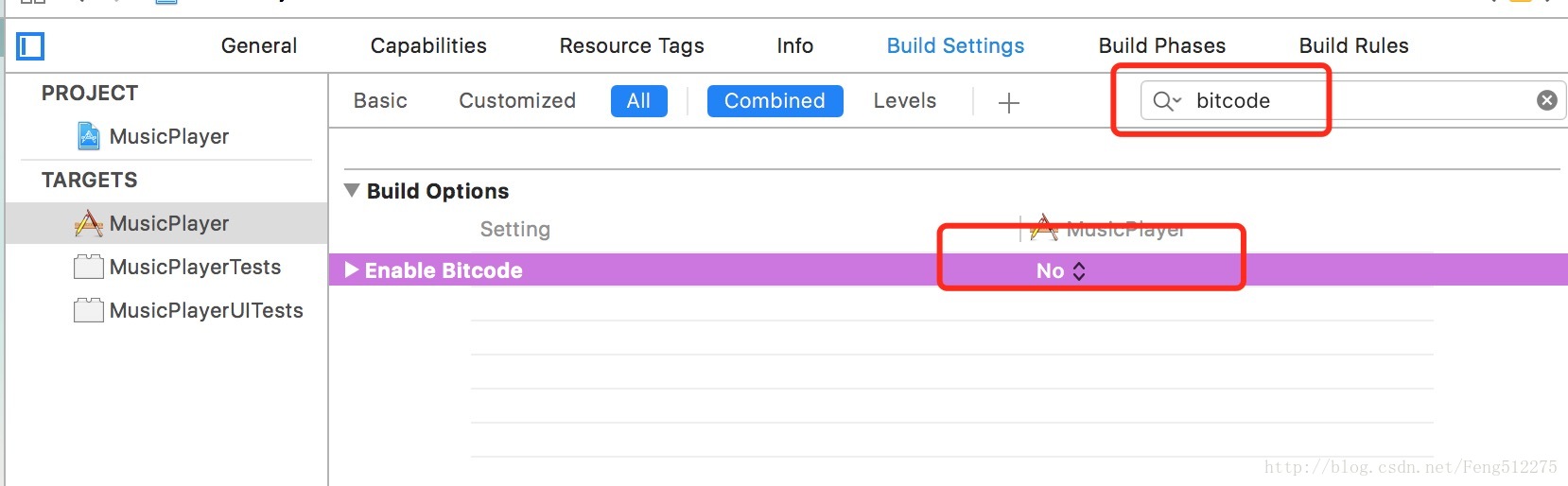

- 三、设置系统参数

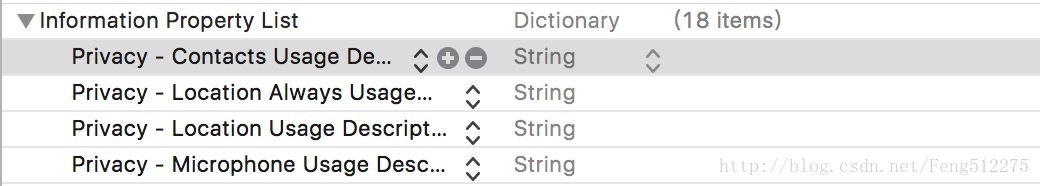

用户隐私权限配置

iOS 10发布以来,苹果为了用户信息安全,加入隐私权限设置机制,让用户来选择是否允许。

隐私权限配置可在info.plist 新增相关privacy字段,MSC SDK中需要用到的权限主要包括麦克风权限、联系人权限和地理位置权限:

<key>NSMicrophoneUsageDescription</key>

<string></string>

<key>NSLocationUsageDescription</key>

<string></string>

<key>NSLocationAlwaysUsageDescription</key>

<string></string>

<key>NSContactsUsageDescription</key>

<string></string>- 四、代码初始化

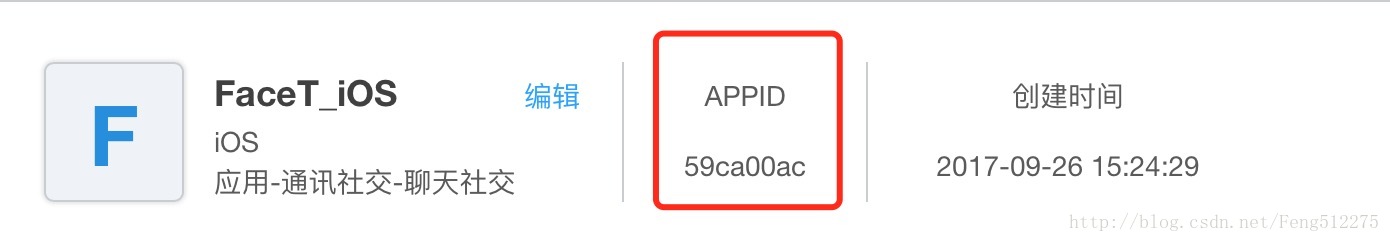

//Appid是应用的身份信息,具有唯一性,初始化时必须要传入Appid。

NSString *initString = [[NSString alloc] initWithFormat:@"appid=%@",xunfeiID];

[IFlySpeechUtility createUtility:initString];ID就是对应图片的ID。

建议把上面这段代码放在AppDelegate.m中

- (BOOL)application:(UIApplication *)application didFinishLaunchingWithOptions:(NSDictionary *)launchOptions方法里面初始化。

PS:要导入头文件#import "IFlyMSC/IFlyMSC.h"这个头文件,没有智能提示,文档里面我好像也没看到,还有我去年写的时候有备份(下面我会狠狠吐槽讯飞)

示例代码

- (BOOL)application:(UIApplication *)application didFinishLaunchingWithOptions:(NSDictionary *)launchOptions {

//Appid是应用的身份信息,具有唯一性,初始化时必须要传入Appid。

NSString *initString = [[NSString alloc] initWithFormat:@"appid=%@",xunfeiID];

[IFlySpeechUtility createUtility:initString];

}//

// MMusicViewController.m

// MusicPlayer

//

// Created by HZhenF on 2018/2/18.

// Copyright © 2018年 LiuZhu. All rights reserved.

//

#import "MMusicViewController.h"

#import "IFlyMSC/IFlyMSC.h"

本文档详细介绍了在iOS应用中接入讯飞语音识别的步骤,包括下载SDK、配置隐私权限、初始化代码,并对讯飞的开发文档提出了批评。在实现语音识别功能的同时,作者表达了对讯飞SDK更新后文档不足的失望。

本文档详细介绍了在iOS应用中接入讯飞语音识别的步骤,包括下载SDK、配置隐私权限、初始化代码,并对讯飞的开发文档提出了批评。在实现语音识别功能的同时,作者表达了对讯飞SDK更新后文档不足的失望。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3362

3362

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?