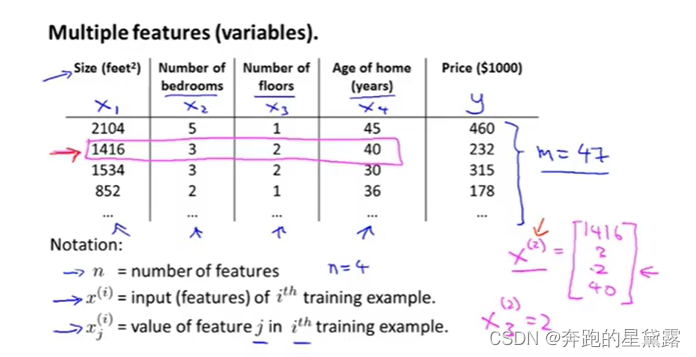

(1)符号表示

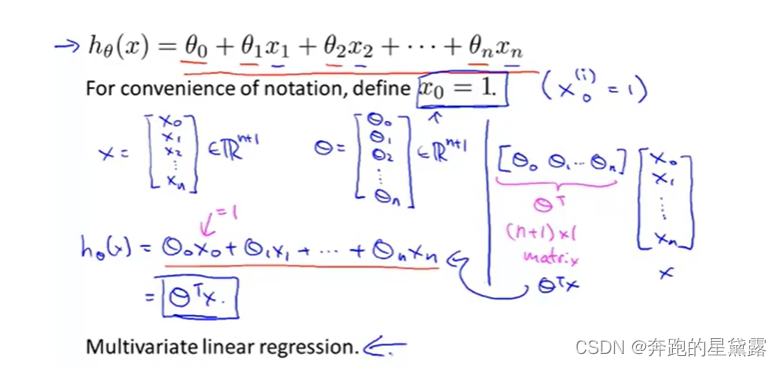

(2)假设函数

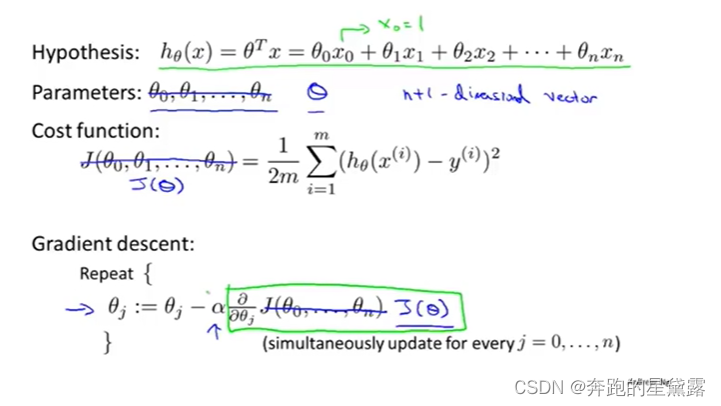

(3)损失函数

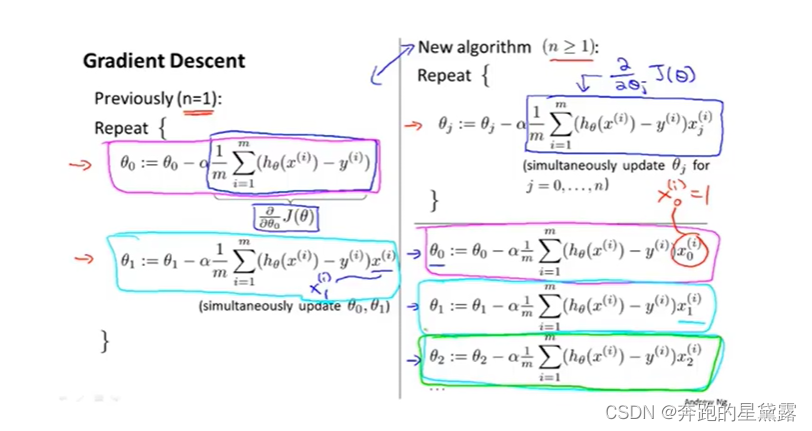

(4)梯度下降法用于多变量线性回归

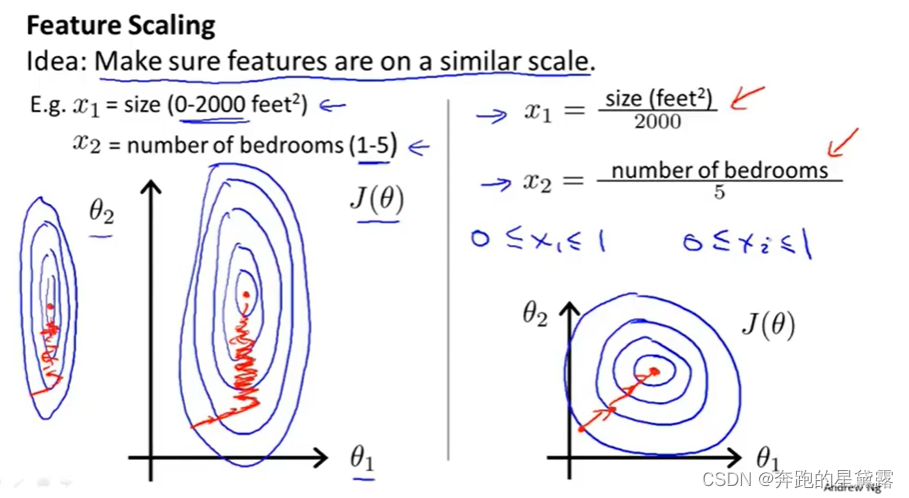

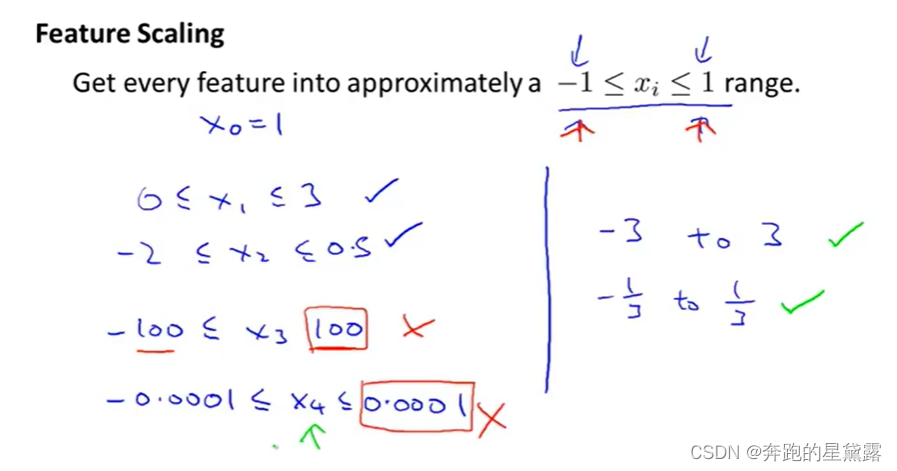

(5)特征缩放

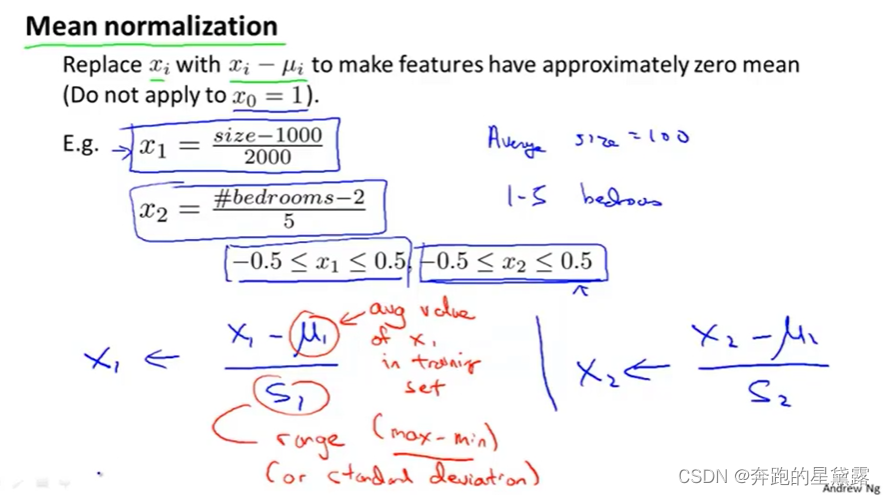

(6)均值归一化

【目的:让梯度下降速度更快,收敛迭代次数更少】

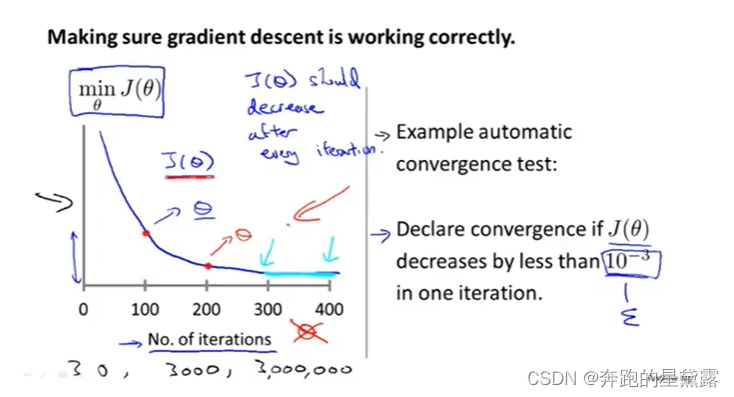

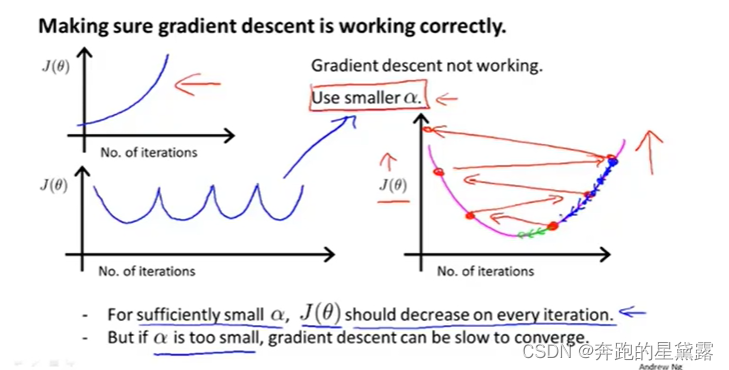

(7)代价函数与迭代次数

【右侧为自动收敛检测】

【学习速率过大,可能无法达到收敛】

【选择更小的学习速率已到达收敛】

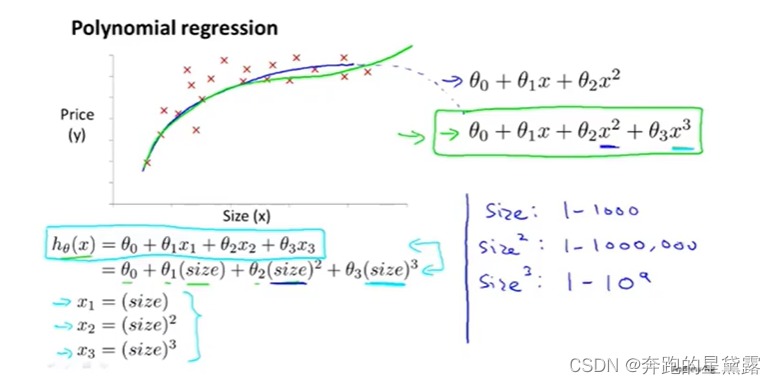

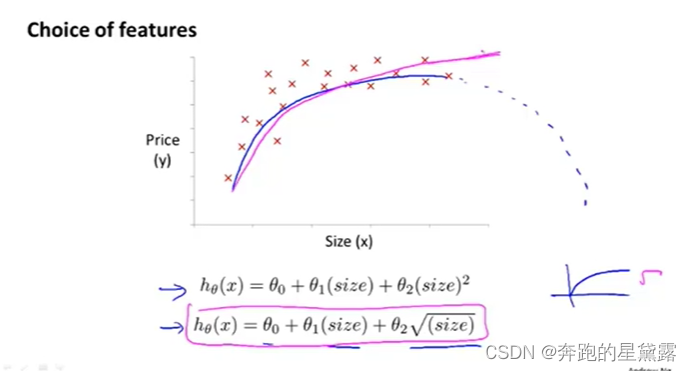

(8)多项式回归

【通过设置变量与变量之间的关系转化为线性回归】

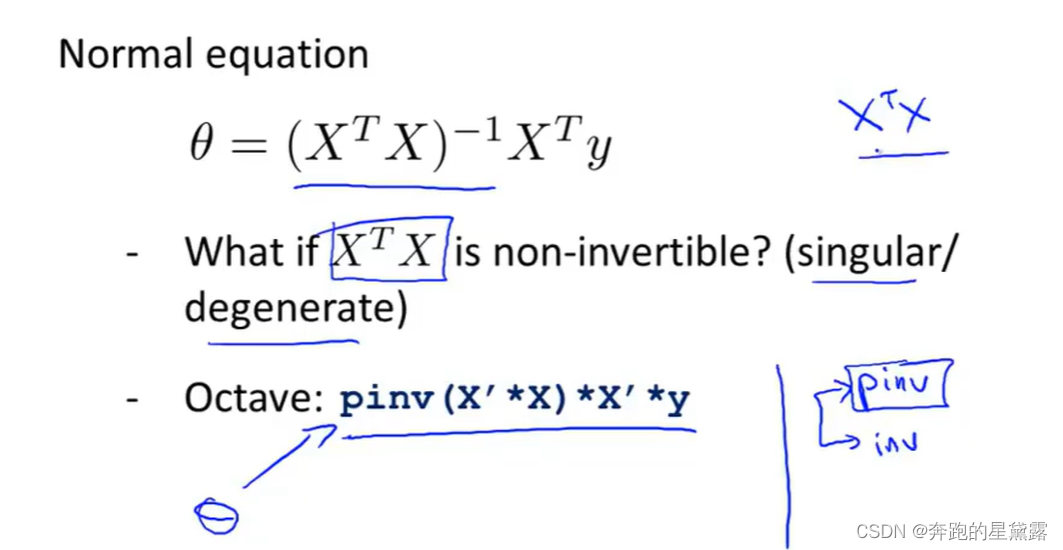

(9)正规方程

【不需要特征缩放】

【梯度下降与正规方程之间的对比】

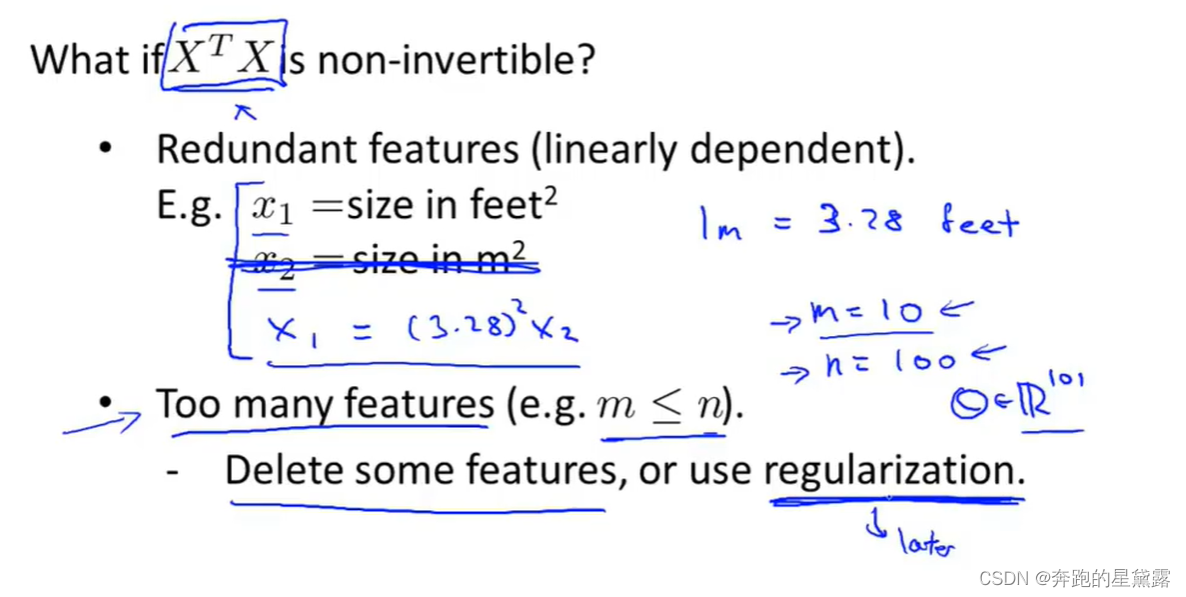

【X^T X 不可逆在pinv(伪逆)也可以求解 // inv(逆)】

【若发现X^T X 不可逆的解决方案

1. 检查是否有多余的特征,如果有多余的就删掉,直到没有多余的为止

2. 检查是否有过多的特征,若特征过多,如果少一些不影响的话,删掉一些特征,或者正则化

266

266

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?