0 前言

🔥这两年开始毕业设计和毕业答辩的要求和难度不断提升,传统的毕设题目缺少创新和亮点,往往达不到毕业答辩的要求,这两年不断有学弟学妹告诉学长自己做的项目系统达不到老师的要求。

为了大家能够顺利以及最少的精力通过毕设,学长分享优质毕业设计项目,今天要分享的是

🚩 毕业设计 深度学习街道行人流量计数系统

🥇学长这里给一个题目综合评分(每项满分5分)

难度系数:3分

工作量:3分

创新点:4分

🧿 项目分享:见文末!

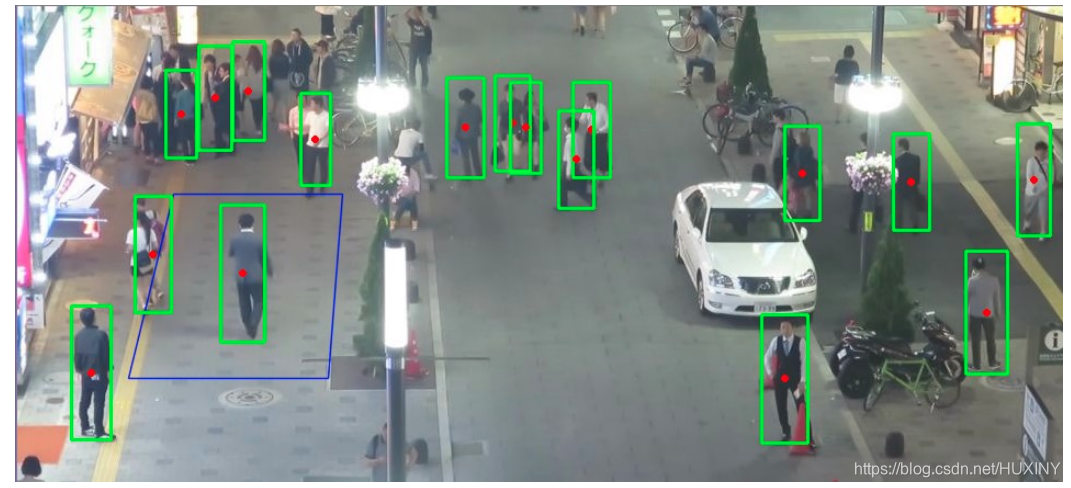

1 项目运行效果

视频效果:

毕业设计 深度学习街道行人流量计数系统

2 设计概要

行人跟踪( Pedestrian Detection)是利用计算机视觉技术判断图像或者视频序列中是否存在行人并给予精确定位,并在后续视频中跟踪行人。该技术可与行人重识别等技术结合,应用于人工智能系统、车辆辅助驾驶系统、智能机器人、智能视频监控、人体行为分析、智能交通等领域。由于行人兼具刚性和柔性物体的特性 ,外观易受穿着、尺度、遮挡、姿态和视角等影响,使得行人跟踪成为计算机视觉领域中一个既具有研究价值同时又极具挑战性的热门课题。

1.对单个行人跟踪分析并建立数学模型:

(1)了解视频数据的特点

(2)根据视频数据确定相应的算法

(3)建立整个过程的数学模型

2.行人检测的设计:

(1)了解行人检测的原理

(2)对比几种行人检测的方法确定合适的算法

(3)理解并掌握该行人检测的方法

(4)编程实现该算法

3.行人跟踪的设计:

(1)了解行人跟踪的原理

(2)对比几种跟踪的方法并选出合适的算法

(3)理解并掌握该行人检测的方法

(4)编成实现该算法

4.编程的实现:

(1)利用python实现程序的编写

(2)实现整个行人跟踪过程的控制

2 原理介绍

这里以一个简单的demo进行原理介绍。

2.1 目标检测概况

什么是目标检测?

目标检测,粗略来说就是:输入图片/视频,经过处理,得到:目标的位置信息(比如左上角和右下角的坐标)、目标的预测类别、目标的预测置信度(confidence)。

发展阶段

-

手工特征提取算法,如VJ、HOG、DPM

-

R-CNN算法(2014),最早的基于深度学习的目标检测器之一,其结构是两级网络:

- 1)首先需要诸如选择性搜索之类的算法来提出可能包含对象的候选边界框;

- 2)然后将这些区域传递到CNN算法进行分类;

-

R-CNN算法存在的问题是其仿真很慢,并且不是完整的端到端的目标检测器。

-

Fast R-CNN算法(2014末),对原始R-CNN进行了相当大的改进:提高准确度,并减少执行正向传递所花费的时间。

是,该模型仍然依赖于外部区域搜索算法。 -

faster R-CNN算法(2015),真正的端到端深度学习目标检测器。删除了选择性搜索的要求,而是依赖于

- (1)完全卷积的区域提议网络(RPN, Region Purpose Network),可以预测对象边界框和“对象”分数(量化它是一个区域的可能性的分数)。

- (2)然后将RPN的输出传递到R-CNN组件以进行最终分类和标记。

-

R-CNN系列算法,都采取了two-stage策略。特点是:虽然检测结果一般都非常准确,但仿真速度非常慢,即使是在GPU上也仅获得5 FPS。

-

one-stage方法有:yolo(2015)、SSD(2015末),以及在这两个算法基础上改进的各论文提出的算法。这些算法的基本思路是:均匀地在图片的不同位置进行密集抽样,抽样时可以采用不同尺度和长宽比,然后利用CNN提取特征后直接进行分类与回归。

整个过程只需要一步,所以其优势是速度快,但是训练比较困难。 -

yolov3(2018)是yolo作者提出的第三个版本(之前还提过yolov2和它们的tinny版本,tinny版本经过压缩更快但是也降低了准确率)。

2.2 行人检测

这里学长以行人检测作为例子来讲解目标检测。

行人检测简介

行人检测( Pedestrian Detection)一直是计算机视觉研究中的热点和难点。行人检测要解决的问题是:找出图像或视频帧中所有的行人,包括位置和大小,一般用矩形框表示,和人脸检测类似,这也是典型的目标检测问题。

行人检测技术有很强的使用价值,它可以与行人跟踪,行人重识别等技术结合,应用于汽车无人驾驶系统(ADAS),智能机器人,智能视频监控,人体行为分析,客流统计系统,智能交通等领域。

行人检测技术难点

由于人体具有相当的柔性,因此会有各种姿态和形状,其外观受穿着,姿态,视角等影响非常大,另外还面临着遮挡 、光照等因素的影响,这使得行人检测成为计算机视觉领域中一个极具挑战性的课题。行人检测要解决的主要难题是:

-

外观差异大:包括视角,姿态,服饰和附着物,光照,成像距离等。从不同的角度看过去,行人的外观是很不一样的。处于不同姿态的行人,外观差异也很大。由于人穿的衣服不同,以及打伞、戴帽子、戴围巾、提行李等附着物的影响,外观差异也非常大。光照的差异也导致了一些困难。远距离的人体和近距离的人体,在外观上差别也非常大。

-

遮挡问题: 在很多应用场景中,行人非常密集,存在严重的遮挡,我们只能看到人体的一部分,这对检测算法带来了严重的挑战。

-

背景复杂:无论是室内还是室外,行人检测一般面临的背景都非常复杂,有些物体的外观和形状、颜色、纹理很像人体,导致算法无法准确的区分。

-

检测速度:行人检测一般采用了复杂的模型,运算量相当大,要达到实时非常困难,一般需要大量的优化。

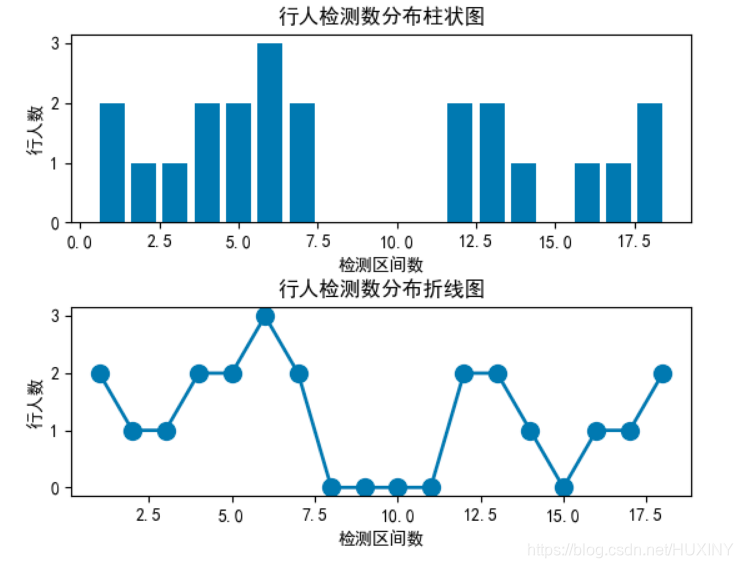

行人检测实现效果

检测到行人后还可以做流量分析:

import cv2

import numpy as np

import random

def load_images(dirname, amout = 9999):

img_list = []

file = open(dirname)

img_name = file.readline()

while img_name != '': # 文件尾

img_name = dirname.rsplit(r'/', 1)[0] + r'/' + img_name.split('/', 1)[1].strip('\n')

img_list.append(cv2.imread(img_name))

img_name = file.readline()

amout -= 1

if amout <= 0: # 控制读取图片的数量

break

return img_list

# 从每一张没有人的原始图片中随机裁出10张64*128的图片作为负样本

def sample_neg(full_neg_lst, neg_list, size):

random.seed(1)

width, height = size[1], size[0]

for i in range(len(full_neg_lst)):

for j in range(10):

y = int(random.random() * (len(full_neg_lst[i]) - height))

x = int(random.random() * (len(full_neg_lst[i][0]) - width))

neg_list.append(full_neg_lst[i][y:y + height, x:x + width])

return neg_list

# wsize: 处理图片大小,通常64*128; 输入图片尺寸>= wsize

def computeHOGs(img_lst, gradient_lst, wsize=(128, 64)):

hog = cv2.HOGDescriptor()

# hog.winSize = wsize

for i in range(len(img_lst)):

if img_lst[i].shape[1] >= wsize[1] and img_lst[i].shape[0] >= wsize[0]:

roi = img_lst[i][(img_lst[i].shape[0] - wsize[0]) // 2: (img_lst[i].shape[0] - wsize[0]) // 2 + wsize[0], \

(img_lst[i].shape[1] - wsize[1]) // 2: (img_lst[i].shape[1] - wsize[1]) // 2 + wsize[1]]

gray = cv2.cvtColor(roi, cv2.COLOR_BGR2GRAY)

gradient_lst.append(hog.compute(gray))

# return gradient_lst

def get_svm_detector(svm):

sv = svm.getSupportVectors()

rho, _, _ = svm.getDecisionFunction(0)

sv = np.transpose(sv)

return np.append(sv, [[-rho]], 0)

# 主程序

# 第一步:计算HOG特征

neg_list = []

pos_list = []

gradient_lst = []

labels = []

hard_neg_list = []

svm = cv2.ml.SVM_create()

pos_list = load_images(r'G:/python_project/INRIAPerson/96X160H96/Train/pos.lst')

full_neg_lst = load_images(r'G:/python_project/INRIAPerson/train_64x128_H96/neg.lst')

sample_neg(full_neg_lst, neg_list, [128, 64])

print(len(neg_list))

computeHOGs(pos_list, gradient_lst)

[labels.append(+1) for _ in range(len(pos_list))]

computeHOGs(neg_list, gradient_lst)

[labels.append(-1) for _ in range(len(neg_list))]

# 第二步:训练SVM

svm.setCoef0(0)

svm.setCoef0(0.0)

svm.setDegree(3)

criteria = (cv2.TERM_CRITERIA_MAX_ITER + cv2.TERM_CRITERIA_EPS, 1000, 1e-3)

svm.setTermCriteria(criteria)

svm.setGamma(0)

svm.setKernel(cv2.ml.SVM_LINEAR)

svm.setNu(0.5)

svm.setP(0.1) # for EPSILON_SVR, epsilon in loss function?

svm.setC(0.01) # From paper, soft classifier

svm.setType(cv2.ml.SVM_EPS_SVR) # C_SVC # EPSILON_SVR # may be also NU_SVR # do regression task

svm.train(np.array(gradient_lst), cv2.ml.ROW_SAMPLE, np.array(labels))

# 第三步:加入识别错误的样本,进行第二轮训练

# 参考 http://masikkk.com/article/SVM-HOG-HardExample/

hog = cv2.HOGDescriptor()

hard_neg_list.clear()

hog.setSVMDetector(get_svm_detector(svm))

for i in range(len(full_neg_lst)):

rects, wei = hog.detectMultiScale(full_neg_lst[i], winStride=(4, 4),padding=(8, 8), scale=1.05)

for (x,y,w,h) in rects:

hardExample = full_neg_lst[i][y:y+h, x:x+w]

hard_neg_list.append(cv2.resize(hardExample,(64,128)))

computeHOGs(hard_neg_list, gradient_lst)

[labels.append(-1) for _ in range(len(hard_neg_list))]

svm.train(np.array(gradient_lst), cv2.ml.ROW_SAMPLE, np.array(labels))

# 第四步:保存训练结果

hog.setSVMDetector(get_svm_detector(svm))

hog.save('myHogDector.bin')

篇幅有限,更多详细设计见设计论文

4 最后

项目包含内容

🧿 项目分享:见文末!

354

354

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?