作业1:

下段程序循环体执行的次数是是多少,为什么

下段程序循环体执行的次数是是多少,为什么

#include <stdio.h>

int main()

{

int i=1,n=0,num = 0;

while (n<=2*i)

{

n=i*i;

i=i+1;

num++;

}

return 0;

}

答:三次。算出来的。当i=3时,n=4.

----------------------分割线----------------------

作业2:

阅读下面程序,在???填上适当的语句,使程序完成指定的功能。并说明为什么?

程序说明:是用公式 求π的近似值,直到最后一项的绝对值小于是10 的负6 为止。

#include "stdio.h"

#include "math.h"

main()

{

int s=1;

float n=1,t=1,pi=0;

while( ??? )

{

pi=pi+ ??? ;

n= ??? ;

s=-s;

t=s/n;

}

pi=pi*4;

printf("pi=%f\n",pi);

} 答:

填入的答案依次为:fabs(t)>1e-6, t , n+2。由公式π/4=1-1/3+1/5-1/7+....可得,t为每一项的值;n的取值是首项为1公差为2的等差数列,所以n=n+2;pi为求和,所以pi=pi+t;根据题意,循环要执行到最后一项的绝对值小于是10的-6次为止,所以是fabs(t)>1e-6。

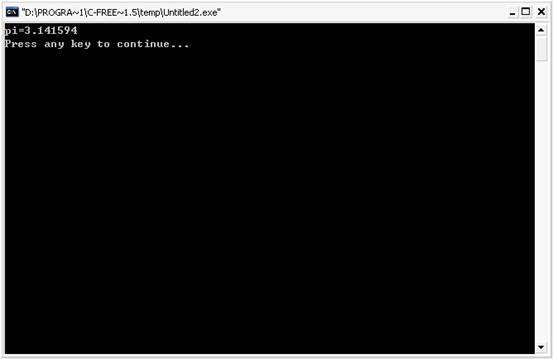

运行程序截图:

----------------------分割线----------------------

作业3:

阅读下面程序,在???填上适当的语句,使程序完成指定的功能。并说明为什么?

程序说明:冒泡对十个数按升序排序程序

#include "stdio.h"

main()

{

static int a[10]={12,23,14,5,6,1,0,10,9,7};

int i,j,t;

for(j=0;j<???;j++)

for(i=0;i<9-j;i++)

if(???)

{

t=a[i];a[i]=a[i+1];a[i+1]=t;}

for(i=0;i<10;???)

printf("%5d ",???);

} 答:

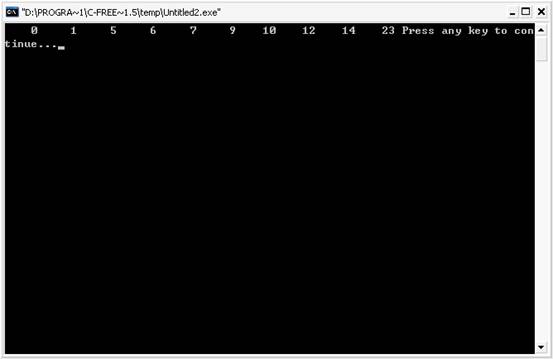

10 , a[i]>a[i+1] , i++ , a[i] 。10表示执行10次前后换位的循环;a[i]>a[i+1]判断前后项大小;循环控制变量i;输出的值是a[i]。

运行程序截图:

----------------------分割线----------------------

作业4:程序运行后的输出结果是什么,为什么?

#include <string.h>

#include <stdio.h>

struct STU

{

char name[10];

int num;

};

void f(char *name, int num)

{

struct STU s[2]={{"SunDan",20044},{"Penghua",20045}};

num = s[0].num;

strcpy(name, s[0].name);

}

main()

{

struct STU s[2]={{"YangSan",20041},{"LiSiGuo",20042}},*p;

p=&s[1]; f(p->name, p->num);

printf("%s %d\n", p->name, p->num);

}

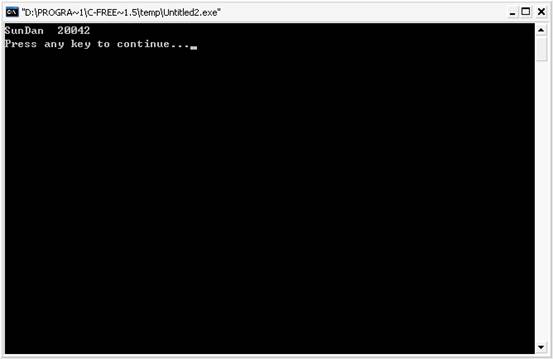

运行程序截图:

第12行代码,将数组结构中的“SnuDan”复制给了name,所以运用函数f()之后透过指针访问的name的值是固定的;第17行代码是透过指针访问了第二个数组结构的num。

----------------------分割线----------------------

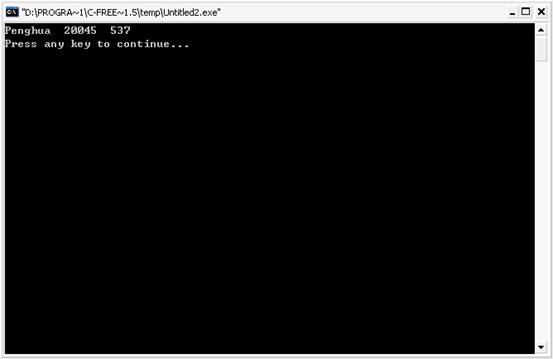

作业5:程序运行后的输出结果是什么,为什么?

#include <string.h>

#include <stdio.h>

struct STU

{ char name[10]; int num; float TotalScore; };

void f(struct STU *p)

{

struct STU s[2]={{"SunDan",20044,550},{"Penghua",20045,537}}, *q=s;

++p ; ++q; *p=*q;

}

main()

{

struct STU s[3]={{"YangSan",20041,703},{"LiSiGuo",20042,580}};

f(s);

printf("%s %d %3.0f\n", s[1].name, s[1].num, s[1].TotalScore);

}

5546

5546

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?