论文阅读笔记(十二)——U-Net: Convolutional Networks for Biomedical Image Segmentation

前言

还是干吧…本来以为可以养生了,结果还是得干活,好耶,使劲卷

1 论文简介

1.1 关于文章

论文名称:U-Net: Convolutional Networks for Biomedical Image Segmentation

1.2 关于模型

相信做语义分割的都知道这篇文章,主要要学着咋写了,unet,yyds。

2 文章正文

2.1 摘要

人们普遍认为,成功的深度网络训练需要数千个标注的训练样本。在本文中,我们提出了一种网络和训练策略,它依赖于强大的数据增强来更有效地使用可用的带注释的样本。该体系结构包括捕获上下文的收缩路径和支持精确定位的对称扩展路径。我们表明,这样的网络可以从很少的图像端到端训练,并在电子显微镜堆栈中分割神经元结构的ISBI挑战中优于先验最佳方法(滑动窗口卷积网络)。使用同样的网络训练透射光显微镜图像(相位对比度和DIC),我们在这些类别中以较大优势赢得了2015年ISBI细胞跟踪挑战。此外,网络速度很快。在最近的GPU上分割512x512图像只需要不到一秒的时间。完整的实现(基于Caffe)和经过培训的网络可以在http://lmb.informatik.uni-freiburg.de/people/ronneber/u-net上获得。

2.2 Motivation&Contributions

PS: 这一段主要是方便我们以后写Introduction与Related Work

2.2.1 Motivation

其实后面看,他这玩意不是很快

在过去的两年中,深度卷积网络在许多视觉识别任务中已经超越了目前的技术水平,例如。虽然卷积网络已经存在很长一段时间了,但由于可用训练集的大小和考虑的网络的大小,它们的成功受到了限制。Krizhevsky等人的突破是由于在ImageNet数据集上有100万张训练图像,对8层和数百万个参数的大型网络进行监督训练。从那时起,甚至更大更深的网络被训练出来。

卷积网络的典型应用是在分类任务中,对图像的输出是一个单一的类别标签。然而,在许多视觉任务中,特别是在生物医学图像处理中,期望的输出应该包括定位,即,一个类标签被分配给每个像素。此外,数以千计的训练图像在生物医学任务中通常是无法达到的。因此,Ciresan等人在滑动窗口设置中训练网络,通过提供像素周围的局部区域(补丁)来预测每个像素的类标签作为输入。首先,这个网络可以本地化。其次,以patch表示的训练数据远远大于训练图像的数量。最终的网络在ISBI 2012的EM分割挑战中获得了巨大的优势。

显然,Ciresan等人的策略有两个缺点。首先,速度比较慢,因为每个补丁都必须单独运行,而且由于补丁的重叠,有很多冗余。其次,在定位精度和上下文的使用之间存在一个权衡。较大的补丁需要更多的最大池层,这会降低定位精度,而较小的补丁只允许网络看到很少的上下文。最近的方法提出了一种考虑到多层特征的分类器输出。好的本土化和上下文的使用是可能的。

2.2.2 Contributions

在本文中,我们构建了一个更优雅的架构,即所谓的“全卷积网络”。(这里可能是翻译有问题,应该意思比FCN更加优雅的架构)我们修改和扩展了这个架构,这样它就可以在很少的训练图像上工作,并产生更精确的分割;参见下图。他的主要思想是用连续的层来补充通常的收缩网络,其中池运算符被上采样运算符取代。因此,这些层增加了输出的分辨率。为了实现局部定位,将收缩路径的高分辨率特征与上采样特征相结合输出。一个连续的卷积层可以学习根据这些信息组装更精确的输出。

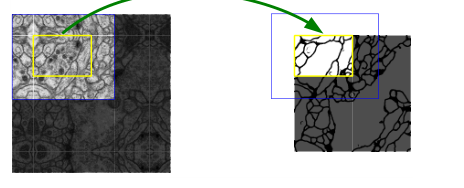

我们架构的一个重要修改是,在上采样部分我们也有大量的特征通道,这允许网络将上下文信息传播到更高的分辨率层。因此,扩展路径或多或少与收缩路径对称,并产生一个u型架构。该网络没有任何完全连接的层,只使用每个卷积的有效部分,即分割地图只包含输入图像中具有完整上下文的像素。该策略允许通过重叠贴图策略对任意大的图像进行无缝分割,见下图。为了预测图像边界区域的像素,通过镜像输入图像来推断缺失的上下文。这种平铺策略对于将网络应用于大型图像非常重要,否则分辨率将受到GPU内存的限制。

对于我们的任务来说,可用的训练数据非常少,我们通过应用弹性变形对可用的训练图像进行过度的数据增强。这允许网络学习这种变形的不变性,而不需要在带注释的图像语料库中看到这些转换。这在生物医学分割中尤其重要,因为变形曾经是组织中最常见的变化,并且真实的变形可以有效地模拟。在无监督特征学习的范围内,Dosovitskiy等人表明了数据增强对学习不变性的价值。

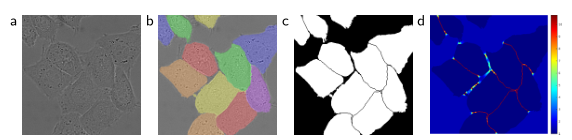

在许多细胞分割任务中,另一个挑战是分离同类别的接触对象;参见下图。为此,我们提出使用加权损失,即在触摸细胞之间的分离背景标签在损失函数中获得较大的权重。

所得到的网络适用于各种生物医学分割问题。在本文中,我们展示了EM堆栈中神经元结构的分割结果(ISBI 2012年开始的一项持续竞争),其中我们击败了Ciresan等人的网络。此外,我们还展示了来自2015年ISBI细胞跟踪挑战的光显微镜图像中的细胞分割结果。在这里,我们在两个最具挑战性的2D传输光数据集上获得了巨大的优势。

模型结构

PS:这是我见过写的最短的了

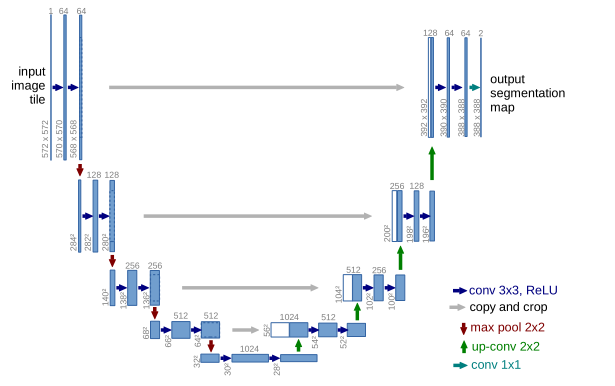

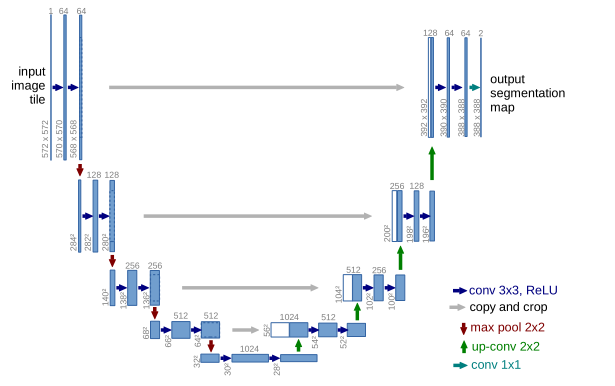

网络架构如图所示。它由收缩路径(左侧)和扩张路径(右侧)组成。

收缩路径遵循卷积网络的典型结构。它包括重复应用两个3x3的卷积(未填充的卷积),每个后面跟随一个矫正线性单元(ReLU)和一个2x2最大池化操作,stride=2用于降采样。在每个下采样步骤中,我们将特征信道的数量增加一倍。每一步的扩张路径由一个upsampling特性映射后跟2 x2卷积(“up-convolution”)部分频道的数量特性,与相应的裁剪功能连接图从缔约路径,和两个3 x3的隆起,每一个ReLU紧随其后。

裁剪是必要的,因为在每次卷积中都会丢失边缘像素。在最后一层,使用1x1卷积将每个64component特征向量映射到所需的类数量。网络共有23个卷积层。为了实现输出分割图的无缝平铺(见图2),选择输入平铺的大小是很重要的,这样所有的2x2最大池操作都应用到x和y大小相等的层上。

训练

利用输入图像及其对应的分割图,使用Caffe[6]的随机梯度下降实现来训练网络。由于未填充的卷积,输出图像比输入图像小一个恒定的边界宽度。为了最小化开销并最大限度地利用GPU内存,我们倾向于使用大的输入块而不是大的批处理大小,从而将批处理减少到单个图像。因此,我们使用一个高动量(0.99),以使大量之前看到的训练样本决定当前优化步骤中的更新。

激活函数是通过结合交叉熵损失函数在最终特征图上的像素级软最大值来计算的。soft-max的定义是

交叉熵公式

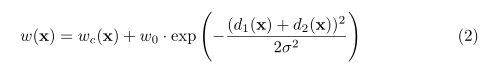

权重映射计算为

理想情况下,初始权值应该被调整,使网络中的每个特征映射具有近似的单位方差。对于具有我们架构的网络(交替卷积和ReLU层),这可以通过从标准偏差为p2/N的高斯分布中绘制初始权值来实现,其中N表示一个神经元[5]的传入节点数。例如,对于一个3x3的卷积,前一层有64个特征通道,N = 9·64 = 576。

数据增强

当只有很少的训练样本可用时,数据增强对于教导网络所需的不变性和鲁棒性是至关重要的。对于幅显微镜图像,我们首先需要平移和旋转不变性以及对变形和灰度值变化的鲁棒性。特别是训练样本的随机弹性变形,似乎是训练带注释图像较少的分割网络的关键概念。我们在3 × 3的粗糙网格上使用随机位移向量生成平滑变形。位移的采样是一个带有10个像素标准差的高斯分布。然后使用双三次插值计算逐像素位移。收缩路径末尾的退出层执行进一步的隐式数据扩展。

实验

我们演示u-net的应用到三个不同的分割任务。第一个任务是在电子显微镜记录中分割神经元结构。下图显示了数据集的示例和我们获得的分割。我们提供完整的结果作为补充资料。该数据集是由在ISBI 2012年开始的EM分割挑战提供的,仍然对新的贡献开放。训练数据是一组来自果蝇第一龄幼虫腹神经索(VNC)串行切片透射电子显微镜的30张图像(512x512像素)。每个图像都有相应的细胞(白色)和膜(黑色)的完全注释的地面真实分割图。测试集是公开的,但是它的分割地图是保密的。可以通过将预测的膜概率图发送给组织者来获得评估。评估是通过在10个不同的级别阈值地图和计算“扭曲误差”、“兰德误差”和“像素误差”来完成的。

![在EM segmentation challenge[14]上排名(2015年3月6日),按翘曲错误排序](https://img-blog.csdnimg.cn/20210329212108865.png)

u-net(平均超过7个旋转版本的输入数据)在没有任何进一步的预处理或后处理的情况下实现了0.0003529的翘曲误差(新的最佳分数,见表1)和0.0382的随机误差。

这明显优于Ciresan等人的滑动窗口卷积网络,其最佳提交翘曲误差为0.000420,rand误差为0.0504。在兰德误差方面,唯一表现更好的该数据集上的算法使用了Ciresan等人的概率图的高度数据集特定的后处理方法。

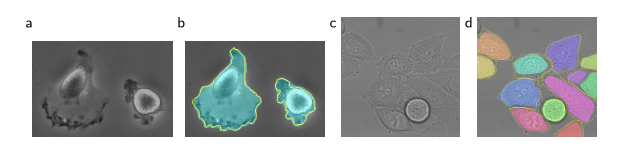

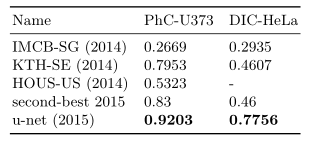

我们也应用u-net在光显微镜图像的细胞分割任务。这个分割任务是ISBI cell tracking challenge 2014和2015的一部分。第一个数据集“PhC-U373”2包含聚丙烯腈酰亚胺底物上的胶质母细胞瘤-星形细胞瘤U373细胞(见图4a,b和Supp.材料)。它包含35个部分注释的训练图像。这里我们实现平均借据(“十字路口在联盟”)的92%,这是明显比第二个最好的算法为83%(见表2)。第二个数据集“DIC-HeLa”3海拉细胞在平板玻璃(DIC)微分干涉对比显微镜记录的(参见图3,图4 c, d和增刊。材料)。它包含20张部分注释的训练图像。这里我们得到了77.5%的平均借据,这明显优于第二优算法的46%。

CONCLUSION

u-net体系结构在非常不同的生物医学分割应用中取得了非常好的性能。由于数据增强的弹性变形。它只需要很少的注释图像,在NVidia Titan GPU (6 GB)上只有10小时的训练时间,这是非常合理的。我们提供了完整的基于Caffe[6]的实现和训练有素的网络s4。我们确信u-net体系结构可以很容易地应用于更多的任务。

收获

- 还算阔以,就是感觉内容有点少。不过Unet的效果确实蛮不错的,缺点就是flops很高。

- 弹性变形数据增强方法

3739

3739

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?