1. 引言

在计算机视觉领域,目标检测(Object Detection)是一个至关重要的任务。它广泛应用于自动驾驶、视频监控、人脸识别、智能零售等领域。目标检测的核心问题是如何在一张图片中定位并识别多个目标,这比传统的图像分类(Classification)任务复杂得多。

传统的目标检测方法(如 Faster R-CNN)在精度上表现出色,但计算开销大,不适合嵌入式设备或实时应用。为了解决这一问题,SSD(Single Shot MultiBox Detector)MobileNet 结合了 SSD 框架的高效检测能力和 MobileNet 的轻量级特征提取能力,使得目标检测在移动设备、边缘计算和嵌入式设备上变得可行。

本文将详细解析 SSD MobileNet 的架构、原理、应用场景以及如何优化其性能。

2. SSD MobileNet 介绍

2.1 什么是 SSD?

SSD(Single Shot MultiBox Detector)是一种端到端的目标检测网络,能够在单次前向传播(Single Shot)过程中完成物体的位置预测和分类任务。它相比传统的 Faster R-CNN,去除了区域提议网络(RPN),因此计算效率更高。

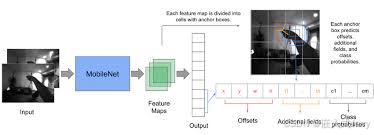

SSD 通过在输入图像的不同尺度上生成多个默认框(Prior Box 或 Anchor Box),并在这些框上进行分类和回归预测。其主要特点包括:

- 单步检测,不需要候选框生成,提高检测速度。

- 多尺度特征图,提高小目标检测能力。

- 使用不同尺寸的默认框,增强检测鲁棒性。

2.2 什么是 MobileNet?

MobileNet 是一种专为移动端和嵌入式设备设计的轻量级深度神经网络,它使用 深度可分离卷积(Depthwise Separable Convolution) 来减少计算量,提高计算效率。

MobileNet 的主要特点包括:

- 计算量小,参数量相比 VGG、ResNet 等模型大幅减少。

- 适用于低算力设备,如智能手机、嵌入式设备、IoT 设备等。

- 可用于迁移学习,容易与其他任务结合,如目标检测、语义分割等。

2.3 SSD MobileNet 结合的意义

将 SSD 作为目标检测框架,同时使用 MobileNet 作为其主干(Backbone),可以实现高效且轻量级的目标检测网络。

SSD MobileNet 兼具 SSD 的高检测速度和 MobileNet 的计算效率,非常适用于 实时目标检测任务,例如:

- 智能摄像头:实时人脸识别和安全监控。

- 自动驾驶:车辆和行人检测,提高交通安全。

- 机器人视觉:检测障碍物,实现自主导航。

- 智能零售:监控顾客行为,实现智能商品推荐。

3. SSD MobileNet 的架构解析

SSD MobileNet 的核心架构可以拆分为两个部分:

- Backbone(主干网络):用于提取图像特征。

- Prediction Layers(预测层):用于目标分类和边界框回归。

3.1 Backbone(MobileNet)

MobileNet 作为 SSD 的特征提取网络,负责将输入图片转换为多尺度的特征图。MobileNet 主要包含:

- 标准卷积层(Convolution Layer):用于提取低级特征,如边缘、颜色等。

- 深度可分离卷积(Depthwise Separable Convolution):减少计算复杂度,提高效率。

- 全局池化层(Global Average Pooling):降低计算量,提高泛化能力。

3.2 Prediction Layers(预测层)

SSD MobileNet 预测层主要包括:

- 类别分类(Class Prediction):在每个默认框上预测目标类别。

- 边界框回归(Box Regression):预测目标位置的坐标(x, y, w, h)。

为了实现更好的检测效果,SSD MobileNet 在多个尺度的特征图上进行预测。例如:

- 高层特征图:用于检测大目标。

- 底层特征图:用于检测小目标。

4. 训练 SSD MobileNet

4.1 训练数据

SSD MobileNet 需要大量的标注数据进行训练,常用的数据集包括:

- COCO(Common Objects in Context):80 类目标检测数据。

- PASCAL VOC:较小但经典的数据集,适用于快速实验。

- Open Images Dataset:更大规模的数据集,适用于复杂检测任务。

4.2 训练步骤

- 数据预处理:将数据转换为适当格式,如归一化、数据增强等。

- 定义损失函数:使用交叉熵损失(分类)和平滑 L1 损失(边界框回归)。

- 选择优化器:常用 Adam 或 SGD 进行训练。

- 训练与评估:使用 TensorFlow 或 PyTorch 训练,监测 mAP(mean Average Precision)作为衡量标准。

5. SSD MobileNet 的优化

5.1 量化(Quantization)

通过 INT8 量化,可以减少计算量,适用于移动端和嵌入式设备。例如,使用 TensorFlow Lite 可以量化模型:

import tensorflow as tf

converter = tf.lite.TFLiteConverter.from_saved_model("ssd_mobilenet_model")

converter.optimizations = [tf.lite.Optimize.DEFAULT]

tflite_model = converter.convert()

5.2 硬件加速

- 使用 Edge TPU(如 Google Coral)

- NVIDIA Jetson Nano 加速推理

- OpenVINO 适配 Intel 处理器

5.3 多线程优化

在树莓派等低算力设备上,可以使用 OpenCV DNN 进行多线程优化,提高检测速度。

6. 结论

SSD MobileNet 结合了 SSD 的高效检测和 MobileNet 的轻量级特性,在嵌入式 AI、自动驾驶、智能监控等领域具有广泛的应用前景。随着 AI 硬件的发展,SSD MobileNet 在边缘计算设备上的表现将进一步提升。

📌 总结:

✅ 速度快,适用于实时检测

✅ 计算量小,适用于嵌入式设备

✅ 可以进行量化,提升推理速度

🚀 未来,SSD MobileNet 仍将是轻量级目标检测领域的重要模型!

1075

1075

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?