ChatGPT横空出世引发了“百模大战”,算力需求成为焦点, GPU卡一时洛阳纸贵。训练一个大模型,究竟需要多少张GPU卡呢?2023年初写了篇文章《训练GPT模型需要多少算力?》大致总结了一下,但没有提到推导过程,今天有空展开聊聊。

据估计,OpenAI训练GPT-4模型,很有可能应用了10000到20000张英伟达A100。按照马斯克的说法,GPT-5的训练可能需要3万到5万张H100,可见随着大模型的迭代发展,训练所需算力也呈爆发性增长。

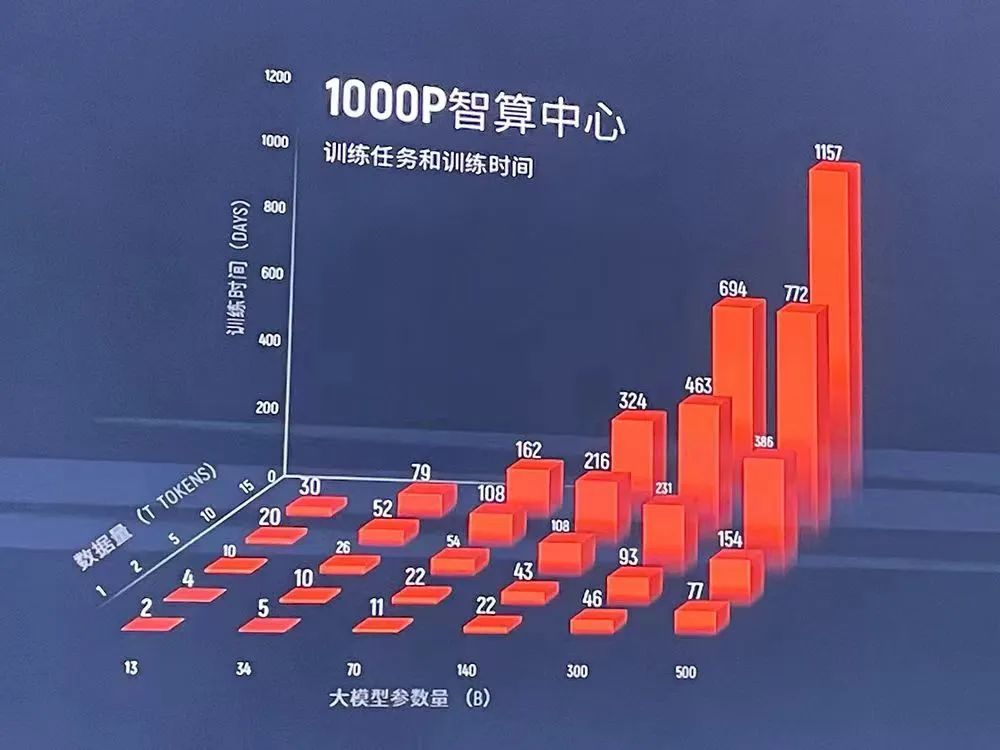

早在2020年,OpenAI使用数千张V100卡训练GPT-3,花了1个月左右的时间才完成。Inflection公司基于超过3500张H100卡,在C4数据集下,仅用了不到11分钟就训练完 GPT-3模型。下图是不同参数量、数据量的训练时间。

大模型训练需要的算力究竟是怎么计算出来的呢?OpenAI在Scaling Laws 论文中给我们提出了一个经验公式:C = rT ≈ 6*P*D

解释一下该公式:C是训练一个Transformer模型所需的算力,单位是FLOPS;

P是Transformer模型中参数的数量;

D是训练数据集的大小,也就是用多少tokens来训练;

r是训练集群中所有硬件总的算吞吐,单位是FLOPS,T是训练模型需要的时间,单位是秒。为什么系数是6?Scaling Laws论文对这个公式做了简单推导,在此不展开。

在计算所需算力的时候,我们刚才都是使用 FLOPS这个单位,即FLOP-seconds,其实使用 PFLOP-days更加直观。

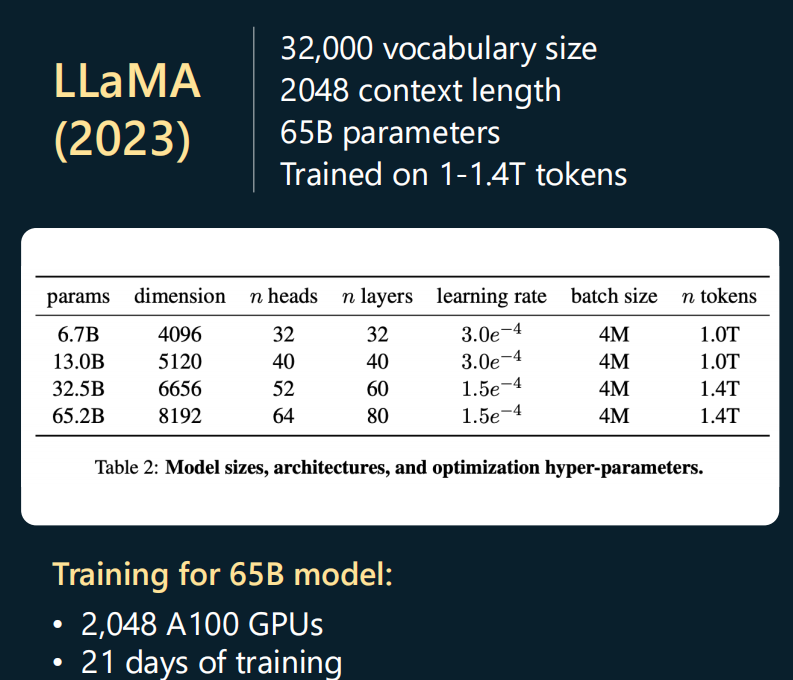

以 Meta 年初开源的LLaMA-1模型为例。

假设参数65B,基于1.4T的tokens 数据集,使用了2048张A100 ,需要多长训练时间呢?

首先,计算训练该模型所需的算力:

C = rT ≈ 6*P*D

=6*65*109*1.4*1012

=546*10^21 FLOPS

然后,根据《A100白皮书》给出的BF16 Tensor Core的算力为312 TFLOPS,实际上算力单块A100的算力一般在130-180 TFLOPS之间,我们取中间值150,2048张卡的集群算力吞吐为:

r=2048*150*1012=300*1015 FLOPS,即300PFLOPS

最后,代入到上面提到的公式:C = rT,得出训练LLaMA-1模型所需时间为:

T=C/r=546*1021/(300*1015)

=1.82*10^6 seconds ≈ 21 days

这一计算结果和 LLaMA-1 在论文中得出的实际训练时间基本一致。

如果将A100换成H100,需要多长时间?

根据《H100白皮书》上给出BF16的性能参数是1979 TFLOPS(稀疏算力指标),实际稠密算力大约在1000 TFLOPS。对比A100,差不多有 3 倍的增长。

简单测算可得出结论:使用相同数量的H100卡训练LLaMA-1模型,训练时间可从21天减少到10天以内。

下面给大家分享一份2025最新版的大模型学习路线,帮助新人小白更系统、更快速的学习大模型!

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享**

一、2025最新大模型学习路线

一个明确的学习路线可以帮助新人了解从哪里开始,按照什么顺序学习,以及需要掌握哪些知识点。大模型领域涉及的知识点非常广泛,没有明确的学习路线可能会导致新人感到迷茫,不知道应该专注于哪些内容。

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1级别:AI大模型时代的华丽登场

L1阶段:我们会去了解大模型的基础知识,以及大模型在各个行业的应用和分析;学习理解大模型的核心原理,关键技术,以及大模型应用场景;通过理论原理结合多个项目实战,从提示工程基础到提示工程进阶,掌握Prompt提示工程。

L2级别:AI大模型RAG应用开发工程

L2阶段是我们的AI大模型RAG应用开发工程,我们会去学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3级别:大模型Agent应用架构进阶实践

L3阶段:大模型Agent应用架构进阶实现,我们会去学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造我们自己的Agent智能体;同时还可以学习到包括Coze、Dify在内的可视化工具的使用。

L4级别:大模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,我们会更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调;并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

整个大模型学习路线L1主要是对大模型的理论基础、生态以及提示词他的一个学习掌握;而L3 L4更多的是通过项目实战来掌握大模型的应用开发,针对以上大模型的学习路线我们也整理了对应的学习视频教程,和配套的学习资料。

二、大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

三、大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

四、大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

五、大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

735

735

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?