题外话:这是一个“连载”,主要用于记录并监督我每周的Spark学习进程

【上周毕业典礼,放肆high~~~】

1、RDD基础

RDD(risilient distributed dataset )弹性分布式数据集,简单理解成不可变的分布式的元素集合

2.创建RDD【python】

创建RDD有两种:外部读取文件和自定义传递集合给SparkContext

shell命令:

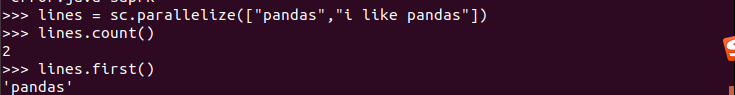

lines=sc.parallelize(["pandas","i love pandas"])#传递集合

lines.count()

运行截图:

shell命令:

lines=sc.textFile("README.md")#读取外部文件

lines.count()运行截图:

2.RDD操作【python】

RDD操作分为两种:转化操作和行动操作,其中转化操作是指由一个RDD转化为另一个RDD,行动操作是指在RDD上所进行的具体的计算,得出具体的值。值得注意的是,转

题外话:这是一个“连载”,主要用于记录并监督我每周的Spark学习进程【上周毕业典礼,放肆high~~~】1、RDD基础RDD(risilient distributed dataset )弹性分布式数据集,简单理解成不可变的分布式的元素集合2.创建RDD【python】创建RDD有两种:外部读取文件和自定义传递集合给SparkContextshell命令:lines...

题外话:这是一个“连载”,主要用于记录并监督我每周的Spark学习进程【上周毕业典礼,放肆high~~~】1、RDD基础RDD(risilient distributed dataset )弹性分布式数据集,简单理解成不可变的分布式的元素集合2.创建RDD【python】创建RDD有两种:外部读取文件和自定义传递集合给SparkContextshell命令:lines...

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2862

2862

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?