损失函数用来鼓励和抑制某些行为。

在深度学习中,如果是分类问题,则可以用交叉熵,softmax,SVM等损失函数。如果是回归问题,则代价函数普遍采用L2,或者L1。

由于L2(即用真值和预测值的欧氏距离)是一个非凸形式且可导。。但L2的使用前提是噪声高斯分布的。它抑制大的误差,但对小的误差却很能容忍。比如L2能很好地复现边缘,但却无法很好地消除那些小的噪声。

最重要的,L2和人类的视觉系统(human visual system (HVS))很不一样。HVS对局部信息很敏感,对光照,颜色变化很敏感。而人类制造的相机,其感光能力是以HVS为努力方向的。

结构相似性指数(structural similarity index,SSIM)和HVS一样,对局部结构变化很敏感,而且可导。即使对图片进行白噪声,对比度增强,mean-shifted处理,SSIM也不会变化太多。

先写两篇文章的简略笔记

1.论文一

Image Quality Assessment: From Error Visibility to Structural Similarity

当对一幅图片进行有损压缩,或者一幅图片有了噪声、畸变(distortion)等。我们人可以分辨出这两幅图大概率还是同一幅图,但如何有效地衡量他们的相似性呢?

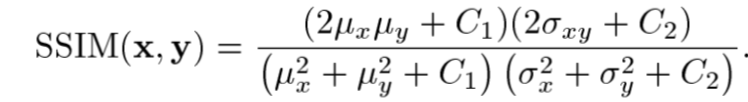

为了抵消普通的L2距离(Mean Square Error,MSE)无法衡量图片的结构相似性的缺陷,这篇文章提出了SSIM这种structure similarity的方法来做最后变化后的图片与变化前的结构相似性。

(各类相机的宗旨也是提供给更接近人眼感知系统(human vision system,HVS)的感知能力)

人眼对光照不敏感,但对局部(图像不同部分)光照的变化敏感。对灰度不敏感但对各部分灰度的相对变化程度敏感(对比度变化)。以及对整个很大局部的结构敏感。基于以上认知,作者最后提出的:

对于两个DxD的图像块,他们的SSIM始终小于1;1表示完全相似。其中

本文介绍了SSIM(结构相似性指数)作为损失函数在深度学习图像处理中的应用,对比了L2和SSIM的优缺点。论文一详细阐述了SSIM的计算原理,强调其对局部结构变化的敏感性。论文二则提出结合L1和MS-SSIM的损失函数,实验表明在图像恢复任务中表现出色。

本文介绍了SSIM(结构相似性指数)作为损失函数在深度学习图像处理中的应用,对比了L2和SSIM的优缺点。论文一详细阐述了SSIM的计算原理,强调其对局部结构变化的敏感性。论文二则提出结合L1和MS-SSIM的损失函数,实验表明在图像恢复任务中表现出色。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?